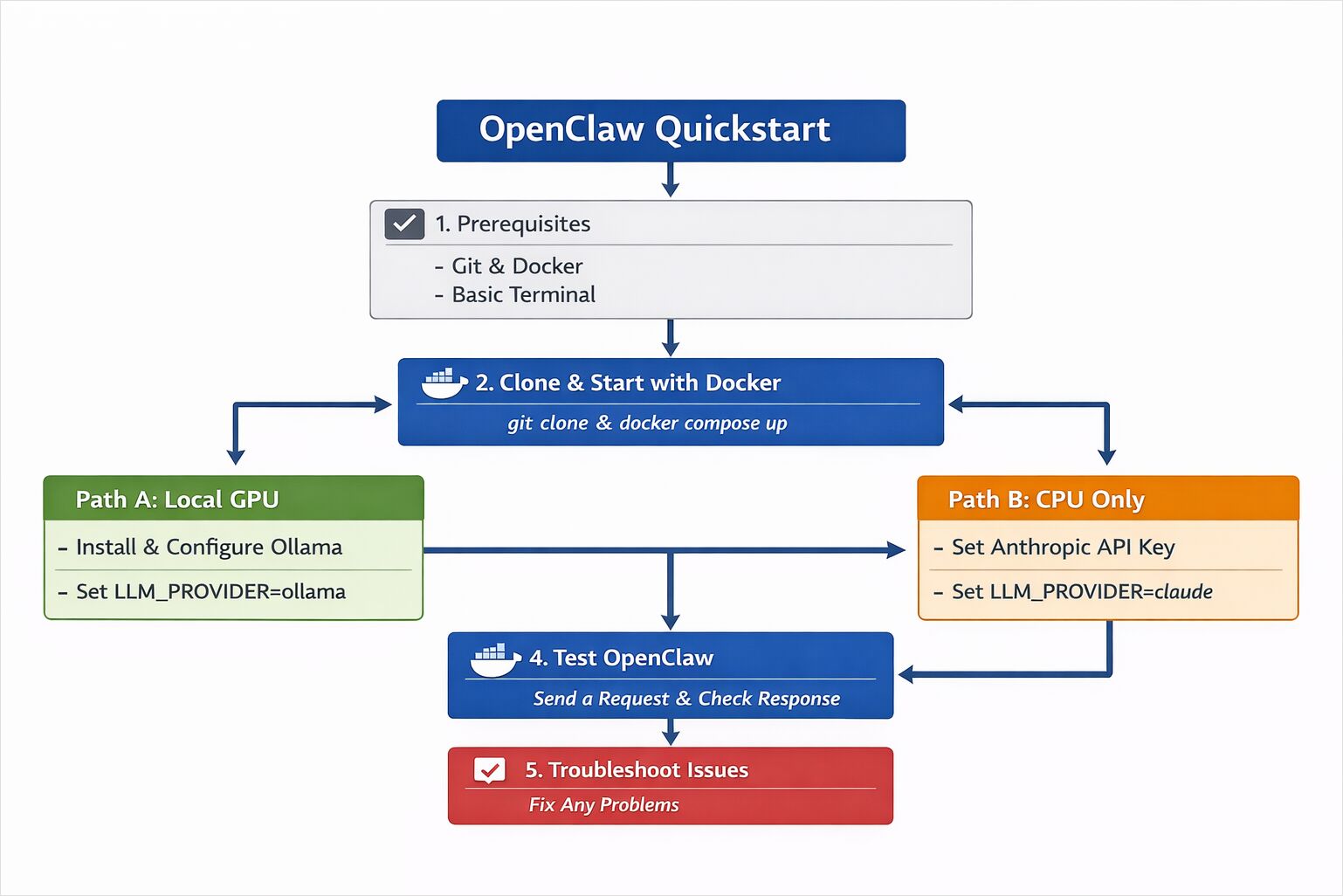

OpenClaw Guida Rapida: Installazione con Docker (Ollama GPU o Claude + CPU)

Installa OpenClaw localmente con Ollama

OpenClaw è un assistente AI self-hosted progettato per essere eseguito con runtime LLM locali come Ollama o con modelli basati sul cloud come Claude Sonnet.

Questa guida rapida mostra come distribuire OpenClaw utilizzando Docker, configurare un modello locale alimentato da GPU o un modello cloud solo CPU e verificare che il tuo assistente AI funzioni correttamente dall’inizio alla fine.

Questa guida illustra una configurazione minima di OpenClaw per permetterti di vederlo funzionare e rispondere sulla tua macchina.

L’obiettivo è semplice:

- Avviare OpenClaw.

- Inviare una richiesta.

- Confermare che funziona.

Questa non è una guida per l’hardening in produzione. Questa non è una guida per l’ottimizzazione delle prestazioni. Questo è un punto di partenza pratico.

Hai due opzioni:

- Percorso A — GPU Locale utilizzando Ollama (consigliato se disponi di una GPU)

- Percorso B — Solo CPU utilizzando Claude Sonnet 4.6 tramite API Anthropic

Entrambi i percorsi condividono lo stesso processo di installazione centrale.

Se sei nuovo a OpenClaw e desideri una panoramica più approfondita di come è strutturato il sistema, leggi la panoramica del sistema OpenClaw.

Requisiti di Sistema e Configurazione dell’Ambiente

OpenClaw è un sistema di tipo assistente che può connettersi a servizi esterni. Per questa Guida Rapida:

- Utilizzare account di test ove possibile.

- Evitare di connettere sistemi di produzione sensibili.

- Eseguirlo all’interno di Docker (consigliato).

L’isolamento è un’impostazione predefinita valida quando si sperimenta con software di tipo “agente”.

Prerequisiti OpenClaw (GPU con Ollama o CPU con Claude)

Richiesto per Entrambi i Percorsi

- Git

- Docker Desktop (o Docker + Docker Compose)

- Un terminale

Per Percorso A (GPU Locale)

- Una macchina con una GPU compatibile (NVIDIA o AMD consigliate)

- Ollama installato

Per Percorso B (CPU + Modello Cloud)

- Una chiave API Anthropic

- Accesso a Claude Sonnet 4.6

Passo 1 — Installazione di OpenClaw con Docker (Clona & Avvia)

OpenClaw può essere avviato utilizzando Docker Compose. Questo mantiene la configurazione contenuta e riproducibile.

Clona il repository

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Copia la configurazione dell’ambiente

cp .env.example .env

Apri .env nel tuo editor. Lo configureremo nel passo successivo a seconda del percorso del modello scelto.

Avvia i container

docker compose up -d

Se tutto parte correttamente, dovresti vedere i container in esecuzione:

docker ps

A questo punto, OpenClaw è in esecuzione — ma non è ancora connesso a un modello.

Passo 2 — Configura il Provider LLM (Ollama GPU o Claude CPU)

Ora decidi come desideri che funzioni l’inferenza.

Percorso A — GPU Locale con Ollama

Se hai una GPU disponibile, questa è l’opzione più semplice e più autonoma.

Installa o Verifica Ollama

Se hai bisogno di una guida di installazione più dettagliata o vuoi configurare le posizioni di archiviazione dei modelli, consulta:

- Installa Ollama e Configura la Posizione dei Modelli

- Ollama CLI Cheatsheet: ls, serve, run, ps + altri comandi (aggiornamento 2026)

Se Ollama non è installato:

curl -fsSL https://ollama.com/install.sh | sh

Verifica che funzioni:

ollama pull llama3

ollama run llama3

Se il modello risponde, l’inferenza funziona.

Configura OpenClaw per Utilizzare Ollama

Nel tuo file .env, configura:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Riavvia i container:

docker compose restart

OpenClaw instraderà ora le richieste alla tua istanza locale di Ollama.

Se stai decidendo quale modello eseguire su una GPU con 16GB di VRAM o desideri confronti di benchmark, consulta:

Per comprendere la concorrenza e il comportamento della CPU sotto carico:

- Come Ollama Gestisce le Richieste Parallele

- Test: Come Ollama Utilizza le Prestazioni della CPU Intel e i Core Efficienti

Percorso B — Solo CPU Utilizzando Claude Sonnet 4.6

Se non hai una GPU, puoi utilizzare un modello ospitato.

Aggiungi la Tua Chiave API

Nel tuo file .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Riavvia:

docker compose restart

OpenClaw utilizzerà ora Claude Sonnet 4.6 per l’inferenza mentre l’orchestrazione viene eseguita localmente.

Questa configurazione funziona bene su macchine solo CPU perché il pesante calcolo del modello avviene nel cloud.

Se stai utilizzando modelli Anthropic qui, questo cambiamento nella politica di abbonamento Claude spiega perché OpenClaw richiede una fatturazione basata sulle API invece del riutilizzo del piano Claude.

Passo 3 — Test di OpenClaw con il Tuo Primo Prompt

Una volta che i container sono in esecuzione e il modello è configurato, puoi testare l’assistente.

A seconda della tua configurazione, ciò può avvenire tramite:

- Un’interfaccia web

- Un’integrazione di messaggistica

- Un endpoint API locale

Per un test API di base:

curl http://localhost:3000/health

Dovresti vedere una risposta di stato “healthy” (sano).

Ora invia un prompt semplice:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Explain what OpenClaw does in simple terms."}'

Se ricevi una risposta strutturata, il sistema funziona.

Cosa Hai Just Eseguito

A questo punto, hai:

- Un’istanza OpenClaw in esecuzione

- Un provider LLM configurato (locale o cloud)

- Un ciclo di richiesta-risposta funzionante

Se hai scelto il percorso GPU, l’inferenza avviene localmente tramite Ollama.

Se hai scelto il percorso CPU, l’inferenza avviene tramite Claude Sonnet 4.6, mentre l’orchestrazione, l’instradamento e la gestione della memoria vengono eseguiti all’interno dei tuoi container Docker locali.

L’interazione visibile può sembrare semplice. Sotto la superficie, diversi componenti coordinano per elaborare la tua richiesta.

Risoluzione dei Problemi di Installazione e Esecuzione di OpenClaw

Modello Non Risponde

- Verifica la configurazione del tuo file

.env. - Controlla i log dei container:

docker compose logs

Ollama Non Raggiungibile

- Conferma che Ollama sia in esecuzione:

ollama list

- Assicurati che l’URL base corrisponda al tuo ambiente.

Chiave API Non Valida

- Ricontrolla

ANTHROPIC_API_KEY - Riavvia i container dopo aver aggiornato

.env

GPU Non Utilizzata

- Conferma che i driver GPU siano installati.

- Assicurati che Docker abbia l’accesso alla GPU abilitato.

Prossimi Passi Dopo l’Installazione di OpenClaw

Ora hai un’istanza OpenClaw funzionante.

Da qui, puoi:

- Connettere piattaforme di messaggistica

- Abilitare il recupero di documenti

- Sperimentare strategie di instradamento

- Aggiungere osservabilità e metriche

- Ottimizzare le prestazioni e il comportamento dei costi

Le discussioni architetturali più approfondite hanno più senso una volta che il sistema è in esecuzione.

Metterlo in funzione è il primo passo.

Una volta che è in esecuzione, i prossimi articoli naturali sono:

- Guida ai plugin OpenClaw — quali plugin installare per memoria, strumenti, canali e osservabilità, e come funziona il ciclo di vita

- Guida alle abilità OpenClaw — quali abilità vale la pena installare da ClawHub e come gestirle in sicurezza per ruolo dell’agente

- Pattern di configurazione in produzione per OpenClaw — come plugin e abilità si combinano per tipi di utenti reali come sviluppatori, team di automazione, ricercatori e operatori di supporto

Per ulteriori casi studio sui sistemi AI, consulta la sezione Sistemi AI.