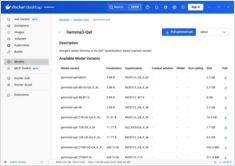

Qwen 3.6 27B e 35B MTP rispetto allo standard su GPU da 16 GB

MTP rispetto alla decodifica standard su RTX 4080 — benchmark reali

Ho testato le prestazioni di Speculative Decoding (Multi-Token Prediction, MTP) su Qwen 3.6 27B e 35B su una RTX 4080 con 16 GB di VRAM.