Spostare i modelli Ollama in una posizione diversa

I file dei modelli LLM di Ollama occupano molto spazio.

Dopo aver installato ollama, è meglio riconfigurare Ollama per memorizzarli subito in un nuovo luogo. In questo modo, dopo aver scaricato un nuovo modello, non verrà scaricato nella posizione vecchia.

Informazioni su Ollama

Ollama è un frontend testuale per i Modelli di IA LLM e un’API che può ospitarli. Per un confronto più ampio tra Ollama e vLLM, Docker Model Runner, LocalAI e i provider cloud—comprese le compensazioni tra costi e infrastruttura—consulta Ospitalità LLM: Confronto tra infrastruttura locale, self-hosted e cloud.

Installa Ollama

Vai su https://ollama.com/download

Per installare Ollama su Linux:

curl -fsSL https://ollama.com/install.sh | sh

Ollama per Windows si trova in questa pagina: https://ollama.com/download/windows Ollama per Mac è disponibile anche qui: https://ollama.com/download/macOllamaSetup.exe

Scaricare, elencare e rimuovere i modelli Ollama

Per scaricare alcuni modelli Ollama: Vai alla Libreria di Ollama (https://ollama.com/library) e trova il modello che ti serve; lì potrai anche trovare i tag e le dimensioni dei modelli.

Quindi esegui:

ollama pull gemma2:latest

# Oppure ottieni uno leggermente più intelligente che si adatta ancora bene in 16GB di VRAM:

ollama pull gemma2:27b-instruct-q3_K_S

# Oppure:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

Per verificare i modelli che Ollama ha nel repository locale:

ollama list

Per rimuovere un modello non necessario:

ollama rm qwen2:7b-instruct-q8_0 # ad esempio

Posizione del modello Ollama

Di default, i file del modello sono memorizzati in:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

La stessa preoccupazione relativa all’archiviazione si presenta quando Ollama viene eseguito in container: desideri avere modelli e stato del server su un volume nominato o un mount legato (e opzionalmente OLLAMA_MODELS quando il layout deve differire dal percorso predefinito /root/.ollama nell’immagine ufficiale). Per un layout Compose completo con riserva GPU, OLLAMA_HOST, aggiornamenti e schemi di rollback, consulta Ollama in Docker Compose con GPU e archiviazione persistente dei modelli.

Configurare il percorso dei modelli Ollama su Windows

Per creare una variabile di ambiente su Windows, puoi seguire queste istruzioni:

- Apri Impostazioni di Windows.

- Vai su Sistema.

- Seleziona Informazioni.

- Seleziona Impostazioni di sistema avanzate.

- Vai alla scheda Avanzate.

- Seleziona Variabili di ambiente….

- Clicca su Nuova…

- E crea una variabile chiamata OLLAMA_MODELS che punta alla posizione in cui desideri memorizzare i modelli

Spostare i modelli Ollama su Linux

Modifica i parametri del servizio systemd di ollama

sudo systemctl edit ollama.service

oppure

sudo xed /etc/systemd/system/ollama.service

Questo aprirà un editor.

Per ciascuna variabile di ambiente, aggiungi una riga Environment sotto la sezione [Service]:

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

Salva ed esci.

Esistono anche i parametri Utente e Gruppo, che devono avere accesso a questa cartella.

Ricarica systemd e riavvia Ollama:

sudo systemctl daemon-reload

sudo systemctl restart ollama

se qualcosa è andato storto

systemctl status ollama.service

sudo journalctl -u ollama.service

Overhead di archiviazione file su NTFS

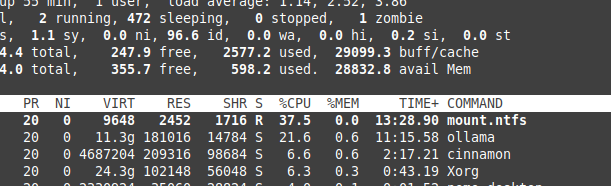

Tieni presente che se stai eseguendo Linux e tieni i tuoi modelli su una partizione formattata NTFS, i tuoi modelli verranno caricati molto più lentamente—più del 20%.

Installa Ollama su Windows in una cartella specifica

Insieme ai modelli

.\OllamaSetup.exe /DIR=D:\OllamaDir

Esporre l’API Ollama alla rete interna

Per “interno” si intende la rete locale.

Aggiungi alla configurazione del servizio:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

Questo espone l’API HTTP in chiaro sulla tua rete. Per HTTPS automatizzato, streaming corretto e proxy WebSocket tramite Caddy o Nginx, e rafforzamento del perimetro (timeout, buffering, autenticazione opzionale davanti all’API), usa Ollama dietro un proxy inverso con Caddy o Nginx per lo streaming HTTPS.

Per accedere a Ollama da dispositivi remoti senza aprire porte pubbliche, usa un overlay privato (Tailscale) o WireGuard; consulta Accesso remoto a Ollama tramite Tailscale o WireGuard, senza porte pubbliche.

Per vedere come Ollama si inserisce tra le altre opzioni LLM locali e cloud, controlla la nostra guida Ospitalità LLM: Confronto tra infrastruttura locale, self-hosted e cloud.

Link utili

- Test: Come Ollama utilizza le prestazioni della CPU Intel e i nuclei efficienti

- Come Ollama gestisce le richieste parallele

- Prestazioni LLM e lane PCIe: considerazioni chiave

- Confronto delle prestazioni di velocità LLM

- Confronto delle capacità di riassunto degli LLM

- Scrittura di prompt efficaci per gli LLM

- Self-hosting di Perplexica - con Ollama

- Fornitori cloud LLM