澳大利亚GPU和RAM价格飙升:RTX 5090上涨15%,内存上涨38% - 2026年1月

2025年1月GPU和RAM价格检查

今天我们将关注顶级消费级显卡和内存模块。

具体来说,我关注的是

RTX-5080和RTX-5090价格,以及32GB(2x16GB)DDR5 6000。

2025年1月GPU和RAM价格检查

今天我们将关注顶级消费级显卡和内存模块。

具体来说,我关注的是

RTX-5080和RTX-5090价格,以及32GB(2x16GB)DDR5 6000。

为你的 Linux 工作流程选择合适的终端

对于Linux用户来说,最必不可少的工具之一是终端模拟器。

现在从澳大利亚零售商处获得真实的AUD定价

NVIDIA DGX Spark (GB10 Grace Blackwell) 现已在澳大利亚 now available in Australia 主要电脑零售商处有现货销售。 如果你一直在关注 全球 DGX Spark 价格和供货情况, 你可能会对澳大利亚的价格感兴趣,价格范围从 6,249 至 7,999 澳元,具体取决于存储配置和零售商。

使用本地LLM测试Cognee - 实际效果

Cognee 是一个 Python 框架,用于使用 LLM 从文档中构建知识图谱。 但它能与自托管模型一起使用吗?

我在Ubuntu中解决网络问题的方法

在自动安装新内核后,Ubuntu 24.04 丢失以太网网络。这个问题第二次出现在我身上,因此我在此记录解决方法,以帮助遇到相同问题的其他人。

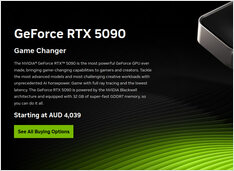

简短的帖子,仅记录价格

在当前内存价格剧烈波动的背景下,为了更好地了解情况,我们不妨先自行跟踪澳大利亚的内存价格。

“由于人工智能需求导致供应紧张,RAM价格暴涨163%至619%”

2025年下半段,内存市场正经历前所未有的价格波动,所有细分市场中RAM价格均出现大幅上涨。

适合人工智能的消费级显卡价格 - RTX 5080 和 RTX 5090

让我们比较顶级消费级GPU的价格,这些GPU特别适合LLMs,也适用于AI整体。 具体来说,我正在查看 RTX-5080和RTX-5090价格。

在预算硬件上部署企业级AI,使用开放模型

人工智能的民主化已经到来。

借助像 Llama 3、Mixtral 和 Qwen 这样的开源大语言模型(LLM),团队现在可以使用消费级硬件构建强大的 AI 基础设施 - 在降低成本的同时,仍能完全控制数据隐私和部署。

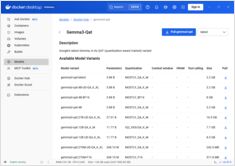

启用 NVIDIA CUDA 支持的 Docker 模型运行器的 GPU 加速功能

Docker Model Runner 是 Docker 官方用于本地运行 AI 模型的工具,但

在 Docker Model Runner 中启用 NVidia GPU 加速

需要特定的配置。

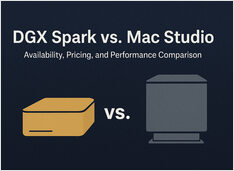

GPT-OSS 120b 在三个 AI 平台上的基准测试

我找到了一些关于GPT-OSS 120b在三个不同平台上运行的性能测试结果:NVIDIA DGX Spark、Mac Studio和RTX 4080。Ollama库中的GPT-OSS 120b模型大小为65GB,这意味着它无法装入RTX 4080(或更新的RTX 5080的16GB显存中。

Docker Model Runner 命令快速参考

Docker Model Runner (DMR) 是 Docker 官方用于本地运行 AI 模型的解决方案,于 2025 年 4 月推出。此快速参考提供了所有关键命令、配置和最佳实践的快速查阅。

使用 GNOME Boxes 管理 Linux 虚拟机

在当今的计算环境中,虚拟化已成为开发、测试和运行多个操作系统的重要工具。对于寻求一种简单直观方式来管理虚拟机的 Linux 用户来说,GNOME Boxes 是一个轻量且用户友好的选择,它在不牺牲功能性的前提下优先考虑易用性。

专用芯片正在让人工智能推理变得更加快速、廉价。

可用性、六个国家的真实零售价格以及与Mac Studio的对比。

NVIDIA DGX Spark 是真实存在的,将于 2025年10月15日 开售,目标用户是需要 本地大型语言模型(LLM)工作 的 CUDA 开发者,配备集成的 NVIDIA AI 套件。美国建议零售价为 3,999美元;由于增值税和渠道因素,英国/德国/日本 的零售价更高。澳大利亚/韩元 的公开标价 尚未广泛发布。

适合AI的消费级GPU价格 - RTX 5080 和 RTX 5090

一再地,让我们比较顶级消费级GPU的价格,这些GPU特别适合LLMs,也适用于AI整体。

具体来说,我正在查看

RTX-5080和RTX-5090价格。

它们的价格略有下降。