OpenClaw – szybki start: instalacja przez Docker (Ollama z GPU lub Claude z CPU)

Zainstaluj OpenClaw lokalnie za pomocą Ollama.

OpenClaw to samodzielnie hostowany asystent AI zaprojektowany do działania z lokalnymi środowiskami uruchomienia modeli LLM, takimi jak Ollama, lub z modelami chmurowymi, np. Claude Sonnet.

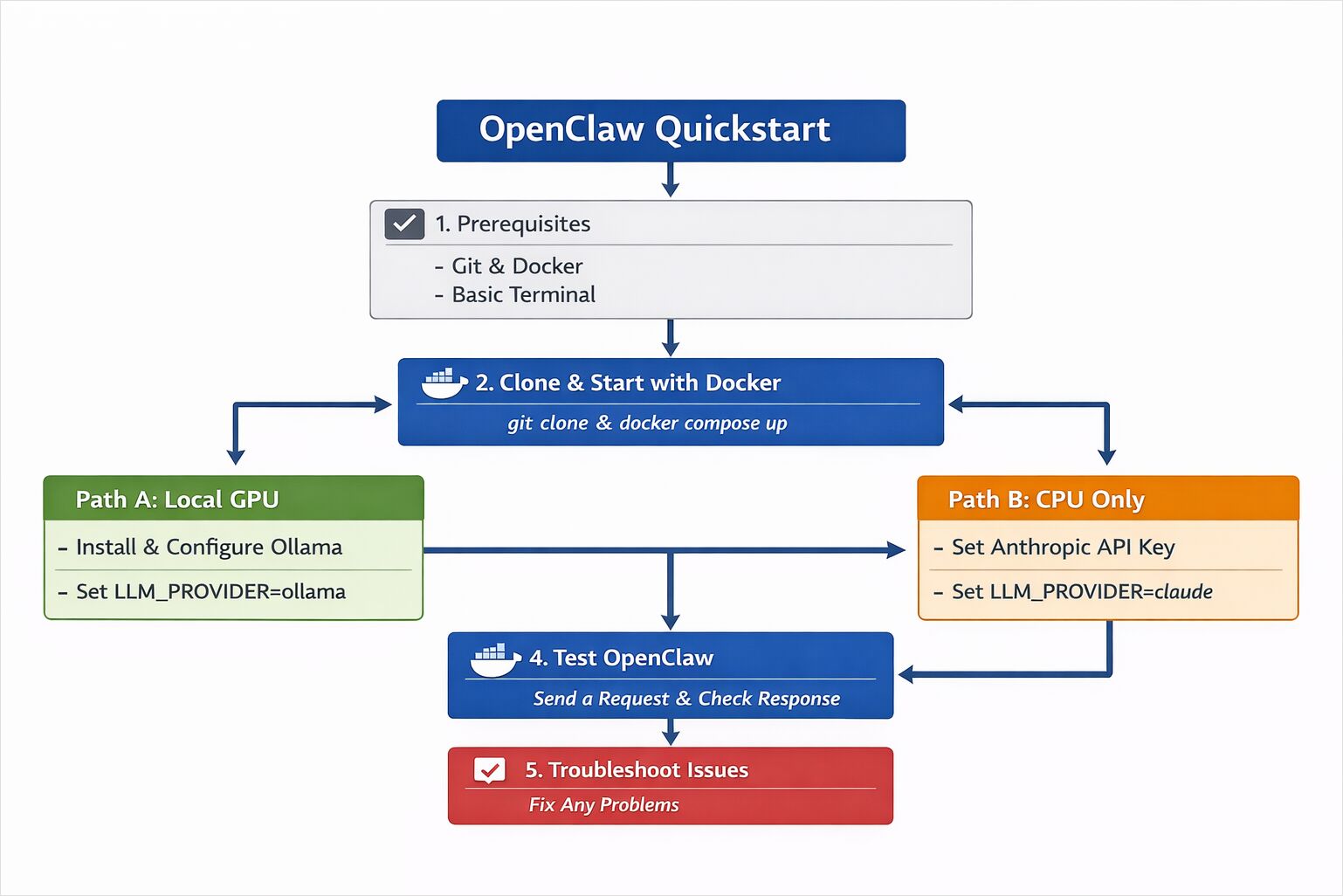

Ten przewodnik szybkiego startu pokaże, jak wdrożyć OpenClaw za pomocą Docker, skonfigurować model lokalny z akceleracją GPU lub model chmurowy działający wyłącznie na CPU, a następnie zweryfikować, czy Twój asystent AI działa poprawnie od początku do końca.

Ten przewodnik przeprowadzi Cię przez minimalną konfigurację OpenClaw, dzięki czemu zobaczysz go działającego i odpowiadającego na Twoim własnym komputerze.

Cel jest prosty:

- Uruchom OpenClaw.

- Wyślij zapytanie.

- Potwierdź, że wszystko działa.

To nie jest przewodnik dotyczący przygotowania środowiska produkcyjnego.

To nie jest przewodnik dotyczący optymalizacji wydajności.

To praktyczny punkt wyjścia.

Masz dwie możliwości:

- Ścieżka A — Lokalny GPU przy użyciu Ollama (zalecane, jeśli masz kartę GPU)

- Ścieżka B — Tylko CPU przy użyciu Claude Sonnet 4.6 przez API Anthropic

Obie ścieżki wykorzystują ten sam podstawowy proces instalacji.

Jeśli dopiero zaczynasz przygodę z OpenClaw i chcesz uzyskać głębsze zrozumienie struktury systemu, przeczytaj Przegląd systemu OpenClaw.

Wymagania systemowe i konfiguracja środowiska

OpenClaw to system w stylu asystenta, który może łączyć się z zewnętrznymi usługami. W ramach tego szybkiego startu:

- Używaj kont testowych, gdzie to możliwe.

- Unikaj podłączania wrażliwych systemów produkcyjnych.

- Uruchamiaj go wewnątrz Docker (zalecane).

Izolacja jest dobrym domyślnym wyborem podczas eksperymentowania z oprogramowaniem opartym na agentach.

Wymagania wstępne OpenClaw (GPU z Ollama lub CPU z Claude)

Wymagane dla obu ścieżek

- Git

- Docker Desktop (lub Docker + Docker Compose)

- Terminal

Dla ścieżki A (Lokalny GPU)

- Komputer z kompatybilną kartą GPU (zalecane NVIDIA lub AMD)

- Zainstalowany Ollama

Dla ścieżki B (CPU + Model chmurowy)

- Klucz API Anthropic

- Dostęp do modelu Claude Sonnet 4.6

Krok 1 — Instalacja OpenClaw z Docker (Klonowanie i uruchomienie)

OpenClaw można uruchomić za pomocą Docker Compose. Dzięki temu konfiguracja pozostaje zamknięta w jednym miejscu i jest powtarzalna.

Sklonuj repozytorium

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Skopiuj konfigurację środowiska

cp .env.example .env

Otwórz plik .env w swoim edytorze. Zkonfiguruje go w następnym kroku w zależności od wybranej ścieżki modelu.

Uruchom kontenery

docker compose up -d

Jeśli wszystko ruszy poprawnie, powinieneś zobaczyć działające kontenery:

docker ps

Na tym etapie OpenClaw jest uruchomiony, ale jeszcze nie połączony z modelem.

Krok 2 — Konfiguracja dostawcy LLM (Ollama GPU lub Claude CPU)

Teraz zdecyduj, jak ma działać wnioskowanie (inferencja).

Ścieżka A — Lokalny GPU z Ollama

Jeśli masz dostępną kartę GPU, jest to najprostsza i najbardziej samodzielna opcja.

Instalacja lub weryfikacja Ollama

Jeśli potrzebujesz bardziej szczegółowego przewodnika instalacyjnego lub chcesz skonfigurować lokalizacje przechowywania modeli, zobacz:

- Instalacja Ollama i konfiguracja lokalizacji modeli

- Ollama CLI Cheatsheet: ls, serve, run, ps i inne polecenia (aktualizacja 2026)

Jeśli Ollama nie jest zainstalowany:

curl -fsSL https://ollama.com/install.sh | sh

Zweryfikuj, czy działa:

ollama pull llama3

ollama run llama3

Jeśli model odpowiada, wnioskowanie działa.

Skonfiguruj OpenClaw do użycia Ollama

W pliku .env skonfiguruj:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Uruchom ponownie kontenery:

docker compose restart

OpenClaw będzie teraz przekazywać zapytania do Twojej lokalnej instancji Ollama.

Jeśli zastanawiasz się, który model uruchomić na GPU z 16 GB VRAM lub chcesz porównań wydajności, zobacz:

Aby zrozumieć kwestie konkurencyjności i zachowania CPU pod obciążeniem:

- Jak Ollama obsługuje równoległe żądania

- Test: Jak Ollama wykorzystuje wydajność procesorów Intel i efektywne rdzenie

Ścieżka B — Tylko CPU przy użyciu Claude Sonnet 4.6

Jeśli nie masz karty GPU, możesz skorzystać z modelu hostowanego.

Dodaj swój klucz API

W pliku .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Uruchom ponownie:

docker compose restart

OpenClaw będzie teraz używać Claude Sonnet 4.6 do wnioskowania, podczas gdy orkiestracja będzie działać lokalnie.

Ta konfiguracja działa dobrze na komputerach tylko z CPU, ponieważ ciężkie obliczenia modelu odbywają się w chmurze.

Jeśli korzystasz tutaj z modeli Anthropic, ta zmiana w polityce subskrypcji Claude wyjaśnia, dlaczego OpenClaw wymaga rozliczeń opartych na API, zamiast ponownego wykorzystania planu Claude.

Krok 3 — Przetestuj OpenClaw z pierwszym promptem

Po uruchomieniu kontenerów i skonfigurowaniu modelu możesz przetestować asystenta.

W zależności od konfiguracji może to być:

- Interfejs webowy

- Integracja z platformą wiadomości

- Lokalny punkt końcowy API

Dla podstawowego testu API:

curl http://localhost:3000/health

Powinieneś zobaczyć odpowiedź o statusie zdrowia.

Teraz wyślij prosty prompt:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Wyjaśnij, co robi OpenClaw, prostymi słowami."}'

Jeśli otrzymasz sformatowaną odpowiedź, system działa.

Co właśnie uruchomiłeś

Na tym etapie masz:

- Działającą instancję OpenClaw

- Skonfigurowanego dostawcę LLM (lokalny lub chmurowy)

- Działający pętla żądania-odpowiedzi

Jeśli wybrałeś ścieżkę GPU, wnioskowanie odbywa się lokalnie przez Ollama.

Jeśli wybrałeś ścieżkę CPU, wnioskowanie odbywa się przez Claude Sonnet 4.6, podczas gdy orkiestracja, przekierowanie i obsługa pamięci działają wewnątrz Twoich lokalnych kontenerów Docker.

Widoczna interakcja może wydawać się prosta. Pod spodem wiele komponentów współdziała, aby przetworzyć Twoje żądanie.

Rozwiązywanie problemów z instalacją i uruchomieniem OpenClaw

Model nie odpowiada

- Zweryfikuj konfigurację pliku

.env. - Sprawdź logi kontenerów:

docker compose logs

Ollama nieosiągalny

- Potwierdź, że Ollama działa:

ollama list

- Upewnij się, że podstawowy URL pasuje do Twojego środowiska.

Nieprawidłowy klucz API

- Sprawdź ponownie

ANTHROPIC_API_KEY. - Uruchom ponownie kontenery po aktualizacji

.env.

GPU nie jest wykorzystywany

- Potwierdź, że sterowniki GPU są zainstalowane.

- Upewnij się, że dostęp GPU dla Docker jest włączony.

Kolejne kroki po zainstalowaniu OpenClaw

Masz teraz działającą instancję OpenClaw.

Stąd możesz:

- Podłączyć platformy komunikacyjne

- Włączyć pobieranie dokumentów

- Eksperymentować ze strategiami przekierowania

- Dodać obserwowalność i metryki

- Dostosować wydajność i zachowanie kosztów

Głębsze dyskusje architektoniczne mają więcej sensu, gdy system już działa.

Udostępnienie go to pierwszy krok.

Po uruchomieniu naturalnymi kolejnymi artykułami są:

- Przewodnik po wtyczkach OpenClaw — które wtyczki zainstalować dla pamięci, narzędzi, kanałów i obserwowalności oraz jak działa cykl życia

- Przewodnik po umiejętnościach OpenClaw — które umiejętności warto zainstalować z ClawHub i jak bezpiecznie ograniczać je w zależności od roli agenta

- Wzorce konfiguracji produkcyjnej OpenClaw — jak wtyczki i umiejętności łączą się dla rzeczywistych typów użytkowników, takich jak programiści, zespoły automatyzacji, badacze i operatorzy wsparcia

Aby zobaczyć więcej studiów przypadków systemów AI, zobacz sekcję Systemy AI.