Przeniesienie modeli Ollama do innego lokalizacji

Pliki modeli LLM Ollama zajmują dużo miejsca.

Po zainstalowaniu Ollama lepiej jest od razu skonfigurować Ollama tak, aby przechowywał je w nowej lokalizacji. Dzięki temu po pociągnięciu nowego modelu nie zostanie on pobrany do starego miejsca.

O Ollama

Ollama to tekstowy interfejs do Modeli LLM AI oraz API, które może je również hostować. Szersze porównanie Ollama z vLLM, Docker Model Runner, LocalAI oraz dostawcami chmurowymi – w tym kompromisy kosztowe i infrastrukturalne – znajdziesz w artykule Hosting LLM: Porównanie infrastruktury lokalnej, self-hosted i chmurowej.

Instalacja Ollama

Przejdź do https://ollama.com/download

Aby zainstalować Ollama na systemie Linux:

curl -fsSL https://ollama.com/install.sh | sh

Ollama na Windowsie znajduje się na stronie: https://ollama.com/download/windows Ollama dla Maca również jest dostępne: https://ollama.com/download/macOllamaSetup.exe

Pobieranie, wypisywanie i usuwanie modeli Ollama

Aby pobrać modele Ollama: Przejdź do Biblioteki Ollama (https://ollama.com/library) i znajdź potrzebny model, tam możesz również znaleźć tagi i rozmiary modeli.

Następnie wykonaj:

ollama pull gemma2:latest

# Lub pobierz nieco mądrzejszy, który wciąż mieści się w 16 GB VRAM:

ollama pull gemma2:27b-instruct-q3_K_S

# Lub:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

Aby sprawdzić modele, które Ollama ma w lokalnym repozytorium:

ollama list

Aby usunąć niepotrzebny model:

ollama rm qwen2:7b-instruct-q8_0 # na przykład

Lokalizacja modeli Ollama

Domyślnie pliki modeli są przechowywane w:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

To samo zagadnienie przechowywania pojawia się, gdy Ollama działa w kontenerach: chcesz, aby modele i stan serwera były na nazwanej woluminie lub zamontowaniu (i opcjonalnie OLLAMA_MODELS, gdy układ ma różnić się od domyślnego ścieżki /root/.ollama w oficjalnym obrazie). Pełny układ Compose z rezerwacją GPU, OLLAMA_HOST, aktualizacjami i wzorcami cofania znajdziesz w artykule Ollama w Docker Compose z GPU i trwałym przechowywaniem modeli.

Konfigurowanie ścieżki modeli Ollama w systemie Windows

Aby utworzyć zmienną środowiskową w systemie Windows, postępuj zgodnie z poniższymi instrukcjami:

- Otwórz Ustawienia Windows.

- Przejdź do System.

- Wybierz Informacje o systemie.

- Wybierz Zaawansowane ustawienia systemu.

- Przejdź do zakładki Zaawansowane.

- Wybierz Zmienne środowiskowe….

- Kliknij Nowa…

- Utwórz zmienną o nazwie OLLAMA_MODELS wskazującą na miejsce, w którym chcesz przechowywać modele

Przenoszenie modeli Ollama na systemie Linux

Edytuj parametry usługi systemd Ollama:

sudo systemctl edit ollama.service

lub

sudo xed /etc/systemd/system/ollama.service

Otworzy się edytor.

Dla każdej zmiennej środowiskowej dodaj linię Environment w sekcji [Service]:

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

Zapisz i wyjść.

Istnieją również parametry User i Group, które muszą mieć dostęp do tego folderu.

Przeładuj systemd i uruchom ponownie Ollama:

sudo systemctl daemon-reload

sudo systemctl restart ollama

Jeśli coś poszło nie tak:

systemctl status ollama.service

sudo journalctl -u ollama.service

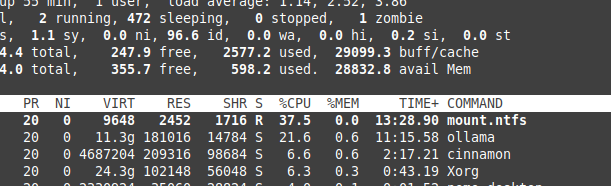

Koszty przechowywania plików na NTFS

Należy pamiętać, że jeśli korzystasz z systemu Linux i przechowujesz modele na partycji sformatowanej jako NTFS, ładowanie modeli będzie znacznie wolniejsze – o ponad 20%.

Instalacja Ollama na Windows w konkretnym folderze

Wraz z modelami:

.\OllamaSetup.exe /DIR=D:\OllamaDir

Udostępnianie API Ollama w sieci wewnętrznej

Sieć wewnętrzna oznacza tutaj sieć lokalną.

Dodaj do konfiguracji usługi:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

To udostępnia czyste API HTTP w Twojej sieci. W przypadku automatycznego HTTPS, poprawnego przekazywania strumieniowego i proxy WebSocket przez Caddy lub Nginx, oraz zabezpieczeń na krawędzi (limit czasu, buforowanie, opcjonalne uwierzytelnianie przed API), użyj Ollama za reverse proxy z Caddy lub Nginx dla strumieniowego HTTPS.

Aby uzyskać dostęp do Ollama z urządzeń zdalnych bez otwierania portów publicznych, użyj prywatnej nakładki (Tailscale) lub WireGuard; zobacz Zdalny dostęp do Ollama przez Tailscale lub WireGuard bez portów publicznych.

Aby zobaczyć, jak Ollama pasuje do innych lokalnych i chmurowych opcji LLM, sprawdź nasz przewodnik Hosting LLM: Porównanie infrastruktury lokalnej, self-hosted i chmurowej.

Przydatne linki

- Test: Jak Ollama wykorzystuje wydajność CPU Intel i rdzenie Efficient

- Jak Ollama obsługuje żądania równoległe

- Wydajność LLM i linie PCIe: kluczowe rozważania

- Porównanie szybkości LLM

- Porównanie zdolności podsumowujących LLM

- Pisanie skutecznych promptów dla LLM

- Self-hosting Perplexica - z Ollama

- Dostawcy chmurowi LLM