ASIC-y dla dużych modeli językowych i specjalizowane układy do inferencji (dlaczego są ważne)

ASIC-y i dedykowane układy scalone zwiększają szybkość i efektywność inferencji w modelach LLM.

Przyszłość AI to nie tylko mądrzejsze modele. To również półprzewodniki dostosowane do sposobu, w jaki te modele są faktycznie obsługiwane. Specjalistyczne układy sprzętowe do wnioskowania LLM podążają ścieżką przypominającą ewolucję kopalni Bitcoina od GPU do dedykowanych układów ASIC, choć z jeszcze bardziej surowymi ograniczeniami, ponieważ modele i metody precyzji ciągle się ewoluują.

Więcej informacji na temat przepustowości, opóźnień, pamięci VRAM oraz benchmarków dla różnych środowisk uruchomieniowych i sprzętu znajdziesz w artykule Wydajność LLM: Benchmarki, wąskie gardła i optymalizacja.

Elektryczna wyobraźnia – Flux text to image LLM.

Elektryczna wyobraźnia – Flux text to image LLM.

Dlaczego LLMy zyskują dzięki sprzętowi dedykowanemu do wnioskowania

Duże modele językowe zmieniły oblicze AI, ale każda płynna odpowiedź opiera się na ogromnych, przewidywalnych strumieniach matematyki macierzowej i ruchu pamięci. W miarę wzrostu kosztów wnioskowania – które często przewyższają koszty trenowania w cyklu życia modelu – układy zoptymalizowane do obsługi (serving), a nie do każdego możliwego obciążenia, stają się ekonomicznie atrakcyjne.

Analogia do kopalni Bitcoina jest niepełna, ale pouczająca. Oba przypadki to zadania powtarzalne i dobrze zdefiniowane, gdzie usunięcie niepotrzebnej uniwersalności z układu (die) przynosi ogromne zyski w przepustowości i energii zużywanej na użyteczną operację.

Co historia kopalni Bitcoina mówi o układach ASIC do wnioskowania

Kopalnie Bitcoina przeszły przez cztery generacje:

| Era | Sprzęt | Kluczowa korzyść | Ograniczenie |

|---|---|---|---|

| 2015–2020 | GPU (CUDA, ROCm) | Elastyczność | Wysokie zużycie energii, ograniczenia pamięciowe |

| 2021–2023 | TPU, NPU | Specjalizacja o grubym ziarnie | Nadal nastawione na trenowanie |

| 2024–2025 | ASICy dla Transformerów | Dostosowane do wnioskowania o niskiej precyzji | Ograniczona uniwersalność |

AI podąża podobną ścieżką. Każda zmiana przyniosła poprawę wydajności i efektywności energetycznej o rzędy wielkości.

Jednakże, w przeciwieństwie do układów ASIC dla Bitcoina (które obliczają tylko SHA-256), układy do wnioskowania wymagają pewnej elastyczności. Modele ewoluują, architektury się zmieniają, a schematy precyzji ulepszają. Chodzi o specjalizację właściwie w tym stopniu – hardkodowanie kluczowych wzorców przy zachowaniu adaptacyjności na marginesach.

Jak wnioskowanie LLM różni się od trenowania (i co wykorzystują układy)

Obciążenia wnioskowania ujawniają wzorce, na które może celować sprzęt specjalistyczny:

- Dominuje niska precyzja – arytmetyka 8-bitowa, 4-bitowa, a nawet trójwartościowa lub binarna działa dobrze w wnioskowaniu

- Pamięć jest wąskim gardłem – Przesyłanie wag i cache’ów KV zużywa znacznie więcej energii niż same obliczenia

- Opóźnienia są ważniejsze niż przepustowość – Użytkownicy oczekują tokenów w czasie poniżej 200 ms

- Ogromne równoległość żądań – Tysiące równoczesnych żądań wnioskowania na jeden układ

- Przewidywalne wzorce – Warstwy Transformer są altamente strukturalne i mogą być zrealizowane sprzętowo

- Możliwości wykorzystania rzadkości (sparsity) – Modele coraz częściej stosują techniki przycinania (pruning) i MoE (Mixture-of-Experts)

Dedykowany układ do wnioskowania może zrealizować te założenia sprzętowo, osiągając 10–50-krotnie lepszą wydajność na wat w porównaniu do uniwersalnych GPU.

Kto buduje układy optymalizowane pod LLM

Rynek układów ASIC do wnioskowania obejmuje liderów, projekty na skalę waferów oraz startupy postawione na układy w kształcie transformera:

| Firma | Układ / Platforma | Specjalizacja |

|---|---|---|

| Groq | LPU (Language Processing Unit) | Deterministyczna przepustowość dla LLMów |

| Etched AI | Sohu ASIC | Zrealizowany sprzętowo silnik Transformer |

| Tenstorrent | Grayskull / Blackhole | Ogólna ML z łączem o dużej przepustowości |

| Taalas | HC1 (produkt Llama 3.1 8B) / droga HC2 | Sprzęt „hardcore" dedykowany dla modelu; łączy pamięć i obliczenia |

| OpenAI × Broadcom | Niestandardowy układ do wnioskowania | Oczekiwany start w 2026 |

| Intel | Crescent Island | GPU Xe3P tylko do wnioskowania z 160GB HBM |

| Cerebras | Wafer-Scale Engine (WSE-3) | Ogromna przepustowość pamięci na chipie |

Wiele z tego znajduje się już w działających centrach danych, a nie tylko na slajdach. Mniejsze zespoły, takie jak d-Matrix, Rain AI, Mythic i Tenet, również pracują nad architekturami dostosowanymi do wnioskowania o niskiej precyzji i strukturalnej rzadkości.

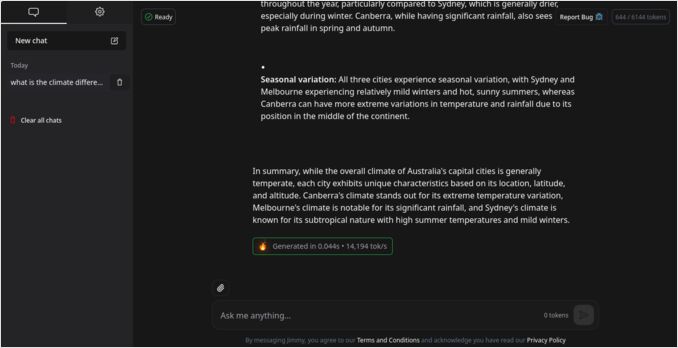

Taalas HC1, Chat Jimmy i ultra-szybka obsługa małych modeli

Taalas to świeży przykład szkoły „specjalizuj prawie wszystko". Firma argumentuje, że granica między pamięcią a obliczeniami (pamięć DRAM poza chipem a SRAM na chipie) dominuje nad kosztami, energią i złożonością inżynieryjną w wnioskowaniu, a układy dedykowane dla modelu – co nazywają Hardcore Models – mogą tę granicę usunąć, jeśli wdrożenie pozwala na stałe wagi i graf.

Ich pierwszy produkt, HC1, hardkoduje wariant Llama 3.1 8B. To wybór pragmatyczny: model jest wystarczająco mały, by szybko go uruchomić, jest otwocement dokumentowany i nadal przydatny do wielu zadań automatyzacji, klasyfikacji i tworzenia szkiców, gdzie głębia rozumowania ma mniejsze znaczenie niż opóźnienia i koszty. Taalas zgłasza wydajność rzędu 16–17 tys. zdekodowanych tokenów na sekundę na użytkownika dla tej konfiguracji (metodyka i porównania producenta znajdują się w ich opracowaniu), wraz z twierdzeniami o dużych zyskach w kapitale i energii w porównaniu z konwencjonalnymi stosami GPU dla tej samej klasy modeli. Układy pierwszej generacji stosują agresywne mieszane formaty o niskiej precyzji; firma opisuje przejście do standardowych formatów zmiennopozycyjnych 4-bitowych na HC2, aby odzyskać zapas jakości.

Dla deweloperów, którzy chcą poczuć, co oznacza taka klasa przepustowości w praktyce, Taalas prowadzi darmowy chatbot demo, Chat Jimmy, i oferuje dostęp do API przez formularz aplikacyjny na swojej stronie. Jest to jawnie dowód koncepcji – nie asystent na froncie nauki – ale ilustruje realną grupę odbiorców, która może preferować umiarkowany model w tempie „ludzkiego myślenia" zamiast większego modelu, który wydaje się ociężały lub kosztowny.

Architektura ASIC do wnioskowania transformerów

Jak właściwie wygląda pod maską układ zoptymalizowany pod transformery?

+--------------------------------------+

| Interfejs Gospodarza |

| (PCIe / CXL / NVLink / Ethernet) |

+--------------------------------------+

| Połączenia wewnętrzne (mesh/ring) |

+--------------------------------------+

| Płytki obliczeniowe / rdzenie |

| — Jednostki do iloczynu macierzy |

| — ALU o niskiej precyzji (int8/int4)|

| — Jednostki dekwantyzacji/aktywacji |

+--------------------------------------+

| SRAM na chipie i bufor cache'ów KV |

| — Gorące wagi, scalone cache'y |

+--------------------------------------+

| Rurociągi kwantyzacji/dekwantyzacji |

+--------------------------------------+

| Harmonogram / Kontroler |

| — Silnik wykonania statycznego grafu|

+--------------------------------------+

| Interfejs DRAM/HBM poza chipem |

+--------------------------------------+

Kluczowe cechy architektoniczne obejmują:

- Rdzenie obliczeniowe – Jednostki iloczynu macierzy zoptymalizowane pod operacje int8, int4 i trójwartościowe

- SRAM na chipie – Duże bufor przechowuje gorące wagi i cache’y KV, minimalizując kosztowne dostęp do DRAM

- Strumieniowe połączenia – Topologia mesh umożliwia efektywną skalowalność na wielu układach

- Silniki kwantyzacji – Kwantyzacja/dekwantyzacja w czasie rzeczywistym między warstwami

- Stack kompilatora – Tłumaczy grafy PyTorch/ONNX bezpośrednio na mikrooperacje specyficzne dla układu

- Zrealizowane sprzętowo jądra uwagi – Eliminacja nadmiaru sterowania dla softmax i innych operacji

Filozofia projektu odzwierciedla układy ASIC dla Bitcoina: każdy tranzystor służy konkretnemu obciążeniu. Żaden marnowany silikon na funkcje niepotrzebne we wnioskowaniu.

Porównanie benchmarków GPU i ASIC dla wnioskowania LLM

Reprezentatywne dane publiczne pokazują, jak specjalistyczny sprzęt do wnioskowania może odciąć się od uniwersalnych stosów GPU dla tych samych rodzin modeli (zawsze weryfikuj metodykę i założenia o batching dla własnych obciążeni):

| Model | Sprzęt | Przepustowość (tokeny/s) | Czas do pierwszego tokena | Mnożnik wydajności |

|---|---|---|---|---|

| Llama-2-70B | NVIDIA H100 (8x DGX) | ~80–100 | ~1.7s | Bazowe (1×) |

| Llama-2-70B | Groq LPU | 241–300 | 0.22s | 3–18× szybciej |

| Llama-3.3-70B | Groq LPU | ~276 | ~0.2s | Stały 3× |

| Gemma-7B | Groq LPU | 814 | <0.1s | 5–15× szybciej |

| Llama-3.1-8B | Taalas HC1 (producent) | ~16–17k tokenów/s/użytkownika | — | Inna oś (stały graf 8B, nie 70B) |

Źródła: Groq.com, ArtificialAnalysis.ai, Blog deweloperski NVIDIA; dane Taalas HC1 z postu produktu firmy.

Wiersze skupione na Groq pokazują duże zyski w przepustowości i czasie do pierwszego tokena w porównaniu z bazą wysokowydajnych GPU dla dużych modeli. Wiersz Taalas nie jest kolejnym mnożnikiem wobec linii 70B; ilustruje, jak daleko można pchnąć dekodowanie na użytkownika, gdy model i graf są stałe w silikonie, kosztem elastyczności.

Kompromisy przy specjalizacji sprzętu do wnioskowania

Specjalizacja kupuje wydajność, ale wprowadza ryzyko produkcyjne i inżynieryjne:

-

Elastyczność vs. Efektywność. W pełni stały ASIC błyskawicznie przetwarza dzisiejsze modele transformerowe, ale może mieć problem z jutra architekturami. Co się stanie, gdy mechanizmy uwagi ewoluują lub pojawią się nowe rodziny modeli?

-

Kwantyzacja i dokładność. Niższa precyzja oszczędza ogromne ilości energii, ale zarządzanie degradacją dokładności wymaga zaawansowanych schematów kwantyzacji. Nie wszystkie modele kwantyzują się elegancko do 4-bit lub mniej.

-

Ekosystem oprogramowania. Sprzęt bez solidnych kompilatorów, jąder i frameworków jest bezużyteczny. NVIDIA nadal dominuje głównie dzięki dojrzałemu ekosystemowi CUDA. Nowi producenci układów muszą mocno inwestować w oprogramowanie.

-

Koszt i Ryzyko. Wypalenie układu (taping out) kosztuje dziesiątki milionów dolarów i trwa 12–24 miesiące. Dla startupów jest to ogromne zakłócenie na założenia architektoniczne, które mogą nie zostać spełnione.

Nawet tak, w skali hyperscale, nawet 2-krotny zysk w efektywności przekłada się na miliardy oszczędności. Dla dostawców chmury obsługujących miliony żądań wnioskowania na sekundę, niestandardowy silikon staje się coraz bardziej nieunikniony.

Lista życzeń dla układu do wnioskowania LLM

| Cecha | Idealna specyfikacja |

|---|---|

| Proces | 3–5nm węzeł |

| SRAM na chipie | 100MB+ ściśle powiązane |

| Precyzja | int8 / int4 / natywne wsparcie trójwartościowe |

| Przepustowość | 500+ tokenów/s (model 70B) |

| Opóźnienia | <100ms czas do pierwszego tokena |

| Połączenia | Sieć o niskim opóźnieniu lub linki optyczne |

| Kompilator | PyTorch/ONNX → narzędzia mikrokode |

| Energia | <0.3 dżula na token |

Wgłąd w przyszłość (2026–2030)

Oczekuj, że krajobraz sprzętu do wnioskowania podzieli się na trzy grube warstwy:

-

Układy do trenowania. Wysokiej klasy GPU, takie jak NVIDIA B200 i AMD Instinct MI400, będą nadal dominować w trenowaniu dzięki elastyczności FP16/FP8 i ogromnej przepustowości pamięci.

-

ASICy do wnioskowania. Zrealizowane sprzętowo, o niskiej precyzji akceleratorzy transformerów będą obsługiwać produkcję w skali hyperscale, zoptymalizowane pod koszt i efektywność.

-

NPU na krawędzi (Edge). Małe, ultra-efektywne układy przeniosą kwantyzowane LLMy do smartfonów, pojazdów, urządzeń IoT i robotów, umożliwiając inteligencję na urządzeniu bez zależności od chmury.

Oprócz samego sprzętu zobaczymy:

- Klastery hybrydowe – GPU do elastycznego trenowania, ASICy (lub silniki wnioskowania na waferze) do efektywnej obsługi

- Wnioskowanie jako usługa – Hyperscalers mieszają akceleratorzy pierwszej strony (AWS Inferentia, Google TPU i inne) z GPU

- Współprojektowanie sprzętu i oprogramowania – Modele kształtowane pod blokową rzadkość, routing MoE i warstwy przyjazne kwantyzacji

- Silikon per-model lub per-family – Firmy jak Taalas zakłócają, że niektóre wdrożenia oddadzą elastyczność architektoniczną w zamian za ekstremalne koszty i opóźnienia na znanym grafie

- Otwarte API wnioskowania – Presja, by utrzymać interfejsy obsługi przenośne nawet, gdy silikon nie jest

Myśli końcowe

Proces „ASIC-izacji" wnioskowania AI już się rozpoczął. Tak jak kopalnie Bitcoina ewoluowały od CPU do specjalistycznego silikonu, wdrażanie AI podąża tą samą ścieżką.

Następna rewolucja w AI nie będzie polegać na większych modelach – będzie chodzić o lepsze układy. Sprzęt zoptymalizowany pod specyficzne wzorce wnioskowania transformerów zdecyduje, kto będzie mógł wdrożyć AI ekonomicznie w skali.

Tak jak kopalnie Bitcoina zoptymalizowały każdy zużyty wat, sprzęt do wnioskowania będzie wyciskał każdy ostatni FLOP na dżul. Kiedy to nastąpi, prawdziwym przełomem nie będą algorytmy – będzie to silikon, który je wykonuje.

Przyszłość AI jest grawerowana w silikonie, po jednym tranzystorze.

Więcej benchmarków, wyborów sprzętowych i tuningów wydajności znajdziesz w naszym hubie Wydajność LLM: Benchmarki, wąskie gardła i optymalizacja.

Przydatne linki

- Oficjalne benchmarki Groq

- Taalas — Droga do wszechobecnej AI (HC1, roadmap, filozofia)

- Chat Jimmy — Demo Taalas Llama 3.1 8B

- Formularz dostępu do API Taalas

- Artificial Analysis - Liderka wydajności LLM

- NVIDIA H100 Technical Brief

- Etched AI - Ogłoszenie ASIC Transformer

- Cerebras Wafer-Scale Engine

- Ceny kart NVidia RTX 5080 i RTX 5090 w Australii – październik 2025

- Wydajność LLM i linie PCIe: Kluczowe rozważania

- Test szybkości dużych modeli językowych

- Porównanie przydatności GPU NVidia do AI

- Czy Quadro RTX 5880 Ada 48GB jest dobry?