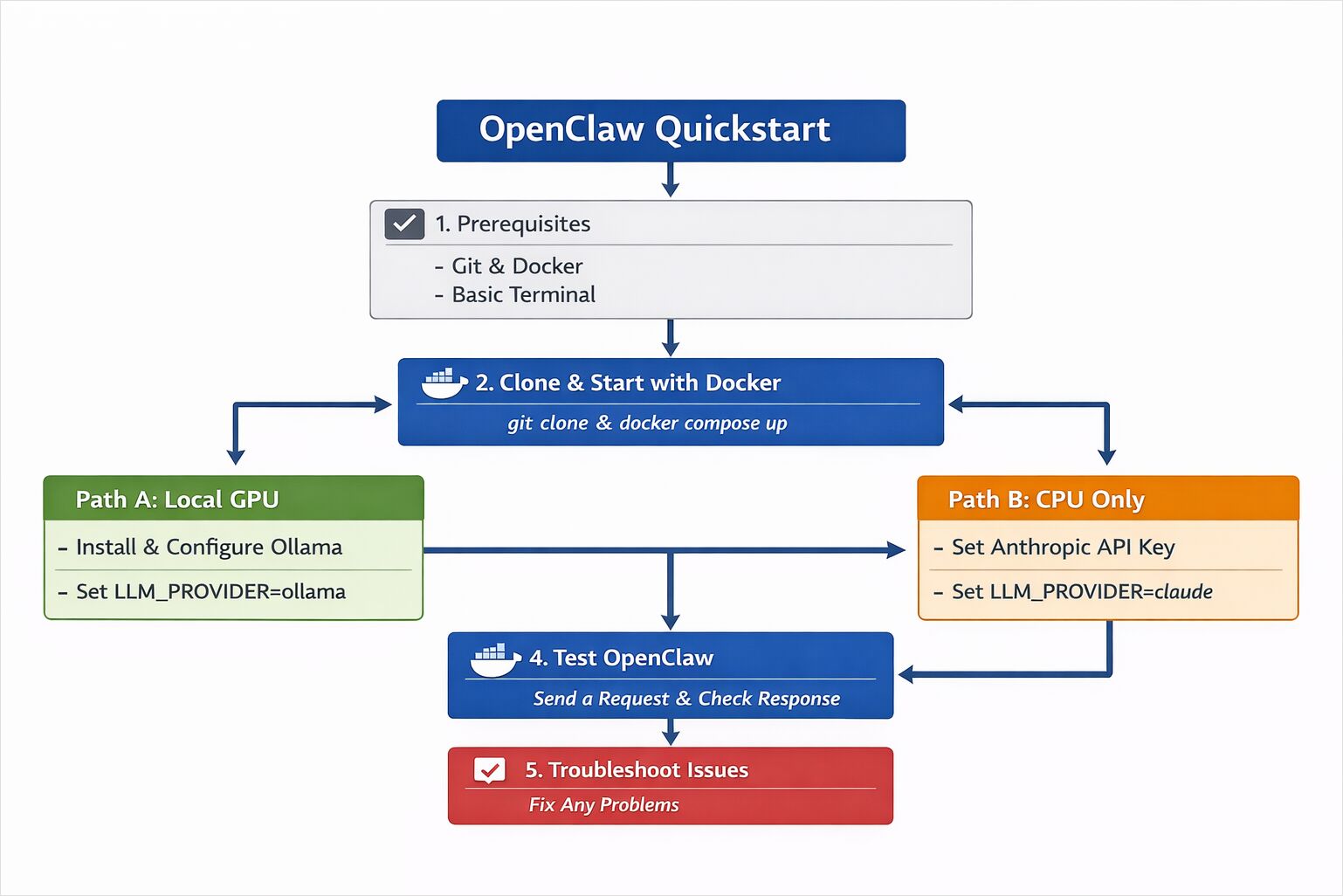

Início Rápido do OpenClaw: Instalação com Docker (Ollama GPU ou Claude + CPU)

Instale o OpenClaw localmente com o Ollama

O OpenClaw é um assistente de IA hospedado localmente projetado para funcionar com tempos de execução de LLM locais, como o Ollama, ou com modelos baseados em nuvem, como o Claude Sonnet.

Este guia rápido mostra como implantar o OpenClaw usando o Docker, configurar um modelo local com aceleração por GPU ou um modelo na nuvem apenas com CPU e verificar se seu assistente de IA está funcionando de ponta a ponta.

Este guia percorre uma configuração mínima do OpenClaw para que você possa vê-lo em execução e respondendo na sua própria máquina.

O objetivo é simples:

- Colocar o OpenClaw em execução.

- Enviar uma solicitação.

- Confirmar que funciona.

Este não é um guia de endurecimento para produção. Este não é um guia de ajuste de desempenho. Este é um ponto de partida prático.

Você tem duas opções:

- Caminho A — GPU Local usando o Ollama (recomendado se você tiver uma GPU)

- Caminho B — Apenas CPU usando o Claude Sonnet 4.6 via API da Anthropic

Ambos os caminhos compartilham o mesmo processo de instalação central.

Se você é novo no OpenClaw e deseja uma visão mais aprofundada de como o sistema é estruturado, leia a visão geral do sistema OpenClaw.

Requisitos de Sistema e Configuração do Ambiente

O OpenClaw é um sistema de estilo assistente que pode se conectar a serviços externos. Para este Guia Rápido:

- Utilize contas de teste sempre que possível.

- Evite conectar sistemas de produção sensíveis.

- Execute-o dentro do Docker (recomendado).

O isolamento é uma boa configuração padrão ao experimentar softwares de estilo agente.

Pré-requisitos do OpenClaw (GPU com Ollama ou CPU com Claude)

Necessário para Ambos os Caminhos

- Git

- Docker Desktop (ou Docker + Docker Compose)

- Um terminal

Para o Caminho A (GPU Local)

- Uma máquina com uma GPU compatível (NVIDIA ou AMD recomendadas)

- Ollama instalado

Para o Caminho B (CPU + Modelo em Nuvem)

- Uma chave de API da Anthropic

- Acesso ao Claude Sonnet 4.6

Passo 1 — Instale o OpenClaw com Docker (Clone e Inicie)

O OpenClaw pode ser iniciado usando o Docker Compose. Isso mantém a configuração contida e reproduzível.

Clone o repositório

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Copie a configuração do ambiente

cp .env.example .env

Abra o arquivo .env no seu editor. Vamos configurá-lo no próximo passo, dependendo do caminho do modelo que você escolher.

Inicie os contêineres

docker compose up -d

Se tudo iniciar corretamente, você deverá ver os contêineres em execução:

docker ps

Neste estágio, o OpenClaw está em execução, mas ainda não está conectado a um modelo.

Passo 2 — Configure o Provedor de LLM (Ollama GPU ou Claude CPU)

Agora decida como deseja que a inferência funcione.

Caminho A — GPU Local com Ollama

Se você tiver uma GPU disponível, esta é a opção mais simples e autocontida.

Instale ou Verifique o Ollama

Se você precisar de um guia de instalação mais detalhado ou quiser configurar os locais de armazenamento de modelos, consulte:

- Instalar Ollama e Configurar Localização dos Modelos

- Apostila de Comandos CLI do Ollama: ls, serve, run, ps e outros comandos (atualização 2026)

Se o Ollama não estiver instalado:

curl -fsSL https://ollama.com/install.sh | sh

Verifique se funciona:

ollama pull llama3

ollama run llama3

Se o modelo responder, a inferência está funcionando.

Configure o OpenClaw para Usar o Ollama

No seu arquivo .env, configure:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Reinicie os contêineres:

docker compose restart

Agora o OpenClaw encaminhará as solicitações para sua instância local do Ollama.

Se você estiver decidindo qual modelo executar em uma GPU com 16GB de VRAM ou quiser comparações de benchmarks, consulte:

Para entender a concorrência e o comportamento da CPU sob carga:

- Como o Ollama Lida com Solicitações Paralelas

- Teste: Como o Ollama está usando o Desempenho da CPU Intel e Núcleos Eficientes

Caminho B — Apenas CPU Usando Claude Sonnet 4.6

Se você não tiver uma GPU, pode usar um modelo hospedado.

Adicione Sua Chave de API

No seu arquivo .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Reinicie:

docker compose restart

Agora o OpenClaw usará o Claude Sonnet 4.6 para inferência, enquanto a orquestração é executada localmente.

Esta configuração funciona bem em máquinas apenas com CPU, porque o cálculo pesado do modelo ocorre na nuvem.

Se você estiver usando modelos da Anthropic aqui, esta mudança na política de assinatura do Claude explica por que o OpenClaw exige faturamento baseado em API em vez de reutilizar planos do Claude.

Passo 3 — Teste o OpenClaw com Seu Primeiro Prompt

Uma vez que os contêineres estejam em execução e o modelo esteja configurado, você pode testar o assistente.

Dependendo da sua configuração, isso pode ser feito através de:

- Uma interface web

- Uma integração de mensagens

- Um endpoint de API local

Para um teste básico de API:

curl http://localhost:3000/health

Você deverá ver uma resposta de status saudável.

Agora envie um prompt simples:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Explain what OpenClaw does in simple terms."}'

Se você receber uma resposta estruturada, o sistema está funcionando.

O Que Você Acabou de Executar

Neste ponto, você tem:

- Uma instância do OpenClaw em execução

- Um provedor de LLM configurado (local ou em nuvem)

- Um loop de solicitação-resposta funcionando

Se você escolheu o caminho da GPU, a inferência ocorre localmente via Ollama.

Se você escolheu o caminho da CPU, a inferência ocorre via Claude Sonnet 4.6, enquanto a orquestração, roteamento e gerenciamento de memória rodam dentro dos seus contêineres Docker locais.

A interação visível pode parecer simples. Por baixo dos panos, vários componentes coordenam-se para processar sua solicitação.

Solução de Problemas de Instalação e Execução do OpenClaw

Modelo Não Está Respondendo

- Verifique sua configuração

.env. - Verifique os logs do contêiner:

docker compose logs

Ollama Não Acessível

- Confirme que o Ollama está em execução:

ollama list

- Garanta que a URL base corresponda ao seu ambiente.

Chave de API Inválida

- Verifique novamente

ANTHROPIC_API_KEY. - Reinicie os contêineres após atualizar o

.env.

GPU Não Está Sendo Utilizada

- Confirme que os drivers da GPU estão instalados.

- Garanta que o acesso à GPU esteja habilitado no Docker.

Próximos Passos Após Instalar o OpenClaw

Agora você tem uma instância do OpenClaw funcionando.

A partir daqui, você pode:

- Conectar plataformas de mensagens

- Habilitar recuperação de documentos

- Experimentar estratégias de roteamento

- Adicionar observabilidade e métricas

- Ajustar comportamento de desempenho e custo

As discussões arquitetônicas mais profundas fazem mais sentido uma vez que o sistema esteja em execução.

Colocá-lo em operação é o primeiro passo.

Uma vez em execução, os próximos artigos naturais são:

- Guia de plugins do OpenClaw — quais plugins instalar para memória, ferramentas, canais e observabilidade, e como o ciclo de vida funciona

- Guia de habilidades do OpenClaw — quais habilidades valem a pena instalar do ClawHub e como controlá-las com segurança por função de agente

- Padrões de configuração de produção do OpenClaw — como plugins e habilidades se combinam para tipos de usuários reais, como desenvolvedores, equipes de automação, pesquisadores e operadores de suporte

Para mais estudos de caso de sistemas de IA, consulte a seção Sistemas de IA.