Docker Model Runner vs Ollama (2026): Qual é Melhor para LLMs Locais?

Compare o Docker Model Runner e o Ollama para LLM locais.

Execução local de grandes modelos de linguagem (LLMs) tornou-se cada vez mais popular devido à privacidade, controle de custos e capacidades offline. O cenário mudou significativamente em abril de 2025, quando a Docker introduziu o Docker Model Runner (DMR), sua solução oficial para implantação de modelos de IA.

Agora, três abordagens competem pela atenção dos desenvolvedores: o Model Runner nativo da Docker, soluções containerizadas de terceiros (vLLM, TGI) e a plataforma independente Ollama.

Para uma visão mais ampla que inclui provedores de nuvem e compensações de infraestrutura, consulte Hospedagem de LLM: Local, Auto-hospedado e Infraestrutura em Nuvem Comparados.

TL;DR – Docker Model Runner vs Ollama

Esta comparação foca na execução local de grandes modelos de linguagem (LLMs) usando Docker ou runtimes independentes, cobrindo desempenho, suporte a GPU, compatibilidade de API e cenários de implantação em produção.

- Melhor para fluxos de trabalho nativos do Docker: Docker Model Runner

- Melhor para simplicidade e prototipagem rápida: Ollama

- Melhor para Kubernetes e orquestração: Configurações baseadas em Docker

- Melhor para desenvolvimento em máquina única: Ollama

Se você já usa o Docker intensivamente, o DMR faz sentido.

Se você quer a maneira mais rápida de executar LLMs localmente, o Ollama é mais simples.

Se você está comparando mais do que apenas o Docker Model Runner e o Ollama, consulte nossa análise completa de Ollama vs vLLM vs LM Studio e outras ferramentas locais de LLM. Este guia compara maturidade de API, suporte de hardware, chamada de ferramentas e prontidão para produção em mais de 12 runtimes locais de LLM.

Docker Model Runner vs Ollama: Comparação Direta

Com a entrada oficial da Docker no espaço de execução de LLMs, a comparação torna-se mais interessante. Veja como DMR e Ollama se comparam cara a cara:

| Característica | Docker Model Runner | Ollama |

|---|---|---|

| Instalação | Aba AI do Docker Desktop ou docker-model-plugin |

Comando único: curl | sh |

| Estilo de Comando | docker model pull/run/package |

ollama pull/run/list |

| Formato do Modelo | GGUF (Artefatos OCI) | GGUF (nativo) |

| Distribuição de Modelos | Docker Hub, registros OCI | Registro do Ollama |

| Configuração de GPU | Automática (mais simples que Docker tradicional) | Automática |

| API | Compatível com OpenAI | Compatível com OpenAI |

| Integração Docker | Nativa (é o próprio Docker) | Executa no Docker se necessário |

| Suporte a Compose | Nativo | Via imagem Docker |

| Curva de Aprendizado | Baixa (para usuários do Docker) | A mais baixa (para todos) |

| Parceiros do Ecossistema | Google, Hugging Face, VMware | LangChain, CrewAI, Open WebUI |

| Melhor Para | Fluxos de trabalho nativos do Docker | Simplicidade independente |

Insight Chave: O DMR traz fluxos de trabalho do Docker para a implantação de LLMs, enquanto o Ollama permanece agnóstico a frameworks com operação independente mais simples. Sua infraestrutura existente importa mais do que as diferenças técnicas.

O Docker Model Runner é Melhor que o Ollama?

Depende do seu fluxo de trabalho.

- Escolha o Docker Model Runner (DMR) se sua equipe já depende pesadamente do Docker, artefatos OCI e orquestração de containers.

- Escolha o Ollama se você quer a maneira mais simples de executar LLMs localmente com configuração mínima e prototipagem rápida.

Para a maioria das configurações de máquina única, o Ollama é mais fácil de usar.

Para pipelines CI/CD nativos do Docker e fluxos de trabalho corporativos de containers, o DMR se integra mais naturalmente.

Como Executar um LLM no Docker: DMR vs Ollama

Se o seu objetivo é simplesmente executar um LLM dentro do Docker, tanto o Docker Model Runner quanto o Ollama em containers Docker podem alcançar isso.

O Docker Model Runner usa os comandos nativos docker model pull e docker model run, empacotando modelos como artefatos OCI.

O Ollama também pode ser executado dentro do Docker usando a imagem de container oficial ollama/ollama, expondo uma API compatível com OpenAI na porta 11434.

A diferença fundamental reside na integração do fluxo de trabalho:

- O DMR se encaixa naturalmente em pipelines CI/CD nativos do Docker.

- O Ollama no Docker oferece gerenciamento de modelos mais simples com flexibilidade de orquestração do Docker.

Entendendo os Model Runners Baseados em Docker

Os model runners baseados em Docker usam containerização para empacotar motores de inferência de LLM junto com suas dependências. O cenário inclui tanto a solução oficial da Docker quanto frameworks de terceiros.

Docker Model Runner (DMR) - Solução Oficial

Em abril de 2025, a Docker introduziu o Docker Model Runner (DMR), um produto oficial projetado para simplificar a execução de modelos de IA localmente usando a infraestrutura da Docker. Isso representa o compromisso da Docker em tornar a implantação de modelos de IA tão simples quanto a implantação de containers.

Principais Características do DMR:

- Integração Nativa com Docker: Usa comandos Docker familiares (

docker model pull,docker model run,docker model package) - Empacotamento de Artefatos OCI: Modelos são empacotados como Artefatos OCI, permitindo distribuição através do Docker Hub e outros registros

- API Compatível com OpenAI: Substituição direta para endpoints OpenAI, simplificando a integração

- Aceleração de GPU: Suporte nativo a GPU sem configuração complexa de nvidia-docker

- Suporte a Formato GGUF: Funciona com formatos de modelos quantizados populares

- Integração com Docker Compose: Configure e deploye modelos facilmente usando ferramentas padrão do Docker

- Suporte a Testcontainers: Integra-se perfeitamente com frameworks de teste

Instalação:

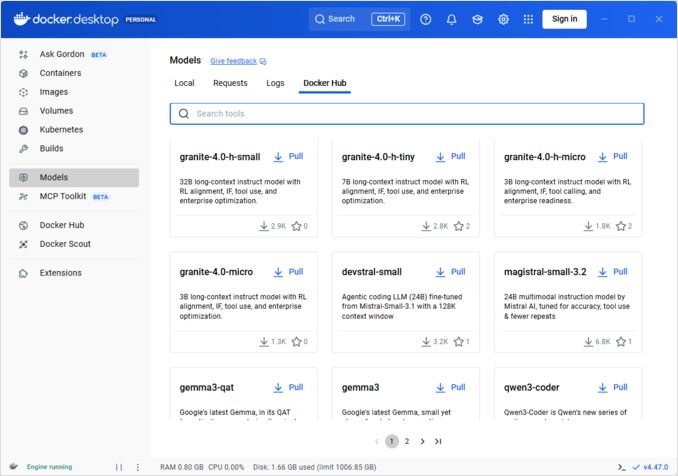

- Docker Desktop: Ative via aba AI nas configurações

- Docker Engine: Instale o pacote

docker-model-plugin

Exemplo de Uso:

# Baixe um modelo do Docker Hub

docker model pull ai/smollm2

# Execute inferência

docker model run ai/smollm2 "Explique o Docker Model Runner"

# Empacote modelo personalizado

docker model package --gguf /caminho/para/modelo.gguf --push minhaorg/meumodelo:latest

Para uma referência completa dos comandos docker model, opções de empacotamento, flags de configuração e exemplos práticos, consulte nosso detalhado Guia de Comandos e Exemplos do Docker Model Runner. Ele cobre o download, empacotamento, configuração de modelos e melhores práticas para implantação local de LLMs com Docker.

O DMR é parceiro da Google, Hugging Face e VMware Tanzu para expandir o ecossistema de modelos de IA disponíveis através do Docker Hub. Se você é novo no Docker ou precisa de uma revisão sobre comandos Docker, nosso Guia Rápido do Docker oferece um guia abrangente para operações essenciais do Docker.

Soluções Docker de Terceiros

Além do DMR, o ecossistema inclui frameworks estabelecidos:

- Containers vLLM: Servidor de inferência de alto throughput otimizado para processamento em lote

- Text Generation Inference (TGI): Solução pronta para produção da Hugging Face

- Containers llama.cpp: Implementação C++ leve com quantização

- Containers Personalizados: Envoltórios para PyTorch, Transformers ou frameworks proprietários

Vantagens da Abordagem Docker

Flexibilidade e Agnosticismo a Frameworks: Containers Docker podem executar qualquer framework de LLM, do PyTorch ao ONNX Runtime, dando aos desenvolvedores controle total sobre a pilha de inferência.

Isolamento de Recursos: Cada container opera em ambientes isolados com limites de recursos definidos (CPU, memória, GPU), prevenindo conflitos de recursos em implantações de múltiplos modelos.

Suporte a Orquestração: Docker integra-se perfeitamente com Kubernetes, Docker Swarm e plataformas de nuvem para escalabilidade, balanceamento de carga e alta disponibilidade.

Controle de Versão: Diferentes versões de modelos ou frameworks podem coexistir no mesmo sistema sem conflitos de dependência.

Desvantagens da Abordagem Docker

Complexidade: Requer compreensão de containerização, montagens de volume, configuração de rede e passagem de GPU (nvidia-docker).

Overhead: Embora mínimo, o Docker adiciona uma fina camada de abstração que impacta ligeiramente o tempo de inicialização e uso de recursos.

Carga de Configuração: Cada implantação requer configuração cuidadosa de Dockerfiles, variáveis de ambiente e parâmetros de runtime.

Entendendo o Ollama

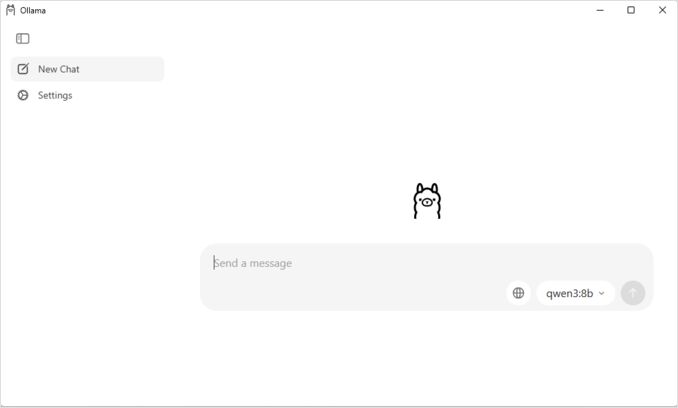

Ollama é uma aplicação projetada especificamente para executar LLMs localmente, com simplicidade como seu princípio central. Ele fornece:

- Binário nativo para Linux, macOS e Windows

- Biblioteca de modelos embutida com instalação em um comando

- Detecção e otimização automática de GPU

- API RESTful compatível com o formato do OpenAI

- Gerenciamento de contexto e estado do modelo

Vantagens do Ollama

Simplicidade: A instalação é direta (curl | sh no Linux) e executar modelos requer apenas ollama run llama2. Para uma referência completa dos comandos CLI do Ollama, como ollama serve, ollama run, ollama ps e fluxos de gerenciamento de modelos, consulte nosso Guia Rápido da CLI do Ollama.

Desempenho Otimizado: Construído sobre llama.cpp, o Ollama é altamente otimizado para velocidade de inferência com suporte a quantização (Q4, Q5, Q8).

Gerenciamento de Modelos: Registro de modelos embutido com comandos como ollama pull, ollama list e ollama rm simplifica o ciclo de vida do modelo.

Experiência do Desenvolvedor: API limpa, documentação extensa e ecossistema crescente de integrações (LangChain, CrewAI, etc.). A versatilidade do Ollama se estende a casos de uso especializados como reclassificação de documentos de texto com modelos de embedding.

Eficiência de Recursos: Gerenciamento automático de memória e descarregamento de modelos quando inativos conserva recursos do sistema.

Desvantagens do Ollama

Travamento de Framework: Suporta principalmente modelos compatíveis com llama.cpp, limitando a flexibilidade para frameworks como vLLM ou motores de inferência personalizados.

Personalização Limitada: Configurações avançadas (quantização personalizada, streams CUDA específicos) são menos acessíveis do que em ambientes Docker.

Desafios de Orquestração: Embora o Ollama possa rodar em containers, ele carece de suporte nativo para recursos avançados de orquestração como escalonamento horizontal.

Comparação de Desempenho

Velocidade de Inferência

Docker Model Runner: Desempenho comparável ao Ollama, pois ambos suportam modelos quantizados GGUF. Para Llama 2 7B (Q4), espere 20-30 tokens/segundo em CPU e 50-80 tokens/segundo em GPUs de nível médio. Overhead de container mínimo.

Ollama: Aproveita o backend altamente otimizado llama.cpp com quantização eficiente. Para Llama 2 7B (Q4), espere 20-30 tokens/segundo em CPU e 50-80 tokens/segundo em GPUs de nível médio. Sem overhead de containerização. Para detalhes sobre como o Ollama gerencia inferência concorrente, veja nossa análise sobre como o Ollama lida com solicitações paralelas.

Docker (vLLM): Otimizado para processamento em lote com lotes contínuos. Solicitações únicas podem ser ligeiramente mais lentas, mas o throughput se destaca sob alta carga concorrente (100+ tokens/segundo por modelo com lotes).

Docker (TGI): Semelhante ao vLLM com excelente desempenho de lotes. Adiciona recursos como streaming e geração token por token.

Uso de Memória

Docker Model Runner: Semelhante ao Ollama com carregamento automático de modelos. Modelos GGUF Q4 tipicamente usam 4-6GB de RAM. O overhead do container é mínimo (dezenas de MB).

A configuração do tamanho do contexto pode impactar significativamente o uso de memória e o comportamento do modelo. Por padrão, algumas imagens CUDA do Docker Model Runner têm um limite de 4096 tokens hardcoded, mesmo que valores mais altos sejam especificados no docker-compose. Para passos detalhados sobre como substituir esse comportamento e empacotar modelos com tamanhos de contexto personalizados, consulte nosso guia sobre configuração de tamanho de contexto no Docker Model Runner.

Ollama: Gerenciamento automático de memória carrega modelos sob demanda e os descarrega quando inativos. Um modelo 7B Q4 tipicamente usa 4-6GB de RAM. Mais eficiente para cenários de modelo único.

Soluções Docker Tradicionais: A memória depende do framework. O vLLM pré-aloca memória GPU para desempenho ótimo, enquanto containers baseados em PyTorch podem usar mais RAM para pesos do modelo e cache KV (8-14GB para modelos 7B).

Tempo de Inicialização

Docker Model Runner: A inicialização do container adiciona ~1 segundo, mais o carregamento do modelo (2-5 segundos). Total: 3-6 segundos para modelos de tamanho médio.

Ollama: Inicialização quase instantânea com carregamento do modelo levando 2-5 segundos para modelos de tamanho médio. Experiência de inicialização a frio mais rápida.

Docker Tradicional: A inicialização do container adiciona 1-3 segundos, mais o tempo de carregamento do modelo. Pré-aquecimento de containers mitiga isso em implantações de produção.

Recomendações de Casos de Uso

Quando Escolher Docker Model Runner

- Fluxo de trabalho primeiro Docker: Sua equipe já usa Docker extensivamente

- Ferramentas unificadas: Você quer uma única ferramenta (Docker) para containers e modelos

- Distribuição de artefatos OCI: Você precisa de integração com registro corporativo

- Integração Testcontainers: Você está testando recursos de IA em CI/CD

- Preferência Docker Hub: Você quer distribuição de modelos através de canais familiares

Quando Escolher Ollama

- Prototipagem rápida: Experimentação rápida com diferentes modelos

- Agnóstico a framework: Não vinculado ao ecossistema Docker

- Simplicidade absoluta: Overhead mínimo de configuração e manutenção

- Implantações em servidor único: Executando em laptops, estações de trabalho ou VMs únicas

- Biblioteca de modelos grande: Acesso a extenso registro de modelos pré-configurados

Quando Escolher Soluções Docker de Terceiros

- Implantações em produção: Necessidade de orquestração e monitoramento avançados

- Serving de múltiplos modelos: Executando diferentes frameworks (vLLM, TGI) simultaneamente

- Orquestração Kubernetes: Escalonamento através de clusters com balanceamento de carga

- Frameworks personalizados: Usando Ray Serve ou motores de inferência proprietários

- Controle estrito de recursos: Impor limites granulares de CPU/GPU por modelo

Abordagens Híbridas: O Melhor dos Dois Mundos

Você não está limitado a uma única abordagem. Considere essas estratégias híbridas:

Opção 1: Docker Model Runner + Containers Tradicionais

Use DMR para modelos padrão e containers de terceiros para frameworks especializados:

# Baixe um modelo padrão com DMR

docker model pull ai/llama2

# Execute vLLM para cenários de alto throughput

docker run --gpus all vllm/vllm-openai

Opção 2: Ollama no Docker

Execute Ollama dentro de containers Docker para capacidades de orquestração:

docker run -d \

--name ollama \

--gpus all \

-v ollama:/root/.ollama \

-p 11434:11434 \

ollama/ollama

Isso fornece:

- Gerenciamento de modelos intuitivo do Ollama

- Capacidades de orquestração e isolamento do Docker

- Implantação Kubernetes com manifestos padrão

Opção 3: Mistura e Correspondência por Caso de Uso

- Desenvolvimento: Ollama para iteração rápida

- Staging: Docker Model Runner para testes de integração

- Produção: vLLM/TGI em Kubernetes para escala

Compatibilidade de API

Todas as soluções modernas convergem para APIs compatíveis com OpenAI, simplificando a integração:

API Docker Model Runner: Endpoints compatíveis com OpenAI servidos automaticamente ao executar modelos. Nenhuma configuração adicional necessária.

# Modelo executa com API automaticamente exposta

docker model run ai/llama2

# Use endpoint compatível com OpenAI

curl http://localhost:8080/v1/chat/completions -d '{

"model": "llama2",

"messages": [{"role": "user", "content": "Por que o céu é azul?"}]

}'

API Ollama: Endpoints compatíveis com OpenAI o tornam uma substituição direta para aplicativos que usam o SDK do OpenAI. Streaming é totalmente suportado.

curl http://localhost:11434/api/generate -d '{

"model": "llama2",

"prompt": "Por que o céu é azul?"

}'

APIs Docker de Terceiros: vLLM e TGI oferecem endpoints compatíveis com OpenAI, enquanto containers personalizados podem implementar APIs proprietárias.

A convergência na compatibilidade OpenAI significa que você pode alternar entre soluções com mudanças mínimas de código.

Gerenciamento de Recursos

Aceleração de GPU

Docker Model Runner: Suporte nativo a GPU sem configuração complexa de nvidia-docker. Detecta e usa GPUs disponíveis automaticamente, simplificando significativamente a experiência de GPU do Docker em comparação com containers tradicionais.

Se você está usando GPUs NVIDIA e quer configurar a aceleração CUDA corretamente, consulte nosso guia detalhado sobre adicionar suporte a GPU NVIDIA ao Docker Model Runner. Ele cobre a configuração do daemon Docker, instalação do NVIDIA Container Toolkit e como verificar se seu LLM está realmente usando memória de GPU em vez de recorrer à inferência de CPU.

# Aceleração de GPU funciona automaticamente

docker model run ai/llama2

Ollama: Detecção automática de GPU em GPUs NVIDIA compatíveis com CUDA. Nenhuma configuração necessária além da instalação de drivers.

Containers Docker Tradicionais: Requer runtime nvidia-docker e alocação explícita de GPU:

docker run --gpus all meu-container-llm

Fallback para CPU

Ambos recaem graciosamente para inferência de CPU quando GPUs não estão disponíveis, embora o desempenho diminua significativamente (5-10x mais lento para grandes modelos). Para insights sobre desempenho apenas com CPU em processadores modernos, leia nosso teste sobre como o Ollama usa CPUs Intel Performance e Efficient Cores.

Suporte Multi-GPU

Ollama: Suporta paralelismo de tensor através de múltiplas GPUs para grandes modelos.

Docker: Depende do framework. vLLM e TGI suportam inferência multi-GPU com configuração adequada.

Comunidade e Ecossistema

Docker Model Runner: Lançado em abril de 2025 com forte apoio corporativo. Parcerias com Google, Hugging Face e VMware Tanzu AI Solutions garantem ampla disponibilidade de modelos. A integração com a enorme comunidade de desenvolvedores da Docker (milhões de usuários) fornece acesso instantâneo ao ecossistema. Ainda construindo recursos específicos da comunidade como produto novo.

Ollama: Comunidade em crescimento rápido com 50K+ estrelas no GitHub. Ecossistema de integração forte (LangChain, LiteLLM, Open WebUI, CrewAI) e comunidade ativa no Discord. Extensas ferramentas e tutoriais de terceiros disponíveis. Documentação e recursos da comunidade mais maduros. Para uma visão geral abrangente de interfaces disponíveis, consulte nosso guia de UIs de chat de código aberto para instâncias locais do Ollama. Como com qualquer projeto de código aberto em crescimento rápido, é importante monitorar a direção do projeto - leia nossa análise de primeiros sinais de degradação do Ollama para entender preocupações potenciais.

Soluções Docker de Terceiros: vLLM e TGI têm ecossistemas maduros com suporte corporativo. Estudos de caso de produção extensos, guias de otimização e padrões de implantação da Hugging Face e contribuintes da comunidade.

Considerações de Custo

Docker Model Runner: Gratuito com Docker Desktop (pessoal/educacional) ou Docker Engine. Docker Desktop requer assinatura para organizações maiores (250+ funcionários ou receita de $10M+). Modelos distribuídos através do Docker Hub seguem a precificação do registro da Docker (repositórios públicos gratuitos, repositórios privados pagos).

Ollama: Totalmente gratuito e de código aberto sem custos de licenciamento, independentemente do tamanho da organização. Custos de recursos dependem apenas do hardware.

Soluções Docker de Terceiros: Gratuitas para frameworks de código aberto (vLLM, TGI). Custos potenciais para plataformas de orquestração de containers (ECS, GKE) e armazenamento de registro privado.

Considerações de Segurança

Docker Model Runner: Aproveita o modelo de segurança da Docker com isolamento de container. Modelos empacotados como Artefatos OCI podem ser escaneados e assinados. Distribuição através do Docker Hub permite controle de acesso e varredura de vulnerabilidades para usuários corporativos.

Ollama: Executa como serviço local com API exposta em localhost por padrão. Exposição de rede requer configuração explícita. Registro de modelos é confiável (curado pelo Ollama), reduzindo riscos de cadeia de suprimentos.

Soluções Docker Tradicionais: Isolamento de rede é embutido. Escaneamento de segurança de containers (Snyk, Trivy) e assinatura de imagens são práticas padrão em ambientes de produção.

Todas as soluções requerem atenção a:

- Proveniência do modelo: Modelos não confiáveis podem conter código malicioso ou backdoors

- Autenticação de API: Implemente autenticação/autorização em implantações de produção

- Limitação de taxa: Previna abuso e esgotamento de recursos

- Exposição de rede: Garanta que APIs não sejam inadvertidamente expostas à internet

- Privacidade de dados: Modelos processam dados sensíveis; garanta conformidade com regulamentos de proteção de dados

Caminhos de Migração

De Ollama para Docker Model Runner

O suporte GGUF do Docker Model Runner torna a migração simples:

- Ative Docker Model Runner no Docker Desktop ou instale

docker-model-plugin - Converta referências de modelo:

ollama run llama2→docker model pull ai/llama2edocker model run ai/llama2 - Atualize endpoints de API de

localhost:11434para endpoint DMR (tipicamentelocalhost:8080) - Ambos usam APIs compatíveis com OpenAI, então o código do aplicativo requer mudanças mínimas

De Docker Model Runner para Ollama

Migrando para Ollama para operação independente mais simples:

- Instale Ollama:

curl -fsSL https://ollama.ai/install.sh | sh. Para uma lista completa de comandos CLI do Ollama e opções de configuração, consulte o guia rápido da CLI do Ollama. - Baixe modelos equivalentes:

ollama pull llama2 - Atualize endpoints de API para

localhost:11434do Ollama - Teste com

ollama run llama2para verificar funcionalidade

De Containers Docker Tradicionais para DMR

Simplifique sua configuração de LLM Docker:

- Ative Docker Model Runner

- Substitua Dockerfiles personalizados por comandos

docker model pull - Remova configuração nvidia-docker (DMR lida com GPU automaticamente)

- Use

docker model runem vez de comandos complexosdocker run

De Qualquer Solução para Ollama no Docker

Abordagem do melhor dos dois mundos:

docker pull ollama/ollama- Execute:

docker run -d --gpus all -v ollama:/root/.ollama -p 11434:11434 ollama/ollama - Use comandos Ollama como de costume:

docker exec -it ollama ollama pull llama2 - Ganhe orquestração Docker com simplicidade do Ollama

Monitoramento e Observabilidade

Ollama: Métricas básicas via API (/api/tags, /api/ps). Ferramentas de terceiros como Open WebUI fornecem dashboards.

Docker: Integração completa com Prometheus, Grafana, stack ELK e serviços de monitoramento em nuvem. Métricas de container (CPU, memória, GPU) estão prontamente disponíveis.

Conclusão

O cenário de implantação local de LLM evoluiu significativamente com a introdução do Docker Model Runner (DMR) pela Docker em 2025. A escolha agora depende dos seus requisitos específicos:

- Para desenvolvedores que buscam integração Docker: DMR fornece integração nativa de fluxo de trabalho Docker com comandos

docker model - Para simplicidade máxima: Ollama continua sendo a solução mais fácil com seu gerenciamento de modelos em um comando

- Para produção e corporativo: Tanto DMR quanto soluções de terceiros (vLLM, TGI) no Docker oferecem orquestração, monitoramento e escalabilidade

- Para o melhor dos dois mundos: Execute Ollama em containers Docker para combinar simplicidade com infraestrutura de produção

A introdução do DMR reduz a lacuna entre Docker e Ollama em termos de facilidade de uso. Ollama ainda vence em simplicidade para prototipagem rápida, enquanto o DMR se destaca para equipes já investidas em fluxos de trabalho Docker. Ambas as abordagens são ativamente desenvolvidas, prontas para produção, e o ecossistema é maduro o suficiente para que a troca entre eles seja relativamente indolor.

Conclusão: Se você já usa Docker extensivamente, o DMR é a escolha natural. Se você quer a experiência absolutamente mais simples, independentemente da infraestrutura, escolha Ollama. Para comparar essas opções locais com APIs de nuvem e outras configurações auto-hospedadas, consulte nosso guia Hospedagem de LLM: Local, Auto-hospedado e Infraestrutura em Nuvem Comparados.

Links Úteis

Docker Model Runner

- Página Oficial do Docker Model Runner

- Documentação do Docker Model Runner

- Guia de Início Rápido do Docker Model Runner

- Blog de Anúncio do Docker Model Runner

Ollama

Outras Soluções Docker

- Documentação vLLM

- Text Generation Inference da Hugging Face

- llama.cpp no GitHub

- NVIDIA Container Toolkit