Interfaces de Chat para Instâncias Locais do Ollama

Visão geral rápida das principais interfaces de usuário para Ollama em 2025

O Ollama hospedado localmente permite executar modelos de linguagem grandes na sua própria máquina, mas usá-lo via linha de comando não é amigável. Aqui estão vários projetos de código aberto que oferecem interfaces estilo ChatGPT que se conectam a uma instância local do Ollama.

Essas interfaces de usuário (UIs) suportam conversas por chat, muitas vezes com recursos como upload de documentos para geração aumentada por recuperação (RAG), e funcionam como aplicativos web ou de desktop. Abaixo está uma comparação das principais opções, seguida de seções detalhadas sobre cada uma. Para uma visão mais ampla de como o Ollama local se encaixa com vLLM, Docker Model Runner, LocalAI e provedores de nuvem — incluindo compensações de custo e infraestrutura — veja Hospedagem de LLM: Local, Autohospedado e Infraestrutura em Nuvem Comparados.

Comparação de UIs Compatíveis com Ollama

| Ferramenta de UI | Plataforma | Suporte a Documentos | Integração com Ollama | Pontos Fortes | Limitações |

|---|---|---|---|---|---|

| Page Assist | Extensão de navegador (Chrome, Firefox) | Sim – adicione arquivos para análise | Conecta-se ao Ollama local via configuração da extensão | Chat no navegador; gestão fácil de modelos e integração de contexto de páginas web. | Apenas navegador; requer instalação/configuração de uma extensão. |

| Open WebUI | App web (autohospedado; Docker/PWA) | Sim – RAG integrado (upload de documentos ou adição à biblioteca) | Suporte direto à API do Ollama ou servidor incluído (configure a URL base) | Rico em recursos (multi-LLM, offline, geração de imagens); amigável para mobile (PWA). | Configuração mais pesada (Docker/K8s); escopo amplo pode ser excessivo para uso simples. |

| LobeChat | App web (autohospedado; suporte PWA) | Sim – “Base de Conhecimento” com upload de arquivos (PDF, imagens, etc.) | Suporta Ollama como um de vários backends de IA (requer habilitar o acesso à API do Ollama) | UI elegante estilo ChatGPT; chat de voz, plugins e suporte a múltiplos modelos. | Conjunto de recursos complexo; requer configuração de ambiente (ex. cross-origin para Ollama). |

| LibreChat | App web (autohospedado; multi-usuário) | Sim – “Chat com Arquivos” usando RAG (via embeddings) | Compatível com Ollama e muitos outros provedores (alternável por chat) | Interface familiar estilo ChatGPT; recursos ricos (agentes, interpretador de código, etc.). | Instalação/configuração pode ser envolvida; projeto grande pode ser mais do que necessário para uso básico. |

| AnythingLLM | App desktop (Windows, Mac, Linux) ou web (Docker) | Sim – RAG integrado: arraste e solte documentos (PDF, DOCX, etc.) com citações | Ollama suportado como provedor de LLM (definido na configuração ou variáveis de ambiente Docker) | UI tudo-em-um (ChatGPT privado com seus documentos); construtor de agentes sem código, suporte multi-usuário. | Maior uso de recursos (DB de embeddings, etc.); app desktop carece de alguns recursos multi-usuário. |

| Chat-with-Notes | App web (servidor Flask leve) | Sim – upload de arquivos de texto/PDF e chat com seu conteúdo | Usa Ollama para todas as respostas de IA (requer Ollama rodando localmente) | Configuração e interface muito simples focadas em Q&A de documentos; dados permanecem locais. | UI e funcionalidades básicas; single-user, um documento por vez (sem recursos avançados). |

Cada uma dessas ferramentas é ativamente mantida e de código aberto. A seguir, exploramos os detalhes de cada opção, incluindo como funcionam com o Ollama, recursos notáveis e compensações.

Page Assist (Extensão de Navegador)

Page Assist é uma extensão de navegador de código aberto que traz chat de LLM local para o seu navegador. Suporta navegadores baseados em Chromium e Firefox, oferecendo uma barra lateral ou aba estilo ChatGPT onde você pode conversar com um modelo. O Page Assist pode se conectar ao Ollama rodando localmente como provedor de IA, ou a outros backends locais, através das suas configurações. Notavelmente, permite adicionar arquivos (ex. PDFs ou texto) para a IA analisar dentro do chat, habilitando fluxos de trabalho básicos de RAG. Você pode até tê-lo auxiliando com o conteúdo da página web atual ou realizando pesquisas na web por informações.

A configuração é direta: instale a extensão na Chrome Web Store ou Add-ons do Firefox, garanta que o Ollama esteja em execução e selecione Ollama como provedor de IA local nas configurações do Page Assist. A interface inclui recursos como histórico de conversas, seleção de modelos e uma URL compartilhável opcional para seus resultados de chat. Uma UI web também está disponível via atalho de teclado se você preferir uma experiência de chat em aba cheia.

Pontos Fortes: O Page Assist é leve e conveniente – como vive no navegador, não há servidor separado para rodar. É ótimo para contextos de navegação (você pode abri-lo em qualquer página web) e suporta integração de pesquisa na internet e anexos de arquivos para enriquecer a conversa. Também oferece recursos úteis como atalhos de teclado para novo chat e alternância da barra lateral.

Limitações: Sendo uma extensão, ele é restrito a um ambiente de navegador. A UI é mais simples e um pouco menos rica em recursos que aplicativos de chat standalone completos. Por exemplo, gestão multi-usuário ou plugins de agentes avançados não estão no escopo. Além disso, a configuração inicial pode exigir compilar/carregar a extensão se uma versão pré-empacotada não estiver disponível para o seu navegador (o projeto fornece instruções de build usando Bun ou npm). No geral, o Page Assist é ideal para uso individual quando você quer acesso rápido ao chat alimentado pelo Ollama enquanto navega na web, com capacidades moderadas de RAG.

Open WebUI (Aplicação Web Autohospedada)

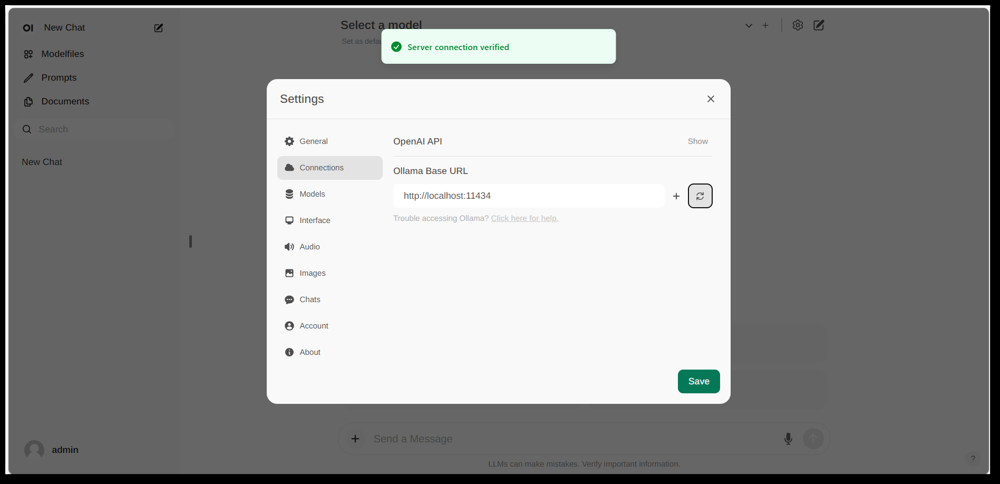

Interface de configurações do Open WebUI, mostrando uma conexão Ollama configurada (URL base definida para a API local do Ollama). A UI inclui uma seção de Documentos, habilitando fluxos de trabalho de RAG.

Open WebUI é uma poderosa interface de chat de propósito geral, originalmente criada para trabalhar com Ollama, e agora expandida para suportar vários backends de LLM. Roda como uma aplicação web autohospedada e é tipicamente implantada via Docker ou Kubernetes para facilitar a configuração. Uma vez em execução, você acessa através do navegador (com suporte para instalação como Aplicativo Web Progressivo em dispositivos móveis).

O Open WebUI oferece uma interface de chat completa com suporte multi-usuário, gestão de modelos e recursos extensivos. Criticamente, possui capacidades de RAG integradas – você pode enviar ou importar documentos para uma biblioteca de documentos e depois fazer perguntas com recuperação aumentada. A interface permite carregar documentos diretamente em uma sessão de chat ou manter uma biblioteca de conhecimento persistente. Suporta até mesmo realizar pesquisas na web e injetar resultados na conversa para informações atualizadas.

Integração com Ollama: Open WebUI conecta-se ao Ollama através da sua API. Você pode rodar o container Docker do Open WebUI junto com um servidor Ollama e definir uma variável de ambiente para apontar para a URL do Ollama, ou usar uma imagem Docker especial que inclui o Ollama com a UI web. Na prática, após iniciar os containers, você visitará o Open WebUI no seu navegador e verá o “Conexão do servidor verificada” se configurado corretamente (como mostrado na imagem acima). Isso significa que a UI está pronta para usar seus modelos locais do Ollama para chat. O Open WebUI também suporta endpoints compatíveis com API OpenAI, permitindo interface com LM Studio, OpenRouter, etc., além do Ollama.

Pontos Fortes: Esta solução é uma das UIs mais ricas em recursos e flexíveis. Suporta modelos simultâneos múltiplos e threads de conversa, “personagens” ou prompts de sistema personalizados, geração de imagens e mais. A implementação de RAG é robusta – você obtém uma UI completa para gerenciar documentos e até configurar qual vetor armazenado ou serviço de busca usar para recuperação. O Open WebUI também é ativamente desenvolvido (com uma comunidade extensa, como indicado pelo alto número de estrelas no GitHub) e projetado para extensibilidade e escalabilidade. É uma boa escolha se você quer uma UI de chat tudo-em-um para modelos locais, especialmente em cenários com múltiplos usuários ou casos de uso complexos.

Limitações: Com grande poder vem maior complexidade. O Open WebUI pode ser excesso para uso pessoal simples – implantar containers Docker e gerenciar a configuração pode ser intimidador se você não estiver familiarizado. Consome mais recursos que um app leve, pois roda um servidor web, banco de dados opcional para histórico de chat, etc. Além disso, recursos como controle de acesso baseado em função e gestão de usuários, embora úteis, indicam que é voltado para uma configuração de servidor – um único usuário em um PC doméstico pode não precisar de tudo isso. Em suma, a configuração é mais pesada e a interface pode parecer complexa se você só precisa de um clone básico do ChatGPT. Mas para aqueles que precisam da amplitude de recursos (ou querem alternar facilmente entre Ollama e outros provedores de modelos em uma UI), o Open WebUI é um concorrente de topo.

LobeChat (Framework Estilo ChatGPT com Plugins)

Banner de interface do LobeChat mostrando “Ollama Suportado” e múltiplos modelos locais. O LobeChat permite implantar um app web estilo ChatGPT elegante usando Ollama ou outros provedores, com recursos como entrada de voz e plugins.

LobeChat é um framework de chat de código aberto que enfatiza uma experiência de usuário polida e flexibilidade. É essencialmente um aplicativo web estilo ChatGPT que você pode autohospedar, com suporte para múltiplos provedores de IA – de OpenAI e Anthropic a modelos abertos via Ollama. O LobeChat é projetado pensando na privacidade (você o roda você mesmo) e tem uma interface moderna que inclui conveniências como memória de conversação, modo de conversação por voz e até geração de texto para imagem através de plugins.

Um dos recursos principais do LobeChat é a sua capacidade de Base de Conhecimento. Você pode enviar documentos (em formatos como PDFs, imagens, áudio, vídeo) e criar uma base de conhecimento que pode ser utilizada durante o chat. Isso significa que você pode fazer perguntas sobre o conteúdo dos seus arquivos – um fluxo de trabalho de RAG que o LobeChat suporta nativamente. A UI fornece gestão desses arquivos/bases de conhecimento e permite alternar seu uso na conversa, proporcionando uma experiência de Q&A mais rica além do LLM base.

Para usar o LobeChat com Ollama, você implantará o app LobeChat (por exemplo, via uma imagem Docker fornecida ou script) e configurará o Ollama como backend. O LobeChat reconhece o Ollama como um provedor de primeira classe – até oferece um script de implantação de um clique via o navegador Pinokio AI se você usar isso. Na prática, você pode precisar ajustar as configurações do Ollama (como habilitar CORS conforme a documentação do LobeChat) para que o frontend web do LobeChat possa acessar a API HTTP do Ollama. Uma vez configurado, você pode escolher um modelo hospedado pelo Ollama na UI do LobeChat e conversar com ele, incluindo consultar seus documentos enviados.

Pontos Fortes: A UI do LobeChat é frequentemente elogiada por ser limpa e amigável, imitando de perto o visual e sensação do ChatGPT (o que pode facilitar a adoção). Adiciona valor com extras como entrada/saída de voz para conversas faladas e um sistema de plugins para estender a funcionalidade (similar aos plugins do ChatGPT, habilitando coisas como navegação web ou geração de imagens). O suporte multi-modelo significa que você pode alternar facilmente entre, digamos, um modelo local do Ollama e um modelo de API OpenAI na mesma interface. Também suporta instalação como PWA amigável para mobile, para que você possa acessar seu chat local em movimento.

Limitações: Configurar o LobeChat pode ser mais complexo que algumas alternativas. É uma aplicação full-stack (muitas vezes rodando com Docker Compose), então há alguma sobrecarga. Em particular, configurar a integração com Ollama requer habilitar solicitações cross-origin no lado do Ollama e garantir que as portas estejam alinhadas – uma tarefa única, mas técnica. Além disso, embora o LobeChat seja bastante poderoso, nem todos os recursos podem ser necessários para cada usuário; por exemplo, se você não precisar de suporte multi-provedor ou plugins, a interface pode parecer poluída comparada a uma ferramenta minimalista. Por último, certos recursos avançados como a implantação de um clique assumem ambientes específicos (navegador Pinokio ou Vercel), que você pode ou não usar. No geral, o LobeChat é ideal se você quer uma alternativa completa ao ChatGPT que rode localmente com Ollama, e não se importa com um pouco de configuração inicial para chegar lá.

LibreChat (Clone do ChatGPT com Suporte Multi-Provedor)

LibreChat (anteriormente conhecido como ChatGPT-Clone ou UI) é um projeto de código aberto que visa replicar e estender a interface e funcionalidade do ChatGPT. Pode ser implantado localmente (ou no seu próprio servidor) e suporta uma variedade de backends de IA – incluindo modelos de código aberto via Ollama. Essencialmente, o LibreChat fornece a experiência de chat familiar (interface de diálogo com histórico, mensagens de usuário e assistente) enquanto permite conectar diferentes provedores de modelos no backend.

O LibreChat suporta interação com documentos e RAG através de um add-on chamado API RAG e serviços de embedding. Na interface, você pode usar recursos como “Chat com Arquivos”, que permite enviar documentos e depois fazer perguntas sobre eles. Sob o capô, isso usa embeddings e um vetor armazenado para buscar contexto relevante dos seus arquivos. Isso significa que você pode alcançar um efeito similar ao ChatGPT + conhecimento personalizado, tudo localmente. O projeto até fornece um repositório separado para o serviço RAG se você quiser autohospedar isso.

Usar o LibreChat com Ollama tipicamente envolve rodar o servidor LibreChat (por exemplo via Node/Docker) e garantir que possa alcançar o serviço Ollama. O LibreChat tem uma configuração de “Endpoint Personalizado” onde você pode inserir uma URL de API compatível com OpenAI. Como o Ollama pode expor uma API local compatível com OpenAI, o LibreChat pode ser apontado para http://localhost:11434 (ou onde quer que o Ollama esteja ouvindo). De fato, o LibreChat lista explicitamente Ollama entre seus provedores de IA suportados – ao lado de outros como OpenAI, Cohere, etc. Uma vez configurado, você pode selecionar o modelo (modelo do Ollama) em um dropdown e conversar. O LibreChat também permite alternar modelos ou provedores mesmo no meio da conversa e suporta múltiplos pré-configurações/contextos de chat.

Pontos Fortes: A principal vantagem do LibreChat é o conjunto rico de recursos construídos em torno da experiência de chat. Inclui coisas como ramificação de conversas, busca de mensagens, suporte integrado a Interpretador de Código (execução de código segura em sandbox) e integrações de ferramentas/agentes. É essencialmente um ChatGPT++, com a capacidade de integrar modelos locais. Para alguém que gosta da UI do ChatGPT, o LibreChat será muito familiar e requer pouca curva de aprendizado. O projeto é ativo e impulsionado pela comunidade (como evidenciado por suas atualizações frequentes e discussões), e é bastante flexível: você pode conectar a muitos tipos de endpoints de LLM ou até rodá-lo multi-usuário com autenticação para um ambiente de equipe.

Limitações: Com seus muitos recursos, o LibreChat pode ser mais pesado para rodar. A instalação pode envolver configurar um banco de dados para armazenar chats e configurar variáveis de ambiente para várias APIs. Se você habilitar todos os componentes (RAG, agentes, geração de imagens, etc.), é uma pilha bastante complexa. Para um único usuário que precisa apenas de um chat básico com um modelo local, o LibreChat pode ser mais do que necessário. Além disso, a UI, embora familiar, não é altamente especializada para Q&A de documentos – faz o trabalho, mas carece de uma interface dedicada de “biblioteca de documentos” (uploads são feitos tipicamente dentro de um chat ou via API). Em suma, o LibreChat brilha quando você quer um ambiente completo estilo ChatGPT com uma gama de recursos rodando localmente, mas soluções mais simples podem ser suficientes para casos de uso estreitos.

AnythingLLM (App Tudo-em-Um Desktop ou Servidor)

AnythingLLM é uma aplicação de IA tudo-em-um que enfatiza RAG e facilidade de uso. Permite que você “converse com seus documentos” usando LLMs de código aberto ou até modelos da OpenAI, tudo através de uma única interface unificada. Notavelmente, o AnythingLLM está disponível tanto como um app desktop multiplataforma (para Windows, Mac, Linux) quanto como um servidor web autohospedado (via Docker). Essa flexibilidade significa que você pode rodá-lo como um aplicativo normal no seu PC, ou implantá-lo para múltiplos usuários em um servidor.

O manuseio de documentos é o núcleo do AnythingLLM. Você pode arrastar e soltar documentos (PDF, TXT, DOCX, etc.) no app, e ele automaticamente os indexará em um banco de dados vetorial (vem com LanceDB por padrão). Na interface de chat, quando você faz perguntas, ele recupera trechos relevantes dos seus documentos e fornece respostas com citações, para que você saiba de qual arquivo e seção a informação veio. Essencialmente, ele constrói uma base de conhecimento privada para você e permite que o LLM o use como contexto. Você pode organizar documentos em “espaços de trabalho” (por exemplo, um espaço de trabalho por projeto ou tópico), isolando contextos conforme necessário.

Usar Ollama com AnythingLLM é direto. Na configuração, você escolhe Ollama como provedor de LLM. Se rodando via Docker, você define variáveis de ambiente como LLM_PROVIDER=ollama e fornece a OLLAMA_BASE_PATH (a URL da sua instância Ollama). O servidor AnythingLLM então enviará todas as consultas de modelo para a API do Ollama. O Ollama é oficialmente suportado, e a documentação nota que você pode usá-lo para rodar vários modelos abertos (como Llama 2, Mistral, etc.) localmente. De fato, os desenvolvedores destacam que combinar AnythingLLM com Ollama desbloqueia poderosas capacidades de RAG offline: Ollama lida com a inferência do modelo, e AnythingLLM lida com embeddings e a lógica de UI/agentes.

Pontos Fortes: AnythingLLM fornece uma solução abrangente para Q&A privado e chat. Pontos fortes chave incluem: configuração fácil para RAG (o trabalho pesado de embedding e armazenar vetores é automatizado), suporte a múltiplos documentos com citação clara de fontes, e recursos adicionais como Agentes de IA (tem um construtor de agentes sem código onde você pode criar fluxos de trabalho personalizados e uso de ferramentas). Também é multi-usuário nativamente (especialmente no modo servidor), com contas de usuário e permissões se necessário. A interface é projetada para ser simples (caixa de chat + barra lateral de documentos/espaços de trabalho) mas poderosa sob o capô. Para uso pessoal, o app desktop é um grande plus – você obtém um app com sensação nativa sem precisar abrir um navegador ou rodar comandos, e ele armazena dados localmente por padrão.

Limitações: Por integrar muitos componentes (API de LLM, modelos de embedding, DB vetorial, etc.), AnythingLLM pode ser intensivo em recursos. Quando você ingere documentos, pode levar tempo e memória para gerar embeddings (até suporta usar o próprio Ollama ou modelos locais para embeddings com modelos como nomic-embed). O app desktop simplifica o uso, mas se você tiver muitos documentos ou arquivos muito grandes, espere algum processamento pesado em segundo plano. Outra limitação é que usuários avançados podem achar menos configurável que montar sua própria pilha – por exemplo, atualmente usa LanceDB ou Chroma; se você quisesse um vetor armazenado diferente, teria que mergulhar na configuração ou código. Além disso, embora suporte multi-provedor, a interface é realmente voltada para um modelo de cada vez (você alternaria a configuração global do provedor se quisesse usar um modelo diferente). Em resumo, AnythingLLM é uma excelente solução pronta para uso para chat de documentos local, especialmente com Ollama, mas é um aplicativo maior para rodar comparado a UIs minimalistas.

Chat-with-Notes (UI Minimalista de Chat de Documentos)

Chat-with-Notes é uma aplicação minimalista especificamente construída para conversar com arquivos de texto locais usando modelos gerenciados pelo Ollama. É essencialmente um servidor web Flask leve que você roda no seu PC, proporcionando uma página web simples onde você pode enviar um documento e iniciar um chat sobre ele. O objetivo deste projeto é simplicidade: não tem muitos apetrechos, mas faz o trabalho central de resposta a perguntas de documentos com um LLM local.

Usar o Chat-with-Notes envolve primeiro garantir que sua instância Ollama esteja rodando um modelo (por exemplo, você pode iniciar o Ollama com ollama run llama2 ou outro modelo). Depois você inicia o app Flask (python app.py) e abre o site local. A UI solicitará que você envie um arquivo (formatos suportados incluem texto simples, Markdown, arquivos de código, HTML, JSON e PDFs). Uma vez enviado, o conteúdo de texto do arquivo é exibido, e você pode fazer perguntas ou conversar com a IA sobre aquele conteúdo. A conversa acontece em um formato de balão de chat típico. Se você enviar um novo arquivo no meio da conversa, o app perguntará se você quer iniciar um chat fresco ou manter o contexto do chat atual e apenas adicionar as informações do novo arquivo. Assim, você pode conversar sobre múltiplos arquivos sequencialmente se necessário. Também há botões para limpar o chat ou exportar a conversa para um arquivo de texto.

Sob o capô, o Chat-with-Notes consulta a API do Ollama para gerar respostas. O Ollama lida com a inferência do modelo, e o Chat-with-Notes apenas fornece o prompt (que inclui partes relevantes do texto enviado). Não usa um banco de dados vetorial; em vez disso, simplesmente envia todo o conteúdo do arquivo (ou pedaços dele) junto com sua pergunta para o modelo. Esta abordagem funciona melhor para documentos de tamanho razoável que cabem na janela de contexto do modelo.

Pontos Fortes: O app é extremamente simples de implantar e usar. Não há configuração complexa – se você tiver Python e Ollama configurados, pode rodar em um minuto ou dois. A interface é limpa e minimalista, focando no conteúdo de texto e no Q&A. Como é tão focado, garante que todos os dados permaneçam locais e apenas na memória (sem chamadas externas exceto para Ollama em localhost). É uma ótima escolha se você especificamente quer conversar com arquivos e não precisa de conversação geral sem um documento.

Limitações: O minimalismo do Chat-with-Notes significa que carece de muitos recursos encontrados em outras UIs. Por exemplo, não suporta usar múltiplos modelos ou provedores (é Ollama-only por design), e não mantém uma biblioteca de documentos de longo prazo – você envia arquivos conforme necessário por sessão, e não há um índice vetorial persistente. Escalar para documentos muito grandes pode ser complicado sem ajustes manuais, pois pode tentar incluir muito texto no prompt. Além disso, a UI, embora funcional, não é tão polida (sem modo escuro, sem formatação de texto rico das respostas, etc.). Em essência, esta ferramenta é ideal para análises rápidas e pontuais de arquivos com um modelo Ollama. Se suas necessidades crescerem (digamos, muitos documentos, ou desejo de uma UI mais elaborada), você pode superar o Chat-with-Notes. Mas como ponto de partida ou uma solução pessoal de “pergunte ao meu PDF” sobre o Ollama, é muito eficaz.

Conclusão

Cada uma dessas UIs de código aberto pode aprimorar sua experiência com modelos locais do Ollama fornecendo uma interface de chat amigável e capacidades extras como resposta a perguntas de documentos. A melhor escolha depende dos seus requisitos e conforto técnico:

- Para configuração rápida e uso baseado em navegador: Page Assist é uma ótima escolha, integrando-se diretamente à sua navegação web com pouco trabalho.

- Para um ambiente de app web completo: Open WebUI ou LibreChat oferecem recursos extensivos e flexibilidade multi-modelo, adequados para usuários avançados ou configurações multi-usuário.

- Para uma alternativa polida ao ChatGPT com potencial de plugins: LobeChat oferece um bom equilíbrio de usabilidade e recursos em um pacote autohospedado.

- Para interações focadas em documentos: AnythingLLM entrega uma solução tudo-em-um (particularmente se você gosta de ter um app desktop), enquanto Chat-with-Notes oferece uma abordagem minimalista para Q&A de único documento.

Como todas essas ferramentas são ativamente mantidas, você também pode esperar melhorias e suporte da comunidade. Ao escolher uma dessas UIs, você poderá conversar com seus modelos hospedados localmente pelo Ollama de uma maneira conveniente – seja analisando documentos, codificando com assistência ou apenas tendo IA conversacional disponível sem dependências de nuvem. Cada solução acima é de código aberto, então você pode adaptá-los ainda mais às suas necessidades ou até contribuir para seu desenvolvimento. Para ver como o Ollama local mais essas UIs se encaixa com outras opções locais e de nuvem, consulte nosso guia Hospedagem de LLM: Local, Autohospedado e Infraestrutura em Nuvem Comparados.

Boa conversa com seu LLM local!