Comparando a adequação das GPUs da NVidia para IA

A IA exige muita energia...

No meio da agitação do mundo moderno, estou comparando as especificações técnicas de diferentes placas adequadas para tarefas de IA (Aprendizado Profundo, Detecção de Objetos e LLMs). No entanto, todas elas são incrivelmente caras.

Para saber mais sobre como a escolha da GPU afeta a taxa de transferência de LLM, os limites de VRAM e os benchmarks em diferentes ambientes de execução, consulte Desempenho de LLM: Benchmarks, Gargalos e Otimização.

Esta é uma imagem gerada por IA. Não leve a sério…

Vamos olhar para outras opções, apenas para dar uma volta

| Placa | VRAM | Largura de Barramento | Largura de Banda de Memória | Núcleos CUDA | Núcleos Tensor | Potência (W) |

|---|---|---|---|---|---|---|

| RTX 4060 Ti 16GB | 16 GB | 128-bit | 288 GB/s | 4.352 | 136 | 165 |

| RTX 4070 Ti 16GB | 16 GB | 256-bit | 672 GB/s | 7.680 | 240 | 285 |

| RTX 4080 16GB | 16 GB | 256-bit | 716,8 GB/s | 9.728 | 304 | 320 |

| RTX 4080 Super 16GB | 16 GB | 256-bit | 736 GB/s | 10.240 | 320 | 320 |

| RTX 4090 24GB | 24 GB | 384-bit | 1008 GB/s | 16.384 | 512 | 450 |

| RTX 5060 Ti 16GB | 16 GB | 128-bit | 448 GB/s | 4.608 | 144 | 180 |

| RTX 5070 Ti 16GB | 16 GB | 256-bit | 896 GB/s | 8.960 | 280 | 300 |

| RTX 5080 16GB | 16 GB | 256-bit | 896 GB/s | 10.752 | 336 | ~320 |

| RTX 5090 32GB | 32 GB | 512-bit | 1792 GB/s | 21.760 | 680 | ~450 |

| RTX 2000 Ada | 16 GB | 128-bit | 224 GB/s | 2.816 | 88 | 70 |

| RTX 4000 Ada | 20 GB | 160-bit | 280 GB/s | 6.144 | 192 | 70 |

| RTX 4500 Ada | 24 GB | 192-bit | 432 GB/s | 7.680 | 240 | 210 |

| RTX 5000 Ada | 32 GB | 256-bit | 576 GB/s | 12.800 | 400 | 250 |

| RTX 6000 Ada | 48 GB | 384-bit | 960 GB/s | 18.176 | 568 | 300 |

Largura de Banda de Memória:

- RTX 5090 (1792 GB/s), seguida da RTX 4090 (1008 GB/s) e depois da RTX 6000 Ada (960 GB/s)

Núcleos Tensor:

- RTX 5090 (680), seguida da RTX 6000 Ada (568) e depois da RTX 4090 (512)

Núcleos CUDA

- RTX 5090 (21.760), seguida da RTX 6000 Ada (18.176) e depois da RTX 4090 (16.384)

RAM

- RTX 6000 Ada (48 GB), seguida da RTX 5090 e RTX 5000 Ada (32 GB) e depois da RTX 4090 (24 GB)

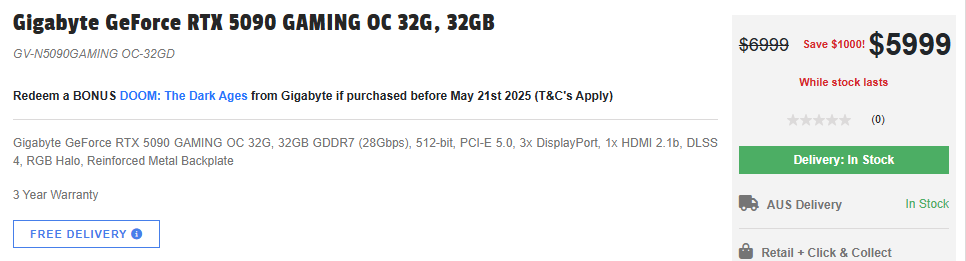

Preços na Austrália

- RTX 6000 Ada: 12.000 AUD

- RTX 5090: 6.000 AUD

- RTX 5000 Ada: 7.000 AUD

- RTX 4090: Esgotado

A melhor GPU de consumo para LLM

Ainda assim, acho que a RTX 5090 seria a melhor escolha para aprendizado de máquina, aprendizado profundo, IA e até mesmo LLMs :)…

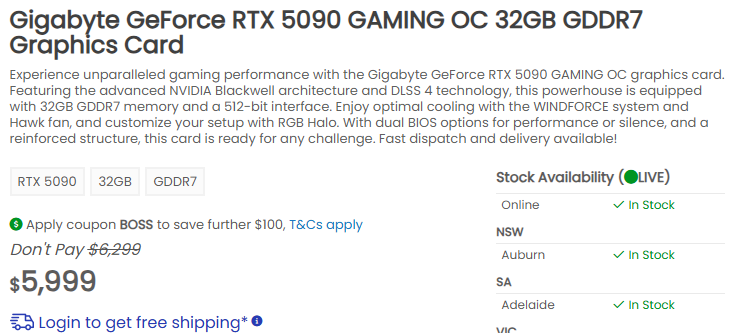

Preços Reais

Um pouco caro…

E os preços reais da RTX 5090 são 50% mais altos do que o esperado. Olhem para isso!

Isso é em 15/05/2025

Para explorar benchmarks de LLM, requisitos de VRAM e ajuste de desempenho em diferentes GPUs e ambientes de execução, verifique nosso hub Desempenho de LLM: Benchmarks, Gargalos e Otimização.