Перемещение моделей Ollama в другое расположение

Файлы моделей LLM в Ollama занимают много места

После установки Ollama лучше сразу же перенастроить Ollama для хранения их в новом месте. Таким образом, после загрузки новой модели она не будет скачиваться в старое расположение.

Об Ollama

Ollama — это текстовый интерфейс для моделей ИИ с большими языковыми моделями (LLM) и API, способное также их размещать. Для более широкого сравнения Ollama с vLLM, Docker Model Runner, LocalAI и облачными провайдерами, включая компромиссы по стоимости и инфраструктуре, см. Размещение LLM: локальное, самодостаточное и облачное инфраструктурное сравнение.

Установка Ollama

Перейдите на https://ollama.com/download

Для установки Ollama на Linux:

curl -fsSL https://ollama.com/install.sh | sh

Ollama для Windows находится на странице: https://ollama.com/download/windows Ollama для Mac также доступна: https://ollama.com/download/macOllamaSetup.exe

Загрузка, список и удаление моделей Ollama

Для загрузки некоторых моделей Ollama: Перейдите в библиотеку Ollama (https://ollama.com/library) и найдите нужную модель, там же можно найти теги и размеры моделей.

Затем выполните:

ollama pull gemma2:latest

# Или получить немного более умную модель, которая всё ещё хорошо помещается в 16 ГБ VRAM:

ollama pull gemma2:27b-instruct-q3_K_S

# Или:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

Для проверки моделей, которые Ollama имеет в локальном репозитории:

ollama list

Для удаления ненужной модели:

ollama rm qwen2:7b-instruct-q8_0 # например

Расположение моделей Ollama

По умолчанию файлы моделей хранятся в:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

Та же проблема с хранением возникает, когда Ollama работает в контейнерах: вы хотите, чтобы модели и состояние сервера находились в именованном томе или точке монтирования (и при необходимости OLLAMA_MODELS, когда структура должна отличаться от пути по умолчанию /root/.ollama в официальном образе). Для полной конфигурации Compose с резервированием GPU, OLLAMA_HOST, обновлениями и паттернами отката см. Ollama в Docker Compose с GPU и постоянным хранением моделей.

Настройка пути к моделям Ollama в Windows

Для создания переменной окружения в Windows выполните следующие действия:

- Откройте настройки Windows.

- Перейдите в систему.

- Выберите “О системе”.

- Выберите “Дополнительные настройки системы”.

- Перейдите на вкладку “Дополнительно”.

- Выберите “Переменные среды…”.

- Нажмите “Создать…”.

- И создайте переменную OLLAMA_MODELS, указывающую на место, где вы хотите хранить модели.

Перемещение моделей Ollama в Linux

Измените параметры службы systemd ollama:

sudo systemctl edit ollama.service

или

sudo xed /etc/systemd/system/ollama.service

Это откроет редактор.

Для каждой переменной окружения добавьте строку Environment в секцию [Service]:

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

Сохраните и выйдите.

Также есть параметры Пользователя и Группы, у которых должен быть доступ к этой папке.

Перезагрузите systemd и перезапустите Ollama:

sudo systemctl daemon-reload

sudo systemctl restart ollama

если что-то пошло не так:

systemctl status ollama.service

sudo journalctl -u ollama.service

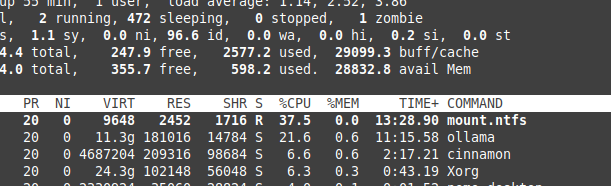

Накладные расходы при хранении файлов на NTFS

Пожалуйста, имейте в виду, что если вы работаете в Linux и храните модели на разделе с файловой системой NTFS, загрузка ваших моделей будет происходить гораздо медленнее — более чем на 20%.

Установка Ollama в Windows в конкретную папку

Вместе с моделями:

.\OllamaSetup.exe /DIR=D:\OllamaDir

Публикация API Ollama во внутренней сети

Внутренняя сеть здесь означает локальную сеть.

Добавьте в конфигурацию службы:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

Это публикует чистый HTTP API в вашей сети. Для автоматизированного HTTPS, корректного потокового вещания и проксирования WebSocket через Caddy или Nginx, а также для усиления краевых узлов (таймауты, буферизация, опциональная аутентификация перед API), используйте Ollama за обратным прокси с Caddy или Nginx для потокового HTTPS.

Для доступа к Ollama с удаленных устройств без открытия публичных портов используйте частное покрытие (Tailscale) или WireGuard; см. Удаленный доступ к Ollama через Tailscale или WireGuard без публичных портов.

Чтобы узнать, как Ollama вписывается в другие локальные и облачные варианты LLM, ознакомьтесь с нашим руководством Размещение LLM: локальное, самодостаточное и облачное инфраструктурное сравнение.

Полезные ссылки

- Тест: как Ollama использует производительность процессора Intel и эффективные ядра

- Как Ollama обрабатывает параллельные запросы

- Производительность LLM и линии PCIe: ключевые соображения

- Сравнение скорости производительности LLM

- Сравнение возможностей суммирования LLM

- Написание эффективных промптов для LLM

- Самохостинг Perplexica — с Ollama

- Облачные провайдеры LLM