OpenClaw-quickstart: Installera med Docker (Ollama GPU eller Claude + CPU)

Installera OpenClaw lokalt med Ollama

OpenClaw är en självhyst AI-assistant designad för att köras med lokala LLM-runtime som Ollama eller med molnbaserade modeller som Claude Sonnet.

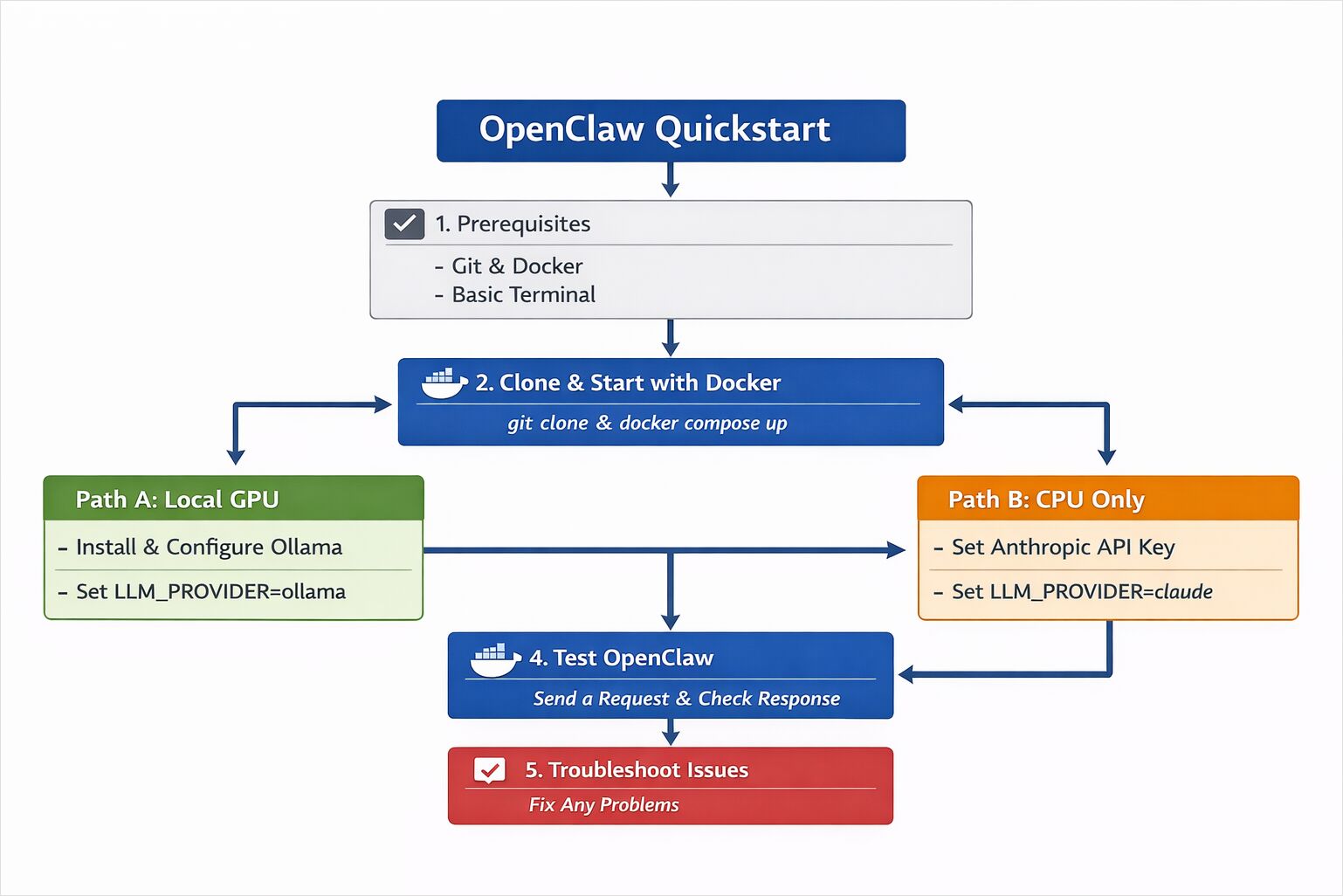

Denna snabbguide visar hur du distribuerar OpenClaw med Docker, konfigurerar antingen en GPU-driven lokal modell eller en enbart CPU-baserad molnmodell, och verifierar att din AI-assistant fungerar från start till mål.

Denna guide går igenom en minimal installation av OpenClaw så att du kan se den köra och svara på din egen maskin.

Målet är enkelt:

- Kom igång med OpenClaw.

- Skicka en förfrågan.

- Bekräfta att det fungerar.

Detta är inte en guide för produktionssäkerhet.

Detta är inte en guide för prestandaoptimering.

Detta är en praktisk startpunkt.

Du har två alternativ:

- Väg A — Lokal GPU med Ollama (rekommenderas om du har en GPU)

- Väg B — Enbart CPU med Claude Sonnet 4.6 via Anthropic API

Båda vägarna delar samma kärnprocess för installation.

Om du är ny till OpenClaw och vill ha en djupare översikt över hur systemet är strukturerat, läs OpenClaw systemöversikt.

Systemkrav och miljökonfiguration

OpenClaw är ett assistentbaserat system som kan ansluta till externa tjänster. För denna snabbguide:

- Använd testkonton där det är möjligt.

- Undvik att ansluta känsliga produktionssystem.

- Kör det inuti Docker (rekommenderas).

Isolering är en bra standardinställning när man experimenterar med agenter.

Förutsättningar för OpenClaw (GPU med Ollama eller CPU med Claude)

Krävs för båda vägarna

- Git

- Docker Desktop (eller Docker + Docker Compose)

- En terminal

För Väg A (Lokal GPU)

- En maskin med en kompatibel GPU (NVIDIA eller AMD rekommenderas)

- Ollama installerad

För Väg B (CPU + Molnmodell)

- En Anthropic API-nyckel

- Åtkomst till Claude Sonnet 4.6

Steg 1 — Installera OpenClaw med Docker (Kloning & Start)

OpenClaw kan startas med Docker Compose. Detta håller installationen innesluten och reproducerbar.

Klona repositoriet

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Kopiera miljökonfigurationen

cp .env.example .env

Öppna .env i din editor. Vi kommer att konfigurera den i nästa steg beroende på vilken modellväg du väljer.

Starta behållarna

docker compose up -d

Om allt startar korrekt bör du se behållare köras:

docker ps

På detta stadium körs OpenClaw — men den är inte ansluten till en modell än.

Steg 2 — Konfigurera LLM-leverantör (Ollama GPU eller Claude CPU)

Nu bestämmer du hur inferens ska fungera.

Väg A — Lokal GPU med Ollama

Om du har en GPU tillgänglig är detta det enklaste och mest självständiga alternativet.

Installera eller verifiera Ollama

Om du behöver en mer detaljerad installationsguide eller vill konfigurera lagringsplatser för modeller, se:

- Installera Ollama och konfigurera modellplatser

- Ollama CLI-generell: ls, serve, run, ps + andra kommandon (uppdatering 2026)

Om Ollama inte är installerad:

curl -fsSL https://ollama.com/install.sh | sh

Verifiera att det fungerar:

ollama pull llama3

ollama run llama3

Om modellen svarar fungerar inferensen.

Konfigurera OpenClaw för att använda Ollama

I din .env-fil, konfigurera:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Starta om behållarna:

docker compose restart

OpenClaw kommer nu att routa förfrågningar till din lokala Ollama-instans.

Om du bestämmer dig för vilken modell du ska köra på en 16 GB GPU eller vill se jämförelser av prestanda, se:

För att förstå konkurrens och CPU-beteende under belastning:

- Hur Ollama hanterar parallella förfrågningar

- Test: Hur Ollama använder Intel CPU-prestanda och effektiva kärnor

Väg B — Enbart CPU med Claude Sonnet 4.6

Om du inte har en GPU kan du använda en värdmodell.

Lägg till din API-nyckel

I din .env-fil:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Starta om:

docker compose restart

OpenClaw kommer nu att använda Claude Sonnet 4.6 för inferens medan orkestreringen körs lokalt.

Den här installationen fungerar bra på enbart CPU-maskiner eftersom den tunga modellberäkningen sker i molnet.

Om du använder Anthropic-modeller här, denna ändring i Claude-prenumerationspolicy förklarar varför OpenClaw kräver API-baserad fakturering istället för återanvändning av Claude-planer.

Steg 3 — Testa OpenClaw med din första prompt

När behållarna körs och modellen är konfigurerad kan du testa assistenten.

Beroende på din installation kan detta ske via:

- En webbgränssnitt

- En meddelandeintegration

- En lokal API-ändpunkt

För en grundläggande API-test:

curl http://localhost:3000/health

Du bör se ett svar som indikerar att allt fungerar.

Skicka nu en enkel prompt:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Förklara vad OpenClaw gör på enkla termer."}'

Om du får ett strukturerat svar fungerar systemet.

Vad du just körde

På detta stadium har du:

- En körande OpenClaw-instans

- En konfigurerad LLM-leverantör (lokal eller moln)

- En fungerande slinga för förfrågan-svar

Om du valde GPU-vägen sker inferensen lokalt via Ollama.

Om du valde CPU-vägen sker inferensen via Claude Sonnet 4.6, medan orkestrering, routing och minnehantering körs inuti dina lokala Docker-behållare.

Den synliga interaktionen kan se enkel ut. Under ytan koordineras flera komponenter för att bearbeta din förfrågan.

Felsökning av installations- och körningsproblem med OpenClaw

Modellen svarar inte

- Verifiera din

.env-konfiguration. - Kontrollera behållarloggarna:

docker compose logs

Ollama är inte nåbar

- Bekräfta att Ollama körs:

ollama list

- Se till att bas-URL:n matchar din miljö.

Ogiltig API-nyckel

- Dubbelkolla

ANTHROPIC_API_KEY. - Starta om behållarna efter att ha uppdaterat

.env.

GPU används inte

- Bekräfta att GPU-drivrutiner är installerade.

- Se till att Docker har GPU-åtkomst aktiverad.

Nästa steg efter att ha installerat OpenClaw

Du har nu en fungerande OpenClaw-instans.

Härifrån kan du:

- Ansluta meddelandeplattformar

- Aktivera dokumenthämtning

- Experimentera med routingstrategier

- Lägg till observabilitet och metrik

- Justera prestanda och kostnadsbeteende

De djupare arkitektoniska diskussionerna blir mer meningsfulla när systemet är igång.

Att få det igång är det första steget.

När det är igång är de naturliga nästa artiklarna:

- OpenClaw-pluginsguide — vilka plugins du ska installera för minne, verktyg, kanaler och observabilitet, och hur livscykeln fungerar

- OpenClaw-skillsguide — vilka skills som är värda att installera från ClawHub, och hur du säkert begränsar dem per agentroll

- OpenClaw-produktionskonfiguration — hur plugins och skills kombineras för verkliga användartyper som utvecklare, automatiseringslagar, forskare och supportoperatörer

För fler fallstudier om AI-system, se avsnittet AI-system.