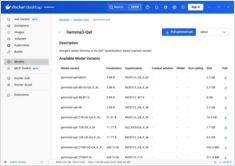

Qwen 3.6 27B och 35B MTP jämfört med Standard på 16 GB GPU

MTP jämfört med standarddekodning på RTX 4080 — verkliga benchmarkresultat

Jag testade prestandan för spekulativ dekodning (Multi-Token Prediction, MTP) i Qwen 3.6 27B och 35B på en RTX 4080 med 16 GB VRAM.