Flytta Ollama-modeller till en annan plats

Ollama LLM-modellfiler tar mycket plats.

Efter att ha installerat Ollama är det bättre att omedelbart omkonfigurera Ollama så att den lagrar modellerna på en ny plats. Så när vi drar ner en ny modell, laddas den inte ner till den gamla platsen.

Om Ollama

Ollama är ett textbaserat gränssnitt för LLM AI-modeller och en API som också kan värd dessa. För en bredare jämförelse av Ollama med vLLM, Docker Model Runner, LocalAI och molnleverantörer – inklusive kostnader och infrastrukturmotsättningar – se LLM-värd: Lokalt, Self-Hosted & Molninfrastruktur jämfört.

Installera Ollama

Gå till https://ollama.com/download

För att installera Ollama på Linux:

curl -fsSL https://ollama.com/install.sh | sh

Ollama på Windows finns på sidan: https://ollama.com/download/windows Ollama för Mac finns också: https://ollama.com/download/macOllamaSetup.exe

Hämta, lista och ta bort Ollama-modeller

För att hämta några Ollama-modeller: Gå till Ollama Library (https://ollama.com/library) och hitta modellen du behöver, där kan du också hitta modelltaggar och storlekar.

Kör sedan:

ollama pull gemma2:latest

# Eller hämta en något smartare variant som fortfarande passar i 16GB VRAM:

ollama pull gemma2:27b-instruct-q3_K_S

# Eller:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

För att kontrollera vilka modeller Ollama har i det lokala lagret:

ollama list

För att ta bort en onödig modell:

ollama rm qwen2:7b-instruct-q8_0 # för exempel

Ollama-modellplats

Som standard lagras modellfilerna på:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

Samma lagringsfråga uppstår när Ollama kör i behållare: du vill att modeller och serverstatus ska ligga på en namngiven volym eller bind mount (och eventuellt OLLAMA_MODELS när layouten ska skilja sig från standardvägen /root/.ollama i den officiella bilden). För en fullständig Compose-layout med GPU-reservation, OLLAMA_HOST, uppgraderingar och rollback-mönster, se Ollama i Docker Compose med GPU och varaktig modelllagring.

Konfigurera Ollama-modellväg på Windows

För att skapa en miljövariabel på Windows kan du följa dessa instruktioner:

- Öppna Windows-inställningar.

- Gå till System.

- Välj Om.

- Välj Avancerade systeminställningar.

- Gå till fliken Avancerat.

- Välj Miljövariabler…

- Klicka på Ny…

- Och skapa en variabel som heter OLLAMA_MODELS som pekar på där du vill lagra modellerna

Flytta Ollama-modeller på Linux

Redigera systemd-tjänstparametrarna för Ollama

sudo systemctl edit ollama.service

eller

sudo xed /etc/systemd/system/ollama.service

Detta öppnar en redigerare.

För varje miljövariabel, lägg till en rad Environment under sektionen [Service]:

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

Spara och avsluta.

Det finns också parametrar för Användare och Grupp, dessa måste ha tillgång till denna mapp.

Ladda om systemd och starta om Ollama:

sudo systemctl daemon-reload

sudo systemctl restart ollama

Om något gick fel

systemctl status ollama.service

sudo journalctl -u ollama.service

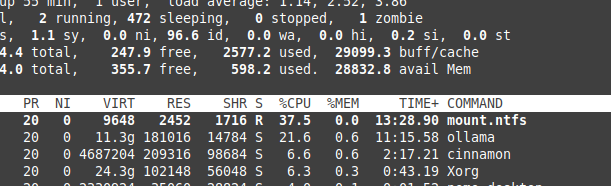

Lagring av filer på NTFS-overhead

Var medveten om att om du kör Linux och lagrar dina modeller på en NTFS-formaterad partition, så kommer dina modeller att laddas mycket – mer än 20% långsammare.

Installera Ollama på Windows till en specifik mapp

Tillsammans med modellerna

.\OllamaSetup.exe /DIR=D:\OllamaDir

Exponera Ollama-API för intern nätverk

Internt här betyder lokalt nätverk.

Lägg till i tjänstkonfigurationen:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

Det exponerar det rena HTTP-API:t på ditt nätverk. För automatiserad HTTPS, korrekt strömning och WebSocket-proxying via Caddy eller Nginx, och kantförstärkning (timeouts, buffring, valfri auth framför API:t), använd Ollama bakom en reverse proxy med Caddy eller Nginx för HTTPS-strömning.

För att nå Ollama från fjärrenheter utan att öppna publika portar, använd ett privat overlay (Tailscale) eller WireGuard; se Fjärråtkomst till Ollama via Tailscale eller WireGuard, inga publika portar.

För att se hur Ollama passar med andra lokala och molnbaserade LLM-alternativ, kolla vår LLM-värd: Lokalt, Self-Hosted & Molninfrastruktur jämfört guide.

Användbara länkar

- Test: Hur Ollama använder Intel CPU-prestanda och Effektiva kärnor

- Hur Ollama hanterar parallella förfrågningar

- LLM-prestanda och PCIe-linjer: Viktiga överväganden

- LLM-hastighetsjämförelse

- Jämförelse av LLM-sammanfattningsförmågor

- Skriva effektiva prompts för LLMs

- Self-hosting Perplexica - med Ollama

- Molnleverantörer för LLM