OpenClaw Inicio Rápido: Instalación con Docker (Ollama GPU o Claude + CPU)

Instale OpenClaw localmente con Ollama

OpenClaw es un asistente de IA autoalojado diseñado para ejecutarse con entornos locales de LLM como Ollama o con modelos basados en la nube como Claude Sonnet.

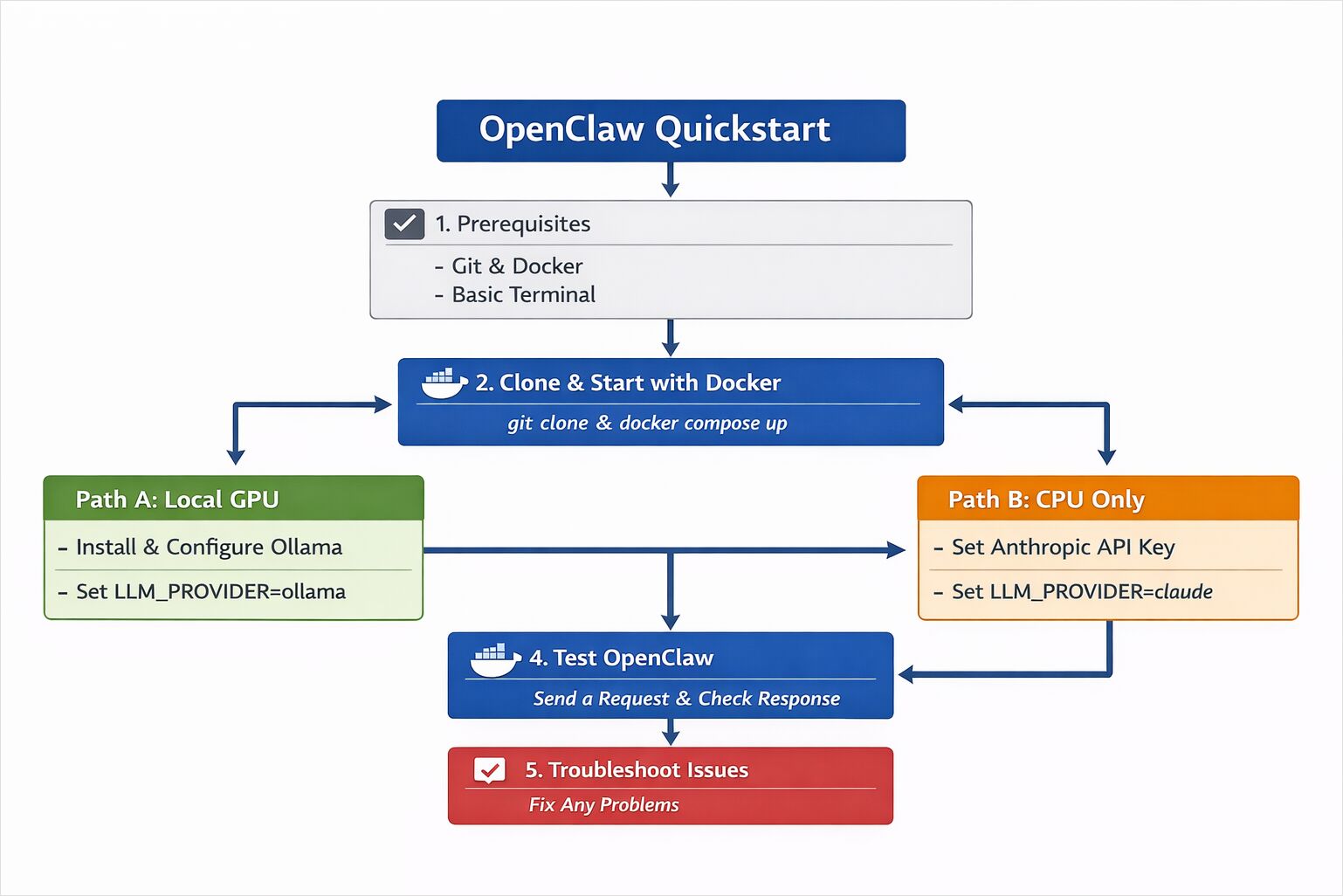

Esta guía rápida muestra cómo desplegar OpenClaw usando Docker, configurar un modelo local con GPU o un modelo de solo CPU en la nube, y verificar que su asistente de IA funciona de extremo a extremo.

Esta guía recorre una configuración mínima de OpenClaw para que pueda verlo ejecutándose y respondiendo en su propia máquina.

El objetivo es sencillo:

- Poner OpenClaw en funcionamiento.

- Enviar una solicitud.

- Confirmar que funciona.

Esto no es una guía de endurecimiento para producción. Esto no es una guía de ajuste de rendimiento. Este es un punto de partida práctico.

Tiene dos opciones:

- Ruta A — GPU local usando Ollama (recomendado si tiene una GPU)

- Ruta B — Solo CPU usando Claude Sonnet 4.6 a través de la API de Anthropic

Ambas rutas comparten el mismo proceso de instalación central.

Si es nuevo en OpenClaw y desea una visión más profunda de cómo está estructurado el sistema, lea la visión general del sistema OpenClaw.

Requisitos del sistema y configuración del entorno

OpenClaw es un sistema de estilo asistente que puede conectarse a servicios externos. Para esta guía rápida:

- Use cuentas de prueba cuando sea posible.

- Evite conectar sistemas de producción sensibles.

- Ejecútelo dentro de Docker (recomendado).

El aislamiento es un valor predeterminado adecuado al experimentar con software de estilo agente.

Prerrequisitos de OpenClaw (GPU con Ollama o CPU con Claude)

Requerido para ambas rutas

- Git

- Docker Desktop (o Docker + Docker Compose)

- Una terminal

Para la Ruta A (GPU local)

- Una máquina con una GPU compatible (se recomienda NVIDIA o AMD)

- Ollama instalado

Para la Ruta B (CPU + Modelo en la nube)

- Una clave de API de Anthropic

- Acceso a Claude Sonnet 4.6

Paso 1: Instalar OpenClaw con Docker (Clonar e Iniciar)

OpenClaw puede iniciarse usando Docker Compose. Esto mantiene la configuración contenida y reproducible.

Clonar el repositorio

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Copiar la configuración del entorno

cp .env.example .env

Abra .env en su editor. Lo configuraremos en el siguiente paso dependiendo de la ruta del modelo que elija.

Iniciar los contenedores

docker compose up -d

Si todo comienza correctamente, debería ver contenedores ejecutándose:

docker ps

En esta etapa, OpenClaw está ejecutándose, pero aún no está conectado a un modelo.

Paso 2: Configurar el proveedor de LLM (Ollama GPU o Claude CPU)

Ahora decida cómo desea que funcione la inferencia.

Ruta A — GPU local con Ollama

Si tiene una GPU disponible, esta es la opción más sencilla y autocontenida.

Instalar o verificar Ollama

Si necesita una guía de instalación más detallada o desea configurar las ubicaciones de almacenamiento de modelos, consulte:

- Instalar Ollama y configurar la ubicación de los modelos

- Hoja de trucos de Ollama CLI: ls, serve, run, ps + otros comandos (actualización 2026)

Si Ollama no está instalado:

curl -fsSL https://ollama.com/install.sh | sh

Verifique que funcione:

ollama pull llama3

ollama run llama3

Si el modelo responde, la inferencia está funcionando.

Configurar OpenClaw para usar Ollama

En su archivo .env, configure:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Reinicie los contenedores:

docker compose restart

OpenClaw ahora enrutará las solicitudes a su instancia local de Ollama.

Si está decidiendo qué modelo ejecutar en una GPU de 16 GB de VRAM o desea comparaciones de benchmarks, consulte:

Para comprender la concurrencia y el comportamiento de la CPU bajo carga:

- Cómo Ollama maneja solicitudes paralelas

- Prueba: Cómo Ollama utiliza el rendimiento de la CPU de Intel y núcleos eficientes

Ruta B — Solo CPU usando Claude Sonnet 4.6

Si no tiene una GPU, puede usar un modelo alojado.

Agregar su clave de API

En su archivo .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Reinicie:

docker compose restart

OpenClaw ahora usará Claude Sonnet 4.6 para la inferencia mientras la orquestación se ejecuta localmente.

Esta configuración funciona bien en máquinas de solo CPU porque el cálculo pesado del modelo ocurre en la nube.

Si está usando modelos de Anthropic aquí, este cambio en la política de suscripción de Claude explica por qué OpenClaw requiere facturación basada en API en lugar de reutilizar planes de Claude.

Paso 3: Probar OpenClaw con su primera solicitud

Una vez que los contenedores están ejecutándose y el modelo está configurado, puede probar el asistente.

Dependiendo de su configuración, esto puede ser a través de:

- Una interfaz web

- Una integración de mensajería

- Un punto de acceso API local

Para una prueba básica de API:

curl http://localhost:3000/health

Debería ver una respuesta de estado saludable.

Ahora envíe una solicitud sencilla:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Explain what OpenClaw does in simple terms."}'

Si recibe una respuesta estructurada, el sistema está funcionando.

Lo que acaba de ejecutar

En este punto, usted tiene:

- Una instancia de OpenClaw en ejecución

- Un proveedor de LLM configurado (local o en la nube)

- Un ciclo de solicitud-respuesta funcional

Si eligió la ruta de GPU, la inferencia ocurre localmente a través de Ollama.

Si eligió la ruta de CPU, la inferencia ocurre a través de Claude Sonnet 4.6, mientras que la orquestación, el enrutamiento y la gestión de memoria se ejecutan dentro de sus contenedores Docker locales.

La interacción visible puede parecer sencilla. Por debajo, múltiples componentes coordinan para procesar su solicitud.

Solución de problemas de instalación y errores de tiempo de ejecución de OpenClaw

El modelo no responde

- Verifique su configuración

.env. - Compruebe los registros del contenedor:

docker compose logs

Ollama no accesible

- Confirme que Ollama está ejecutándose:

ollama list

- Asegúrese de que la URL base coincida con su entorno.

Clave de API inválida

- Verifique

ANTHROPIC_API_KEY. - Reinicie los contenedores después de actualizar

.env.

GPU no se está utilizando

- Confirme que los controladores de GPU están instalados.

- Asegúrese de que Docker tenga el acceso a GPU habilitado.

Próximos pasos después de instalar OpenClaw

Ahora tiene una instancia de OpenClaw funcionando.

A partir de aquí, puede:

- Conectar plataformas de mensajería

- Habilitar la recuperación de documentos

- Experimentar con estrategias de enrutamiento

- Añadir observabilidad y métricas

- Ajustar el rendimiento y el comportamiento de costos

Las discusiones arquitectónicas más profundas tienen más sentido una vez que el sistema está en funcionamiento.

Ponerlo operativo es el primer paso.

Una vez que esté funcionando, los siguientes artículos naturales son:

- Guía de plugins de OpenClaw — qué plugins instalar para memoria, herramientas, canales y observabilidad, y cómo funciona el ciclo de vida

- Guía de habilidades de OpenClaw — qué habilidades valen la pena instalar desde ClawHub y cómo limitarlas de forma segura por rol de agente

- Patrones de configuración de producción de OpenClaw — cómo se combinan plugins y habilidades para tipos de usuarios reales como desarrolladores, equipos de automatización, investigadores y operadores de soporte

Para más estudios de caso de sistemas de IA, consulte la sección Sistemas de IA.