Esecuzione di FLUX.1-dev GGUF Q8 in Python

Accelerare FLUX.1-dev con la quantizzazione GGUF

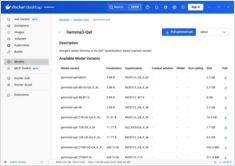

FLUX.1-dev è un potente modello di generazione di immagini da testo che produce risultati straordinari, ma il suo requisito di memoria di 24GB+ rende difficile il suo utilizzo su molti sistemi. Quantizzazione GGUF di FLUX.1-dev offre una soluzione, riducendo l’utilizzo della memoria del circa 50% mantenendo comunque una buona qualità delle immagini.