Docker Model Runner vs Ollama (2026): Vilken är bäst för lokala LLMs?

Jämför Docker Model Runner och Ollama för lokal LLM

Att köra stora språkmodeller (LLMs) lokalt har blivit alltmer populärt för skydd av integritet, kostnadsstyrning och möjlighet att använda modeller offline. Landskapet förändrades betydligt i april 2025 när Docker introducerade Docker Model Runner (DMR), sin officiella lösning för distribution av AI-modeller.

Nu konkurrerar tre olika metoder om utvecklarens uppmärksamhet: Docks egen Model Runner, tredjepartscontainerlösningar (vLLM, TGI) och den oberoende plattformen Ollama.

För en bredare översikt som också inkluderar molntjänstgivare och infrastrukturkompromisser, se LLM Hosting: Lokalt, självvärddat & Molninfrastruktur jämförd.

TL;DR – Docker Model Runner vs Ollama

Den här jämförelsen fokuserar på att köra stora språkmodeller (LLMs) lokalt med Docker eller oberoende körningar, och täcker prestanda, GPU-stöd, API-kompatibilitet och produktionsscenarier.

- Bäst för Docker-nya arbetsflöden: Docker Model Runner

- Bäst för enkelhet och snabb prototypning: Ollama

- Bäst för Kubernetes & orchestration: Docker-baserade inställningar

- Bäst för enskilda maskinutveckling: Ollama

Om du redan använder Docker intensivt, passar DMR bra.

Om du vill ha den snabbaste sättet att köra LLMs lokalt, är Ollama enklare.

Om du jämför mer än bara Docker Model Runner och Ollama, se vår fullständiga jämförelse av Ollama vs vLLM vs LM Studio och andra lokala LLM-verktyg. Den här guiden jämför API-mognad, hårdvarustöd, verktygskall och produktionsklarhet över 12+ lokala LLM-körningar.

Docker Model Runner vs Ollama: Direkt jämförelse

Med Docks officiella inträde i LLM-körningsområdet blir jämförelsen mer intressant. Här är hur DMR och Ollama står upp mot varandra:

| Egenskap | Docker Model Runner | Ollama |

|---|---|---|

| Installation | Docker Desktop AI-flik eller docker-model-plugin |

En kommando: curl | sh |

| Kommandostil | docker model pull/run/package |

ollama pull/run/list |

| Modellformat | GGUF (OCI Artifacts) | GGUF (inbyggd) |

| Modellfördelning | Docker Hub, OCI-registrar | Ollama-registret |

| GPU-inställning | Automatisk (enklare än traditionell Docker) | Automatisk |

| API | OpenAI-kompatibel | OpenAI-kompatibel |

| Docker-integrering | Inbyggd (är Docker) | Kör i Docker om det behövs |

| Compose-stöd | Inbyggd | Via Docker-bild |

| Lärandekurva | Låg (för Docker-användare) | Lägst (för alla) |

| Eko-systempartner | Google, Hugging Face, VMware | LangChain, CrewAI, Open WebUI |

| Bäst för | Docker-nya arbetsflöden | Enkelhet som en egen enhet |

Nyckelinsekt: DMR gör Dockers arbetsflöden tillgängliga för LLM-distribution, medan Ollama förblir ramverksneutralt med enklare oberoende drift. Din befintliga infrastruktur spelar en större roll än tekniska skillnader.

Är Docker Model Runner bättre än Ollama?

Det beror på ditt arbetsflöde.

- Välj Docker Model Runner (DMR) om din grupp redan starkt förlitar sig på Docker, OCI-artefakter och containerorchestration.

- Välj Ollama om du vill ha den enklare sättet att köra LLMs lokalt med minimal konfiguration och snabb prototypning.

För de flesta enskilda maskinställningar är Ollama enklare att använda.

För Docker-nya CI/CD-pipelines och enterprise-containerarbetsflöden integrerar DMR naturligare.

Hur man köra en LLM i Docker: DMR vs Ollama

Om målet är att enkelt köra en LLM inom Docker, kan både Docker Model Runner och Ollama i Docker-kontainer uppnå detta.

Docker Model Runner använder inbyggda docker model pull och docker model run-kommandon, förpackar modeller som OCI-artefakter.

Ollama kan också köra inom Docker med den officiella ollama/ollama-containerbilden, vilket exponerar en OpenAI-kompatibel API på port 11434.

Den viktigaste skillnaden ligger i arbetsflödesintegration:

- DMR passar naturligt in i Docker-nya CI/CD-pipelines.

- Ollama i Docker erbjuder enklare modellhantering med flexibilitet i Docker-orchestration.

Förstå Docker Model Runners

Dockerbaserade modellkörare använder containerisering för att förpacka LLM-inferensmotorer tillsammans med deras beroenden. Landskapet inkluderar både Docks officiella lösning och tredjepartsramverk.

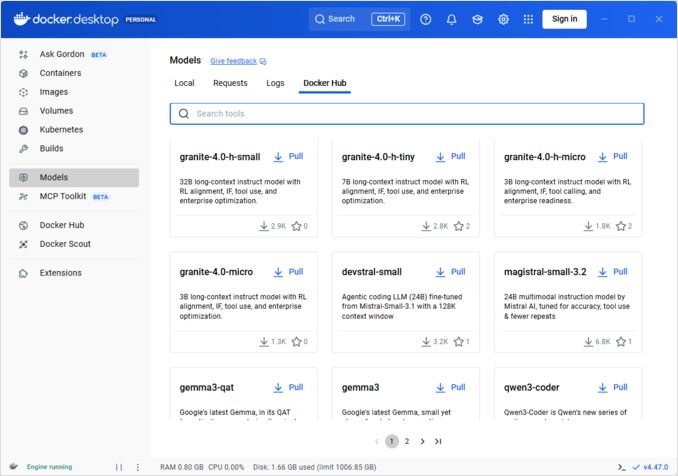

Docker Model Runner (DMR) - Officiell lösning

I april 2025 introducerade Docker Docker Model Runner (DMR), en officiell produkt som är utformad för att förenkla körning av AI-modeller lokalt med Docks infrastruktur. Detta representerar Docks engagemang att göra AI-modelldistribution lika smidig som containerdistribution.

Viktiga funktioner hos DMR:

- Inbyggd Docker-integrering: Använder bekanta Docker-kommandon (

docker model pull,docker model run,docker model package) - OCI-artefaktförpackning: Modeller förpackas som OCI-artefakter, vilket möjliggör distribution genom Docker Hub och andra registrar

- OpenAI-kompatibel API: En direkt ersättning för OpenAI-slutpunkter, vilket förenklar integration

- GPU-accelerering: Inbyggd GPU-stöd utan komplex nvidia-docker-konfiguration

- GGUF-formatstöd: Fungerar med populära kvantiserade modellformat

- Docker Compose-integrering: Enkelt att konfigurera och distribuera modeller med standard Docker-verktyg

- Testcontainers-stöd: Samverkar sömlöst med testverktyg

Installation:

- Docker Desktop: Aktivera via AI-flik i inställningar

- Docker Engine: Installera paketet

docker-model-plugin

Exempel på användning:

# Hämta en modell från Docker Hub

docker model pull ai/smollm2

# Kör inferens

docker model run ai/smollm2 "Förklara Docker Model Runner"

# Förpacka en anpassad modell

docker model package --gguf /path/to/model.gguf --push myorg/mymodel:latest

För en fullständig referens av docker model-kommandon, förpackningsalternativ, konfigurationsflaggor och praktiska exempel, se vår detaljerade Docker Model Runner Cheat Sheet: Kommandon & Exempel. Den täcker modellhämtning, förpackning, konfiguration och bästa praxis för att distribuera LLMs lokalt med Docker.

DMR samarbetar med Google, Hugging Face och VMware Tanzu för att utöka den AI-modellökosystem som är tillgänglig via Docker Hub. Om du är ny på Docker eller behöver en uppdatering om Docker-kommandon, erbjuder vår Docker Cheat Sheet en omfattande guide till viktiga Docker-operationer.

Tredjeparts Docker-lösningar

Utöver DMR inkluderar ekosystemet etablerade ramverk:

- vLLM-kontainer: Höggenomströmningsserver för inferens optimerad för batchbearbetning

- Text Generation Inference (TGI): Hugging Faces produktionsklara lösning

- llama.cpp-kontainer: Lättviktig C++-implementering med kvantisering

- Anpassade kontainer: Inkluderar PyTorch, Transformers eller egna ramverk

Fördelar med Docker-approchen

Flexibilitet och ramverksneutralt: Docker-kontainer kan köra alla LLM-ramverk, från PyTorch till ONNX Runtime, vilket ger utvecklare full kontroll över inferensstacken.

Resursisolation: Varje kontainer fungerar i isolerade miljöer med definierade resursgränser (CPU, minne, GPU), vilket förhindrar resurskonflikter i flermodelldistributioner.

Orchestration-stöd: Docker integrerar sömlöst med Kubernetes, Docker Swarm och molntjänster för skalning, lastbalansering och hög tillgänglighet.

Versionshantering: Olika modellversioner eller ramverk kan existera på samma system utan beroendekonflikter.

Nackdelar med Docker-approchen

Komplexitet: Kräver förståelse för containerisering, volymmonteringar, nätverkskonfiguration och GPU-överföring (nvidia-docker).

Överhuvud: Även om minimal, lägger Docker till en tunn abstraktionslager som lätt påverkar starttiden och resursanvändningen.

Konfigurationsbörda: Varje distribution kräver noggrann konfiguration av Dockerfiles, miljövariabler och körningsparametrar.

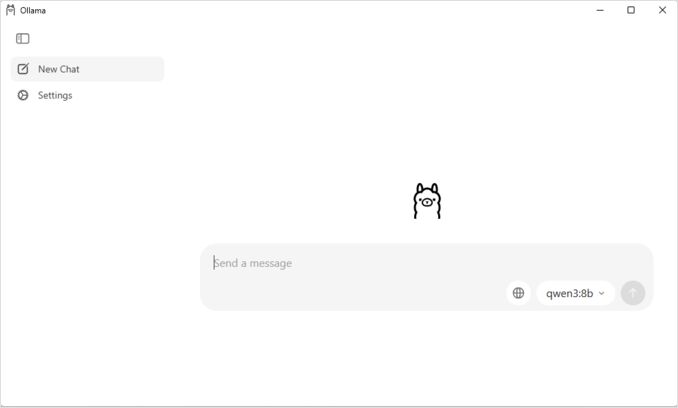

Förstå Ollama

Ollama är en syftar utformad för att köra LLMs lokalt, designad med enkelhet som sin kärnprincip. Den erbjuder:

- Inbyggd binär för Linux, macOS och Windows

- Inbyggd modellbibliotek med enkommandoinstallation

- Automatisk GPU-detektering och optimering

- RESTful API kompatibel med OpenAI-formatet

- Modellkontext och tillståndshantering

Fördelar med Ollama

Enkelhet: Installationen är enkel (curl | sh på Linux), och att köra modeller kräver bara ollama run llama2. För en fullständig referens av Ollama CLI-kommandon som ollama serve, ollama run, ollama ps och modellhanteringsflöden, se vår Ollama CLI Cheat Sheet.

Optimerad prestanda: Byggd på llama.cpp, är Ollama starkt optimerad för inferenshastighet med kvantiseringsstöd (Q4, Q5, Q8).

Modellhantering: Inbyggd modellregistre med kommandon som ollama pull, ollama list och ollama rm förenklar modellens livscykel.

Utvecklarupplevelse: Ren API, omfattande dokumentation och växande ekosystem av integreringar (LangChain, CrewAI, osv.). Ollamas flexibilitet sträcker sig till specialiserade användningsfall som återranka textdokument med inbäddningsmodeller.

Resurseffektivitet: Automatisk minnehantering och modellavlastning när den är inaktiv sparar systemresurser.

Nackdelar med Ollama

Ramverkslås: Huvudsakligen stöder modeller som är kompatibla med llama.cpp, vilket begränsar flexibiliteten för ramverk som vLLM eller egna inferensmotorer.

Begränsad anpassning: Avancerade konfigurationer (anpassad kvantisering, specifika CUDA-strömmar) är mindre tillgängliga än i Docker-miljöer.

Orchestration-problem: Även om Ollama kan köras i kontainer, saknar den inbyggd stöd för avancerade orchestration-funktioner som horisontell skalning.

Prestandajämförelse

Inferenshastighet

Docker Model Runner: Prestanda jämförbar med Ollama eftersom båda stöder GGUF-kvantiserade modeller. För Llama 2 7B (Q4), förväntas 20-30 tokens/sekund på CPU och 50-80 tokens/sekund på mellanliggande GPU:er. Minimal containeröverhuvud.

Ollama: Utvärderas av den högt optimerade llama.cpp-bakgrunden med effektiv kvantisering. För Llama 2 7B (Q4), förväntas 20-30 tokens/sekund på CPU och 50-80 tokens/sekund på mellanliggande GPU:er. Inga containeriseringsoverhuvud. För detaljer om hur Ollama hanterar parallella förfrågningar, se vår analys om hur Ollama hanterar parallella förfrågningar.

Docker (vLLM): Optimerad för batchbearbetning med kontinuerlig batchbearbetning. Enkla förfrågningar kan vara något långsammare, men genomströmmningen är utmärkt vid hög parallell last (100+ tokens/sekund per modell med batchbearbetning).

Docker (TGI): Liknande vLLM med utmärkt batchbearbetning. Lägger till funktioner som strömning och token-igenomgenerering.

Minnesanvändning

Docker Model Runner: Liknande Ollama med automatisk modellladdning. GGUF Q4-modeller använder vanligtvis 4-6 GB minne. Containeröverhuvud är minimalt (tio MB).

Konfigurering av kontextstorlek kan påverka minnesanvändning och modellbeteende betydligt. Standardmått för vissa Docker Model Runner CUDA-bilder är hårdkodade till 4096 token, även om högre värden anges i docker-compose. För detaljerade steg för att åsidosätta detta beteende och förpacka modeller med anpassad kontextstorlek, se vår guide om konfigurera kontextstorlek i Docker Model Runner.

Ollama: Automatisk minnehantering laddar modeller på efterfrågan och avlastar när den är inaktiv. En 7B Q4-modell använder vanligtvis 4-6 GB minne. mest effektiv för enskilda modellscenarier.

Traditionella Docker-lösningar: Minnesanvändning beror på ramverket. vLLM förbereder GPU-minne för optimal prestanda, medan PyTorch-baserade kontainer kan använda mer minne för modellvikt och KV-cache (8-14 GB för 7B-modeller).

Starttid

Docker Model Runner: Containerstart lägger till ~1 sekund, plus modellladdning (2-5 sekunder). Total: 3-6 sekunder för medelstora modeller.

Ollama: Nästan omedelbar start med modellladdning som tar 2-5 sekunder för medelstora modeller. Snabbast kallstartupplevelse.

Traditionella Docker: Containerstart lägger till 1-3 sekunder, plus modellladdningstid. Förvärmning av kontroller minskar detta i produktionsdistributioner.

Rekommendationer för användningsfall

Välj Docker Model Runner när

- Docker-först arbetsflöde: Din grupp använder redan Docker intensivt

- Enheter för verktyg: Du vill ha ett verktyg (Docker) för kontroller och modeller

- OCI-artefaktfördelning: Du behöver företagsregisterversionering

- Testcontainers-integrering: Du testar AI-funktioner i CI/CD

- Docker Hub-föredragen: Du vill distribuera modeller genom bekanta kanaler

Välj Ollama när

- Snabb prototypning: Snabb experimentering med olika modeller

- Ramverksneutralt: Inte bunden till Docker-ekosystemet

- Absolut enkelhet: Minimal konfiguration och underhållsöverhuvud

- Enkelserverdistributioner: Kör på datorer, arbetsstationer eller enskilda VM:er

- Stor modellbibliotek: Tillgång till omfattande förkonfigurerat modellregistret

Välj tredjeparts Docker-lösningar när

- Produktionsdistributioner: Behov av avancerad orchestration och övervakning

- Multi-modellservering: Kör olika ramverk (vLLM, TGI) samtidigt

- Kubernetes orchestration: Skalning över kluster med lastbalansering

- Anpassade ramverk: Använd Ray Serve eller egna inferensmotorer

- Strikt resurshantering: Tvinga detaljerade CPU/GPU-limiter per modell

Hybridmetoder: Bästa av båda världarna

Du är inte begränsad till en enda metod. Overväg dessa hybridstrategier:

Alternativ 1: Docker Model Runner + Traditionella kontroller

Använd DMR för standardmodeller och tredjepartskontroller för specialiserade ramverk:

# Hämta en standardmodell med DMR

docker model pull ai/llama2

# Kör vLLM för höggenomströmningsscenarier

docker run --gpus all vllm/vllm-openai

Alternativ 2: Ollama i Docker

Kör Ollama inuti Docker-kontroller för orchestration-förmåga:

docker run -d \

--name ollama \

--gpus all \

-v ollama:/root/.ollama \

-p 11434:11434 \

ollama/ollama

Detta ger:

- Ollamas intuitiva modellhantering

- Docks orchestration och isoleringsförmåga

- Kubernetesdistribution med standardmanifest

Alternativ 3: Mix och match efter användningsfall

- Utveckling: Ollama för snabb iteration

- Staging: Docker Model Runner för integrationsprov

- Produktion: vLLM/TGI i Kubernetes för skalning

API-kompatibilitet

Alla moderna lösningar konvergerar till OpenAI-kompatibla API:er, vilket förenklar integrationen:

Docker Model Runner API: OpenAI-kompatibla slutpunkter som serveras automatiskt när modeller köras. Inga ytterligare konfigurationsåtgärder krävs.

# Modell körs med API som exponeras automatiskt

docker model run ai/llama2

# Använd OpenAI-kompatibel slutpunkt

curl http://localhost:8080/v1/chat/completions -d '{

"model": "llama2",

"messages": [{"role": "user", "content": "Varför är himlen blå?"}]

}'

Ollama API: OpenAI-kompatibla slutpunkter gör det till en direkt ersättning för appar som använder OpenAI SDK. Strömning stöds fullt ut.

curl http://localhost:11434/api/generate -d '{

"model": "llama2",

"prompt": "Varför är himlen blå?"

}'

Tredjeparts Docker-API:er: vLLM och TGI erbjuder OpenAI-kompatibla slutpunkter, medan anpassade kontroller kan implementera egna API:er.

Konvergensen till OpenAI-kompatibilitet innebär att du kan byta mellan lösningar med minimal kodändring.

Resurshantering

GPU-accelerering

Docker Model Runner: Inbyggd GPU-stöd utan komplex nvidia-docker-konfiguration. Detektion och användning av tillgängliga GPU:er sker automatiskt, vilket betydligt förenklar Docker GPU-upplevelsen jämfört med traditionella kontroller.

Om du använder NVIDIA GPU:er och vill konfigurera CUDA-accelerering korrekt, se vår detaljerade guide om att lägga till NVIDIA GPU-stöd i Docker Model Runner. Den täcker Docker-daemonkonfiguration, NVIDIA Container Toolkit-inställning och hur du verifierar att din LLM faktiskt använder GPU-minne istället för att falla tillbaka till CPU-inferens.

# GPU-accelerering fungerar automatiskt

docker model run ai/llama2

Ollama: Automatisk GPU-detektering på CUDA-kompatibla NVIDIA GPU:er. Inga konfigurationsåtgärder krävs utöver driverinstallation.

Traditionella Docker-kontroller: Kräver nvidia-docker runtime och explicit GPU-allocering:

docker run --gpus all my-llm-container

CPU-fallback

Båda faller naturligt tillbaka till CPU-inferens när GPU:er inte är tillgängliga, även om prestandan minskar betydligt (5-10 gånger långsammare för stora modeller). För insikter i CPU-endast prestanda på moderna processorer, läs vår test om hur Ollama använder Intel CPU-prestanda och effektiva kärnor.

Multi-GPU-stöd

Ollama: Stöder tensorparallellitet över flera GPU:er för stora modeller.

Docker: Beroende av ramverket. vLLM och TGI stöder multi-GPU-inferens med korrekt konfiguration.

Community och ekosystem

Docker Model Runner: Lanserades april 2025 med starkt företagsstöd. Samarbete med Google, Hugging Face och VMware Tanzu AI Solutions säkerställer bred tillgänglighet för AI-modeller. Integration med Docks stora utvecklarkommunitet (miljoner användare) ger omedelbar tillgång till ekosystem. Bygger fortfarande communityspecifika resurser som en ny produkt.

Ollama: Snabbt växande community med över 50K GitHub-stjärnor. Stark integrationsekosystem (LangChain, LiteLLM, Open WebUI, CrewAI) och aktiv Discord-kommunitet. Omfattande tredjepartsverktyg och tutorier tillgängliga. Mer mognad i dokumentation och communityresurser. För en omfattande översikt över tillgängliga gränssnitt, se vår guide till öppen källkod chat UI för lokala Ollama-instanser. Som med alla snabbt växande öppna källkodsprojekt är det viktigt att övervaka projektets riktning - läs vår analys av tidiga tecken på Ollama-enshittification för att förstå potentiella bekymmer.

Tredjeparts Docker-lösningar: vLLM och TGI har mognade ekosystem med företagsstöd. Omfattande produktionsfallstudier, optimeringsguider och distributionsmönster från Hugging Face och communitybidragare.

Kostnadskonsekvenser

Docker Model Runner: Gratis med Docker Desktop (personlig/utbildning) eller Docker Engine. Docker Desktop kräver prenumeration för större organisationer (250+ anställda eller $10M+ intäkter). Modeller distribueras via Docker Hub följer Docks registervärden (gratis publika repo, betalda privata repo).

Ollama: Komplett gratis och öppen källkod utan licenskostnader oavsett organisationens storlek. Resurskostnader beror endast på hårdvara.

Tredjeparts Docker-lösningar: Gratis för öppen källkodsramverk (vLLM, TGI). Potentiella kostnader för containerorchestrationplattformar (ECS, GKE) och privat registervärden.

Säkerhetsaspekter

Docker Model Runner: Utgår från Docks säkerhetsmodell med kontrollisolering. Modeller förpackade som OCI-artefakter kan skannas och signeras. Distribution via Docker Hub möjliggör åtkomstkontroll och skadanalys för företagsanvändare.

Ollama: Kör som en lokal tjänst med API exponerad på localhost som standard. Nätverksåtkomst kräver explicit konfiguration. Modellregistret är tillitvärt (Ollama-kuraterat), vilket minskar leverantörsrisker.

Traditionella Docker-lösningar: Nätverksisolering är inbyggd. Kontrollskanning (Snyk, Trivy) och bildsignering är standardpraxis i produktionsmiljöer.

Alla lösningar kräver uppmärksamhet till:

- Modellproveniens: Otillitliga modeller kan innehålla skadlig kod eller bakdörrar

- API-autentisering: Implementera autentisering/auktorisering i produktionsdistributioner

- Hastighetsbegränsning: Förhindra missbruk och resursutmattning

- Nätverksåtkomst: Se till att API:er inte oavsiktligt exponeras till internet

- Dataskydd: Modeller behandlar känslig data; se till att följa dataskyddsregler

Migreringsvägar

Från Ollama till Docker Model Runner

Docker Model Runners stöd för GGUF gör migrationen enkel:

- Aktivera Docker Model Runner i Docker Desktop eller installera

docker-model-plugin - Konvertera modellreferenser:

ollama run llama2→docker model pull ai/llama2ochdocker model run ai/llama2 - Uppdatera API-slutpunkter från

localhost:11434till DMR-slutpunkt (oftalocalhost:8080) - Båda använder OpenAI-kompatibla API:er, så applikationskod kräver minimala förändringar

Från Docker Model Runner till Ollama

Flytta till Ollama för enklare oberoende drift:

- Installera Ollama:

curl -fsSL https://ollama.ai/install.sh | sh. För en fullständig lista över Ollama CLI-kommandon och konfigurationsalternativ, hänvisa till Ollama CLI cheat sheet. - Hämta motsvarande modeller:

ollama pull llama2 - Uppdatera API-slutpunkter till Ollamas

localhost:11434 - Testa med

ollama run llama2för att bekräfta funktionen

Från traditionella Docker-kontroller till DMR

Förenkla din Docker-LLM-konfiguration:

- Aktivera Docker Model Runner

- Ersätt anpassade Dockerfiles med

docker model pull-kommandon - Ta bort nvidia-docker-konfiguration (DMR hanterar GPU automatiskt)

- Använd

docker model runistället för komplexadocker run-kommandon

Från någon lösning till Ollama i Docker

Bästa av båda världarna:

docker pull ollama/ollama- Kör:

docker run -d --gpus all -v ollama:/root/.ollama -p 11434:11434 ollama/ollama - Använd Ollama-kommandon som vanligt:

docker exec -it ollama ollama pull llama2 - Få Docker-orchestration med Ollamas enkelhet

Övervakning och insikter

Ollama: Grundläggande mått via API (/api/tags, /api/ps). Tredjepartsverktyg som Open WebUI ger dashboards.

Docker: Full integration med Prometheus, Grafana, ELK stack, och molnövervakningstjänster. Kontrollmått (CPU, minne, GPU) är tillgängliga direkt.

Slutsats

Landskapet för lokal LLM-distribution har utvecklats betydligt med Docks introduktion av Docker Model Runner (DMR) 2025. Väljningen beror nu på dina specifika krav:

- För utvecklare som söker Docker-integrering: DMR ger inbyggd Docker-arbetsflödesintegration med

docker model-kommandon - För maximal enkelhet: Ollama är fortfarande den enklaste lösningen med sin enkommandomodellhantering

- För produktion och företag: Både DMR och tredjepartslösningar (vLLM, TGI) i Docker erbjuder orchestration, övervakning och skalbarhet

- För bästa av båda: Kör Ollama i Docker-kontroller för att kombinera enkelhet med produktionsinfrastruktur

Introduktionen av DMR minskar sprickan mellan Docker och Ollama i fråga om användarvänlighet. Ollama vinner fortfarande på enkelhet för snabb prototypning, medan DMR är bäst för grupper som redan är investerade i Docker-arbetsflöden. Båda metoder utvecklas aktivt, är produktionsklara och ekosystemet är mognat tillräckligt för att byta mellan dem är relativt smärtfritt.

Sammanfattning: Om du redan använder Docker intensivt, är DMR den naturliga valet. Om du vill ha den absolut enklare upplevelse oavsett infrastruktur, välj Ollama. För att jämföra dessa lokala alternativ med molntjänster och andra självvärddade inställningar, se vår LLM Hosting: Lokalt, självvärddat & Molninfrastruktur jämförd guide.

Nyttafulla länkar

Docker Model Runner

- Docker Model Runner Officiell Sida

- Docker Model Runner Dokumentation

- Docker Model Runner Startguide

- Docker Model Runner Bloggpost