도커 모델 러너 vs 올라마(2026): 로컬 LLM에 더 적합한 것은?

로컬 LLM용 Docker Model Runner와 Ollama 비교

로컬에서 대규모 언어 모델(LLM) 실행 는 프라이버시, 비용 관리 및 오프라인 기능을 위해 점점 더 인기를 끌고 있습니다. 2025년 4월에 Docker가 Docker Model Runner (DMR), AI 모델 배포를 위한 공식 솔루션을 도입하면서 상황은 크게 변화했습니다.

이제 개발자들의 관심을 끌고 있는 세 가지 접근법이 경쟁하고 있습니다: Docker의 네이티브 Model Runner, 제3자 컨테이너화 솔루션(vLLM, TGI), 그리고 독립형 Ollama 플랫폼입니다.

클라우드 제공업체 및 인프라 트레이드오프를 포함한 더 넓은 시각을 원하시면 LLM 호스팅: 로컬, 자체 호스팅 및 클라우드 인프라 비교를 참조하세요.

TL;DR – Docker Model Runner vs Ollama

이 비교는 Docker 또는 독립형 런타임을 사용하여 대규모 언어 모델(LLM)을 로컬에서 실행하는 데 초점을 맞추며, 성능, GPU 지원, API 호환성 및 프로덕션 배포 시나리오를 다룹니다.

- Docker 네이티브 워크플로우에 최적: Docker Model Runner

- 간단함과 빠른 프로토타이핑에 최적: Ollama

- Kubernetes 및 오케스트레이션에 최적: Docker 기반 설정

- 단일 머신 개발에 최적: Ollama

이미 Docker를 광범위하게 사용하고 있다면 DMR이 적합합니다.

로컬에서 LLM을 실행하는 가장 빠른 방법을 원한다면 Ollama가 더 간단합니다.

Docker Model Runner와 Ollama보다 더 많은 것을 비교하고 싶다면, 우리의 완전한 분석인 Ollama vs vLLM vs LM Studio 및 기타 로컬 LLM 도구를 참조하세요. 이 가이드는 12개 이상의 로컬 LLM 런타임에서 API 성숙도, 하드웨어 지원, 도구 호출 및 프로덕션 준비 상태를 비교합니다.

Docker Model Runner vs Ollama: 직접 비교

Docker가 LLM 런너 공간에 공식적으로 진입하면서 비교는 더 흥미진진해졌습니다. DMR과 Ollama가 어떻게 대등하게 비교되는지 아래에 보여줍니다:

| 기능 | Docker Model Runner | Ollama |

|---|---|---|

| 설치 | Docker Desktop AI 탭 또는 docker-model-plugin |

단일 명령: curl | sh |

| 명령 스타일 | docker model pull/run/package |

ollama pull/run/list |

| 모델 형식 | GGUF (OCI 아티팩트) | GGUF (내장) |

| 모델 분배 | Docker Hub, OCI 레지스트리 | Ollama 레지스트리 |

| GPU 설정 | 자동 (전통적인 Docker보다 간단) | 자동 |

| API | OpenAI 호환 | OpenAI 호환 |

| Docker 통합 | 네이티브 (Docker 자체) | 필요 시 Docker에서 실행 가능 |

| Compose 지원 | 네이티브 | Docker 이미지를 통해 |

| 학습 곡선 | Docker 사용자에게 낮음 | 모두에게 가장 낮음 |

| 생태계 파트너 | Google, Hugging Face, VMware | LangChain, CrewAI, Open WebUI |

| 최적 사용 시나리오 | Docker 네이티브 워크플로우 | 독립형 간단함 |

핵심 통찰: DMR은 LLM 배포에 Docker 워크플로우를 가져오고, Ollama는 기술적 차이보다 기존 인프라가 더 중요하다는 점에서 프레임워크에 무관하게 간단한 독립형 운영을 제공합니다.

Docker Model Runner이 Ollama보다 더 나은가요?

그것은 당신의 워크플로우에 달려 있습니다.

- Docker Model Runner (DMR)를 선택하세요 만약 팀이 이미 Docker, OCI 아티팩트 및 컨테이너 오케스트레이션에 크게 의존하고 있다면.

- Ollama를 선택하세요 만약 LLM을 로컬에서 최소한의 설정과 빠른 프로토타이핑으로 실행하고 싶다면.

대부분의 단일 머신 설정에서는 Ollama가 사용하기 더 쉬우며, Docker 네이티브 CI/CD 파이프라인 및 기업 컨테이너 워크플로우에서는 DMR이 더 자연스럽게 통합됩니다.

LLM을 Docker에서 실행하는 방법: DMR vs Ollama

목표가 단순히 Docker 내에서 LLM을 실행하는 것이라면, Docker Model Runner와 Docker 컨테이너 내에서 실행되는 Ollama 모두 이 목표를 달성할 수 있습니다.

Docker Model Runner는 네이티브 docker model pull 및 docker model run 명령을 사용하여 모델을 OCI 아티팩트로 패키징합니다.

Ollama는 공식 ollama/ollama 컨테이너 이미지를 사용하여 Docker 내에서 실행될 수 있으며, 11434 포트에서 OpenAI 호환 API를 노출합니다.

핵심 차이점은 워크플로우 통합에 있습니다:

- DMR은 Docker 네이티브 CI/CD 파이프라인에 자연스럽게 적합합니다.

- Docker 내 Ollama는 Docker 오케스트레이션 유연성과 함께 간단한 모델 관리를 제공합니다.

Docker Model Runner 이해하기

Docker 기반 모델 런너는 컨테이너화를 통해 LLM 추론 엔진과 그 의존성을 함께 패키징합니다. 이 풍경에는 Docker 공식 솔루션과 제3자 프레임워크가 모두 포함됩니다.

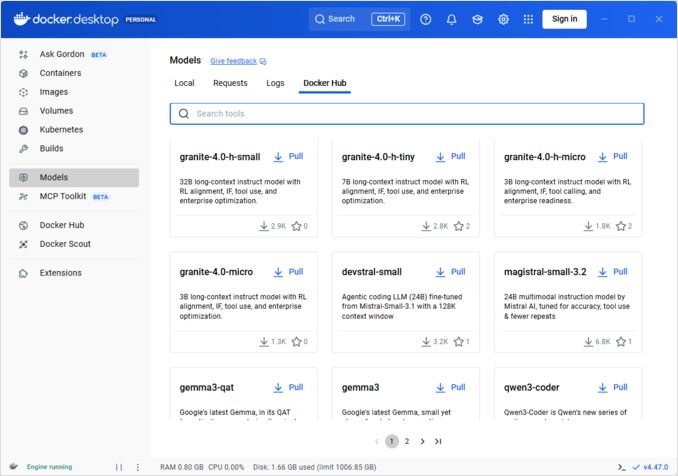

Docker Model Runner (DMR) - 공식 솔루션

2025년 4월에 Docker는 Docker Model Runner (DMR), Docker 인프라를 사용하여 로컬에서 AI 모델을 실행하는 것을 간소화하기 위한 공식 제품을 도입했습니다. 이는 Docker가 AI 모델 배포를 컨테이너 배포만큼 편리하게 만들려는 의지를 보여줍니다.

DMR의 주요 기능:

- 네이티브 Docker 통합: 익숙한 Docker 명령(

docker model pull,docker model run,docker model package)을 사용합니다. - OCI 아티팩트 패키징: 모델은 OCI 아티팩트로 패키징되어 Docker Hub 및 기타 레지스트리에서 배포할 수 있습니다.

- OpenAI 호환 API: OpenAI 엔드포인트의 즉시 사용 가능한 대체품으로, 통합을 간소화합니다.

- GPU 가속: 복잡한 nvidia-docker 구성 없이 네이티브 GPU 지원.

- GGUF 형식 지원: 인기 있는 양자화 모델 형식과 호환됩니다.

- Docker Compose 통합: 표준 Docker 도구를 사용하여 모델을 쉽게 구성하고 배포할 수 있습니다.

- Testcontainers 지원: 테스트 프레임워크와 원활하게 통합됩니다.

설치:

- Docker Desktop: 설정의 AI 탭을 통해 활성화

- Docker Engine:

docker-model-plugin패키지 설치

사용 예시:

# Docker Hub에서 모델을 끌어옵니다

docker model pull ai/smollm2

# 추론을 실행합니다

docker model run ai/smollm2 "Docker Model Runner를 설명해주세요"

# 사용자 정의 모델을 패키징합니다

docker model package --gguf /path/to/model.gguf --push myorg/mymodel:latest

docker model 명령, 패키징 옵션, 구성 플래그 및 실용적인 예시에 대한 전체 참조는 우리의 자세한 Docker Model Runner 체크리스트: 명령 및 예제를 참조하세요. 이 가이드는 모델 끌어오기, 패키징, 구성, Docker를 사용하여 로컬에서 LLM을 배포하는 최고의 실천 사례를 다룹니다.

DMR은 Google, Hugging Face 및 VMware Tanzu와 협력하여 Docker Hub를 통해 사용 가능한 AI 모델 생태계를 확장하고 있습니다. Docker에 새로 시작하거나 Docker 명령에 대한 리프레시가 필요하다면, 우리의 Docker 체크리스트가 필수적인 Docker 운영에 대한 종합 가이드를 제공합니다.

제3자 Docker 솔루션

DMR 이외에도 다음과 같은 확립된 프레임워크가 포함됩니다:

- vLLM 컨테이너: 배치 처리에 최적화된 고성능 추론 서버

- Text Generation Inference (TGI): Hugging Face의 프로덕션 준비 솔루션

- llama.cpp 컨테이너: 양자화가 가능한 경량 C++ 구현

- 사용자 정의 컨테이너: PyTorch, Transformers 또는 전용 프레임워크를 감싸는 컨테이너

Docker 접근 방식의 장점

유연성 및 프레임워크 무관성: Docker 컨테이너는 PyTorch에서 ONNX Runtime에 이르기까지 모든 LLM 프레임워크를 실행할 수 있어 개발자가 추론 스택에 대한 완전한 제어권을 제공합니다.

자원 격리: 각 컨테이너는 정의된 자원 제한(CPU, 메모리, GPU)을 가진 격리된 환경에서 작동하여 다중 모델 배포 시 자원 충돌을 방지합니다.

오케스트레이션 지원: Docker는 Kubernetes, Docker Swarm 및 클라우드 플랫폼과의 통합을 통해 확장, 로드 밸런싱, 고가용성을 제공합니다.

버전 관리: 동일한 시스템에서 다른 모델 버전 또는 프레임워크가 의존성 충돌 없이 공존할 수 있습니다.

Docker 접근 방식의 단점

복잡성: 컨테이너화, 볼륨 마운트, 네트워크 구성 및 GPU 전달(nvidia-docker)에 대한 이해가 필요합니다.

부하: 최소한의 부하가 있지만, Docker는 시작 시간과 자원 사용에 약간의 영향을 미칩니다.

구성 부담: 각 배포는 Dockerfile, 환경 변수 및 런타임 매개변수의 신중한 구성이 필요합니다.

Ollama 이해하기

Ollama는 LLM을 로컬에서 실행하기 위한 목적에 맞춘 애플리케이션으로, 간단함을 핵심 원칙으로 삼고 있습니다. 제공하는 기능은 다음과 같습니다:

- Linux, macOS 및 Windows용 네이티브 바이너리

- 한 명령어로 설치되는 내장 모델 라이브러리

- 자동 GPU 감지 및 최적화

- OpenAI 형식과 호환되는 RESTful API

- 모델 컨텍스트 및 상태 관리

Ollama의 장점

간단함: 설치는 간단합니다(curl | sh on Linux), 모델 실행은 ollama run llama2만으로 가능합니다. Ollama CLI 명령어(ollama serve, ollama run, ollama ps) 및 모델 관리 워크플로우에 대한 완전한 참조는 우리의 Ollama CLI 체크리스트를 참조하세요.

최적화된 성능: llama.cpp 기반으로 구축되어 양자화(Q4, Q5, Q8) 지원으로 추론 속도가 빠릅니다.

모델 관리: ollama pull, ollama list, ollama rm과 같은 명령어를 통해 내장 모델 레지스트리가 제공되어 모델 생명주기를 간단하게 합니다.

개발자 경험: 깔끔한 API, 광범위한 문서, 그리고 LangChain, CrewAI 등과 같은 성장하는 통합 생태계를 제공합니다. Ollama의 유연성은 임베딩 모델을 사용한 텍스트 문서 재정렬과 같은 특화된 사용 사례로도 확장됩니다.

자원 효율성: 자동 메모리 관리 및 모델이 유휴 상태일 때 언로딩하여 시스템 자원을 절약합니다.

Ollama의 단점

프레임워크 고착화: 주로 llama.cpp 호환 모델을 지원하여 vLLM이나 사용자 정의 추론 엔진과 같은 프레임워크의 유연성을 제한합니다.

제한된 맞춤화: Docker 환경보다는 고급 구성(사용자 정의 양자화, 특정 CUDA 스트림)이 덜 접근 가능합니다.

오케스트레이션 문제: Ollama는 컨테이너에서 실행할 수 있지만, 수평 확장과 같은 고급 오케스트레이션 기능에 대한 네이티브 지원이 없습니다.

성능 비교

추론 속도

Docker Model Runner: Ollama와 마찬가지로 GGUF 양자화 모델을 지원하므로 성능이 유사합니다. Llama 2 7B (Q4)의 경우 CPU에서 20-30 토큰/초, 중간급 GPU에서 50-80 토큰/초 예상됩니다. 컨테이너 오버헤드는 최소입니다.

Ollama: 매우 최적화된 llama.cpp 백엔드를 사용하여 효율적인 양자화를 제공합니다. Llama 2 7B (Q4)의 경우 CPU에서 20-30 토큰/초, 중간급 GPU에서 50-80 토큰/초 예상됩니다. 컨테이너화 오버헤드가 없습니다. Ollama가 병렬 요청을 어떻게 처리하는지에 대한 자세한 내용은 우리의 분석인 Ollama가 병렬 요청을 어떻게 처리하는가를 참조하세요.

Docker (vLLM): 배치 처리에 최적화되어 있으며, 지속적인 배치 처리를 지원합니다. 단일 요청은 약간 느릴 수 있지만, 고 동시성 부하(100+ 토큰/초/모델)에서는 처리량이 우수합니다.

Docker (TGI): vLLM과 유사하며, 배치 처리 성능이 우수합니다. 스트리밍 및 토큰별 생성 기능을 추가합니다.

메모리 사용량

Docker Model Runner: Ollama와 유사한 자동 모델 로딩을 제공합니다. GGUF Q4 모델은 일반적으로 4-6GB RAM을 사용합니다. 컨테이너 오버헤드는 최소입니다(십만 단위의 MB).

컨텍스트 크기 설정은 메모리 사용량 및 모델 행동에 큰 영향을 줄 수 있습니다. 일부 Docker Model Runner CUDA 이미지는 docker-compose에서 지정된 값이 더 높더라도 기본적으로 4096 토큰 제한을 강제로 적용합니다. 커스터마이징된 컨텍스트 크기로 모델을 패키징하는 방법에 대한 자세한 단계는 우리의 Docker Model Runner에서 컨텍스트 크기를 설정하는 방법을 참조하세요.

Ollama: 자동 메모리 관리가 모델을 필요 시 로딩하고, 유휴 상태일 때 언로딩합니다. 7B Q4 모델은 일반적으로 4-6GB RAM을 사용합니다. 단일 모델 시나리오에서 가장 효율적입니다.

전통적인 Docker 솔루션: 메모리는 프레임워크에 따라 달라집니다. vLLM은 최적의 성능을 위해 GPU 메모리를 사전 할당하고, PyTorch 기반 컨테이너는 모델 가중치 및 KV 캐시(7B 모델의 경우 8-14GB)에 더 많은 RAM을 사용할 수 있습니다.

시작 시간

Docker Model Runner: 컨테이너 시작은 약 1초이며, 모델 로딩은 2-5초입니다. 중간 모델의 경우 총 3-6초입니다.

Ollama: 모델 로딩은 중간 크기 모델의 경우 2-5초이며, 거의 즉시 시작됩니다. 가장 빠른 냉시작 경험입니다.

전통적인 Docker: 컨테이너 시작은 1-3초이며, 모델 로딩 시간이 필요합니다. 생산 배포에서는 컨테이너를 사전에 따뜻하게 해서 이 문제를 완화할 수 있습니다.

사용 사례 추천

Docker Model Runner를 선택할 때

- Docker 중심 워크플로우: 팀이 이미 Docker를 광범위하게 사용하고 있다면

- 통합 도구: 컨테이너와 모델을 위한 단일 도구(Docker)를 원한다면

- OCI 아티팩트 분배: 기업 레지스트리 통합이 필요하다면

- Testcontainers 통합: CI/CD에서 AI 기능을 테스트하고 있다면

- Docker Hub 선호: 익숙한 채널을 통해 모델 분배를 원한다면

Ollama를 선택할 때

- 빠른 프로토타이핑: 다양한 모델을 사용하여 빠른 실험을 원한다면

- 프레임워크 무관: Docker 생태계에 묶이지 않기를 원한다면

- 절대적인 간단함: 최소한의 구성 및 유지 관리 부담을 원한다면

- 단일 서버 배포: 데스크탑, 워크스테이션 또는 단일 VM에서 실행할 경우

- 대규모 모델 라이브러리: 광범위한 사전 구성된 모델 레지스트리에 접근하고 싶다면

제3자 Docker 솔루션을 선택할 때

- 프로덕션 배포: 고급 오케스트레이션 및 모니터링이 필요하다면

- 다중 모델 서빙: vLLM, TGI 등 다양한 프레임워크를 동시에 실행하고 싶다면

- Kubernetes 오케스트레이션: 클러스터 간 확장 및 로드 밸런싱이 필요하다면

- 커스텀 프레임워크: Ray Serve 또는 전용 추론 엔진을 사용하고 싶다면

- 엄격한 자원 제어: 모델별로 세분화된 CPU/GPU 제한을 강제하고 싶다면

하이브리드 접근: 최고의 두 가지 방법

단일 접근법에 제한되지 않으며, 다음의 하이브리드 전략을 고려할 수 있습니다:

선택 1: Docker Model Runner + 전통적인 컨테이너

표준 모델에 DMR을 사용하고, 특화 프레임워크에 제3자 컨테이너를 사용합니다:

# DMR을 사용하여 표준 모델을 끌어옵니다

docker model pull ai/llama2

# 고성능 시나리오에 vLLM을 실행합니다

docker run --gpus all vllm/vllm-openai

선택 2: Docker 내 Ollama

Docker 컨테이너 내에서 Ollama를 실행하여 오케스트레이션 기능을 제공합니다:

docker run -d \

--name ollama \

--gpus all \

-v ollama:/root/.ollama \

-p 11434:11434 \

ollama/ollama

이 방법은 다음과 같은 장점을 제공합니다:

- Ollama의 직관적인 모델 관리

- Docker의 오케스트레이션 및 격리 기능

- 표준 매니페스트를 사용한 Kubernetes 배포

선택 3: 사용 사례에 따라 혼합 사용

- 개발: Ollama를 사용하여 빠른 반복

- 스테이징: Docker Model Runner를 사용하여 통합 테스트

- 프로덕션: Kubernetes에서 vLLM/TGI를 사용하여 확장

API 호환성

모든 현대 솔루션은 OpenAI 호환 API로 수렴하여 통합을 간소화합니다:

Docker Model Runner API: 모델을 실행할 때 자동으로 OpenAI 호환 엔드포인트가 제공됩니다. 추가 구성이 필요 없습니다.

# 모델 실행 시 API가 자동으로 노출됩니다

docker model run ai/llama2

# OpenAI 호환 엔드포인트 사용

curl http://localhost:8080/v1/chat/completions -d '{

"model": "llama2",

"messages": [{"role": "user", "content": "하늘은 왜 파란가요?"}]

}'

Ollama API: OpenAI SDK를 사용하는 애플리케이션에 즉시 대체 가능한 OpenAI 호환 엔드포인트를 제공합니다. 스트리밍도 완전히 지원됩니다.

curl http://localhost:11434/api/generate -d '{

"model": "llama2",

"prompt": "하늘은 왜 파란가요?"

}'

제3자 Docker API: vLLM 및 TGI는 OpenAI 호환 엔드포인트를 제공하며, 사용자 정의 컨테이너는 전용 API를 구현할 수 있습니다.

OpenAI 호환성 수렴은 솔루션 간 전환 시 최소한의 코드 변경으로 가능하게 합니다.

자원 관리

GPU 가속

Docker Model Runner: 복잡한 nvidia-docker 구성 없이 네이티브 GPU 지원. 자동으로 사용 가능한 GPU를 감지하고 사용하여, 전통적인 컨테이너보다 Docker GPU 경험을 크게 단순화합니다.

NVIDIA GPU를 사용하고 CUDA 가속을 올바르게 구성하려면, 우리의 Docker Model Runner에 NVIDIA GPU 지원 추가 가이드를 참조하세요. 이 가이드는 Docker 데몬 구성, NVIDIA Container Toolkit 설정 및 LLM이 실제로 GPU 메모리를 사용하는지 확인하는 방법을 다룹니다.

# GPU 가속은 자동으로 작동합니다

docker model run ai/llama2

Ollama: CUDA 호환 NVIDIA GPU에서 자동 GPU 감지. 드라이버 설치 이외의 구성이 필요 없습니다.

전통적인 Docker 컨테이너: nvidia-docker 런타임과 명시적인 GPU 할당이 필요합니다:

docker run --gpus all my-llm-container

CPU 대체

둘 다 GPU가 없을 경우 CPU 추론으로 자연스럽게 전환되지만, 성능이 크게 감소합니다(대규모 모델의 경우 5-10배 느림). 현대 프로세서에서 CPU만 사용하는 성능에 대한 통찰은 우리의 테스트인 Ollama가 인텔 CPU 성능과 효율 코어를 어떻게 사용하는가를 참조하세요.

다중 GPU 지원

Ollama: 대규모 모델을 위한 여러 GPU 간의 텐서 병렬 처리를 지원합니다.

Docker: 프레임워크에 따라 다릅니다. vLLM 및 TGI는 적절한 구성으로 다중 GPU 추론을 지원합니다.

커뮤니티 및 생태계

Docker Model Runner: 2025년 4월에 출시되어 강력한 기업 지원을 받고 있습니다. Google, Hugging Face, VMware Tanzu AI 솔루션과의 협업으로 Docker Hub를 통해 넓은 모델 접근성을 제공합니다. Docker의 엄청난 개발자 커뮤니티(수백만 명의 사용자)와의 통합으로 즉시 생태계 접근이 가능합니다. 아직 제품으로서의 커뮤니티 특정 자원은 계속해서 구축되고 있습니다.

Ollama: 빠르게 성장하는 커뮤니티로 GitHub 스타 5만 개 이상을 기록하고 있습니다. 강력한 통합 생태계(LangChain, LiteLLM, Open WebUI, CrewAI)와 활발한 Discord 커뮤니티를 제공합니다. 광범위한 제3자 도구와 튜토리얼이 제공됩니다. 더 성숙한 문서 및 커뮤니티 자원이 있습니다. 사용 가능한 인터페이스에 대한 종합적인 개요는 우리의 로컬 Ollama 인스턴스용 오픈소스 채팅 UI 가이드를 참조하세요. 어떤 빠르게 성장하는 오픈소스 프로젝트라도 프로젝트의 방향을 모니터링하는 것이 중요합니다 - 우리의 Ollama Enshittification의 초기 징후 분석을 참조하세요.

제3자 Docker 솔루션: vLLM 및 TGI는 성숙한 생태계와 기업 지원을 제공합니다. Hugging Face 및 커뮤니티 기여자로부터의 광범위한 프로덕션 사례 연구, 최적화 가이드 및 배포 패턴이 있습니다.

비용 고려사항

Docker Model Runner: Docker Desktop(개인/교육용) 또는 Docker Engine이 무료입니다. Docker Desktop은 더 큰 조직(250명 이상의 직원 또는 1,000만 달러 이상의 수익)에 대해 구독이 필요합니다. Docker Hub를 통해 배포되는 모델은 Docker의 레지스트리 가격 정책에 따라 무료 공개 저장소, 유료 사설 저장소로 구분됩니다.

Ollama: 완전히 무료이며, 조직의 규모에 관계없이 라이선스 비용이 없습니다. 자원 비용은 단지 하드웨어에 의존합니다.

제3자 Docker 솔루션: 오픈소스 프레임워크(vLLM, TGI)는 무료입니다. 컨테이너 오케스트레이션 플랫폼(ECS, GKE) 및 사설 레지스트리 저장소에 대한 잠재적 비용이 있을 수 있습니다.

보안 고려사항

Docker Model Runner: Docker의 보안 모델을 활용하여 컨테이너 격리. OCI 아티팩트로 패키징된 모델은 스캔 및 서명이 가능합니다. Docker Hub를 통한 배포는 기업 사용자에게 액세스 제어 및 취약점 스캔을 가능하게 합니다.

Ollama: 기본적으로 로컬 서비스로 실행되며, API는 localhost에서 노출됩니다. 네트워크 노출은 명시적인 구성이 필요합니다. 모델 레지스트리는 Ollama가 관리하는 신뢰할 수 있는 것으로, 공급망 위험을 줄입니다.

전통적인 Docker 솔루션: 네트워크 격리가 기본적으로 제공됩니다. 컨테이너 보안 스캔(Snyk, Trivy) 및 이미지 서명은 프로덕션 환경에서 표준적인 실천입니다.

모든 솔루션은 다음과 같은 주의를 기울여야 합니다:

- 모델 출처: 신뢰할 수 없는 모델은 악성 코드 또는 백도어를 포함할 수 있습니다.

- API 인증: 프로덕션 배포에서 인증/인가를 구현해야 합니다.

- 레이트 제한: 남용 및 자원 고갈을 방지해야 합니다.

- 네트워크 노출: API가 인터넷에 실수로 노출되지 않도록 해야 합니다.

- 데이터 프라이버시: 모델은 민감한 데이터를 처리하므로 데이터 보호 규정 준수를 보장해야 합니다.

이전 경로

Ollama에서 Docker Model Runner로 이전

Docker Model Runner의 GGUF 지원으로 인해 이전이 간단합니다:

- Docker Desktop에서 Docker Model Runner를 활성화하거나

docker-model-plugin을 설치합니다. - 모델 참조를 전환:

ollama run llama2→docker model pull ai/llama2및docker model run ai/llama2 - API 엔드포인트를

localhost:11434에서 DMR 엔드포인트(일반적으로localhost:8080)로 업데이트합니다. - 두 가지 모두 OpenAI 호환 API를 사용하므로, 애플리케이션 코드는 최소한의 변경이 필요합니다.

Docker Model Runner에서 Ollama로 이전

더 간단한 독립형 운영을 위해 Ollama로 이전:

- Ollama 설치:

curl -fsSL https://ollama.ai/install.sh | sh. Ollama CLI 명령어 및 구성 옵션에 대한 전체 목록은 Ollama CLI 체크리스트를 참조하세요. - 동등한 모델을 끌어옵니다:

ollama pull llama2 - API 엔드포인트를 Ollama의

localhost:11434로 업데이트합니다. ollama run llama2를 사용하여 기능을 확인합니다.

전통적인 Docker 컨테이너에서 DMR로 이전

Docker LLM 설정을 간소화합니다:

- Docker Model Runner를 활성화합니다.

- 사용자 정의 Dockerfile을

docker model pull명령어로 대체합니다. - nvidia-docker 구성(이미 DMR이 자동으로 GPU를 처리함)을 제거합니다.

- 복잡한

docker run명령어 대신docker model run을 사용합니다.

모든 솔루션에서 Ollama in Docker로 이전

둘 다의 최고를 결합하는 접근법:

docker pull ollama/ollama- 실행:

docker run -d --gpus all -v ollama:/root/.ollama -p 11434:11434 ollama/ollama - Ollama 명령어를 사용합니다:

docker exec -it ollama ollama pull llama2 - Docker 오케스트레이션과 Ollama의 간단함을 결합하여 사용합니다.

모니터링 및 가시성

Ollama: 기본 메트릭은 API(/api/tags, /api/ps)를 통해 제공됩니다. Open WebUI와 같은 제3자 도구는 대시보드를 제공합니다.

Docker: 완전한 통합이 Prometheus, Grafana, ELK 스택 및 클라우드 모니터링 서비스와 제공됩니다. 컨테이너 메트릭(CPU, 메모리, GPU)은 즉시 사용 가능합니다.

결론

2025년 Docker가 Docker Model Runner (DMR)를 도입하면서 로컬 LLM 배포 풍경은 크게 변화했습니다. 선택은 이제 당신의 특정 요구사항에 따라 결정됩니다:

- Docker 통합을 원하는 개발자에게: DMR은

docker model명령어를 사용하는 네이티브 Docker 워크플로우 통합을 제공합니다. - 최대 간단함을 원하는 경우: Ollama는 단일 명령어 모델 관리로 가장 간단한 솔루션입니다.

- 프로덕션 및 기업 환경을 원하는 경우: DMR 및 제3자 솔루션(vLLM, TGI)은 Docker에서 오케스트레이션, 모니터링, 확장성을 제공합니다.

- 둘 다의 최고를 원하는 경우: Ollama를 Docker 컨테이너에서 실행하여 간단함과 프로덕션 인프라를 결합할 수 있습니다.

DMR의 도입은 Docker와 Ollama 간의 사용 편의성 격차를 좁히는 데 도움이 됩니다. Ollama는 빠른 프로토타이핑을 위해 여전히 간단함에서 우위를 차지하고 있으며, DMR은 Docker 워크플로우에 이미 투자한 팀에게 우수합니다. 두 접근법 모두 활발히 개발되고 있으며, 프로덕션 준비 상태이며, 생태계는 충분히 성숙하여 그들 사이에서 전환하는 것이 상대적으로 부드럽습니다.

결론: 이미 Docker를 광범위하게 사용하고 있다면 DMR이 자연스러운 선택입니다. 인프라에 관계없이 절대적으로 간단한 경험을 원한다면 Ollama를 선택하세요. 로컬 옵션과 클라우드 API 및 기타 자체 호스팅 설정을 비교하려면, 우리의 LLM 호스팅: 로컬, 자체 호스팅 및 클라우드 인프라 비교 가이드를 참조하세요.

유용한 링크

Docker Model Runner

- Docker Model Runner 공식 페이지

- Docker Model Runner 문서

- Docker Model Runner 시작 가이드

- Docker Model Runner 발표 블로그