다른 위치로 Ollama 모델 이동

Ollama LLM 모델 파일은 많은 공간을 차지합니다.

ollama 설치 후에는 즉시 ollama를 재구성하여 새 위치에 저장하는 것이 좋습니다.

이렇게 하면 새로운 모델을 끌어다 사용할 때 이전 위치에 다운로드되지 않습니다.

Ollama에 대해

Ollama는 LLM AI 모델에 대한 텍스트 기반 프론트엔드이며, 이 모델들을 호스팅할 수도 있는 API입니다.

Ollama와 vLLM, Docker Model Runner, LocalAI 및 클라우드 제공업체 간의 비교를 포함하여, 비용 및 인프라 트레이드오프에 대한 보다 넓은 비교는 LLM 호스팅: 로컬, 자체 호스팅 및 클라우드 인프라 비교를 참조하세요.

Ollama 설치

https://ollama.com/download로 이동하세요.

Linux에 Ollama를 설치하려면 다음을 실행하세요:

curl -fsSL https://ollama.com/install.sh | sh

Windows용 Ollama는 이 페이지에서 확인할 수 있습니다: https://ollama.com/download/windows

Mac용 Ollama도 있습니다: https://ollama.com/download/macOllamaSetup.exe

Ollama 모델 다운로드, 목록 확인 및 삭제

일부 Ollama 모델을 다운로드하려면:

Ollama 라이브러리(https://ollama.com/library)로 이동하여 필요한 모델을 찾고,

여기에서 모델 태그와 크기를 확인할 수 있습니다.

그런 다음 다음 명령을 실행하세요:

ollama pull gemma2:latest

# 또는 16GB VRAM에 잘 맞는 약간 더 똑똑한 모델을 사용하려면:

ollama pull gemma2:27b-instruct-q3_K_S

# 또는:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

로컬 저장소에 있는 Ollama 모델을 확인하려면:

ollama list

필요 없는 모델을 제거하려면:

ollama rm qwen2:7b-instruct-q8_0 # 예시

Ollama 모델 위치

기본적으로 모델 파일은 다음 위치에 저장됩니다:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

Windows에서 Ollama 모델 경로 설정

Windows에서 환경 변수를 생성하려면 다음 단계를 따르세요:

- Windows 설정을 열고,

- 시스템으로 이동하고,

- ‘에 대한’을 클릭하고,

- ‘고급 시스템 설정’을 선택하고,

- ‘고급’ 탭으로 이동하고,

- ‘환경 변수…‘를 클릭하고,

- ‘새로 추가…‘를 클릭하고,

- OLLAMA_MODELS라는 이름의 변수를 생성하고, 모델을 저장할 위치를 지정하세요.

Linux에서 Ollama 모델 이동

ollama systemd 서비스 매개변수를 편집하세요:

sudo systemctl edit ollama.service

또는

sudo xed /etc/systemd/system/ollama.service

이렇게 하면 편집기가 열립니다.

각 환경 변수에 대해 [Service] 섹션 아래에 Environment 라인을 추가하세요:

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

저장하고 편집기를 종료합니다.

사용자 및 그룹 매개변수도 이 폴더에 대한 접근 권한이 있어야 합니다.

systemd를 재로드하고 Ollama를 다시 시작하세요:

sudo systemctl daemon-reload

sudo systemctl restart ollama

문제가 발생한 경우:

systemctl status ollama.service

sudo journalctl -u ollama.service

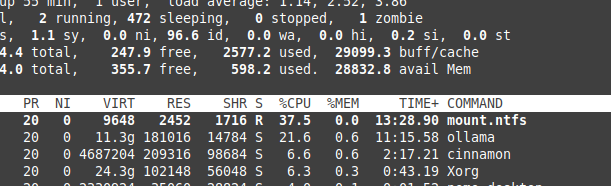

NTFS 포맷의 오버헤드

Linux에서 NTFS 포맷 파티션에 모델을 저장하는 경우,

모델 로딩 속도가 약 20% 이상 느려질 수 있습니다.

Windows에 Ollama 설치 및 특정 폴더에 모델 저장

다음 명령을 사용하여 특정 폴더에 Ollama와 모델을 설치하세요:

.\OllamaSetup.exe /DIR=D:\OllamaDir

내부 네트워크에 Ollama API 노출

내부 네트워크는 로컬 네트워크를 의미합니다.

서비스 구성에 다음을 추가하세요:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

Ollama가 다른 로컬 및 클라우드 LLM 옵션과 어떻게 호환되는지 확인하려면 LLM 호스팅: 로컬, 자체 호스팅 및 클라우드 인프라 비교 가이드를 참조하세요.