NVIDIA GPU의 AI 적합성 비교

AI는 많은 컴퓨팅 파워가 필요합니다...

Page content

현대 세계의 혼란 속에서 저는 다른 카드의 기술 사양 비교를 진행하고 있습니다. 이는 AI 작업에 적합한 카드들입니다.

(딥러닝,

객체 감지,

LLMs).

하지만 이 모든 카드는 매우 비싸죠.

GPU 선택이 LLM 처리량, VRAM 한계, 그리고 런타임에 걸친 벤치마크에 미치는 영향에 대한 더 많은 정보는 LLM 성능: 벤치마크, 병목 현상 및 최적화를 참고하세요.

이것은 AI로 생성된 이미지입니다. 진지하게 받아들이지 마세요…

다른 옵션들도 살펴보겠습니다

| 카드 | VRAM | 버스 폭 | 메모리 대역폭 | CUDA 코어 | 텐서 코어 | 전력 소비 (W) |

|---|---|---|---|---|---|---|

| RTX 4060 Ti 16GB | 16 GB | 128비트 | 288 GB/s | 4,352 | 136 | 165 |

| RTX 4070 Ti 16GB | 16 GB | 256비트 | 672 GB/s | 7,680 | 240 | 285 |

| RTX 4080 16GB | 16 GB | 256비트 | 716.8 GB/s | 9,728 | 304 | 320 |

| RTX 4080 Super 16GB | 16 GB | 256비트 | 736 GB/s | 10,240 | 320 | 320 |

| RTX 4090 24GB | 24 GB | 384비트 | 1008 GB/s | 16,384 | 512 | 450 |

| RTX 5060 Ti 16GB | 16 GB | 128비트 | 448 GB/s | 4,608 | 144 | 180 |

| RTX 5070 Ti 16GB | 16 GB | 256비트 | 896 GB/s | 8,960 | 280 | 300 |

| RTX 5080 16GB | 16 GB | 256비트 | 896 GB/s | 10,752 | 336 | ~320 |

| RTX 5090 32GB | 32 GB | 512비트 | 1792 GB/s | 21,760 | 680 | ~450 |

| RTX 2000 Ada | 16 GB | 128비트 | 224 GB/s | 2,816 | 88 | 70 |

| RTX 4000 Ada | 20 GB | 160비트 | 280 GB/s | 6,144 | 192 | 70 |

| RTX 4500 Ada | 24 GB | 192비트 | 432 GB/s | 7,680 | 240 | 210 |

| RTX 5000 Ada | 32 GB | 256비트 | 576 GB/s | 12,800 | 400 | 250 |

| RTX 6000 Ada | 48 GB | 384비트 | 960 GB/s | 18,176 | 568 | 300 |

메모리 대역폭:

- RTX 5090 (1792 GB/s), 그 다음은 RTX 4090 (1008 GB/s), 그 다음은 RTX 6000 Ada (960 GB/s)

텐서 코어:

- RTX 5090 (680), 그 다음은 RTX 6000 Ada (568), 그 다음은 RTX 4090 (512)

CUDA 코어:

- RTX 5090 (21,760), 그 다음은 RTX 6000 Ada (18,176), 그 다음은 RTX 4090 (16,384)

RAM:

- RTX 6000 Ada (48 GB), 그 다음은 RTX 5090 및 RTX 5000 Ada (32 GB), 그 다음은 RTX 4090 (24 GB)

호주에서의 가격

- RTX 6000 Ada: 12,000 AUD

- RTX 5090: 6,000 AUD

- RTX 5000 Ada: 7,000 AUD

- RTX 4090: 매진

LLM에 최적의 소비자 GPU

그래도 저는 RTX 5090이 머신러닝, 딥러닝, AI, 그리고 심지어 LLM에도 최적의 선택이라고 생각합니다 :)

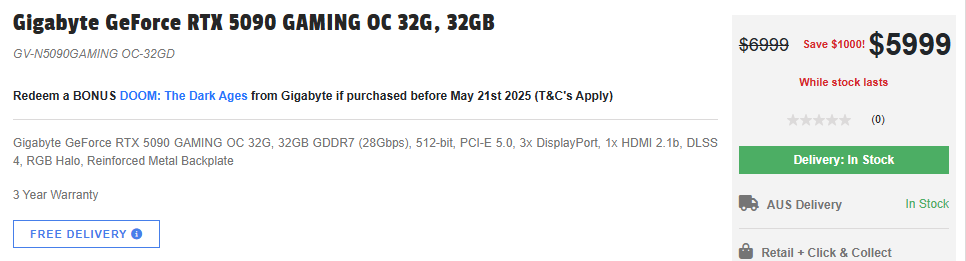

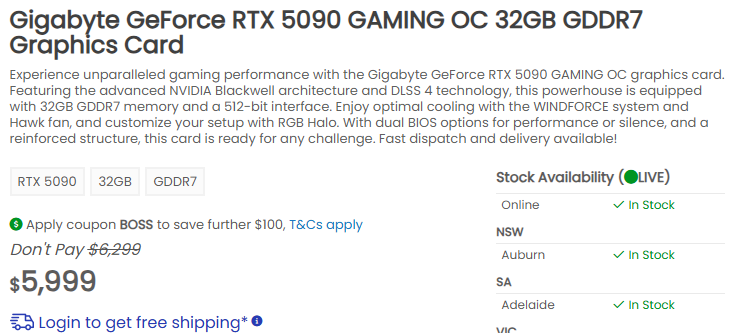

실제 가격

조금 비싸죠…

실제 RTX 5090의 가격은 예상보다 50% 더 높습니다. 이걸 보세요!

2025년 5월 15일 기준입니다.

다른 GPU와 런타임에서의 LLM 벤치마크, VRAM 요구사항, 그리고 성능 최적화를 살펴보려면 LLM 성능: 벤치마크, 병목 현상 및 최적화 허브를 참고하세요.