LLM ASIC 및 전용 추론 칩 (중요성)

ASIC 및 맞춤형 실리콘이 LLM 추론 속도와 효율성을 끌어올립니다.

미래의 AI 는 단순히 더 똑똑한 모델 에 관한 것이 아닙니다. 또한 이러한 모델이 실제로 서비스되는 방식에 맞는 실리콘 (반도체) 에 관한 것입니다. LLM 추론 을 위한 전용 하드웨어는 Bitcoin 채굴에서 GPU 에서 목적-built ASIC 으로 이동하는 경로를 따르고 있지만, 모델과 정밀도 레시피가 계속 진화하기 때문에 더 엄격한 제약 조건을 가지고 있습니다.

처리량, 지연 시간, VRAM, 런타임 및 하드웨어 전반에 걸친 벤치마크에 대한 자세한 내용은 LLM 성능: 벤치마크, 병목 현상 및 최적화 를 참조하세요.

전기적 상상력 - Flux 텍스트에서 이미지로 LLM.

전기적 상상력 - Flux 텍스트에서 이미지로 LLM.

왜 LLM 은 추론 전용 하드웨어에서 혜택을 받는가?

대규모 언어 모델 은 AI 를 혁신했지만, 매번 유창한 응답은 거대하고 예측 가능한 행렬 연산 및 메모리 트래픽 스트림에 의존합니다. 추론 비용이 증가함에 따라 (종종 모델의 수명 동안 훈련 비용을 초과함) 모든 가능한 워크로드가 아닌 서비스 (serving) 에 최적화된 칩은 경제적으로 매력적이 됩니다.

Bitcoin 채굴에 대한 비유는 불완전하지만 교훈적입니다. 둘 다 반복적이고 잘 정의된 작업이며, 다이 (die) 에서 사용되지 않는 일반적인 부분을 제거하면 처리량과 유용한 연산당 줄 (joules) 이 크게 증가합니다.

Bitcoin 채굴 역사가 추론 ASIC 에 대해 시사하는 바

Bitcoin 채굴은 네 가지 세대를 거쳐 진화했습니다:

| 시대 | 하드웨어 | 주요 이점 | 한계 |

|---|---|---|---|

| 2015–2020 | GPU (CUDA, ROCm) | 유연성 | 전력 소비가 높고 메모리 제한 |

| 2021–2023 | TPU, NPU | 거친 특화 (Coarse-grain specialization) | 여전히 훈련 중심 |

| 2024–2025 | Transformer ASIC | 저비트 추론에 최적화됨 | 일반성 제한됨 |

AI 도 유사한 경로를 따르고 있습니다. 각 전환은 성능 과 에너지 효율성을 수 배에서 수십 배 향상시켰습니다.

그러나 Bitcoin ASIC(SHA-256 만 계산) 과는 달리, 추론 ASIC 은 어느 정도의 유연성이 필요합니다. 모델은 진화하고, 아키텍처는 변경되며, 정밀도 스킴은 개선됩니다. 핵심은 적당한 수준으로 특화하는 것입니다. 핵심 패턴을 하드웨어로 고정하되, 가장자리에서는 적응성을 유지하는 것입니다.

LLM 추론이 훈련과 어떻게 다른가 (및 칩이 활용하는 것)

추론 워크로드는 전용 하드웨어가 표적할 수 있는 패턴을 드러냅니다:

- 저정밀도가 지배적 — 8 비트, 4 비트, 심지어 삼진법 (ternary) 이나 이진법 산술이 추론에 잘 작동함

- 메모리가 병목 현상 — 가중치와 KV 캐시를 이동하는 것이 계산보다 훨씬 더 많은 전력을 소모함

- 처리량보다 지연 시간이 더 중요 — 사용자는 200ms 이내에 토큰을 기대함

- 대규모 요청 병렬 처리 — 칩당 수천 개의 동시 추론 요청

- 예측 가능한 패턴 — Transformer 레이어는 구조가 매우 명확하며 하드웨어로 고정할 수 있음

- 희소성 (Sparsity) 기회 — 모델은 점점 더 가지치기 (pruning) 와 MoE (Mixture-of-Experts) 기법을 사용함

목적-built 추론 칩은 이러한 가정을 하드웨어로 고정하여 범용 GPU 보다 10–50 배 더 높은 와트당 성능을 달성할 수 있습니다.

LLM 최적화 추론 실리콘을 구축하는 주체

추론 ASIC 시장은 기존 업체, 웨이퍼 규모 설계, 그리고 트랜스포머 모양의 실리콘에 베팅하는 스타트업으로 구성됩니다:

| 회사 | 칩/플랫폼 | 전문 분야 |

|---|---|---|

| Groq | LPU (Language Processing Unit) | LLM 을 위한 결정론적 처리량 |

| Etched AI | Sohu ASIC | 하드웨어화된 Transformer 엔진 |

| Tenstorrent | Grayskull / Blackhole | 고대역폭 메시를 갖춘 일반 ML |

| Taalas | HC1 (Llama 3.1 8B 제품) / HC2 로드맵 | 모델 특화 “하드코어” 실리콘; 저장소 및 연산 병합 |

| OpenAI × Broadcom | Custom Inference Chip | 2026 년 출시 예정 (전설) |

| Intel | Crescent Island | 160GB HBM 을 탑재한 추론 전용 Xe3P GPU |

| Cerebras | Wafer-Scale Engine (WSE-3) | 칩 내 대용량 메모리 대역폭 |

이 중 많은 부분이 이미 슬라이드웨어가 아닌 생산 데이터 센터에서 사용 중입니다. d-Matrix, Rain AI, Mythic, Tenet과 같은 작은 팀들도 저비트 추론과 구조적 희소성에 맞춰진 아키텍처를 추구하고 있습니다.

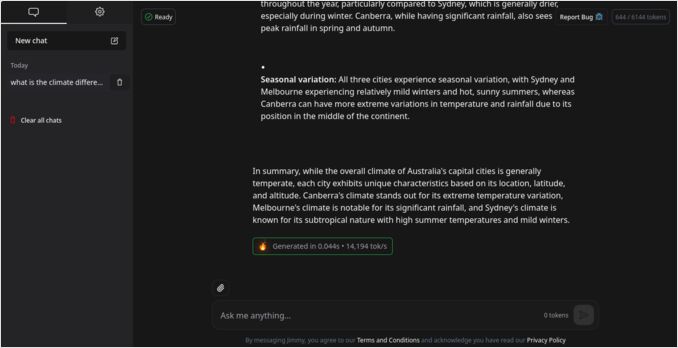

Taalas HC1, Chat Jimmy 및 초고속 소형 모델 서비스

Taalas 는 “거의 모든 것을 특화하라"는 학교의 최근 사례입니다. 이 회사는 메모리-연산 경계 (칩 외부 DRAM 대 칩 내부 SRAM) 가 추론의 비용, 전력, 엔지니어링 복잡성을 지배하며, 모델별 실리콘 (그들이 Hardcore Models이라고 부르는 것) 이 배포 시 가중치와 그래프를 고정할 의사가 있다면 그 경계를 무너뜨릴 수 있다고 주장합니다.

첫 번째 출시 제품인 HC1은 Llama 3.1 8B 변형을 하드웨어로 고정합니다. 이 선택은 실용적입니다. 모델은 신속하게 출시할 만큼 작고, 공개적으로 문서화되어 있으며, 원시 추론 깊이보다 지연 시간과 비용이 더 중요한 많은 자동화, 분류, 초안 작성 작업에 여전히 유용합니다. Taalas 는 이 구성에 대해 사용자는 초당 16k–17k 디코드 토큰을 보고하며 (공급사 방법론 및 비교는 작성물에 명시됨), 동일한 모델 클래스에 대해 기존 GPU 스택에 비해 자본 및 전력 측면에서 큰 이득을 주장합니다. 1 세대 부품은 공격적인 혼합 저비트 저장을 사용하며, 회사는 HC2에서 표준 4 비트 부동 소수점 형식으로 전환하여 품질 여유를 회복한다고 설명합니다.

이러한 처리량 클래스가 실제로 무엇을 의미하는지 느끼고 싶은 개발자를 위해 Taalas 는 무료 챗봇 데모인 Chat Jimmy 를 운영하고 있으며, 사이트의 신청서 를 통해 API 접근을 제공합니다. 이는 명시적으로 개념 증명이며 최첨단 어시스턴트는 아니지만, 느리거나 비싼 대형 모델보다 “인간 인지 속도"에서 작동하는 modest 모델을 선호할 수 있는 실제 청중을 보여줍니다.

트랜스포머 추론 ASIC 의 아키텍처

트랜스포머 최적화 칩의 내부 구조는 실제로 어떻게 생겼을까요?

+--------------------------------------+

| 호스트 인터페이스 |

| (PCIe / CXL / NVLink / Ethernet) |

+--------------------------------------+

| 칩 내 상호 연결 (메시/링) |

+--------------------------------------+

| 연산 타일/코어 |

| — 밀집 행렬 곱셈 단위 |

| — 저정밀 (int8/int4) ALU |

| — 역양자화/활성화 단위 |

+--------------------------------------+

| 칩 내 SRAM 및 KV 캐시 버퍼 |

| — 핫 가중치, 융합된 캐시 |

+--------------------------------------+

| 양자화/역양자화 파이프라인 |

+--------------------------------------+

| 스케줄러/컨트롤러 |

| — 정적 그래프 실행 엔진 |

+--------------------------------------+

| 칩 외부 DRAM/HBM 인터페이스 |

+--------------------------------------+

주요 아키텍처 기능은 다음과 같습니다:

- 연산 코어 — int8, int4, 삼진 연산에 최적화된 밀집 행렬 곱셈 단위

- 칩 내 SRAM — 핫 가중치와 KV 캐시를 보유하여 비용이 비싼 DRAM 접근을 최소화하는 대용량 버퍼

- 스트리밍 상호 연결 — 메시 토폴로지가 여러 칩 간 효율적인 확장을 가능하게 함

- 양자화 엔진 — 레이어 간 실시간 양자화/역양자화

- 컴파일러 스택 — PyTorch/ONNX 그래프를 칩 전용 마이크로 오퍼레이션으로 직접 변환

- 하드웨어화된 어텐션 커널 — softmax 및 기타 연산에 대한 제어 흐름 오버헤드를 제거

이 설계 철학은 Bitcoin ASIC 을 거울처럼 비춥니다: 모든 트랜지스터가 특정 워크로드를 위해 존재합니다. 추론에 필요 없는 기능에 낭비되는 실리콘은 없습니다.

LLM 추론을 위한 GPU 대 ASIC 벤치마크

대표적인 공개 수치는 전용 추론 하드웨어가 동일한 모델 계열에서 범용 GPU 스택에서 얼마나 앞서나갈 수 있는지를 보여줍니다 (자신만의 워크로드에 대해 항상 방법론과 배치 가정을 확인하세요):

| 모델 | 하드웨어 | 처리량 (토큰/초) | 첫 번째 토큰 도달 시간 | 성능 배수 |

|---|---|---|---|---|

| Llama-2-70B | NVIDIA H100 (8x DGX) | ~80–100 | ~1.7s | 기준 (1×) |

| Llama-2-70B | Groq LPU | 241–300 | 0.22s | 3–18 배 더 빠름 |

| Llama-3.3-70B | Groq LPU | ~276 | ~0.2s | 일관된 3 배 |

| Gemma-7B | Groq LPU | 814 | <0.1s | 5–15 배 더 빠름 |

| Llama-3.1-8B | Taalas HC1 (공급사) | ~16k–17k 디코드 토큰/초/사용자 | — | 별도 축 (70B 가 아닌 고정된 8B 그래프) |

출처: Groq.com, ArtificialAnalysis.ai, NVIDIA Developer Blog; Taalas HC1 수치는 회사의 제품 게시글에서 가져옴.

Groq 중심 행은 대형 모델에서 고성능 GPU 기준 대비 처리량 및 첫 번째 토큰 도달 시간에서 큰 이득을 보여줍니다. Taalas 행은 70B 라인에 대한 또 다른 배수가 아닙니다. 대신, 모델과 그래프가 실리콘에 고정될 때 사용자당 디코드가 얼마나 멀리 밀어낼 수 있는지 보여주며, 이는 유연성의 비용으로 이루어집니다.

추론 실리콘을 특화할 때의 트레이드오프

특화는 성능을 구매하지만 제품 및 엔지니어링 리스크를 재도입합니다:

-

유연성 대 효율성. 완전히 고정된 ASIC 은 오늘날의 트랜스포머 모델을 빠르게 처리하지만 내일의 아키텍처에서는 어려움을 겪을 수 있습니다. 어텐션 메커니즘이 진화하거나 새로운 모델 가족이 나타날 때 어떤 일이 발생할까요?

-

양자화 및 정확도. 저정밀도는 막대한 양의 전력을 절약하지만, 정확도 저하를 관리하려면 정교한 양자화 스킴이 필요합니다. 모든 모델이 4 비트 이하로 부드럽게 양자화되는 것은 아닙니다.

-

소프트웨어 생태계. 견고한 컴파일러, 커널, 프레임워크가 없는 하드웨어는 쓸모가 없습니다. NVIDIA 는 주로 CUDA 의 성숙한 생태계 때문에 여전히 지배적입니다. 새로운 칩 제조사는 소프트웨어에 막대한 투자를 해야 합니다.

-

비용 및 리스크. 칩을 테이핑 아웃 (taping out) 하는 데는 수천만 달러의 비용이 들며 12–24 개월이 걸립니다. 스타트업에게는 유지되지 않을 수도 있는 아키텍처 가정에 대한 거대한 베팅입니다.

그럼에도 불구하고, 초규모 (hyperscale) 에서 2 배의 효율성 향상만으로도 수십억 달러의 비용 절감으로 이어집니다. 클라우드 제공자 가 초당 수백만 개의 추론 요청을 실행하는 경우, 커스터마이즈된 실리콘은 점점 더 불가피해지고 있습니다.

LLM 추론 칩을 위한 희망 목록 사양

| 기능 | 이상적인 사양 |

|---|---|

| 공정 | 3–5nm 노드 |

| 칩 내 SRAM | 100MB+ 긴밀하게 결합됨 |

| 정밀도 | int8 / int4 / 삼진 네이티브 지원 |

| 처리량 | 500+ 토큰/초 (70B 모델) |

| 지연 시간 | <100ms 첫 번째 토큰 도달 시간 |

| 상호 연결 | 저지연 메시 또는 광학 링크 |

| 컴파일러 | PyTorch/ONNX → 마이크로코드 툴체인 |

| 에너지 | 토큰당 <0.3 줄 |

앞으로의 전망 (2026–2030)

추론 하드웨어 환경이 세 개의 거친 계층으로 분화될 것으로 예상됩니다:

-

훈련 칩. NVIDIA B200 및 AMD Instinct MI400과 같은 고급 GPU 는 FP16/FP8 유연성과 막대한 메모리 대역폭으로 훈련을 계속 지배할 것입니다.

-

추론 ASIC. 하드웨어화되고 저정밀 트랜스포머 가속기는 비용과 효율성을 최적화하여 초규모에서 생산 서비스를 처리할 것입니다.

-

에지 NPU. 작고 초효율적인 칩은 양자화된 LLM 을 스마트폰, 차량, IoT 장치, 로봇으로 가져와 클라우드 의존성 없이 온디바이스 지능을 가능하게 할 것입니다.

하드웨어 외에도 다음과 같은 것을 볼 수 있습니다:

- 하이브리드 클러스터 — 유연한 훈련용 GPU 와 효율적인 서비스용 ASIC(또는 웨이퍼 규모 추론 엔진)

- 추론 서비스 (Inference-as-a-Service) — 초대규모 업체가 자체 가속기 (AWS Inferentia, Google TPU 등) 와 GPU 를 혼합

- 하드웨어-소프트웨어 공동 설계 — 블록 희소성, MoE 라우팅, 양자화 친화적 레이어를 위해 형성된 모델

- 모델별 또는 패밀리별 실리콘 — Taalas 와 같은 기업이 알려진 그래프에서 극단적인 비용과 지연 시간을 위해 아키텍처 유연성을 거래할 것임을 베팅

- 오픈 추론 API — 실리콘이 비이동성이더라도 서비스 인터페이스를 이동 가능하게 유지하려는 압력

최종 생각

AI 추론의 “ASIC 화”는 이미 진행 중입니다. Bitcoin 채굴이 CPU 에서 전용 실리콘으로 진화한 것처럼, AI 배포도 같은 경로를 따르고 있습니다.

AI 의 다음 혁명은 더 큰 모델에 관한 것이 아니라 더 나은 칩에 관한 것입니다. 트랜스포머 추론의 특정 패턴에 최적화된 하드웨어가 대규모로 경제적으로 AI 를 배포할 수 있는 주체를 결정할 것입니다.

Bitcoin 채굴자가 낭비되는 와트의 마지막까지 최적화하듯이, 추론 하드웨어는 마지막 FLOP-per-joule 짜기까지 할 것입니다. 그때 진정한 돌파구는 알고리즘이 아니라 그것을 실행하는 실리콘에 있을 것입니다.

AI 의 미래는 실리콘에 새겨지고 있으며, 하나의 트랜지스터씩 이루어지고 있습니다.

더 많은 벤치마크, 하드웨어 선택, 성능 튜닝에 대해서는 LLM 성능: 벤치마크, 병목 현상 및 최적화 허브를 확인하세요.

유용한 링크

- Groq 공식 벤치마크

- Taalas — 보편적 AI 로 가는 길 (HC1, 로드맵, 철학)

- Chat Jimmy — Taalas Llama 3.1 8B 데모

- Taalas API 접근 신청서

- Artificial Analysis - LLM 성능 리더보드

- NVIDIA H100 기술 브리프

- Etched AI - Transformer ASIC 발표

- Cerebras Wafer-Scale Engine

- NVidia RTX 5080 and RTX 5090 prices in Australia - October 2025

- LLM Performance and PCIe Lanes: Key Considerations

- Large Language Models Speed Test

- Comparing NVidia GPU suitability for AI

- Is the Quadro RTX 5880 Ada 48GB Any Good?