Tutorial su Generazione Arricchita da Recupero (RAG): Architettura, Implementazione e Guida alla Produzione

Dai fondamenti del RAG alla produzione: chunking, ricerca vettoriale, rirango e valutazione in una guida.

Questo tutorial su Retrieval-Augmented Generation (RAG) è una guida passo dopo passo, orientata alla produzione, per costruire sistemi RAG reali.

Se stai cercando:

- Come costruire un sistema RAG

- Architettura RAG spiegata

- Tutorial RAG con esempi

- Come implementare RAG con database vettoriali

- RAG con reranking

- RAG con ricerca web

- Best practice per RAG in produzione

Sei nel posto giusto.

Questo guide raccoglie conoscenze pratiche sull’implementazione di RAG, pattern architetturali e tecniche di ottimizzazione utilizzate nei sistemi AI in produzione.

Mappa del Cluster RAG (Leggi in Ordine)

Se vuoi il percorso più rapido attraverso il cluster RAG, utilizza questa mappa:

- Sei qui: panoramica su RAG + pipeline end-to-end (questa pagina)

- Chunking (fondamento della qualità del recupero): Strategie di Chunking in RAG

- Vector stores (scelte di archiviazione + indexing): Confronto tra Vector Stores per RAG

- Profondità del recupero (quando “search” non basta): Search vs DeepSearch vs Deep Research

- Reranking (spesso il miglior guadagno di qualità): Reranking con Modelli di Embedding

- Embeddings + modelli di reranker (implementazioni pratiche):

- Architetture avanzate: Varianti avanzate di RAG: LongRAG, Self-RAG, GraphRAG

Cosa è Retrieval-Augmented Generation (RAG)?

Retrieval-Augmented Generation (RAG) è un modello di progettazione di sistemi che combina:

- Recupero dell’informazione

- Ampliamento del contesto

- Generazione da modelli linguistici di grandi dimensioni

In termini semplici, una pipeline RAG recupera documenti rilevanti e li inserisce nella richiesta prima che il modello generi una risposta.

A differenza del fine-tuning, RAG:

- Funziona con dati frequentemente aggiornati

- Supporta basi di conoscenza private

- Riduce le illusioni

- Evita il riallineamento di modelli grandi

- Migliora la fondazione delle risposte

I sistemi RAG moderni includono più di una ricerca vettoriale. Un’implementazione completa di RAG può includere:

- Riscrittura delle query

- Ricerca ibrida (BM25 + ricerca vettoriale)

- Reranking con cross-encoder

- Recupero multi-stage

- Integrazione con la ricerca web

- Valutazione e monitoraggio

BluePrint Minimo di RAG in Produzione (Implementazione di Riferimento)

Utilizza questo come modello mentale (e come scheletro iniziale) per RAG in produzione.

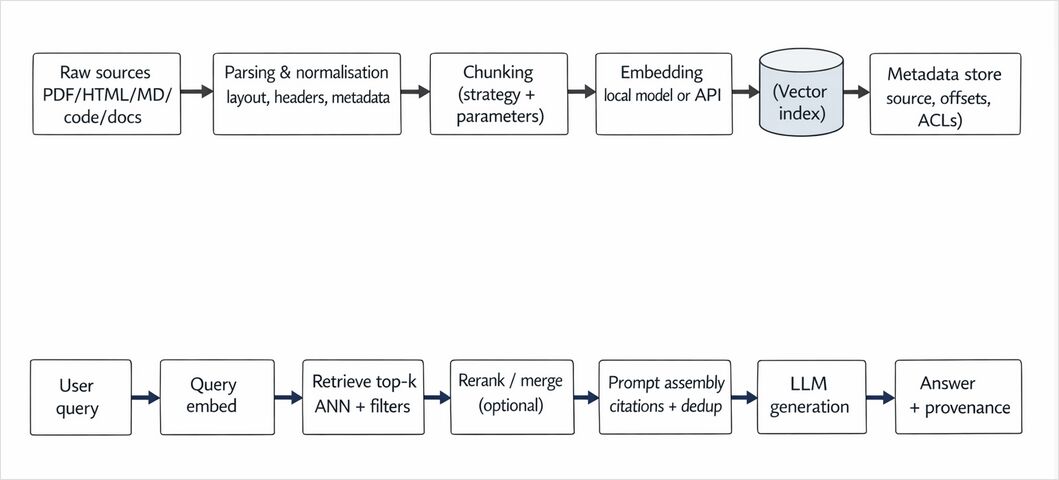

Pipeline di ingestione (offline o continua)

- Raccogli le fonti (documenti, ticket, pagine web, PDF, codice)

- Normalizza (estratto testo, pulizia del boilerplate, de-duplicazione)

- Chunk (scegli strategia + sovrapposizione + metadati)

- Embed (embedding versionati)

- Inserisci nell’indice (archivio vettoriale + campi metadati)

- Strategia di reindicizzazione quando cambiano gli embedding o il chunking

Pipeline di query (online)

- Analizza / riscrivi la query (opzionale)

- Recupera i candidati (vettoriale o ibrido + filtraggio metadati)

- Reranking dei top-K con un modello cross-encoder / reranker

- Assembla il contesto (elimina duplicati, ordina per rilevanza, aggiungi citazioni)

- Genera con un prompt fondato (regole + comportamento di rifiuto)

- Logga (insieme di recupero, insieme reranked, contesto finale, latenza, costo)

- Valuta (harness online/offline)

Se migliorassi solo una cosa in un sistema RAG funzionante: aggiungi il reranking e un harness di valutazione.

Tutorial Passo-Passo su RAG: Come Costruire un Sistema RAG

Questa sezione descrive un flusso pratico per lo sviluppatore in un tutorial RAG.

Passo 1: Prepara e Chunkizza i Tuoi Dati

La qualità del recupero dipende molto dalla strategia di chunking e dal design dell’indice: un buon RAG inizia con un chunking corretto.

Il chunking determina:

- Ricall del recupero

- Latenza

- Rumore del contesto

- Costo dei token

- Rischio di illusioni

Le strategie comuni di chunking in RAG includono:

- Chunking a dimensione fissa

- Chunking con finestra scorrevole

- Chunking semantico

- Chunking ricorsivo

- Chunking gerarchico

- Chunking consapevole dei metadati

Un chunking pessimo è una delle cause più comuni di sistemi RAG con prestazioni insufficienti.

Per un’analisi rigorosa, orientata all’ingegneria, delle trade-off del chunking, delle dimensioni di valutazione, delle matrici decisionali e delle implementazioni Python eseguibili, vedi:

Strategie di Chunking in RAG: Alternative, Trade-off e Esempi

Quella guida copre i valori pratici di default per:

- Sistemi QA

- Pipeline di sintesi

- Ricerca di codice

- Documenti multimodali

- Ingestione streaming

Se sei serio riguardo alle prestazioni di RAG, leggila prima di regolare gli embedding o il reranking.

Passo 2: Scegli un Database Vettoriale per RAG

Un database vettoriale archivia gli embedding per una ricerca veloce di similarità.

Confronta i database vettoriali qui:

Confronto tra Vector Stores per RAG

Quando si seleziona un database vettoriale per un tutorial RAG o un sistema in produzione, considera:

- Tipo di indice (HNSW, IVF, ecc.)

- Supporto per il filtraggio

- Modello di distribuzione (cloud vs self-hosted)

- Latenza delle query

- Scalabilità orizzontale

- Requisiti per multi-tenancy e controllo degli accessi

Passo 3: Implementa il Recupero (Ricerca Vettoriale o Ibrida)

Il recupero base in RAG utilizza la similarità degli embedding.

Il recupero avanzato in RAG utilizza:

- Ricerca ibrida (vettoriale + parola chiave)

- Filtraggio dei metadati

- Recupero multi-indice

- Riscrittura delle query

Per un riferimento concettuale:

Search vs DeepSearch vs Deep Research

Comprendere la profondità del recupero è essenziale per le pipeline RAG di alta qualità.

Passo 4: Aggiungi il Reranking alla Tua Pipeline RAG

Il reranking è spesso il miglior miglioramento di qualità in un’implementazione RAG.

Il reranking migliora:

- Precisione

- Rilevanza del contesto

- Fedeltà

- Rapporto segnale-rumore

Impara le tecniche di reranking:

- Reranking con Modelli di Embedding

- Qwen3 Embedding + Qwen3 Reranker su Ollama

- Reranking con Ollama + Qwen3 Embedding (Go)

- Reranking con Ollama + Qwen3 Reranker in Go

Nei sistemi RAG in produzione, il reranking è spesso più importante del passaggio a un modello più grande.

Passo 5: Integra la Ricerca Web (Opzionale ma Potente)

La ricerca web integrata in RAG consente il recupero dinamico di conoscenza.

La ricerca web è utile per:

- Dati in tempo reale

- Assistenti AI consapevoli delle notizie

- Intelligenza competitiva

- Risposte a domande aperte

Vedi implementazioni pratiche:

Passo 6: Costruisci un Framework di Valutazione RAG

Un tutorial serio su RAG deve includere la valutazione. Senza di essa, l’ottimizzazione di un sistema RAG diventa lavoro di indovinello.

Cosa misurare

| Layer | Cosa misurare | Perché è importante |

|---|---|---|

| Ingestion | copertura dei chunk, tasso di duplicati, versione degli embedding | prevenire il drift silenzioso |

| Retrieval | recall@k, precision@k, MRR/NDCG | ti dice se stai recuperando le prove giuste |

| Reranking | delta in precision@k rispetto al baseline | convalida il ROI del reranker |

| Generation | fedeltà / groundedness, accuratezza delle citazioni, qualità del rifiuto | riduce le illusioni |

| Sistema | latenza p50/p95, costo per query, tasso di cache hit | mantiene il prodotto utilizzabile |

Harness di valutazione minimo (checklist pratica)

- Crea un set di test di query (se possibile, query reali degli utenti)

- Per ogni query, memorizza:

- risposta prevista o fonti previste

- fonti consentite (documenti d’oro) quando disponibili

- Esegui un batch offline:

- recupera i candidati

- reranking

- generazione

- punteggio (recupero + generazione)

- Traccia le metriche nel tempo e fallisci il build in caso di regressione (anche piccola)

Inizia semplice: 50–200 query è sufficiente per rilevare le regressioni principali.

Architetture RAG Avanzate

Una volta che hai compreso il RAG base, esplora i pattern avanzati:

Varianti avanzate di RAG: LongRAG, Self-RAG, GraphRAG

Le architetture avanzate di Retrieval-Augmented Generation consentono:

- Ragionamento multi-hop

- Recupero basato su grafi

- Loop di auto-correzione

- Integrazione della conoscenza strutturata

Queste architetture sono essenziali per i sistemi AI a livello aziendale.

Quando il RAG Fallisce (E Come Correggerlo)

La maggior parte dei fallimenti del RAG è diagnosticabile se si osserva il pipeline strato per strato.

- Restituisce contesto irrilevante → migliora il chunking, aggiungi filtri dei metadati, implementa la ricerca ibrida, regola K.

- Recupera i documenti giusti ma risponde in modo errato → aggiungi il reranking, riduci il rumore del contesto, migliora le regole di grounding del prompt.

- Illude nonostante i buoni documenti → enforza le citazioni, aggiungi il comportamento di rifiuto, aggiungi la valutazione della fedeltà, riduci la temperatura “creativa”.

- È lento/espensivo → cache il recupero + gli embedding, riduci il K di reranking, limita il contesto, batch embed, regola i parametri dell’indice ANN.

- Leak di dati tra tenant → implementa il filtraggio ACL al momento del recupero (non solo nel prompt), separa gli indici o partizioni per tenant.

Errori Comuni nell’Implementazione di RAG

Errori comuni in tutorial RAG principianti includono:

- Utilizzare chunk di documenti troppo grandi

- Saltare il reranking

- Sovraccaricare la finestra del contesto

- Non filtrare i metadati

- Non avere un harness di valutazione

Correggere questi errori migliora drasticamente le prestazioni del sistema RAG.

RAG vs Fine-Tuning

In molti tutorial, RAG e fine-tuning vengono confusi. Usa questa guida per la decisione:

| Dovresti preferire… | Quando… |

|---|---|

| RAG | la conoscenza cambia frequentemente; hai bisogno di citazioni/auditabilità; hai documenti privati; vuoi aggiornamenti rapidi senza riallineamento |

| Fine-tuning | hai bisogno di tono/comportamento coerente; vuoi che il modello segua una guida di stile del dominio; la tua conoscenza è relativamente statica |

| Entrambi | hai bisogno del comportamento del dominio e di conoscenza fresca/privata (comune in produzione) |

Usa RAG per:

- Recupero di conoscenza esterna

- Dati frequentemente aggiornati

- Riduzione del rischio operativo

Usa il fine-tuning per:

- Controllo del comportamento

- Coerenza del tono/stile

- Adattamento al dominio quando i dati sono statici

La maggior parte dei sistemi AI avanzati combina Retrieval-Augmented Generation con fine-tuning selettivo.

Best Practice per RAG in Produzione

Se stai andando oltre un tutorial RAG e ti stai dirigendo verso la produzione:

Recupero + qualità

- Usa la ricerca ibrida

- Aggiungi il reranking

- Usa il filtraggio dei metadati e la deduplicazione

- Traccia continuamente le metriche di recupero (recall@k / precision@k)

Costo + latenza (non saltare questo)

- Caching:

- Cache degli embedding (testo identico → embedding identico)

- Cache del recupero (query popolari)

- Cache delle risposte (per flussi deterministici)

- Regola i parametri dell’indice ANN (HNSW/IVF) e le operazioni in batch

- Controlla l’uso dei token: contesto più piccolo, candidati più ristretti, prompt strutturati

Sicurezza + privacy

- Esegui il controllo degli accessi al momento del recupero (filtri ACL / partizioni per tenant)

- Censura o evita l’indicizzazione dei dati PII quando possibile

- Logga in modo sicuro (evita di archiviare prompt sensibili a meno che non siano necessari)

Disciplina operativa

- Versiona gli embedding e la strategia di chunking

- Automatizza le pipeline di ingestione

- Monitora le metriche di illusioni/fedeltà

- Traccia il costo per query

Retrieval-Augmented Generation non è solo un concetto di tutorial - è una disciplina architetturale in produzione.

Pensieri Finali

Questo tutorial su RAG copre sia l’implementazione per principianti che il design avanzato del sistema.

Retrieval-Augmented Generation è l’ossatura delle applicazioni AI moderne.

Mastricare l’architettura RAG, il reranking, i database vettoriali, la ricerca ibrida, e la valutazione determinerà se il tuo sistema AI rimarrà un demo - o diventerà pronto per la produzione.

Questo argomento continuerà ad espandersi man mano che i sistemi RAG evolvono.