OpenClaw Quickstart: Installeer met Docker (Ollama GPU of Claude CPU)

Installeer OpenClaw lokaal met Ollama

OpenClaw is een zelfgehoste AI-assistent die is ontworpen om te draaien met lokale LLM-runtime zoals Ollama of met cloudgebaseerde modellen zoals Claude Sonnet.

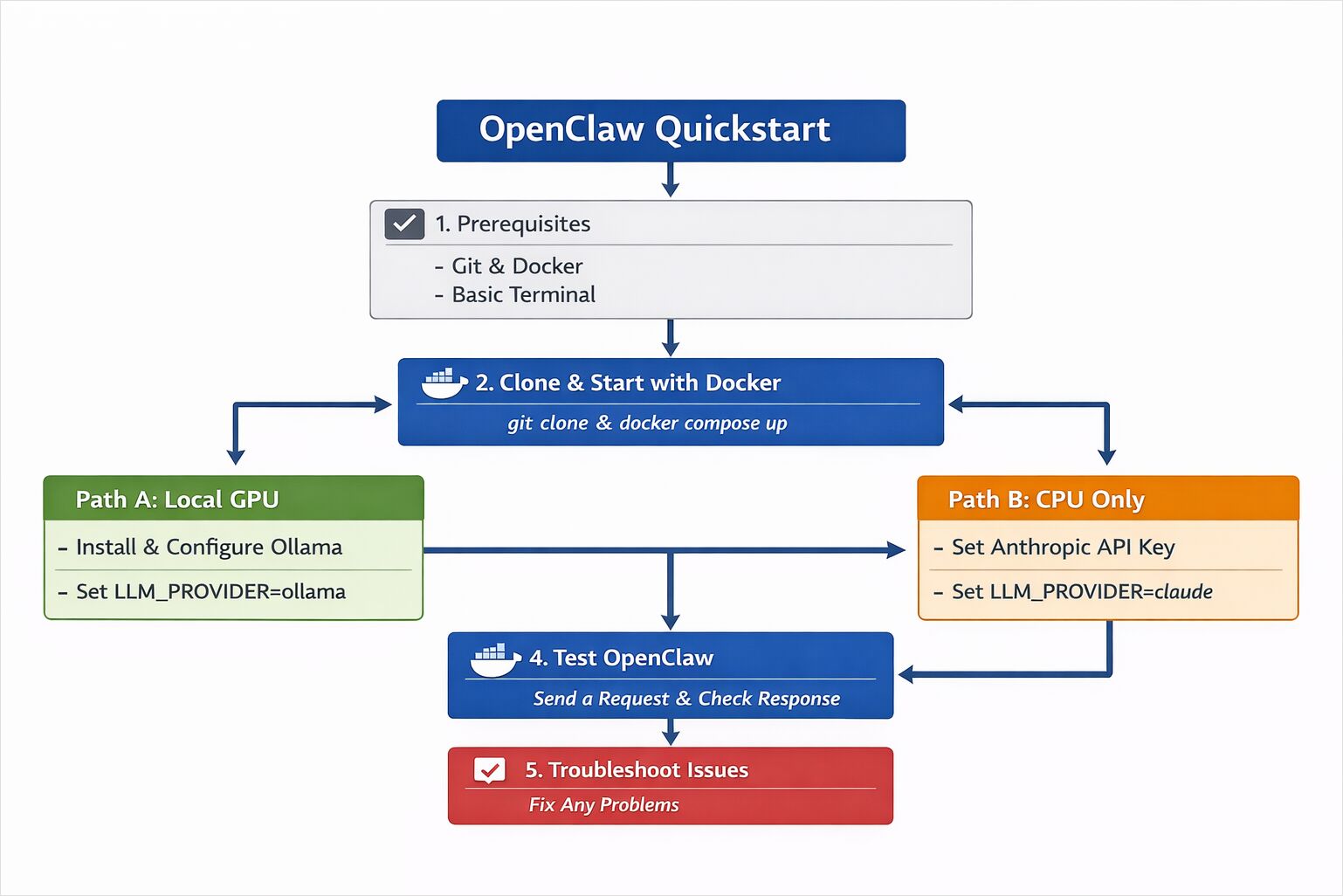

Deze quickstart laat zien hoe je OpenClaw kunt implementeren met behulp van Docker, hoe je een GPU-gevoede lokale model of een CPU-only cloudmodel kunt configureren, en hoe je kunt controleren of je AI-assistent correct werkt van eind tot eind.

Deze gids leidt je door een minimale opzet van OpenClaw, zodat je het kunt zien draaien en reageren op jouw eigen machine.

Het doel is eenvoudig:

- OpenClaw draaien.

- Een aanvraag sturen.

- Bevestigen dat het werkt.

Dit is geen gids voor productiehardening.

Dit is geen gids voor prestatieoptimalisatie.

Dit is een praktische startpunt.

Je hebt twee opties:

- Pad A — Lokale GPU met Ollama (aanbevolen als je een GPU hebt)

- Pad B — Alleen CPU met Claude Sonnet 4.6 via de Anthropic API

Beide paden delen hetzelfde kerninstallatieproces.

Als je nieuw bent bij OpenClaw en je wilt een dieper overzicht van hoe het systeem is opgebouwd, lees dan de OpenClaw systeemoverzicht.

Systeemvereisten en omgevingsopstelling

OpenClaw is een assistentstijl systeem dat kan verbinden met externe diensten. Voor deze Quickstart:

- Gebruik testaccounts waar mogelijk.

- Vermijd het verbinden met gevoelige productiesystemen.

- Voer het uit binnen Docker (aanbevolen).

Isolatie is een goede standaard bij het experimenteren met agentstijl software.

OpenClaw Voorwaarden (GPU met Ollama of CPU met Claude)

Vereist voor Beide Paden

- Git

- Docker Desktop (of Docker + Docker Compose)

- Een terminal

Voor Pad A (Lokale GPU)

- Een machine met een compatibele GPU (NVIDIA of AMD aanbevolen)

- Ollama geïnstalleerd

Voor Pad B (CPU + Cloudmodel)

- Een Anthropic API-sleutel

- Toegang tot Claude Sonnet 4.6

Stap 1 — Installeer OpenClaw met Docker (Kloon & Start)

OpenClaw kan worden gestart met Docker Compose. Dit houdt de opstelling gericht en herhaalbaar.

Kloon de repository

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Kopieer omgevingsconfiguratie

cp .env.example .env

Open .env in je editor. We zullen het configureren in de volgende stap

afhankelijk van het modelpad dat je kiest.

Start de containers

docker compose up -d

Als alles correct is gestart, zie je containers die draaien:

docker ps

Op dit moment draait OpenClaw — maar het is nog niet verbonden met een model.

Stap 2 — Configureer LLM Provider (Ollama GPU of Claude CPU)

Beslis nu hoe je wilt dat de inferentie werkt.

Pad A — Lokale GPU met Ollama

Als je een GPU beschikbaar hebt, is dit de eenvoudigste en meest zelfstandige optie.

Installeer of Controleer Ollama

Als je een gedetailleerde installatiegids nodig hebt of wil configureren van modelopslaglocaties, zie:

- Installeer Ollama en Configureer Modellocatie

- Ollama CLI Cheat Sheet: ls, serve, run, ps + andere commando’s (2026 update)

Als Ollama niet is geïnstalleerd:

curl -fsSL https://ollama.com/install.sh | sh

Controleer of het werkt:

ollama pull llama3

ollama run llama3

Als het model reageert, werkt de inferentie.

Configureer OpenClaw om Ollama te gebruiken

In je .env-bestand, configureer:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Herstart de containers:

docker compose restart

OpenClaw zal nu aanvragen doorsturen naar je lokale Ollama-instantie.

Als je beslist welk model je op een 16GB GPU wilt draaien of wil zien vergelijkingsbenchmarks, zie:

Om te begrijpen hoe concurrentie en CPU gedrag onder belasting werkt:

- Hoe Ollama Parallelle Aanvragen Verwerkt

- Test: Hoe Ollama Intel CPU Prestaties en Efficiënte Kernen Gebruikt

Pad B — Alleen CPU met Claude Sonnet 4.6

Als je geen GPU hebt, kun je een gehoste model gebruiken.

Voeg je API-sleutel toe

In je .env-bestand:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Herstart:

docker compose restart

OpenClaw zal nu Claude Sonnet 4.6 gebruiken voor inferentie terwijl de orchestratie lokaal draait.

Deze opstelling werkt goed op CPU-only machines omdat de zware modelberekeningen in de cloud plaatsvinden.

Stap 3 — Test OpenClaw met Je Eerste Prompt

Zodra de containers draaien en het model is geconfigureerd, kun je de assistent testen.

Afhankelijk van je opstelling, kan dit via:

- Een webinterface

- Een berichtenintegratie

- Een lokale API-eindpunt

Voor een basis API-test:

curl http://localhost:3000/health

Je moet een gezonde statusreactie zien.

Stuur nu een eenvoudige prompt:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Leg uit wat OpenClaw doet in eenvoudige termen."}'

Als je een gestructureerde reactie ontvangt, werkt het systeem.

Wat Je Net hebt Gedaan

Op dit moment heb je:

- Een draaiende OpenClaw-instantie

- Een geconfigureerde LLM-provider (lokale of cloud)

- Een werkende aanvraag-antwoordlus

Als je het GPU-pad hebt gekozen, gebeurt de inferentie lokaal via Ollama.

Als je het CPU-pad hebt gekozen, gebeurt de inferentie via Claude Sonnet 4.6, terwijl de orchestratie, routing en geheugenbeheer lokaal in jouw Docker containers draaien.

De zichtbare interactie kan er eenvoudig uitzien. Onder de oppervlakte coördineren meerdere componenten om jouw aanvraag te verwerken.

Probleemoplossing voor OpenClaw Installatie en Runtime Problemen

Model Reageert Niet

- Controleer je

.envconfiguratie. - Controleer containerlogboeken:

docker compose logs

Ollama Niet Bereikbaar

- Bevestig dat Ollama draait:

ollama list

- Zorg dat de basis-URL overeenkomt met jouw omgeving.

Ongeldige API-sleutel

- Controleer

ANTHROPIC_API_KEYopnieuw. - Herstart containers na het bijwerken van

.env

GPU Wordt Niet Gebruikt

- Bevestig dat GPU-gebruikersdrivers zijn geïnstalleerd.

- Zorg dat Docker toegang heeft tot de GPU.

Volgende Stappen Na het Installeren van OpenClaw

Je hebt nu een werkende OpenClaw-instantie.

Vanaf hier kun je:

- Messagingplatforms verbinden

- Documentophaal inschakelen

- Experimenten doen met routingstrategieën

- Observabiliteit en metrieken toevoegen

- Prestaties en kosten gedrag afstemmen

De diepere architecturale besprekingen maken meer zin als het systeem draait.

Het systeem operationeel maken is de eerste stap.