Chatinterface voor lokale Ollama-instanties

Korte overzicht van de meest opvallende UI's voor Ollama in 2025

Locally geïnstalleerde Ollama maakt het mogelijk om grote taalmodellen op je eigen computer te draaien, maar het gebruik ervan via de opdrachtnaam is niet gebruikersvriendelijk. Hieronder vind je verschillende open-source projecten die ChatGPT-stijl interfaces bieden die verbinding maken met een lokale Ollama.

Deze UI’s ondersteunen conversatief chatten, vaak met functies zoals document upload voor retrieval-augmented generation (RAG), en draaien als web- of desktoptoepassingen. Hieronder volgt een vergelijking van belangrijke opties, gevolgd door gedetailleerde secties over elk van hen. Voor een breder overzicht van hoe lokale Ollama past bij vLLM, Docker Model Runner, LocalAI en cloudproviders – inclusief kosten- en infrastructuurcompromissen – zie LLM Hosting: Local, Self-Hosted & Cloud Infrastructure Compared.

Vergelijking van Ollama-compatibele UI’s

| UI Tool | Platform | Documentondersteuning | Ollama-integratie | Sterktes | Beperkingen |

|---|---|---|---|---|---|

| Page Assist | Browseruitbreiding (Chrome, Firefox) | Ja – bestanden toevoegen voor analyse | Verbindt met lokale Ollama via uitbreidingsconfiguratie | In-browser chat; eenvoudige beheer van modellen en integratie met webpagina context. | Alleen in de browser; vereist installatie/configuratie van een uitbreiding. |

| Open WebUI | Webtoepassing (zelfgehost; Docker/PWA) | Ja – ingebouwde RAG (bestanden uploaden of toevoegen aan bibliotheek) | Directe Ollama API-ondersteuning of gebundelde server (configuratie basis-URL) | Uitgebreide functies (meerdere LLM, offline, afbeeldingengeneratie); mobielvriendelijk (PWA). | Setup is zwaarder (Docker/K8s); brede scope kan overkill zijn voor eenvoudig gebruik. |

| LobeChat | Webtoepassing (zelfgehost; PWA-ondersteuning) | Ja – “Knowledge Base” met bestandupload (PDF, afbeeldingen, etc.) | Ollama wordt ondersteund als één van meerdere AI-backends (vereist inschakelen van Ollama’s API-toegang) | Slechte ChatGPT-achtige UI; stemchat, plugins en ondersteuning voor meerdere modellen. | Complexe functie-set; vereist omgevingsinstellingen (bijv. cross-origin voor Ollama). |

| LibreChat | Webtoepassing (zelfgehost; meervoudige gebruiker) | Ja – “Chat met bestanden” met RAG (via embeddings) | Compatibel met Ollama en veel andere providers (switchable per chat) | Bekende ChatGPT-stijl interface; rijke functies (agents, code interpreter, etc.). | Installatie/configuratie kan ingewikkeld zijn; groot project kan meer zijn dan nodig voor basisgebruik. |

| AnythingLLM | Desktoptoepassing (Windows, Mac, Linux) of web (Docker) | Ja – ingebouwde RAG: sleep en neem documenten (PDF, DOCX, etc.) met citaten | Ollama wordt ondersteund als een LLM-provider (instellen in configuratie of Docker-omgeving) | Alles-in-een UI (privé ChatGPT met jouw documenten); geen code agent builder, meervoudige gebruikersondersteuning. | Hogere bronverbruik (embeddings DB, etc.); desktoptoepassing mist enkele meervoudige gebruikersfuncties. |

| Chat-with-Notes | Webtoepassing (lichtgewicht Flask-server) | Ja – upload tekst/PDF-bestanden en chatten met hun inhoud | Gebruikt Ollama voor alle AI-antwoorden (vereist dat Ollama lokaal draait) | Zeer eenvoudige setup en interface gericht op document Q&A; gegevens blijven lokaal. | Basale UI en functionaliteit; enkel gebruiker, één document tegelijk (geen geavanceerde functies). |

Elk van deze tools is actief onderhouden en open-source. Nu gaan we in op details van elk van de opties, inclusief hoe ze werken met Ollama, opvallende functies en compromissen.

Page Assist (Browseruitbreiding)

Page Assist is een open-source browseruitbreiding die lokale LLM chat naar je browser brengt. Het ondersteunt Chromium-gebaseerde browsers en Firefox, met een ChatGPT-achtige zijbalk of tab waarin je met een model kunt converseren. Page Assist kan verbinding maken met lokale Ollama als de AI-provider, of andere lokale backends, via zijn instellingen. Opvallend is dat het je toestaat om bestanden (bijvoorbeeld PDFs of tekst) toe te voegen zodat de AI binnen de chat kan analyseren, waardoor basis RAG workflows mogelijk zijn. Je kunt het zelfs laten helpen met de inhoud van de huidige webpagina of webzoeken uitvoeren voor informatie.

De setup is eenvoudig: installeer de uitbreiding van de Chrome Web Store of Firefox Add-ons, zorg dat Ollama draait, en selecteer Ollama als de lokale AI-provider in de instellingen van Page Assist. De interface bevat functies zoals chatgeschiedenis, modelkeuze en een optionele deelbare URL voor je chatresultaten. Er is ook een webinterface beschikbaar via een toetsenbordkorteling als je een volledige tab chatervaring prefereert.

Sterktes: Page Assist is lichtgewicht en handig – omdat het in de browser leeft, is er geen aparte server om te draaien. Het is ideaal voor browsen (je kunt het op elk webpagina openen) en ondersteunt internetzoekintegratie en bestandstoegang om de conversatie te verrijken. Het biedt ook handige functies zoals toetsenbordkortingen voor nieuwe chat en wisselen van de zijbalk.

Beperkingen: Als uitbreiding is het beperkt tot een browseromgeving. De UI is eenvoudiger en iets minder functierijk dan volledige standalone chattoepassingen. Bijvoorbeeld, meervoudige gebruikersbeheer of geavanceerde agentplugins zijn niet in het bereik. Ook kan de initiële setup vereisen dat je de uitbreiding bouwt/laadt als er geen vooraf gebouwde versie beschikbaar is voor je browser (het project biedt bouw instructies met Bun of npm). Over het algemeen is Page Assist het beste voor individueel gebruik wanneer je snel toegang wilt tot Ollama-gemotoriseerde chat tijdens het webbrowsen, met matige RAG mogelijkheden.

Open WebUI (Zelfgehoste webtoepassing)

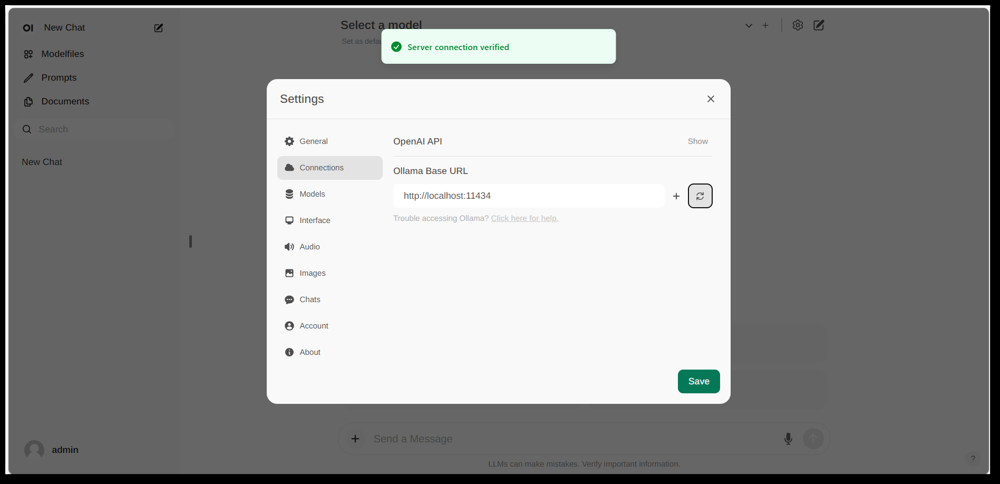

Open WebUI’s instellingeninterface, tonend een Ollama-verbinding die is geconfigureerd (basis-URL ingesteld op de lokale Ollama API). De UI bevat een Documentsectie, waardoor RAG workflows mogelijk zijn.

Open WebUI is een krachtige, algemene chatfront-end die oorspronkelijk is gemaakt om te werken met Ollama, en nu uitgebreid is om verschillende LLM-backends te ondersteunen. Het draait als een zelfgehoste webtoepassing en wordt meestal geïmplementeerd via Docker of Kubernetes voor gemakkelijke setup. Zodra het draait, bereik je het via je browser (met ondersteuning voor het installeren als een Progressive Web App op mobiele apparaten).

Open WebUI biedt een volledige chatinterface met meervoudige gebruikersondersteuning, modelbeheer en uitgebreide functies. Belangrijk is dat het ingebouwde RAG-vereisten heeft – je kunt bestanden uploaden of importeren in een documentbibliotheek en dan vragen stellen met ophalen van gegevens. De interface laat toe om documenten direct in een chatgesprek te laden of een blijvende bibliotheek van kennis te onderhouden. Het ondersteunt zelfs het uitvoeren van webzoeken en het injecteren van resultaten in het gesprek voor up-to-date informatie.

Ollama-integratie: Open WebUI verbindt met Ollama via de API. Je kunt ofwel de Open WebUI Docker-container naast een Ollama-server draaien en een omgevingsvariabele instellen om naar de Ollama-URL te verwijzen, of een speciale Docker-image gebruiken die Ollama bundelt met de webinterface. In de praktijk, na het starten van de containers, bezoek je Open WebUI in je browser en zie je “Server connection verified” als het correct is geconfigureerd (zoals weergegeven in de afbeelding hierboven). Dit betekent dat de UI gereed is om je lokale Ollama-modellen te gebruiken voor chat. Open WebUI ondersteunt ook OpenAI API-compatibele eindpunten, dus het kan interface met LM Studio, OpenRouter, enz., naast Ollama.

Sterktes: Dit is een van de meest functierijke en flexibele UI’s. Het ondersteunt meerdere gelijktijdige modellen en conversatiegedeeltes, aangepaste “personages” of systeemprompts, afbeeldingengeneratie, en meer. De RAG-implementatie is robuust – je krijgt een volledige UI voor het beheren van documenten en zelfs het configureren van welk vectoropslag- of zoekservice moet worden gebruikt voor ophalen. Open WebUI wordt ook actief ontwikkeld (met een uitgebreide gemeenschap, zoals aangegeven door zijn hoge sterrencijfer op GitHub) en is ontworpen voor uitbreidbaarheid en schaalbaarheid. Het is een goede keuze als je een uitgebreid, alles-in-één chatinterface zoekt voor lokale modellen, vooral in een scenario met meerdere gebruikers of complexe toepassingen.

Beperkingen: Met grote kracht komt ook grotere complexiteit. Open WebUI kan overkill zijn voor eenvoudig persoonlijk gebruik – het installeren van Docker-containers en het beheren van de configuratie kan intimiderend zijn als je niet bekend bent met dit. Het verbruikt meer bronnen dan een lichtgewicht toepassing, omdat het een webserver draait, optionele database voor chatgeschiedenis, enz. Ook, functies zoals rolgebaseerd toegangsbeheer en gebruikersbeheer, terwijl nuttig, duiden erop dat het is gericht op een serveropstelling – een enkele gebruiker op een thuiscomputer zou mogelijk niet allemaal nodig hebben. Kortom, de setup is zwaarder en de interface kan zich complex voelen als je alleen een basis ChatGPT-klon wilt. Maar voor diegenen die wel de breedte van functies nodig hebben (of willen wisselen tussen Ollama en andere modelproviders in één UI), is Open WebUI een topkandidaat.

LobeChat (ChatGPT-achtig kader met plugins)

LobeChat interface banner tonend “Ollama Supported” en meerdere lokale modellen. LobeChat laat je een glanzende ChatGPT-achtige webtoepassing implementeren met Ollama of andere providers, met functies zoals steminput en plugins.

LobeChat is een open-source chatkader dat een verfijnde gebruikerservaring en flexibiliteit benadrukt. Het is essentieel een ChatGPT-achtige webtoepassing die je zelf kunt hosten, met ondersteuning voor meerdere AI-providers – van OpenAI en Anthropic tot open modellen via Ollama. LobeChat is ontworpen met privacy in gedachten (je draait het zelf) en heeft een moderne interface die conveniences bevat zoals conversatiegeheugen, stemgesprekmodus en zelfs tekst-naar-afbeeldingsgeneratie via plugins.

Een van de belangrijkste functies van LobeChat is zijn Knowledge Base mogelijkheid. Je kunt documenten uploaden (in formaten zoals PDFs, afbeeldingen, audio, video) en een knowledge base aanmaken die kan worden gebruikt tijdens het chatgesprek. Dit betekent dat je vragen kunt stellen over de inhoud van je bestanden – een RAG workflow die LobeChat standaard ondersteunt. De UI biedt beheer van deze bestanden/knowledge bases en toont hun gebruik in het gesprek, waardoor een rijkere Q&A ervaring mogelijk is dan de basis LLM.

Om LobeChat te gebruiken met Ollama, zul je de LobeChat-app implementeren (bijvoorbeeld via een meegeleverde Docker-image of script) en Ollama configureren als de backend. LobeChat herkent Ollama als een eerste klasse provider – het biedt zelfs een een-klik-implementatiescript via de Pinokio AI-browser als je dat gebruikt. In de praktijk zul je mogelijk Ollama’s instellingen moeten aanpassen (zoals het inschakelen van CORS zoals beschreven in LobeChat’s documentatie) zodat LobeChat’s webfrontend toegang kan krijgen tot de Ollama HTTP API. Zodra geconfigureerd, kun je een Ollama-gestuurde model kiezen in de LobeChat UI en er met hem converseren, inclusief het queryen van je geüploade documenten.

Sterktes: LobeChat’s UI wordt vaak geprezen voor zijn schoon en gebruikersvriendelijke uitstraling, dicht bij de look and feel van ChatGPT (wat adoptie kan vergemakkelijken). Het voegt waarde toe met extra’s zoals steminput/output voor gesproken conversaties en een plug-insysteem om functionaliteit uit te breiden (gelijk aan ChatGPT’s plugins, waardoor dingen mogelijk zijn zoals webbrowsing of afbeeldingengeneratie). Meervoudige modelondersteuning betekent dat je gemakkelijk tussen, bijvoorbeeld, een Ollama lokale model en een OpenAI API model kunt wisselen binnen dezelfde interface. Het ondersteunt ook installatie als een mobielvriendelijke PWA, dus je kunt je lokale chat op de goeie tijd bereiken.

Beperkingen: Het instellen van LobeChat kan complexer zijn dan enkele alternatieven. Het is een full-stack toepassing (vaak uitgevoerd met Docker Compose), dus er is wat overhead. In het bijzonder vereist het instellen van Ollama-integratie het inschakelen van cross-origin requests aan de kant van Ollama en het zorgen dat poorten overeenkomen – een eenmalige taak, maar technisch. Bovendien, terwijl LobeChat zeer krachtig is, zijn niet alle functies mogelijk nodig voor elke gebruiker; bijvoorbeeld, als je geen meervoudige providerondersteuning of plugins nodig hebt, kan de interface zich overbelast voelen vergeleken met een minimale tool. Tot slot, bepaalde geavanceerde functies zoals de een-klik-implementatie veronderstellen specifieke omgevingen (Pinokio-browser of Vercel), die je wel of niet gebruikt. Over het algemeen is LobeChat ideaal als je een volledig uitgeruste ChatGPT-achtige alternatief wilt dat lokaal draait met Ollama, en je geen probleem hebt met een beetje initiële configuratie om daar te komen.

LibreChat (ChatGPT-klon met meervoudige providerondersteuning)

LibreChat (vormelijk bekend als ChatGPT-Clone of UI) is een open-source project dat gericht is op het repliceren en uitbreiden van de ChatGPT-interface en functionaliteit. Het kan lokaal worden geïmplementeerd (of op je eigen server) en ondersteunt een verscheidenheid aan AI-backends – inclusief open-source modellen via Ollama. Essentieel biedt LibreChat de vertrouwde chatervaring (gespreksinterface met geschiedenis, gebruikers- en assistentberichten) terwijl het je toestaat om verschillende modelproviders in de backend te koppelen.

LibreChat ondersteunt documentinteractie en RAG via een add-on genaamd de RAG API en embeddingdiensten. In de interface kun je functies gebruiken zoals “Chat met Bestanden”, wat je toestaat om documenten te uploaden en dan vragen over hen te stellen. Aan de achterkant gebruikt dit embeddings en een vectoropslag om relevante context uit je bestanden op te halen. Dit betekent dat je een vergelijkbare effect bereikt met ChatGPT + aangepaste kennis, alles lokaal. Het project biedt zelfs een aparte repo voor de RAG-service als je die zelf wilt hosten.

Het gebruik van LibreChat met Ollama vereist meestal het draaien van de LibreChat-server (bijvoorbeeld via Node/Docker) en het zorgen dat het kan bereiken van de Ollama-service. LibreChat heeft een “Aangepast Eindpunt” instelling waarin je een OpenAI-compatibele API-URL kunt invoeren. Aangezien Ollama een lokale API kan blootstellen die compatibel is met OpenAI, kan LibreChat worden gericht op http://localhost:11434 (of waar Ollama luistert). In feite, LibreChat vermeldt Ollama expliciet onder zijn ondersteunde AI-providers – naast anderen zoals OpenAI, Cohere, enz. Zodra geconfigureerd, kun je het model (Ollama’s model) kiezen in een dropdown en chatten. LibreChat ondersteunt ook het wisselen van modellen of providers tijdens het gesprek en ondersteunt meervoudige chatvoorinstellingen/contexts.

Sterktes: De primaire voordelen van LibreChat zijn de rijke set van functies gebouwd rond de chatervaring. Het bevat dingen zoals gespreksverzakkingen, berichtzoeken, ingebouwde Code Interpreter ondersteuning (veilig sandboxed codeuitvoering), en tool/agent-integraties. Het is essentieel ChatGPT++, met de mogelijkheid om lokale modellen te integreren. Voor iemand die de UI van ChatGPT leuk vindt, zal LibreChat zeer vertrouwd voelen en vereist weinig leercurve. Het project is actief en gemeenschapsgericht (zoals blijkt uit zijn frequent updates en discussies), en het is zeer flexibel: je kunt verbinding maken met veel soorten LLM-eindpunten of zelfs draaien met meervoudige gebruikers met authenticatie voor een teaminstelling.

Beperkingen: Met zijn veel functies kan LibreChat zwaarder zijn om te draaien. De installatie kan het instellen van een database voor het opslaan van gesprekken en het configureren van omgevingsvariabelen voor verschillende APIs vereisen. Als je alle componenten inschakelt (RAG, agents, afbeeldingengeneratie, enz.), is het een vrij complexe stack. Voor een enkele gebruiker die alleen een basischat met één lokale model nodig heeft, kan LibreChat meer zijn dan nodig. Bovendien, terwijl de UI vertrouwd is, is het niet zeer gespecialiseerd voor document QA – het doet het werk maar mist een specifieke “documentbibliotheek” interface (uploads worden meestal uitgevoerd binnen een chat of via API). Kortom, LibreChat straalt als je een volledig ChatGPT-achtige omgeving met een reeks functies wilt die lokaal draait, maar eenvoudigere oplossingen kunnen voldoen voor nauwer gefocuste gebruiksscenario’s.

AnythingLLM (Alles-in-een desktop- of serverapplicatie)

AnythingLLM is een alles-in-een AI-toepassing die RAG en eenvoudig gebruik benadrukt. Het laat je “chatten met je documenten” via open-source LLMs of zelfs OpenAI’s modellen, alles via één geïntegreerde interface. Opvallend is dat AnythingLLM beschikbaar is als een cross-platform desktopapplicatie (voor Windows, Mac, Linux) en als een zelfgehoste webserver (via Docker). Deze flexibiliteit betekent dat je het kunt draaien als een normale toepassing op je pc, of implementeren voor meerdere gebruikers op een server.

Documentbehandeling is het kernstuk van AnythingLLM. Je kunt bestanden drag-and-drop (PDF, TXT, DOCX, enz.) in de app, en het zal ze automatisch indexeren in een vectordatabase (het heeft LanceDB standaard). In de chatinterface, wanneer je vragen stelt, zal het relevante stukken uit je documenten ophalen en verwijsde antwoorden geven, zodat je weet welk bestand en welk gedeelte de informatie komt van. Essentieel bouwt het een prive kennisbank voor je en laat het LLM gebruiken als context. Je kunt documenten organiseren in “workspaces” (bijvoorbeeld één workspace per project of onderwerp), isolerend contexten waar nodig.

Het gebruik van Ollama met AnythingLLM is eenvoudig. In de configuratie kies je Ollama als de LLM-provider. Als je via Docker draait, stel je omgevingsvariabelen in zoals LLM_PROVIDER=ollama en geef je de OLLAMA_BASE_PATH (de URL naar je Ollama-instantie). De AnythingLLM-server zal dan alle modelvragen naar de Ollama API sturen. Ollama wordt officieel ondersteund, en de documentatie noemt dat je het kunt gebruiken om verschillende open modellen (zoals Llama 2, Mistral, enz.) lokaal te draaien. In feite benadrukken de ontwikkelaars dat het combineren van AnythingLLM met Ollama krachtige offline RAG mogelijkheden ontketent: Ollama verwerkt de modelinference, en AnythingLLM verwerkt embeddings en de UI/agentlogica.

Sterktes: AnythingLLM biedt een comprehensieve oplossing voor privé Q&A en chat. Belangrijke sterktes zijn: eenvoudige setup voor RAG (de zware werkzaamheden van embedding en opslag van vectors zijn geautomatiseerd), meervoudige documentondersteuning met duidelijke bronvermelding, en extra functies zoals AI Agents (het heeft een no-code agent builder waarin je aangepaste workflows en toolgebruik kunt maken). Het is ook meervoudig gebruikersvriendelijk (vooral in servermodus), met gebruikersaccounts en toegangsrechten indien nodig. De interface is ontworpen om eenvoudig te zijn (chattbox + zijbalk van documenten/workspaces) maar krachtig onder de kappe. Voor persoonlijk gebruik is de desktopapp een groot voordeel – je krijgt een native-gevoelde app zonder dat je een browser of opdrachten hoeft te openen, en het slaat gegevens standaard lokaal op.

Beperkingen: Omdat het veel componenten integreert (LLM API, embeddingmodellen, vector DB, enz.), kan AnythingLLM bronintensief zijn. Wanneer je documenten verwerkt, kan het tijd en geheugen kosten om embeddings te genereren (het ondersteunt zelfs het gebruik van Ollama of lokale modellen voor embeddings met modellen zoals nomic-embed). De desktopapp vereenvoudigt het gebruik, maar als je veel documenten of zeer grote bestanden hebt, verwacht dan zware verwerking in de achtergrond. Een andere beperking is dat geavanceerde gebruikers het mogelijk minder configureerbaar vinden dan hun eigen stack samen te stellen – bijvoorbeeld, het gebruikt momenteel LanceDB of Chroma; als je een ander vectoropslag wilt, moet je in de configuratie of code duiken. Ook, terwijl meervoudige providers worden ondersteund, is de interface echt gericht op één model tegelijk (je zou de globale providerinstelling moeten wisselen als je een ander model wilt gebruiken). Kortom, AnythingLLM is een uitstekende uit de doos oplossing voor lokale documentchat, vooral met Ollama, maar het is een grotere toepassing om te draaien vergeleken met minimale UI’s.

Chat-with-Notes (Minimale documentchat UI)

Chat-with-Notes is een minimalistische toepassing die specifiek is ontworpen om met lokale tekstbestanden te chatten via Ollama-gestuurde modellen. Het is essentieel een lichtgewicht Flask-webserver die je op je PC draait, die een eenvoudige webpagina biedt waarop je een document kunt uploaden en een chat over het beginnen. Het doel van dit project is eenvoudigheid: het heeft niet veel klinkers en whistles, maar het doet de kernwerk van documentvraag-antwoord met een lokale LLM.

Het gebruik van Chat-with-Notes vereist eerst dat je je Ollama-instantie een model draait (bijvoorbeeld, je zou Ollama kunnen starten met ollama run llama2 of een ander model). Vervolgens start je de Flask-app (python app.py) en open je de lokale website. De UI zal je vragen om een bestand te uploaden (ondersteunde formaten omvatten platte tekst, Markdown, codebestanden, HTML, JSON en PDFs). Zodra geüpload, wordt de tekstinhoud van het bestand weergegeven, en je kunt vragen stellen of met de AI over die inhoud chatten. Het gesprek gebeurt in een typische chatbubble-formaat. Als je een nieuw bestand upload tijdens een gesprek, zal de app vragen of je een frisse chat wil starten of de huidige chatcontext behouden en alleen de informatie van het nieuwe bestand toevoegen. Op die manier kun je nodig zijn om meerdere bestanden op rij te bespreken. Er zijn ook knoppen om de chat te wissen of het gesprek te exporteren naar een tekstbestand.

Achter de schermen queryt Chat-with-Notes de Ollama API voor het genereren van antwoorden. Ollama verwerkt de modelinference, en Chat-with-Notes levert alleen het prompt (wat relevante delen van de geüploade tekst bevat). Het gebruikt geen vectordatabase; in plaats daarvan stuurt het gewoon de volledige bestandsinhoud (of stukken daarvan) samen met je vraag naar het model. Deze aanpak werkt het beste voor redelijk grote documenten die passen in de contextwindow van het model.

Sterktes: De app is extreem eenvoudig in te stellen en te gebruiken. Er is geen ingewikkelde configuratie – als je Python en Ollama hebt ingesteld, kun je het in een paar minuten draaien. De interface is schoon en minimalistisch, met een focus op de tekstinhoud en het Q&A. Omdat het zo gericht is, zorgt het ervoor dat alle gegevens lokaal blijven en alleen in het geheugen (geen externe oproepen behalve naar Ollama op localhost). Het is een goede keuze als je specifiek wilt chatten met bestanden en geen algemene conversatie zonder een document nodig hebt.

Beperkingen: De minimalisme van Chat-with-Notes betekent dat het veel functies mist die je in andere UIs vindt. Bijvoorbeeld, het ondersteunt geen gebruik van meerdere modellen of providers (het is per ontwerp alleen Ollama), en het onderhoudt geen lange termijnbibliotheek van documenten – je uploadt bestanden per sessie als nodig, en er is geen blijvende vectorindex. Schalen naar zeer grote documenten kan lastig zijn zonder handmatige aanpassingen, aangezien het mogelijk veel tekst in het prompt wil opnemen. Ook, terwijl de UI functioneel is, is het niet zo geslepen (geen donkere modus, geen rijke tekstformattering van antwoorden, enz.). In essentie is dit gereedschap ideaal voor snelle, eenmalige analyses van bestanden met een Ollama-model. Als je behoeften groeien (bijvoorbeeld veel documenten, of een fijnere UI), dan kun je Chat-with-Notes overgroeien. Maar als een startpunt of een persoonlijk “vraag mijn PDF” oplossing boven op Ollama, is het zeer effectief.

Conclusie

Elke van deze open-source UI’s kan je ervaring met lokale Ollama-modellen verbeteren door een gebruikersvriendelijke chatinterface en extra functionaliteiten zoals documentvraag-antwoord. De beste keuze hangt af van je eisen en technische comfort:

- Voor snelle setup en browsergebruik: Page Assist is een goede keuze, die direct in je webbrowsen integreert met minimale moeite.

- Voor een uitgebreide webapp-omgeving: Open WebUI of LibreChat bieden uitgebreide functies en meervoudige modelflexibiliteit, geschikt voor powergebruikers of meervoudige gebruikersopstellingen.

- Voor een verfijnde ChatGPT-achtige alternatief met pluginpotentieel: LobeChat biedt een mooi evenwicht van gebruikersvriendelijkheid en functies in een zelfgehoste pakket.

- Voor documentgerichte interacties: AnythingLLM biedt een alles-in-een oplossing (vooral als je een desktopapp wil), terwijl Chat-with-Notes een minimalistische aanpak biedt voor enkelvoudige document Q&A.

Aangezien alle deze tools actief worden onderhouden, kun je ook rekenen op verbeteringen en gemeenschapsondersteuning. Door één van deze UI’s te kiezen, zul je in een handige manier kunnen chatten met je lokale Ollama-gestuurde modellen – of het nu gaat om documentanalyse, coderen met hulp of gewoon conversatieve AI beschikbaar zonder cloudafhankelijkheid. Elke oplossing hierboven is open-source, dus je kunt ze verder aanpassen aan jouw behoeften of zelfs bijdragen aan hun ontwikkeling. Om te zien hoe lokale Ollama plus deze UI’s past bij andere lokale en cloudopties, raadpleeg onze LLM Hosting: Local, Self-Hosted & Cloud Infrastructure Compared gids.

Veel plezier met chatten met je lokale LLM!