Ollama-modellen naar een andere locatie verplaatsen

Ollama LLM-modelbestanden nemen veel ruimte in beslag.

Na het installeren van Ollama is het beter om Ollama direct opnieuw te configureren om de modellen op een nieuwe locatie op te slaan. Zodat wanneer we een nieuw model ophalen, deze niet naar de oude locatie wordt gedownload.

Over Ollama

Ollama is een tekstgebaseerde frontend voor LLM AI-modellen en een API die deze ook kan hosten. Voor een bredere vergelijking van Ollama met vLLM, Docker Model Runner, LocalAI en cloudproviders – inclusief kosten- en infrastructuuroverwegingen – zie LLM Hosting: Lokaal, Self-Hosted & Cloud Infrastructuur vergeleken.

Ollama installeren

Ga naar https://ollama.com/download

Om Ollama op Linux te installeren:

curl -fsSL https://ollama.com/install.sh | sh

Ollama op Windows is te vinden op de pagina: https://ollama.com/download/windows Ollama voor Mac is ook daar beschikbaar: https://ollama.com/download/macOllamaSetup.exe

Ollama-modellen downloaden, tonen en verwijderen

Om Ollama-modellen te downloaden: Ga naar de Ollama-bibliotheek (https://ollama.com/library) en zoek het model dat je nodig hebt, daar kun je ook modeltags en -groottes vinden.

Voer vervolgens uit:

ollama pull gemma2:latest

# Of haal een iets slimmer model dat nog net in 16GB VRAM past:

ollama pull gemma2:27b-instruct-q3_K_S

# Of:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

Om te controleren welke modellen Ollama in de lokale repository heeft:

ollama list

Om een onnodig model te verwijderen:

ollama rm qwen2:7b-instruct-q8_0 # bijvoorbeeld

Ollama-modellocatie

Standaard worden de modelbestanden opgeslagen op:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

Dezelfde opslagoverweging komt naar voren als Ollama in containers draait: je wilt modellen en serverstatus op een genoemd volume of bind mount (en optioneel OLLAMA_MODELS als de lay-out moet verschillen van het standaardpad /root/.ollama in de officiële image). Voor een volledige Compose-layout met GPU-reservering, OLLAMA_HOST, upgrades en rollback-patronen, zie Ollama in Docker Compose met GPU en persistente modelopslag.

Ollama-modellenpad configureren op Windows

Om een omgevingsvariabele op Windows aan te maken, kun je deze instructies volgen:

- Open Windows-instellingen.

- Ga naar Systeem.

- Selecteer Over.

- Selecteer Geavanceerde systeeminstellingen.

- Ga naar het tabblad Geavanceerd.

- Selecteer Omgevingsvariabelen….

- Klik op Nieuw…

- En maak een variabele genaamd OLLAMA_MODELS aan die verwijst naar de locatie waar je de modellen wilt opslaan

Ollama-modellen verplaatsen op Linux

Bewerk de Ollama systemd-serviceparameters

sudo systemctl edit ollama.service

of

sudo xed /etc/systemd/system/ollama.service

Dit opent een editor.

Voeg voor elke omgevingsvariabele een regel Environment toe onder sectie [Service]:

[Service]

Environment="OLLAMA_MODELS=/specialeplek/ollama/models"

Sla op en sluit af.

Er zijn ook User- en Group-params; deze moeten toegang hebben tot deze map.

Laad systemd opnieuw in en herstart Ollama:

sudo systemctl daemon-reload

sudo systemctl restart ollama

Als er iets misgaat:

systemctl status ollama.service

sudo journalctl -u ollama.service

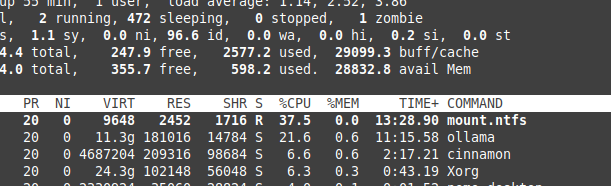

Opslagoverhead op NTFS

Wees er bewust van dat als je Linux draait en je modellen op een NTFS-geformatteerde partitie bewaart, je modellen veel langzamer zullen laden – meer dan 20% trager.

Ollama installeren op Windows in een specifieke map

Samen met de modellen:

.\OllamaSetup.exe /DIR=D:\OllamaDir

Ollama-API blootstellen aan intern netwerk

Intern betekent hier lokaal netwerk.

Voeg toe aan serviceconfiguratie:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

Dit stelt de gewone HTTP-API op je netwerk beschikbaar. Voor geautomatiseerd HTTPS, correcte streaming en WebSocket-proxying via Caddy of Nginx, en randversterking (timeouts, buffering, optionele authenticatie voor de API), gebruik Ollama achter een reverse proxy met Caddy of Nginx voor HTTPS-streaming.

Om Ollama vanaf externe apparaten te bereiken zonder openbare poorten te openen, gebruik een privé-overlay (Tailscale) of WireGuard; zie Externe toegang tot Ollama via Tailscale of WireGuard, zonder openbare poorten.

Om te zien hoe Ollama past bij andere lokale en cloud LLM-opties, bekijk onze LLM Hosting: Lokaal, Self-Hosted & Cloud Infrastructuur vergeleken gids.

Nuttige links

- Test: Hoe Ollama Intel CPU-prestaties en efficiënte kernen gebruikt

- Hoe Ollama parallelle verzoeken handhaaft

- LLM-prestaties en PCIe-banen: Belangrijke overwegingen

- LLM snelheidsprestatievergelijking

- Vergelijking van LLM-samenvattingsmogelijkheden

- Effectieve prompts voor LLM’s schrijven

- Self-hosting van Perplexica - met Ollama

- Cloud LLM-aanbieders