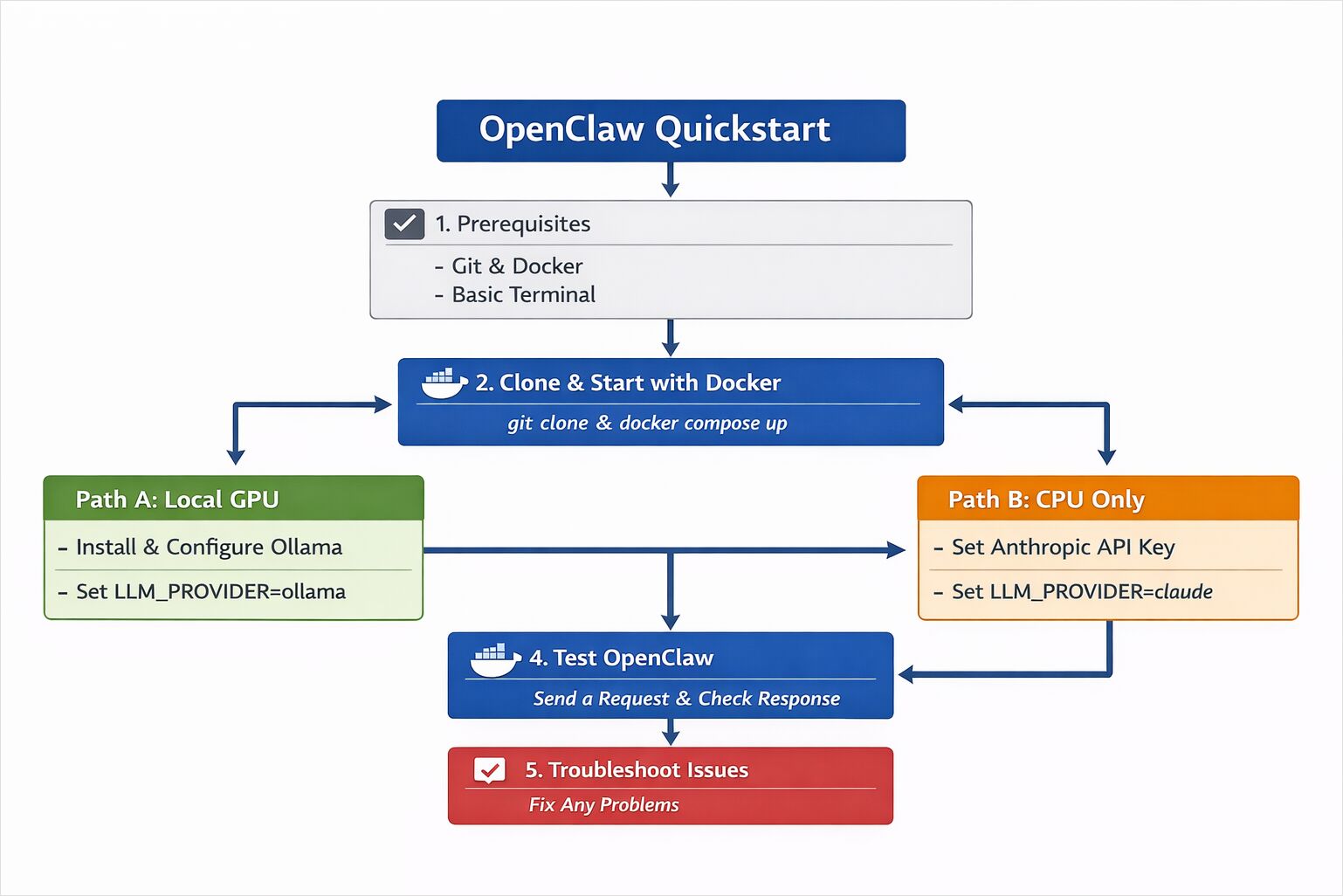

OpenClaw Quickstart: Mit Docker installieren (Ollama GPU oder Claude CPU)

Installieren Sie OpenClaw lokal mit Ollama

OpenClaw ist ein selbstgehosteter KI-Assistent, der mit lokalen LLM-Runtime-Umgebungen wie Ollama oder mit cloudbasierten Modellen wie Claude Sonnet laufen kann.

Dieser Quickstart zeigt, wie Sie OpenClaw mit Docker bereitstellen, entweder ein GPU-gestütztes lokales Modell oder ein CPU-only-Modell im Cloud-Modell konfigurieren und sicherstellen, dass Ihr KI-Assistent end-to-end funktioniert.

Dieser Leitfaden führt Sie durch eine minimale Einrichtung von OpenClaw, damit Sie sehen können, wie es auf Ihrem eigenen Rechner läuft und auf Anfragen reagiert.

Das Ziel ist einfach:

- OpenClaw starten.

- Eine Anfrage senden.

- Bestätigen, dass es funktioniert.

Dies ist kein Leitfaden zur Produktionsverfestigung.

Dies ist kein Leitfaden zur Leistungsfeinabstimmung.

Dies ist ein praktischer Ausgangspunkt.

Sie haben zwei Optionen:

- Pfad A — Lokale GPU mit Ollama (empfohlen, wenn Sie eine GPU haben)

- Pfad B — Nur CPU mit Claude Sonnet 4.6 über die Anthropic API

Beide Pfade verwenden denselben Kerninstallationsschritt.

Wenn Sie OpenClaw neu sind und eine tiefere Übersicht über die Struktur des Systems möchten, lesen Sie den OpenClaw-Systemüberblick.

Systemanforderungen und Umgebungseinrichtung

OpenClaw ist ein assistenzähnliches System, das sich mit externen Diensten verbinden kann. Für diesen Quickstart:

- Nutzen Sie bei Gelegenheit Testkonten.

- Vermeiden Sie die Verbindung sensibler Produktionsysteme.

- Führen Sie es innerhalb von Docker aus (empfohlen).

Isolierung ist eine gute Voreinstellung, wenn man mit agentenähnlicher Software experimentiert.

OpenClaw-Voraussetzungen (GPU mit Ollama oder CPU mit Claude)

Erforderlich für beide Pfade

- Git

- Docker Desktop (oder Docker + Docker Compose)

- Ein Terminal

Für Pfad A (Lokale GPU)

- Ein Gerät mit einer kompatiblen GPU (NVIDIA oder AMD empfohlen)

- Ollama installiert

Für Pfad B (Nur CPU + Cloud-Modell)

- Ein Anthropic-API-Schlüssel

- Zugriff auf Claude Sonnet 4.6

Schritt 1 — OpenClaw mit Docker installieren (Klonen & Starten)

OpenClaw kann mit Docker Compose gestartet werden. Dies hält die Einrichtung isoliert und reproduzierbar.

Repository klonen

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Umgebungs-Konfiguration kopieren

cp .env.example .env

Öffnen Sie .env in Ihrem Editor. Wir konfigurieren ihn im nächsten Schritt je nach gewähltem Modellpfad.

Container starten

docker compose up -d

Wenn alles korrekt gestartet wird, sollten Sie laufende Container sehen:

docker ps

In diesem Stadium läuft OpenClaw — es ist jedoch noch nicht mit einem Modell verbunden.

Schritt 2 — LLM-Anbieter konfigurieren (Ollama GPU oder Claude CPU)

Jetzt entscheiden Sie, wie Sie die Inferenz durchführen möchten.

Pfad A — Lokale GPU mit Ollama

Wenn Sie eine GPU zur Verfügung haben, ist dies die einfachste und am selbstständigste Option.

Ollama installieren oder überprüfen

Wenn Sie einen detaillierteren Installationsleitfaden benötigen oder die Konfiguration von Modell-Speicherorten vornehmen möchten, sehen Sie sich an:

- Ollama installieren und Modell-Speicherort konfigurieren

- Ollama CLI-Kurzanleitung: ls, serve, run, ps + andere Befehle (2026-Update)

Wenn Ollama nicht installiert ist:

curl -fsSL https://ollama.com/install.sh | sh

Überprüfen Sie, ob es funktioniert:

ollama pull llama3

ollama run llama3

Wenn das Modell antwortet, funktioniert die Inferenz.

OpenClaw konfigurieren, um Ollama zu verwenden

In Ihrer .env-Datei konfigurieren Sie:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Starten Sie die Container neu:

docker compose restart

OpenClaw wird nun Anfragen an Ihre lokale Ollama-Instanz weiterleiten.

Wenn Sie entscheiden, welches Modell auf einer 16-GB-GPU zu laufen hat oder Benchmark-Vergleiche wünschen, sehen Sie sich an:

Um Konkurrenz und CPU-Verhalten unter Last zu verstehen:

- Wie Ollama parallelle Anfragen behandelt

- Test: Wie Ollama Intel-CPU-Performance und effiziente Kerne nutzt

Pfad B — Nur CPU mit Claude Sonnet 4.6

Wenn Sie keine GPU haben, können Sie ein gehostetes Modell verwenden.

Ihren API-Schlüssel hinzufügen

In Ihrer .env-Datei:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Neustarten:

docker compose restart

OpenClaw wird nun Claude Sonnet 4.6 für die Inferenz verwenden, während die Orchestrierung lokal läuft.

Diese Einrichtung funktioniert gut auf Maschinen mit nur CPU, da die schwere Modellrechnung in der Cloud stattfindet.

Schritt 3 — OpenClaw mit Ihrem ersten Prompt testen

Sobald die Container laufen und das Modell konfiguriert ist, können Sie den Assistenten testen.

Je nach Einrichtung kann dies über folgende Wege erfolgen:

- Eine Web-Oberfläche

- Eine Messaging-Integration

- Ein lokaler API-Endpunkt

Für einen grundlegenden API-Test:

curl http://localhost:3000/health

Sie sollten eine Gesundheitsstatusantwort sehen.

Senden Sie nun einen einfachen Prompt:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Erkläre einfach, was OpenClaw tut."}'

Wenn Sie eine strukturierte Antwort erhalten, funktioniert das System.

Was Sie gerade ausgeführt haben

In diesem Moment haben Sie:

- Eine laufende OpenClaw-Instanz

- Einen konfigurierten LLM-Anbieter (lokal oder in der Cloud)

- Eine funktionierende Anfrage-Antwort-Schleife

Wenn Sie den GPU-Pfad gewählt haben, erfolgt die Inferenz lokal über Ollama.

Wenn Sie den CPU-Pfad gewählt haben, erfolgt die Inferenz über Claude Sonnet 4.6, während Orchestrierung, Routing und Speicherverwaltung in Ihren lokalen Docker-Containern laufen.

Die sichtbare Interaktion mag einfach wirken. Unter der Oberfläche koordinieren mehrere Komponenten, um Ihre Anfrage zu verarbeiten.

Fehlerbehebung bei der Installation und Laufzeitproblemen von OpenClaw

Modell reagiert nicht

- Überprüfen Sie Ihre

.env-Konfiguration. - Prüfen Sie die Containerprotokolle:

docker compose logs

Ollama ist nicht erreichbar

- Bestätigen Sie, dass Ollama läuft:

ollama list

- Stellen Sie sicher, dass die Basis-URL mit Ihrer Umgebung übereinstimmt.

Ungültiger API-Schlüssel

- Prüfen Sie

ANTHROPIC_API_KEYerneut. - Starten Sie die Container erneut, nachdem Sie

.envaktualisiert haben.

GPU wird nicht genutzt

- Bestätigen Sie, dass die GPU-Treiber installiert sind.

- Stellen Sie sicher, dass Docker Zugriff auf die GPU hat.

Nächste Schritte nach der Installation von OpenClaw

Sie haben nun eine funktionierende OpenClaw-Instanz.

Von hier aus können Sie:

- Messaging-Plattformen verbinden

- Dokumenterstellung aktivieren

- Routing-Strategien testen

- Beobachtbarkeit und Metriken hinzufügen

- Leistung und Kostenverhalten abstimmen

Die tiefgehenden architektonischen Diskussionen ergeben mehr Sinn, sobald das System läuft.

Es ist der erste Schritt, es operational zu machen.