Chat-Oberflächen für lokale Ollama-Instanzen

Schneller Überblick über die wichtigsten UIs für Ollama im Jahr 2025

Locally gehostete Ollama ermöglicht es, große Sprachmodelle auf Ihrem eigenen Gerät auszuführen, aber die Verwendung über die Befehlszeile ist nicht benutzerfreundlich. Hier sind mehrere Open-Source-Projekte, die ChatGPT-ähnliche Schnittstellen bereitstellen, die mit einer lokalen Ollama verbunden sind.

Diese UIs unterstützen konversationellen Chat, oft mit Funktionen wie Dokumentupload für retrieval-augmented generation (RAG), und laufen als Web- oder Desktopanwendungen. Unten finden Sie eine Übersicht der wichtigsten Optionen, gefolgt von detaillierten Abschnitten zu jedem. Für einen umfassenderen Überblick darüber, wie lokale Ollama mit vLLM, Docker Model Runner, LocalAI und Cloud-Anbietern zusammenpasst – einschließlich Kosten- und Infrastrukturkompromisse – siehe LLM-Hosting: Lokal, Selbstgehostet & Cloud-Infrastruktur Verglichen.

Vergleich von Ollama-kompatiblen UIs

| UI-Tool | Plattform | Dokumentunterstützung | Ollama-Integration | Stärken | Einschränkungen |

|---|---|---|---|---|---|

| Page Assist | Browsererweiterung (Chrome, Firefox) | Ja – Dateien hinzufügen, um sie zu analysieren | Verbindet sich über die Erweiterungskonfiguration mit lokaler Ollama | Chat im Browser; einfache Modellverwaltung und Integration in den Webseitenkontext. | Nur im Browser; erfordert das Installieren/Erstellen einer Erweiterung. |

| Open WebUI | Webanwendung (selbstgehostet; Docker/PWA) | Ja – eingebaute RAG (Dokumente hochladen oder zur Bibliothek hinzufügen) | Direkte Ollama-API-Unterstützung oder gebündelter Server (Grund-URL konfigurieren) | Funktionenreich (mehrere LLMs, offline, Bildgenerierung); mobilfreundlich (PWA). | Einrichtung ist schwerer (Docker/K8s); breiter Umfang kann für einfache Anwendungsfälle übertrieben sein. |

| LobeChat | Webanwendung (selbstgehostet; PWA-Unterstützung) | Ja – „Knowledge Base“ mit Dateiupload (PDF, Bilder usw.) | Unterstützt Ollama als eine der vielen AI-Backends (erfordert die Aktivierung der Ollama-API-Zugriffsrechte) | Schlankes ChatGPT-ähnliches UI; Sprachchat, Plugins und Multi-Modell-Unterstützung. | Komplexes Feature-Set; erfordert Umgebungseinrichtung (z. B. Cross-Origin für Ollama). |

| LibreChat | Webanwendung (selbstgehostet; mehrere Benutzer) | Ja – „Chat mit Dateien“ mithilfe von RAG (über Embeddings) | Kompatibel mit Ollama und vielen anderen Anbietern (pro Chat wechselbar) | Vertraute ChatGPT-ähnliche Schnittstelle; reiche Features (Agenten, Code-Interpreter usw.). | Installation/Konfiguration kann aufwendig sein; großes Projekt kann für grundlegende Anwendungsfälle überflüssig sein. |

| AnythingLLM | Desktopanwendung (Windows, Mac, Linux) oder Web (Docker) | Ja – eingebaute RAG: Drag-and-Drop-Dokumente (PDF, DOCX usw.) mit Zitaten | Ollama als LLM-Anbieter unterstützt (in der Konfiguration oder Docker-Umgebung festlegen) | Alle-in-einem UI (privater ChatGPT mit Ihren Dokumenten); keine Code-Agenten-Builder, Multi-Benutzer-Unterstützung. | Höhere Ressourennutzung (Embeddings-Datenbank usw.); Desktop-App fehlt einige Multi-Benutzerfunktionen. |

| Chat-with-Notes | Webanwendung (leichtgewichtiger Flask-Server) | Ja – Text/PDF-Dateien hochladen und mit ihrem Inhalt chatten | Nutzt Ollama für alle AI-Antworten (erfordert, dass Ollama lokal läuft) | Sehr einfache Einrichtung und Schnittstelle, die sich auf Dokumentfragen konzentriert; Daten bleiben lokal. | Grundlegende UI und Funktionalität; Einzelbenutzer, ein Dokument auf einmal (keine erweiterten Funktionen). |

Jedes dieser Tools wird aktiv weiterentwickelt und ist Open-Source. Als nächstes tauchen wir in die Details jeder Option ein, einschließlich der Art und Weise, wie sie mit Ollama zusammenarbeiten, bemerkenswerte Funktionen und Kompromisse.

Page Assist (Browsererweiterung)

Page Assist ist eine Open-Source-Browsererweiterung, die lokale LLM-Chats in Ihren Browser bringt. Sie unterstützt Chromium-basierte Browser und Firefox, bietet eine ChatGPT-ähnliche Seitenleiste oder ein Tab, in dem Sie mit einem Modell sprechen können. Page Assist kann sich über lokales Ollama als AI-Anbieter verbinden oder andere lokale Backends über ihre Einstellungen. Auffällig ist, dass sie es Ihnen ermöglicht, Dateien (z. B. PDFs oder Texte) hinzuzufügen, damit die AI sie im Chat analysieren kann, wodurch grundlegende RAG-Workflows ermöglicht werden. Sie können es sogar dabei unterstützen, den Inhalt der aktuellen Webseite zu bearbeiten oder Informationen durch Web-Suchen zu finden.

Die Einrichtung ist einfach: installieren Sie die Erweiterung aus dem Chrome Web Store oder Firefox Add-ons, stellen Sie sicher, dass Ollama läuft, und wählen Sie Ollama als lokalen AI-Anbieter in den Einstellungen von Page Assist. Die Schnittstelle umfasst Funktionen wie Chat-Historie, Modellauswahl und einen optionalen teilenbaren URL für Ihre Chat-Ergebnisse. Ein Web-UI ist auch über einen Tastenkombination verfügbar, wenn Sie eine vollständige Tab-Chat-Erfahrung bevorzugen.

Stärken: Page Assist ist leicht und bequem – da sie im Browser lebt, gibt es keinen separaten Server, den Sie laufen lassen müssen. Sie ist großartig für Browserkontexte (Sie können sie auf jeder Webseite öffnen) und unterstützt Internet-Suchintegration und Dateianhänge, um die Konversation zu bereichern. Sie bietet auch praktische Funktionen wie Tastenkombinationen für neuen Chat und das Umschalten der Seitenleiste.

Einschränkungen: Als Erweiterung ist sie auf einen Browserumgebung beschränkt. Die UI ist einfacher und etwas weniger feature-reich als vollständige standalone-Chat-Apps. Zum Beispiel sind Multi-Benutzer-Verwaltung oder erweiterte Agenten-Plugins nicht im Umfang. Zudem kann die Anfangseinrichtung möglicherweise erfordern, die Erweiterung zu bauen/laden, wenn keine vorkonfigurierte Version für Ihren Browser verfügbar ist (das Projekt bietet Bauanweisungen mit Bun oder npm). Im Allgemeinen ist Page Assist am besten für individuelle Nutzung geeignet, wenn Sie schnellen Zugriff auf Ollama-gestützten Chat während des Web-Browsings wünschen, mit moderaten RAG-Fähigkeiten.

Open WebUI (Selbstgehostete Webanwendung)

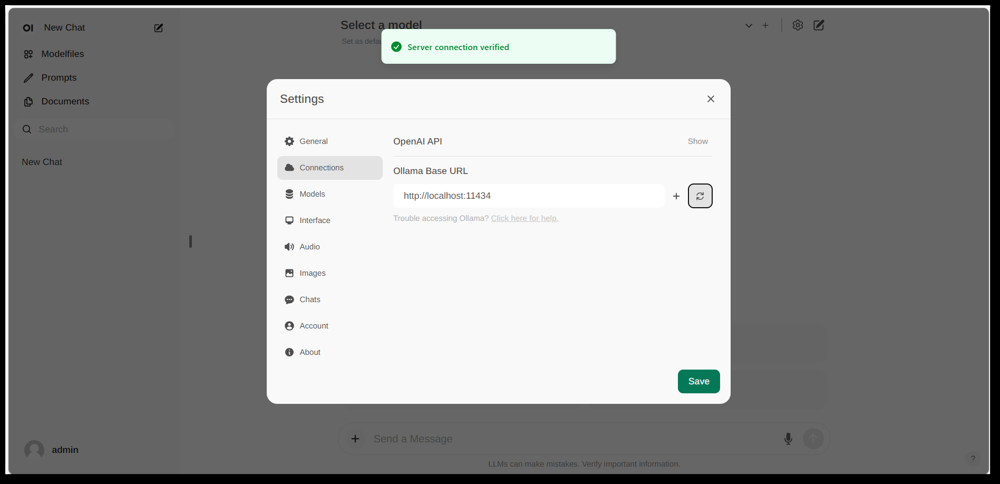

Open WebUIs Einstellungsschnittstelle, die eine Ollama-Verbindung konfiguriert (Grund-URL auf die lokale Ollama-API gesetzt). Die UI enthält einen Dokumentenabschnitt, der RAG-Workflows ermöglicht.

Open WebUI ist eine leistungsstarke, allgemeine Chat-Frontend-Software, ursprünglich erstellt, um mit Ollama zusammenzuarbeiten, und jetzt erweitert, um verschiedene LLM-Backends zu unterstützen. Es läuft als selbstgehostete Webanwendung und wird typischerweise über Docker oder Kubernetes für eine einfache Einrichtung bereitgestellt. Sobald sie läuft, können Sie sie über Ihren Browser zugreifen (mit Unterstützung für das Installieren als Progressive Web App auf mobilen Geräten).

Open WebUI bietet eine vollständige Chat-Schnittstelle mit Multi-Benutzer-Unterstützung, Modellverwaltung und umfangreiche Features. Entscheidend ist, dass sie eingebaute RAG-Fähigkeiten hat – Sie können Dokumente hochladen oder in eine Dokumentenbibliothek importieren und dann Fragen mit Retrieval-Verstärkung stellen. Die Schnittstelle ermöglicht das Laden von Dokumenten direkt in eine Chat-Sitzung oder das Aufrechterhalten einer persistenten Bibliothek von Wissen. Sie unterstützt sogar das Durchführen von Web-Suchen und das Einfügen der Ergebnisse in die Konversation für aktuelle Informationen.

Ollama-Integration: Open WebUI verbindet sich mit Ollama über ihre API. Sie können entweder den Open WebUI Docker-Container neben einem Ollama-Server laufen lassen und eine Umgebungsvariable setzen, um auf die Ollama-URL zu verweisen, oder einen speziellen Docker-Image verwenden, der Ollama mit der Web-Schnittstelle verpackt. In der Praxis, nachdem die Container gestartet wurden, besuchen Sie die Open WebUI in Ihrem Browser und sehen Sie „Serververbindung bestätigt“, wenn sie richtig konfiguriert ist (wie in dem obigen Bild gezeigt). Dies bedeutet, dass die UI bereit ist, Ihre lokalen Ollama-Modelle für Chat zu verwenden. Open WebUI unterstützt auch OpenAI-API-kompatible Endpunkte, sodass sie sich zusätzlich zu Ollama mit LM Studio, OpenRouter usw. verbinden kann.

Stärken: Diese Lösung ist eine der umfangreichsten und flexibelsten UIs. Sie unterstützt mehrere gleichzeitige Modelle und Konversationsstränge, benutzerdefinierte „Charaktere“ oder Systemprompts, Bildgenerierung und mehr. Die RAG-Implementierung ist robust – Sie erhalten eine vollständige UI für die Verwaltung von Dokumenten und sogar die Konfiguration, welcher Vektor-Speicher oder Suchdienst für Retrieval verwendet werden soll. Open WebUI wird auch aktiv weiterentwickelt (mit einer umfangreichen Community, wie durch ihre hohe Sternzahl auf GitHub angezeigt) und ist für Erweiterbarkeit und Skalierung entworfen. Es ist eine gute Wahl, wenn Sie eine umfassende, alle-in-einem Chat-UI für lokale Modelle benötigen, insbesondere in einem Szenario mit mehreren Benutzern oder komplexen Anwendungsfällen.

Einschränkungen: Mit großer Macht kommt auch größere Komplexität. Open WebUI kann für einfache persönliche Nutzung übertrieben sein – das Einrichten von Docker-Containern und das Verwalten der Konfiguration kann beängstigend sein, wenn Sie nicht vertraut sind. Sie verbraucht mehr Ressourcen als eine leichte Anwendung, da sie einen Web-Server, eine optionale Datenbank für Chat-Historie usw. läuft. Auch Features wie rollenbasierte Zugriffssteuerung und Benutzerverwaltung, obwohl nützlich, zeigen, dass sie für eine Servereinrichtung konzipiert ist – ein einzelner Benutzer an einem Heim-PC benötigt möglicherweise nicht alles. Kurz gesagt, die Einrichtung ist schwerer und die Schnittstelle kann komplex wirken, wenn Sie einfach nur eine ChatGPT-Clone benötigen. Aber für diejenigen, die ihre Vielzahl an Features benötigen (oder einfach zwischen Ollama und anderen Modellanbietern in einer UI wechseln möchten), ist Open WebUI eine Top-Option.

LobeChat (ChatGPT-ähnliches Framework mit Plugins)

LobeChat-Schnittstellenbanner, der „Ollama Supported“ und mehrere lokale Modelle anzeigt. LobeChat ermöglicht es Ihnen, eine glatte ChatGPT-ähnliche Webanwendung mit Ollama oder anderen Anbietern zu bereitstellen, mit Funktionen wie Spracheingabe und Plugins.

LobeChat ist ein Open-Source-Chat-Framework, das auf eine polierte Benutzererfahrung und Flexibilität Wert legt. Es ist im Grunde eine ChatGPT-ähnliche Webanwendung, die Sie selbst hosten können, mit Unterstützung für mehrere AI-Anbieter – von OpenAI und Anthropic bis hin zu offenen Modellen über Ollama. LobeChat ist mit Privatsphäre im Blick entworfen (Sie hosten es selbst) und hat eine moderne Schnittstelle, die Bequemlichkeiten wie Konversationsgedächtnis, Sprachmodus und sogar Text-zu-Bild-Generierung über Plugins bietet.

Eine der Schlüsselmerkmale von LobeChat ist seine Knowledge Base-Fähigkeit. Sie können Dokumente hochladen (in Formaten wie PDFs, Bilder, Audio, Video) und eine Wissensbasis erstellen, die während des Chats genutzt werden kann. Dies bedeutet, dass Sie Fragen zu dem Inhalt Ihrer Dateien stellen können – ein RAG-Workflow, den LobeChat standardmäßig unterstützt. Die UI bietet die Verwaltung dieser Dateien/Wissensbasen und ermöglicht das Umschalten ihres Gebrauchs in der Konversation, was zu einer reicheren Q&A-Erfahrung über das Basis-LLM hinaus führt.

Um LobeChat mit Ollama zu verwenden, deployen Sie die LobeChat-App (z. B. über ein bereitgestelltes Docker-Image oder Skript) und konfigurieren Sie Ollama als Backend. LobeChat erkennt Ollama als erstklassigen Anbieter – es bietet sogar ein One-Click-Deployment-Skript über den Pinokio AI-Browser, wenn Sie diesen verwenden. In der Praxis müssen Sie möglicherweise die Einstellungen von Ollama anpassen (z. B. CORS aktivieren, wie in den LobeChat-Dokumenten beschrieben), damit die Web-Frontend von LobeChat auf die Ollama-HTTP-API zugreifen kann. Nach der Konfiguration können Sie in der LobeChat-Schnittstelle ein Ollama-hostetes Modell auswählen und damit konversieren, einschließlich der Abfrage Ihrer hochgeladenen Dokumente.

Stärken: LobeChat’s UI wird oft wegen ihrer sauberen und benutzerfreundlichen Gestaltung gelobt, die sich eng an das Aussehen und Gefühl von ChatGPT anschließt (was die Adoption erleichtert). Sie fügt Wert durch Extras wie Spracheingabe/Ausgabe für gesprochene Konversationen und ein Plugin-System, um die Funktionalität zu erweitern (ähnlich wie ChatGPT-Plugins, die Dinge wie Web-Browsing oder Bildgenerierung ermöglichen). Die Multi-Modell-Unterstützung bedeutet, dass Sie leicht zwischen einem Ollama-Modell und einem OpenAI-API-Modell im selben Interface wechseln können. Sie unterstützt auch die Installation als mobilefreundliche PWA, sodass Sie Ihren lokalen Chat unterwegs nutzen können.

Einschränkungen: Die Einrichtung von LobeChat kann komplexer sein als bei einigen Alternativen. Es ist eine Full-Stack-Anwendung (häufig mit Docker Compose), also gibt es etwas Overhead. Insbesondere erfordert die Ollama-Integration, die Aktivierung von Cross-Origin-Anfragen auf der Seite von Ollama und das Sicherstellen, dass die Ports übereinstimmen – eine einmalige Aufgabe, aber technisch. Zudem, während LobeChat sehr leistungsstark ist, sind nicht alle Features für jeden Nutzer erforderlich; beispielsweise könnte die Schnittstelle für jemanden, der keine Multi-Anbieter-Unterstützung oder Plugins benötigt, überladen wirken im Vergleich zu einer minimalen Tool. Schließlich nehmen bestimmte erweiterte Funktionen wie der One-Click-Deploy bestimmte Umgebungen an (Pinokio-Browser oder Vercel), die Sie möglicherweise nutzen oder nicht. Im Allgemeinen ist LobeChat ideal, wenn Sie eine vollständig ausgestattete ChatGPT-Alternative benötigen, die lokal mit Ollama läuft, und Sie nicht minder ein bisschen Anfangskonfiguration ertragen.

LibreChat (ChatGPT-Clone mit Multi-Anbieter-Unterstützung)

LibreChat (früher bekannt als ChatGPT-Clone oder UI) ist ein Open-Source-Projekt, das darauf abzielt, die ChatGPT-Schnittstelle und -Funktionalität zu replizieren und zu erweitern. Es kann lokal (oder auf Ihrem eigenen Server) bereitgestellt werden und unterstützt eine Vielzahl von AI-Backends – einschließlich Open-Source-Modellen über Ollama. Grundsätzlich bietet LibreChat die vertraute Chat-Erfahrung (Dialogschnittstelle mit Historie, Nutzer- und Assistenten-Nachrichten), während Sie verschiedene Modelleanbieter im Hintergrund einsetzen können.

LibreChat unterstützt Dokumentinteraktion und RAG über eine Erweiterung namens RAG API und Embedding-Dienste. In der Schnittstelle können Sie Funktionen wie „Chat mit Dateien“ nutzen, die es Ihnen ermöglichen, Dateien hochzuladen und dann Fragen dazu zu stellen. Im Hintergrund nutzt dies Embeddings und eine Vektorbank, um relevanten Kontext aus Ihren Dateien zu extrahieren. Dies bedeutet, dass Sie einen ähnlichen Effekt wie ChatGPT + benutzerdefiniertes Wissen lokal erreichen können. Das Projekt bietet sogar ein separates Repository für den RAG-Dienst, falls Sie diesen selbst hosten möchten.

Die Nutzung von LibreChat mit Ollama umfasst in der Regel das Laufen des LibreChat-Servers (z. B. über Node/Docker) und das Sicherstellen, dass er den Ollama-Dienst erreichen kann. LibreChat hat eine „Custom Endpoint“-Einstellung, in der Sie eine OpenAI-kompatible API-URL eingeben können. Da Ollama eine lokale API bereitstellen kann, die OpenAI-kompatibel ist, kann LibreChat auf http://localhost:11434 (oder wo immer Ollama lauscht) gerichtet werden. Tatsächlich listet LibreChat Ollama explizit unter seinen unterstützten AI-Anbietern – neben anderen wie OpenAI, Cohere usw. Nach der Konfiguration können Sie das Modell (Ollamas Modell) in einem Dropdown auswählen und chatten. LibreChat ermöglicht auch das Wechseln von Modellen oder Anbietern während der Konversation und unterstützt mehrere Chat-Vorlagen/Kontexte.

Stärken: Der Hauptvorteil von LibreChat ist das umfangreiche Feature-Set, das um die Chat-Erfahrung herum gebaut ist. Es umfasst Dinge wie Konversationsverzweigung, Nachrichtensuche, eingebaute Code-Interpreter-Unterstützung (sicherer Code-Interpreter in Sandbox) und Tool-/Agenten-Integrationen. Es ist im Grunde ChatGPT++, mit der Fähigkeit, lokale Modelle zu integrieren. Für jemanden, der die UI von ChatGPT mag, wird LibreChat sehr vertraut wirken und erfordert kaum Lernkurve. Das Projekt ist aktiv und communitygetrieben (wie durch häufige Updates und Diskussionen belegt) und ist sehr flexibel: Sie können sich an viele Arten von LLM-Endpunkten anschließen oder es sogar in einer Teamumgebung mit Authentifizierung für mehrere Benutzer laufen lassen.

Einschränkungen: Mit seinen vielen Features kann LibreChat schwerer zu laufen. Die Installation könnte das Einrichten einer Datenbank für das Speichern von Chats und das Konfigurieren von Umgebungsvariablen für verschiedene APIs erfordern. Wenn Sie alle Komponenten (RAG, Agenten, Bildgenerierung usw.) aktivieren, ist es eine ziemlich komplexe Stack. Für einen einzelnen Nutzer, der nur einen einfachen Chat mit einem lokalen Modell benötigt, könnte LibreChat mehr als notwendig sein. Zudem ist die UI, obwohl vertraut, nicht hochspezialisiert für Dokument-Q&A – sie erledigt die Arbeit, aber verfügt nicht über eine dedizierte „Dokumentenbibliothek“-Schnittstelle (Uploads werden typischerweise innerhalb eines Chats oder über API durchgeführt). Kurz gesagt, LibreChat ist großartig, wenn Sie eine vollständige ChatGPT-ähnliche Umgebung mit einer Vielzahl von Features lokal benötigen, aber einfachere Lösungen könnten für eng fokussierte Anwendungsfälle ausreichen.

AnythingLLM (All-in-One-Desktop- oder Server-App)

AnythingLLM ist eine umfassende AI-Anwendung, die RAG und Benutzerfreundlichkeit betont. Sie ermöglicht es Ihnen, „mit Ihren Dokumenten zu chatten“, entweder über Open-Source-LLMs oder sogar über OpenAI-Modelle, alles über eine einzige vereinheitlichte Schnittstelle. Auffällig ist, dass AnythingLLM sowohl als plattformübergreifende Desktop-App (für Windows, Mac, Linux) als auch als selbstgehostete Webserver (über Docker) verfügbar ist. Diese Flexibilität bedeutet, dass Sie sie wie eine normale Anwendung auf Ihrem PC laufen lassen können, oder sie für mehrere Benutzer auf einem Server bereitstellen können.

Die Dokumentverarbeitung ist im Zentrum von AnythingLLM. Sie können Dateien per Drag-and-Drop (PDF, TXT, DOCX usw.) in die App einfügen, und sie wird automatisch in eine Vektorbank indiziert (es kommt standardmäßig mit LanceDB). In der Chat-Schnittstelle, wenn Sie Fragen stellen, wird sie relevante Abschnitte aus Ihren Dokumenten abrufen und zitierte Antworten geben, sodass Sie wissen, welche Datei und welcher Abschnitt die Information stammt. Grundsätzlich erstellt sie eine private Wissensbasis für Sie und ermöglicht dem LLM, sie als Kontext zu verwenden. Sie können Dokumente in „Arbeitsbereiche“ organisieren (z. B. einen Arbeitsbereich pro Projekt oder Thema), um Kontexte bei Bedarf zu isolieren.

Die Verwendung von Ollama mit AnythingLLM ist einfach. In der Konfiguration wählen Sie Ollama als LLM-Anbieter aus. Wenn Sie sie über Docker laufen lassen, setzen Sie Umgebungsvariablen wie LLM_PROVIDER=ollama und geben die OLLAMA_BASE_PATH (die URL zu Ihrer Ollama-Instanz) an. Der AnythingLLM-Server sendet dann alle Modellabfragen an die Ollama-API. Ollama wird offiziell unterstützt, und die Dokumentation erwähnt, dass Sie sie nutzen können, um verschiedene offene Modelle (wie Llama 2, Mistral usw.) lokal zu laufen. Tatsächlich betonen die Entwickler, dass das Kombinieren von AnythingLLM mit Ollama leistungsstarke offline RAG-Fähigkeiten ermöglicht: Ollama übernimmt die Modellinferenz, und AnythingLLM übernimmt Embeddings und die UI/Agenten-Logik.

Stärken: AnythingLLM bietet eine umfassende Lösung für private Q&A und Chat. Schlüsselstärken sind: einfache Einrichtung für RAG (die schwere Arbeit der Embedding und Speicherung von Vektoren wird automatisiert), Multi-Dokument-Unterstützung mit klarer Zitierung von Quellen, und zusätzliche Funktionen wie AI-Agenten (es hat einen no-code Agenten-Builder, mit dem Sie benutzerdefinierte Workflows und Toolnutzung erstellen können). Es ist auch standardmäßig mehrbenutzerfähig (besonders in Servermodus), mit Benutzerkonten und Berechtigungen, wenn nötig. Die Schnittstelle ist so gestaltet, um einfach zu sein (Chat-Box + Seitenleiste der Dokumente/Arbeitsbereiche), aber mächtig im Hintergrund. Für persönliche Nutzung ist die Desktop-App ein großer Pluspunkt – Sie erhalten eine native-fühlende App, ohne einen Browser öffnen oder Befehle ausführen zu müssen, und sie speichert Daten standardmäßig lokal.

Einschränkungen: Da sie viele Komponenten integriert (LLM-API, Embedding-Modelle, Vektorbank usw.), kann AnythingLLM ressourenintensiv sein. Wenn Sie Dokumente importieren, kann es Zeit und Speicher benötigen, um Embeddings zu generieren (es unterstützt sogar die Nutzung von Ollama selbst oder lokalen Modellen für Embeddings mit Modellen wie nomic-embed). Die Desktop-App vereinfacht die Nutzung, aber wenn Sie viele Dokumente oder sehr große Dateien haben, erwarten Sie schwere Verarbeitung im Hintergrund. Eine weitere Einschränkung ist, dass fortgeschrittene Nutzer sie weniger konfigurierbar finden könnten als ein selbst erstelltes Stack – beispielsweise verwendet sie derzeit LanceDB oder Chroma; wenn Sie eine andere Vektorbank verwenden möchten, müssen Sie in die Konfiguration oder den Code eintauchen. Zudem, während Multi-Anbieter-Unterstützung vorhanden ist, ist die Schnittstelle wirklich auf ein Modell pro Mal ausgerichtet (Sie würden den globalen Anbieter-Einstellung wechseln, wenn Sie ein anderes Modell verwenden möchten). Kurz gesagt, AnythingLLM ist eine hervorragende Out-of-the-Box-Lösung für lokale Dokumentchats, insbesondere mit Ollama, aber es ist eine größere Anwendung, um zu laufen, im Vergleich zu minimalen UIs.

Chat-with-Notes (Minimalistische Dokument-Chat-Schnittstelle)

Chat-with-Notes ist eine minimalistische Anwendung, die speziell entwickelt wurde, um mit lokalen Textdateien über Modelle, die von Ollama verwaltet werden, zu chatten. Es ist im Grunde ein leichtgewichtiger Flask-Webserver, den Sie auf Ihrem PC laufen lassen, der eine einfache Webseite bereitstellt, auf der Sie eine Datei hochladen und damit beginnen können, darüber zu chatten. Das Ziel dieses Projekts ist Einfachheit: es hat nicht viele bells und whistles, aber es erledigt die Kernarbeit der Dokumentfragebeantwortung mit einem lokalen LLM.

Die Nutzung von Chat-with-Notes erfordert zunächst, dass Ihre Ollama-Instanz ein Modell läuft (z. B. Sie könnten Ollama mit ollama run llama2 oder einem anderen Modell starten). Dann starten Sie die Flask-App (python app.py) und öffnen Sie die lokale Website. Die UI wird Sie auffordern, eine Datei hochzuladen (unterstützte Formate umfassen reinen Text, Markdown, Code-Dateien, HTML, JSON und PDFs). Nach dem Hochladen wird der Textinhalt der Datei angezeigt, und Sie können Fragen stellen oder mit dem AI über den Inhalt der Datei chatten. Die Konversation erfolgt in der typischen Chat-Blasen-Form. Wenn Sie während der Konversation eine neue Datei hochladen, fragt die App, ob Sie einen frischen Chat starten oder den aktuellen Chatkontext beibehalten und nur die Informationen der neuen Datei hinzufügen möchten. Auf diese Weise können Sie bei Bedarf nacheinander mehrere Dateien besprechen. Es gibt auch Schaltflächen, um den Chat zu löschen oder die Konversation in eine Textdatei zu exportieren.

Unter der Haube fragt Chat-with-Notes die Ollama-API für die Generierung von Antworten. Ollama übernimmt die Modellinferenz, und Chat-with-Notes liefert nur den Prompt (der relevante Teile des hochgeladenen Textes enthält). Es nutzt keine Vektorbank; stattdessen sendet es einfach den gesamten Dateiinhalt (oder Abschnitte davon) zusammen mit Ihrer Frage an das Modell. Dieser Ansatz funktioniert am besten für Dokumente, die in den Kontextfenster des Modells passen.

Stärken: Die App ist extrem einfach zu deployen und zu verwenden. Es gibt keine komplexe Konfiguration – wenn Sie Python und Ollama eingerichtet haben, können Sie sie innerhalb von einer oder zwei Minuten laufen lassen. Die Schnittstelle ist sauber und minimal, mit Fokus auf den Textinhalt und Q&A. Da sie so fokussiert ist, stellt sie sicher, dass alle Daten lokal bleiben und nur im Arbeitsspeicher (keine externen Aufrufe, außer zu Ollama auf localhost). Es ist eine großartige Wahl, wenn Sie speziell mit Dateien chatten möchten und keine allgemeine Konversation ohne ein Dokument benötigen.

Einschränkungen: Die Minimalismus von Chat-with-Notes bedeutet, dass sie viele Funktionen fehlt, die in anderen UIs gefunden werden. Zum Beispiel unterstützt sie nicht die Verwendung mehrerer Modelle oder Anbieter (sie ist Ollama-only by design), und sie speichert keine langfristige Bibliothek von Dokumenten – Sie laden Dateien nach Bedarf pro Sitzung, und es gibt keine persistente Vektorindex. Das Skalieren auf sehr große Dokumente könnte schwierig sein, ohne manuelle Anpassungen, da sie möglicherweise versucht, viel Text in den Prompt zu laden. Zudem ist die UI, obwohl funktional, nicht so poliert (kein Dunkelmodus, keine reichhaltige Formatierung der Antworten usw.). Im Grunde ist dieses Tool ideal für schnelle, einmalige Analysen von Dateien mit einem Ollama-Modell. Wenn Ihre Anforderungen wachsen (z. B. viele Dokumente, oder Wunsch nach einer aufwendigeren UI), könnten Sie Chat-with-Notes überwachsen. Aber als Ausgangspunkt oder persönliche „frage mein PDF“-Lösung über Ollama ist sie sehr effektiv.

Schlussfolgerung

Jede dieser Open-Source-UIs kann Ihre Erfahrung mit lokalen Ollama-Modellen verbessern, indem sie eine benutzerfreundliche Chat-Schnittstelle und zusätzliche Funktionen wie Dokumentfragebeantwortung bereitstellt. Die beste Wahl hängt von Ihren Anforderungen und Ihrer technischen Komfortzone ab:

- Für schnelle Einrichtung und Browser-basierte Nutzung: Page Assist ist eine großartige Wahl, die sich direkt in Ihre Web-Browsing integriert, ohne viel Aufwand.

- Für eine umfassende Web-App-Umgebung: Open WebUI oder LibreChat bieten umfangreiche Funktionen und Flexibilität mit mehreren Modellen, geeignet für erfahrene Nutzer oder Multi-Benutzer-Setups.

- Für eine polierte ChatGPT-Alternative mit Plugin-Potenzial: LobeChat bietet ein gutes Gleichgewicht zwischen Benutzerfreundlichkeit und Funktionen in einem selbstgehosteten Paket.

- Für dokumentenfokussierte Interaktionen: AnythingLLM liefert eine alle-in-einem-Lösung (insbesondere wenn Sie eine Desktop-App bevorzugen), während Chat-with-Notes eine minimalistische Herangehensweise für Einzel-Dokument-Q&A bietet.

Da alle diese Tools aktiv weiterentwickelt werden, können Sie auch mit Verbesserungen und Community-Unterstützung rechnen. Durch die Wahl eines dieser UIs können Sie mit Ihren lokal gehosteten Ollama-Modellen bequem chatten – ob es um Dokumentanalysen, Code-Unterstützung oder einfach um die Verfügbarkeit von konversationeller KI ohne Cloud-Abhängigkeiten geht. Jede der oben genannten Lösungen ist Open-Source, sodass Sie sie weiter an Ihre Bedürfnisse anpassen oder sogar an ihrer Entwicklung mitwirken können. Um zu sehen, wie lokale Ollama plus diese UIs mit anderen lokalen und Cloud-Optionen passt, prüfen Sie unseren LLM-Hosting: Lokal, Selbstgehostet & Cloud-Infrastruktur Verglichen Leitfaden.

Viel Spaß beim Chatten mit Ihrem lokalen LLM!