Top 17 des projets Python tendance sur GitHub

Dépôts Python tendance de janvier 2026

L’écosystème Python de ce mois est dominé par les Claude Skills et les outils d’agents IA. Cette analyse examine les dépôts Python les plus populaires sur GitHub.

Dépôts Python tendance de janvier 2026

L’écosystème Python de ce mois est dominé par les Claude Skills et les outils d’agents IA. Cette analyse examine les dépôts Python les plus populaires sur GitHub.

Dépôts Rust tendance de janvier 2026

L’écosystème Rust explose avec des projets innovants, en particulier dans les outils de codage en IA et les applications terminales. Ce panorama analyse les dépôts Rust les plus tendance sur GitHub ce mois-ci.

Dépôts Go tendance de janvier 2026

L’écosystème Go continue de prospérer avec des projets innovants couvrant l’outillage IA, les applications auto-hébergées et l’infrastructure développeur. Ce panorama analyse les dépôts Go les plus tendance sur GitHub ce mois-ci.

Choisissez le bon gestionnaire de paquets Python

Ce guide complet fournit des informations de base et une comparaison détaillée d’Anaconda, Miniconda et Mamba (https://www.glukhov.org/fr/post/2026/01/anaconda-vs-miniconda-vs-mamba/ “Comparaison d’Anaconda, Miniconda et Mamba”) - trois outils puissants qui sont devenus essentiels pour les développeurs Python et les scientifiques des données travaillant avec des dépendances complexes et des environnements de calcul scientifique.

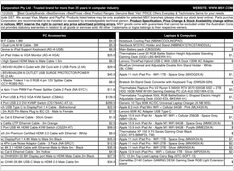

Tarification réelle de l'AUD par les détaillants australiens maintenant

Le NVIDIA DGX Spark (GB10 Grace Blackwell) est maintenant disponible en Australie chez les principaux détaillants de PC avec des stocks locaux. Si vous avez suivi les prix et disponibilités mondiaux du DGX Spark, vous serez intéressé de savoir que les prix australiens vont de 6 249 à 7 999 AUD selon la configuration de stockage et le détaillant.

Guide technique pour la détection de contenu généré par IA

La prolifération du contenu généré par l’IA a créé un nouveau défi : distinguer les écrits humains authentiques du « brouillon d’IA » - du texte synthétique de faible qualité, produit en masse.

Test de Cognee avec des LLM locaux - résultats réels

Cognee est un framework Python permettant de construire des graphes de connaissances à partir de documents en utilisant des LLM. Mais fonctionne-t-il avec des modèles auto-hébergés ?

Sorties de LLM type-sûres avec BAML et Instructor

Lors de l’utilisation de grands modèles de langage en production, obtenir des sorties structurées et de type sûr est essentiel. Deux frameworks populaires - BAML et Instructor - adoptent des approches différentes pour résoudre ce problème.

Raccourcis essentiels et commandes magiques

Améliorez rapidement la productivité avec le Jupyter Notebook grâce à des raccourcis essentiels, des commandes magiques et des conseils de workflow qui transformeront votre expérience en science des données et en développement.

Construisez des agents de recherche IA avec Python et Ollama

La bibliothèque Python d’Ollama inclut désormais des capacités natives de recherche web Ollama. Avec quelques lignes de code, vous pouvez enrichir vos modèles locaux de LLM avec des informations en temps réel provenant du web, réduisant ainsi les hallucinations et améliorant la précision.

Choisissez le bon DB vectoriel pour votre pile RAG

Le choix du bon stockage vectoriel peut faire la différence entre le succès et l’échec de votre application RAG en termes de performance, de coût et d’évolutivité. Cette comparaison approfondie couvre les options les plus populaires en 2024-2025.

Construisez des agents de recherche IA avec Go et Ollama

L’API de recherche web d’Ollama vous permet d’augmenter les LLM locaux avec des informations en temps réel du web. Ce guide vous montre comment implémenter des capacités de recherche web en Go, des appels d’API simples aux agents de recherche complets.

Construisez des pipelines d'IA/ML solides avec des microservices Go

Alors que les charges de travail d’IA et de ML deviennent de plus en plus complexes, le besoin de systèmes d’orchestration robustes est devenu plus important que jamais. La simplicité, la performance et la concurrence de Go en font un choix idéal pour construire la couche d’orchestration des pipelines ML, même lorsque les modèles eux-mêmes sont écrits en Python.

Unifiez le texte, les images et l'audio dans des espaces d'embedding partagés

Embeddings crois-modaux représentent une avancée majeure en intelligence artificielle, permettant de comprendre et de raisonner à travers différents types de données au sein d’un espace de représentation unifié.

Déployez l'intelligence artificielle d'entreprise sur des matériels abordables avec des modèles open source

La démocratisation de l’IA est ici. Avec des LLM open source comme Llama 3, Mixtral et Qwen qui rivalisent désormais avec les modèles propriétaires, les équipes peuvent construire une infrastructure puissante d’IA à l’aide du matériel grand public - réduisant les coûts tout en maintenant un contrôle complet sur la confidentialité des données et le déploiement.

LongRAG, Self-RAG, GraphRAG - Techniques de nouvelle génération

Retrieval-Augmented Generation (RAG) a évolué bien au-delà de la simple recherche de similarité vectorielle. LongRAG, Self-RAG et GraphRAG représentent l’avant-garde de ces capacités.