Implémenter des applications de workflow avec Temporal en Go : un guide complet

Construisez des workflows en Go avec le SDK Temporal

Construisez des workflows en Go avec le SDK Temporal

Stratégie d'observabilité de bout en bout pour l'inférence des modèles de langage et les applications basées sur les modèles de langage

Les systèmes LLM échouent de manière que le suivi classique des API ne peut pas révéler — les files d’attente se remplissent silencieusement, la mémoire GPU atteint sa capacité bien avant que le CPU ne semble chargé, et la latence explose au niveau du regroupement plutôt qu’au niveau de l’application. Ce guide couvre une stratégie complète d’observabilité pour l’inférence LLM et les applications LLM : ce qu’il faut mesurer, comment l’instrumenter avec Prometheus, OpenTelemetry et Grafana, et comment déployer le pipeline de télémétrie à grande échelle.

Métriques, tableaux de bord, journaux et alertes pour les systèmes de production — Prometheus, Grafana, Kubernetes et charges de travail d'IA.

Observabilité est le fondement des systèmes de production fiables.

Sans métriques, tableaux de bord et alertes, les clusters Kubernetes dérivent, les charges de travail d’IA échouent silencieusement et les régressions de latence passent inaperçues jusqu’à ce que les utilisateurs se plaignent.

Du RAG de base à la production : découpage, recherche vectorielle, ré-ranking et évaluation, le tout dans un guide.

Contrôlez les données et les modèles avec des LLM hébergés localement

L’hébergement local des LLM permet de garder les données, les modèles et l’inférence sous votre contrôle : une approche pratique pour atteindre la souveraineté en IA pour les équipes, les entreprises et les nations.

Test de vitesse du LLM sur RTX 4080 avec 16 Go de VRAM

Exécuter des modèles de langage volumineux localement vous offre la confidentialité, la capacité hors ligne et un coût API nul. Ce benchmark révèle exactement ce à quoi on peut s’attendre à partir de 14 modèles populaires LLMs sur Ollama sur un RTX 4080.

Répos Python tendances de janvier 2026

L’écosystème Python ce mois-ci est dominé par Claude Skills et les outils d’agents IA. Cette analyse examine les dépôts Python les plus tendances sur GitHub.

Dépôts Rust tendance de janvier 2026

L’écosystème Rust explose avec des projets innovants, en particulier dans les outils de codage en IA et les applications terminales. Ce panorama analyse les dépôts Rust les plus tendance sur GitHub ce mois-ci.

Dépôts Go tendance de janvier 2026

L’écosystème Go continue de prospérer avec des projets innovants couvrant l’outillage IA, les applications auto-hébergées et l’infrastructure développeur. Ce panorama analyse les dépôts Go les plus tendance sur GitHub ce mois-ci.

Alternative auto-hébergée de ChatGPT pour les LLM locaux

Open WebUI est une application web puissante, extensible et riche en fonctionnalités pour interagir avec les grands modèles de langage, hébergée localement.

Inférence rapide de LLM avec l'API OpenAI

vLLM est un moteur d’inférence et de déploiement à haut débit et économe en mémoire pour les grands modèles de langage (LLM), développé par le Sky Computing Lab de l’Université de Californie à Berkeley.

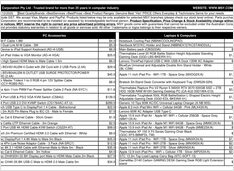

Prix AUD réels provenant de détaillants australiens dès maintenant.

Le NVIDIA DGX Spark (GB10 Grace Blackwell) est désormais disponible en Australie chez les principaux détaillants d’ordinateurs avec un stock local. Si vous suivez les prix et la disponibilité mondiaux du DGX Spark, vous serez intéressé de savoir que les prix en Australie varient de 6 249 $ à 7 999 $ AUD selon la configuration de stockage et le détaillant.

Guide technique pour la détection de contenu généré par IA

La prolifération du contenu généré par l’IA a créé un nouveau défi : distinguer les écrits humains authentiques du « brouillon d’IA » - du texte synthétique de faible qualité, produit en masse.

Test de Cognee avec des LLM locaux - résultats réels

Cognee est un framework Python permettant de construire des graphes de connaissances à partir de documents en utilisant des LLM. Mais fonctionne-t-il avec des modèles auto-hébergés ?