Tarifs DGX Spark AU : 6 249 $ à 7 999 $ chez les principaux détaillants

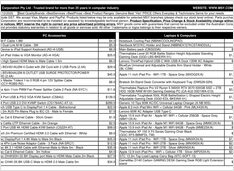

Prix AUD réels provenant de détaillants australiens dès maintenant.

Le NVIDIA DGX Spark (GB10 Grace Blackwell) est désormais disponible en Australie chez les principaux détaillants d’ordinateurs avec un stock local. Si vous suivez les prix et la disponibilité mondiaux du DGX Spark, vous serez intéressé de savoir que les prix en Australie varient de 6 249 $ à 7 999 $ AUD selon la configuration de stockage et le détaillant.