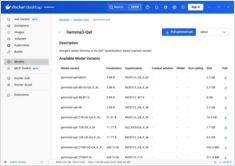

LocalAI QuickStart: Uruchamianie lokalnie modeli LLM zgodnych z OpenAI

Uruchom własny serwer z API zgodnym z OpenAI przy użyciu LocalAI w kilka minut.

LocalAI to serwer inferencji typu self-hosted i first-local zaprojektowany tak, aby zachowywał się jak kompatybilny zamiennik API OpenAI do uruchamiania obciążeń AI na Twoim własnym sprzęcie (laptop, stacja robocza lub serwer lokalny).