Samouczek Retrieval-Augmented Generation (RAG): Architektura, Implementacja i Przewodnik po Wdrożeniu

Od podstaw RAG do produkcji: podział na fragmenty, wyszukiwanie wektorowe, ponowne rangowanie i ocena w jednym przewodniku.

Ten tutorial dotyczący Retrieval-Augmented Generation (RAG) to przewodnik krok po kroku, skupiający się na wdrażaniu rzeczywistych systemów RAG.

Jeśli szukasz:

- Jak zbudować system RAG

- Wyjaśnienie architektury RAG

- Tutorial RAG z przykładami

- Jak zaimplementować RAG z bazami wektorowymi

- RAG z ponownym rankowaniem

- RAG z wyszukiwaniem w sieci

- Najlepsze praktyki wdrażania RAG

Znajdujesz się w odpowiednim miejscu.

Ten przewodnik łączy praktyczne wiedzy dotyczące implementacji RAG, wzorce architekturalne oraz techniki optymalizacji używane w systemach AI produkcyjnych.

Mapa klastra RAG (Przeczytaj w kolejności)

Jeśli chcesz najkrótszą drogę przez klastera RAG, wykorzystaj tę mapę:

- Jesteś tutaj: Omówienie RAG + pełny pipeline (ta strona)

- Chunking (podstawa jakości wyszukiwania): Strategie chunkowania w RAG

- Bazy wektorowe (wybór magazynu + indeksowania): Porównanie baz wektorowych dla RAG

- Głębia wyszukiwania (kiedy „wyszukiwanie” nie wystarcza): Wyszukiwanie vs DeepSearch vs Deep Research

- Ponowne rankowanie (często największy przyrost jakości): Ponowne rankowanie z modelami embedingu

- Embeddingi + modele ponownego rankowania (praktyczne implementacje):

- Zaawansowane architektury: Zaawansowane warianty RAG: LongRAG, Self-RAG, GraphRAG

Co to jest Retrieval-Augmented Generation (RAG)?

Retrieval-Augmented Generation (RAG) to wzorzec projektowania systemu, który łączy:

- Wyszukiwanie informacji

- Augmentację kontekstu

- Generację przez modele językowe

W prostych słowach, pipeline RAG pobiera odpowiednie dokumenty i wstrzykuje je do monologu przed generowaniem odpowiedzi przez model.

W przeciwieństwie do finetuningowania, RAG:

- Działa z często aktualizowanymi danymi

- Obsługuje prywatne bazy wiedzy

- Zmniejsza halucynacje

- Unika ponownego trenowania dużych modeli

- Poprawia gruntowanie odpowiedzi

Nowoczesne systemy RAG obejmują więcej niż tylko wyszukiwanie wektorowe. Pełna implementacja RAG może obejmować:

- Przeformowanie zapytań

- Wyszukiwanie hybrydowe (BM25 + wektorowe)

- Ponowne rankowanie za pomocą cross-encoderów

- Wyszukiwanie wielostopniowe

- Integrację wyszukiwania w sieci

- Ocena i monitorowanie

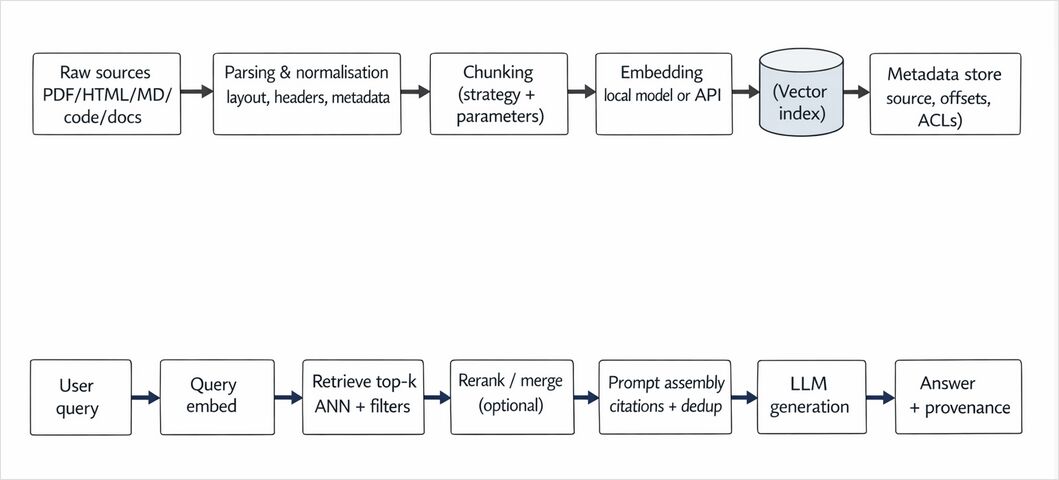

Minimalny projekt produkcyjny RAG (Implementacja odniesienia)

Użyj tego jako modelu myślowego (i szkieletu początkowego) dla produkcyjnego RAG.

Pipeline importu (offline lub ciągły)

- Zbierz źródła (dokumenty, bilety, strony internetowe, PDFy, kod)

- Normalizuj (wyodrębnij tekst, wyczyść boilerplate, usuń duplikaty)

- Podziel na fragmenty (wybierz strategię + nakładanie + metadane)

- Zaencodinguj (wersjonowane embeddingi)

- Wstaw do indeksu (baza wektorowa + pola metadanych)

- Strategia reindeksowania przy zmianie embeddingów lub podziału na fragmenty

Pipeline zapytań (online)

- Przeanalizuj / przeformuj zapytanie (opcjonalnie)

- Wyszukaj kandydatów (wektorowe lub hybrydowe + filtracja metadanych)

- Ponownie uporządkuj najlepszych K wyników za pomocą modelu cross-encoder lub ponownego rankowania

- Złożenie kontekstu (usunięcie duplikatów, uporządkowanie według ważności, dodanie cytowań)

- Generuj z zasadami promptu (zachowanie odmowy)

- Zaloguj (zbiór wyników wyszukiwania, zbiór wyników ponownego rankowania, końcowy kontekst, opóźnienie, koszt)

- Oceń (harnes online/offline)

Jeśli poprawisz tylko jedną rzecz w działającym systemie RAG: dodaj ponowne rankowanie i harnes do oceny.

Krok po kroku: tutorial RAG – jak zbudować system RAG

Ta sekcja przedstawia praktyczny przewodnik krok po kroku dla programistów.

Krok 1: Przygotuj i podziel swoje dane

Jakość wyszukiwania zależy w dużej mierze od strategii podziału i projektu indeksu: dobry RAG zaczyna się od odpowiedniego podziału na fragmenty.

Podział na fragmenty decyduje:

- O pokryciu wyszukiwania

- Opóźnieniu

- Szumie kontekstu

- Koszcie tokenów

- Ryzyku halucynacji

Powszechne strategie podziału w RAG obejmują:

- Podział na stałe fragmenty

- Podział z oknem przesuwającym się

- Podział semantyczny

- Podział rekursywny

- Podział hierarchiczny

- Podział świadomy metadanych

Zły podział to jedna z najczęściej występujących przyczyn niskiej wydajności systemów RAG.

Aby dokładnie i z punktu widzenia inżynierii przeanalizować skutki podziału, wymiary oceny, macierze decyzyjne oraz wdrożenie Pythona, zobacz:

Strategie podziału w RAG: alternatywy, skutki i przykłady

Ten przewodnik obejmuje praktyczne domyślne ustawienia dla:

- Systemów QA

- Pipeline’ów sumaryzacji

- Wyszukiwania kodu

- Dokumentów multimodalnych

- Ingestionu strumieniowego

Jeśli poważnie chcesz poprawić wydajność RAG, przeczytaj ten przewodnik przed dostosowaniem embeddingów lub ponownego rankowania.

Krok 2: Wybierz bazę wektorową dla RAG

Baza wektorowa przechowuje embeddiny dla szybkiego wyszukiwania podobieństw.

Porównaj bazy wektorowe tutaj:

Porównanie baz wektorowych dla RAG

Podczas wyboru bazy wektorowej dla tutoriala RAG lub systemu produkcyjnego rozważ:

- Typ indeksu (HNSW, IVF itp.)

- Obsługa filtrów

- Model wdrażania (chmura vs. samozorganizowana)

- Opóźnienie zapytań

- Skalowalność poziomą

- Wymagania dotyczące wielodostępności i kontroli dostępu

Krok 3: Zaimplementuj wyszukiwanie (wyszukiwanie wektorowe lub hybrydowe)

Podstawowe wyszukiwanie w RAG korzysta z podobieństwa embeddingów.

Zaawansowane wyszukiwanie w RAG korzysta z:

- Wyszukiwania hybrydowego (wektor + słowo kluczowe)

- Filtracji metadanych

- Wyszukiwania wieloindeksowego

- Przeformowania zapytań

Dla fundamentów koncepcyjnych:

Wyszukiwanie vs DeepSearch vs Deep Research

Zrozumienie głębokości wyszukiwania jest kluczowe dla wysokiej jakości pipeline’ów RAG.

Krok 4: Dodaj ponowne rankowanie do pipeline’a RAG

Ponowne rankowanie często daje największy przyrost jakości w implementacji RAG.

Ponowne rankowanie poprawia:

- Dokładność

- Relevans kontekstu

- Wiarygodność

- Stosunek sygnał/hałas

Nauczy się technik ponownego rankowania:

- Ponowne rankowanie z modelami embeddingu

- Qwen3 Embedding + Qwen3 Reranker na Ollama

- Ponowne rankowanie z Ollama + Qwen3 Embedding (Go)

- Ponowne rankowanie z Ollama + Qwen3 Reranker w Go

W systemach RAG produkcyjnych, ponowne rankowanie często ma większy wpływ niż przejście na większy model.

Krok 5: Integruj wyszukiwanie w sieci (opcjonalnie, ale potężne)

Wyszukiwanie w sieci wzbogacane RAG umożliwia dynamiczne pozyskiwanie wiedzy.

Wyszukiwanie w sieci jest przydatne dla:

- Danych w czasie rzeczywistym

- Asystentów AI świadomych aktualności

- Wiedzy konkurencyjnej

- Odpowiedzi na pytania w otwartym obszarze

Zobacz praktyczne implementacje:

Krok 6: Buduj ramy oceny RAG

Serious tutorial RAG musi obejmować ocenę. Bez niej optymalizacja systemu RAG staje się domysłami.

Co mierzyć

| Warstwa | Co mierzyć | Dlaczego to ważne |

|---|---|---|

| Ingestion | pokrycie fragmentów, stopień duplikacji, wersja embeddingu | zapobiega cichemu przesuwaniu |

| Wyszukiwanie | recall@k, precision@k, MRR/NDCG | mówi, czy pobierasz odpowiednie dowody |

| Ponowne rankowanie | zmiana w precision@k w porównaniu do podstawy | potwierdza zwrót inwestycji w ponownym rankowaniu |

| Generowanie | wiarygodność / gruntowanie, dokładność cytowań, jakość odmowy | zmniejsza halucynacje |

| System | opóźnienie p50/p95, koszt na zapytanie, stopień trafienia w pamięci podręcznej | utrzymuje produkcyjność |

Minimalna ramy oceny (praktyczna lista kontrolna)

- Stwórz zestaw testowy zapytań (jeśli to możliwe, rzeczywiste zapytania użytkownika)

- Dla każdego zapytania, przechowaj:

- oczekiwana odpowiedź lub oczekiwane źródła

- dostępne źródła (dokumenty złote) jeśli są dostępne

- Uruchom offline batch:

- pobierz kandydatów

- ponownie uporządkuj

- wygeneruj

- ocen (wyszukiwanie + generowanie)

- Śledź metryki w czasie i przerwij kompilację w przypadku regresji (nawet drobnej)

Zacznij od prostego: 50–200 zapytań wystarczy, by wykryć znaczne regresje.

Zaawansowane architektury RAG

Po zrozumieniu podstaw RAG, eksploruj zaawansowane wzorce:

Zaawansowane warianty RAG: LongRAG, Self-RAG, GraphRAG

Zaawansowane architektury Retrieval-Augmented Generation umożliwiają:

- Rozumowanie wielokrotnego skoku

- Wyszukiwanie oparte na grafach

- Samokorygujące się pętle

- Integrację strukturalnej wiedzy

Te architektury są kluczowe dla systemów AI na poziomie przedsiębiorstwa.

Kiedy RAG zawodzi (i jak to naprawić)

Większość przypadków awarii RAG można zdiagnozować, jeśli spojrzysz warstwa po warstwie na pipeline.

- Zwraca nieprawidłowy kontekst → popraw podział na fragmenty, dodaj filtry metadanych, zaimplementuj wyszukiwanie hybrydowe, dostosuj K.

- Pobiera odpowiednie dokumenty, ale odpowiada błędnie → dodaj ponowne rankowanie, zmniejsz szum kontekstu, popraw reguły gruntowania promptu.

- Halucynuje mimo dobrej jakości dokumentów → wymuś cytowanie, dodaj zachowanie odmowy, dodaj ocenę wiarygodności, zmniejsz „kreatywną” temperaturę.

- Jest wolny/ drogi → zapisz wyniki wyszukiwania + embeddingi, zmniejsz K ponownego rankowania, ogranicz kontekst, grupuj embeddingi, dostosuj parametry indeksu ANN.

- Wycieka dane między klientami → zaimplementuj filtrowanie ACL podczas wyszukiwania (nie tylko w promptach), oddziel indeksy lub podziały na klienta.

Powszechne błędy implementacji RAG

Powszechne błędy w tutorialach RAG dla początkujących obejmują:

- Użycie zbyt dużych fragmentów dokumentów

- Pominiecie ponownego rankowania

- Nadmierny obciążenie okna kontekstu

- Brak filtrów metadanych

- Brak ramy oceny

Naprawienie tych błędów znacząco poprawia wydajność systemu RAG.

RAG vs Finetuning

W wielu tutorialach RAG i finetuning są mylone. Użyj tego przewodnika do podejmowania decyzji:

| Powinieneś preferować… | Kiedy… |

|---|---|

| RAG | wiedza zmienia się często; potrzebujesz cytowań/auditowalności; masz prywatne dokumenty; chcesz szybkie aktualizacje bez ponownego trenowania |

| Finetuning | potrzebujesz spójnego tonu/behawioru; chcesz, by model przestrzegał wytycznych stylu dziedziny; Twoja wiedza jest względnie statyczna |

| Oba | potrzebujesz zachowania dziedziny i świeżej/prywatnej wiedzy (powszechne w produkcji) |

Użyj RAG dla:

- Pozyskiwania wiedzy zewnętrznej

- Często aktualizowanych danych

- Mniejszego ryzyka operacyjnego

Użyj finetuninga dla:

- Kontroli behawioru

- Spójności tonu/stylu

- Adaptacji do dziedziny, gdy dane są statyczne

Większość zaawansowanych systemów AI łączy Retrieval-Augmented Generation z wybiórczym finetuningiem.

Najlepsze praktyki wdrażania RAG

Jeśli przechodzisz z tutoriala RAG na produkcyjne wdrożenie:

Wyszukiwanie + jakość

- Użyj wyszukiwania hybrydowego

- Dodaj ponowne rankowanie

- Użyj filtrów metadanych i deduplikacji

- Śledź metryki wyszukiwania (recall@k / precision@k) ciągle

Koszt + opóźnienie (nie pomijaj tego)

- Cachuj:

- Cache embeddingów (identyczny tekst → identyczny embedding)

- Cache wyszukiwania (popularne zapytania)

- Cache odpowiedzi (dla deterministycznych przepływów)

- Dostosuj parametry indeksu ANN (HNSW/IVF) i operacje grupowe

- Kontroluj użycie tokenów: mniejszy kontekst, mniej kandydatów, strukturalne prompty

Bezpieczeństwo + prywatność

- Wprowadź kontrolę dostępu w czasie wyszukiwania (filtrowanie ACL / podziały na klienta)

- Skryj lub unikaj indeksowania PII, jeśli to możliwe

- Bezpiecznie loguj (unikaj przechowywania surowych wrażliwych promptów, chyba że jest to konieczne)

Dyscyplina operacyjna

- Wersjonuj swoje embeddingi i strategię podziału na fragmenty

- Automatyzuj pipeline importu

- Monitoruj metryki halucynacji/wiarygodności

- Śledź koszt na zapytanie

Retrieval-Augmented Generation to nie tylko koncepcja tutoriala – to dyscyplina architektury produkcyjnej.

Ostateczne myśli

Ten tutorial RAG obejmuje zarówno podstawowe implementacje, jak i zaawansowane projekty systemowe.

Retrieval-Augmented Generation to fundament nowoczesnych aplikacji AI.

Zrozumienie architektury RAG, ponownego rankowania, baz wektorowych, wyszukiwania hybrydowego i oceny decyduje, czy Twój system AI pozostanie tylko demo – czy stanie się gotowy do produkcji.

Temat ten będzie się kontynuował w miarę ewolucji systemów RAG.