Porównanie: Qwen3:30b vs GPT-OSS:20b

Porównanie prędkości, parametrów i wydajności tych dwóch modeli

Oto porównanie między Qwen3:30b a GPT-OSS:20b skupiające się na przestrzeganiu instrukcji i parametrach wydajności, specyfikacjach oraz prędkości.

Porównanie prędkości, parametrów i wydajności tych dwóch modeli

Oto porównanie między Qwen3:30b a GPT-OSS:20b skupiające się na przestrzeganiu instrukcji i parametrach wydajności, specyfikacjach oraz prędkości.

Szacunkowe koszty hostingowe vs. subskrypcja.

Oto szybki przegląd Write.as / WriteFreely – jak pasuje do fediverse, gdzie znaleźć hosting zarządzany, jak wygląda trend wykorzystania, oraz jak samodzielnie zainstalować (wraz z szacunkowymi kosztami).

+ Konkretne Przykłady Używania Myślących LLMów

W tym wpisie omówimy dwa sposoby połączenia swojej aplikacji Python z Ollama: 1. Poprzez HTTP REST API; 2. Poprzez oficjalną bibliotekę Pythona do Ollama.

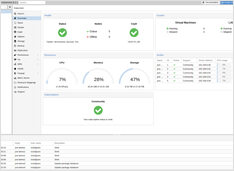

Co to jest Proxmox?

Proxmox Virtual Environment (Proxmox VE) to otwarty źródłowy, typu 1 hypervisor i platforma orchestracji centrów danych oparta na Debianie.

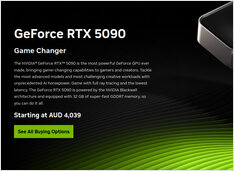

Ceny konsumenckich GPU odpowiednich do AI – RTX 5080 i RTX 5090

Porównajmy ceny najwyższych pod względem wydajności kart graficznych konsumenckich, które są szczególnie odpowiednie do modeli językowych (LLM) oraz sztucznej inteligencji ogólnie. Konkretnie przyglądam się cenom RTX-5080 i RTX-5090. Nieco spadły.

Nie bardzo ładnie.

Modely GPT-OSS z Ollama mają powtarzające się problemy z obsługą strukturalnego wyjścia, szczególnie gdy są używane wraz z frameworkami takimi jak LangChain, OpenAI SDK, vllm i innymi.

Kilka sposobów na uzyskanie strukturalnego wyjścia z Ollama

Duże modele językowe (LLMs)

są potężne, ale w środowisku produkcyjnym rzadko chcemy wolnych paragrafów.

Zamiast tego chcemy przewidywalne dane: atrybuty, fakty lub strukturalne obiekty, które można przekazać do aplikacji.

To Strukturalne wyjście LLM.

Przytestowałem zarówno Kubuntu, jak i KDE Neon; Kubuntu jest bardziej stabilny.

Dla fanów KDE Plasma w dyskusjach często pojawiają się dwie dystrybucje Linuksa: Kubuntu i KDE Neon. Mogą wydawać się podobne – obie dostarczają KDE Plasma jako domyślny pulpit, obie są oparte na Ubuntu i obie są przyjazne dla początkujących.

Moje własne testy harmonogramowania modeli ollama

Oto porównanie jak dużo VRAM nowa wersja Ollama przydziela modelowi z poprzednią wersją Ollama. Nowa wersja jest gorsza.

Uwagi dotyczące konfiguracji statycznego adresu IP w Linuxie

Ten przewodnik pokaże Ci, jak zmienić stały adres IP na serwerze Ubuntu.

Moje spojrzenie na obecnym stanie rozwoju Ollama

Ollama szybko stało się jednym z najpopularniejszych narzędzi do uruchamiania modeli językowych na lokalnym komputerze.

Jego proste CLI i zoptymalizowane zarządzanie modelami sprawiły, że stało się preferowanym wyborem dla programistów, którzy chcą pracować z modelami AI poza chmurą.

Alternatywna platforma komunikacji głosowej nad IP

Mumble to darmowy i open-source aplikacja do wideo i głosu (VoIP), zaprojektowana głównie do czasu rzeczywistego komunikowania się głosem. Wykorzystuje architekturę klient-serwer, gdzie użytkownicy łączą się z udostępnionym serwerem, aby rozmawiać ze sobą.

Krótki przegląd najbardziej wyraźnych interfejsów użytkownika dla Ollama w 2025 roku

Lokalnie hostowane Ollama umożliwia uruchomienie dużych modeli językowych na własnym komputerze, ale korzystanie z niego za pośrednictwem wiersza poleceń nie jest przyjazne dla użytkownika. Oto kilka projektów open source, które oferują interfejsy stylu ChatGPT, łączące się z lokalnym Ollama.

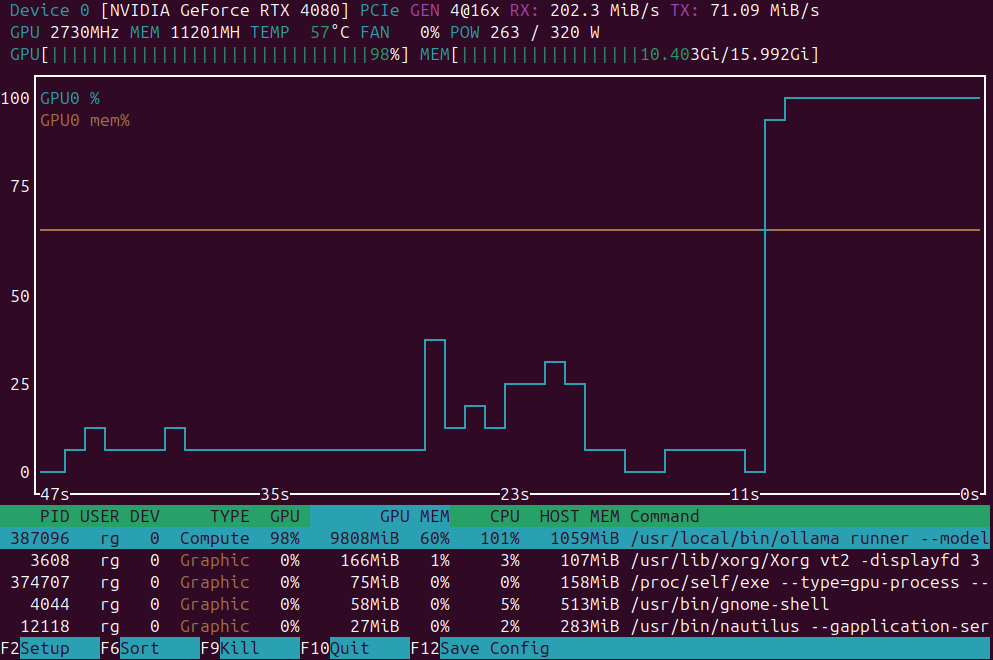

Krótki wykaz aplikacji do monitorowania obciążenia GPU

Monitorowanie obciążenia GPU: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

Instalacja małego klastra Kubernetes z użyciem k3s na homelabie

Oto krok po kroku instrukcja instalacji

3-węzłowego klastra K3s

na serwerach nago metalowych (1 serwer główny + 2 serwery robocze).

Bardzo krótka charakterystyka wersji kubernetes

Porównanie dystrybucji self-hosting Kubernetes przeznaczonych do hostowania na serwerach nago-metalowych lub domowych, zwracając uwagę na łatwość instalacji, wydajność, wymagania systemowe oraz zestaw funkcji.