Implementera Workflow-applikationer med Temporal i Go: En komplett guide

Bygg arbetsflöden i Go med Temporal SDK

Bygg arbetsflöden i Go med Temporal SDK

Slutpunkt-till-slutpunkt-övervakningsstrategi för LLM-inferens och LLM-program

LLM-system kan misslyckas på sätt som traditionell API-övervakning inte kan upptäcka – köer fylls tyst, GPU-minne fylls långt innan CPU verkar sysselsatt, och latens exploderar i batchningslageret snarare än i applikationslageret. Den här guiden täcker en fullständig övervakningsstrategi för LLM-inferens och LLM-applikationer: vad du bör mäta, hur du instrumenterar det med Prometheus, OpenTelemetry och Grafana, och hur du distribuerar telemetri-pipelinen i stora skala.

Från grundläggande RAG till produktion: uppdelning, vektorsökning, omrangering och utvärdering i en guide.

Mätningar, instrumentpaneler, loggar och varningar för produktionssystem – Prometheus, Grafana, Kubernetes och AI-belasta.

Observabilitet är grunden för pålitliga produktionsystem.

Utan metrik, dashboard och varningar drar Kubernetes-kluster, AI-arbetslaster misslyckas tyst och latensregressioner går oobserverade tills användare klagar.

Styra data och modeller med självvärddade LLM:er

Self-hosting av LLM:er håller data, modeller och inferens under din kontroll – en praktisk väg till AI-soveränitet för team, företag och nationer.

LLM-hastighetstest på RTX 4080 med 16 GB VRAM

Att köra stora språkmodeller lokalt ger dig integritet, möjlighet att använda dem offline och noll kostnader för API:er. Detta benchmark visar exakt vad man kan förvänta sig från 14 populära LLMs på Ollama på en RTX 4080.

Januari 2026 – trendande Python-repositorier

Den Python-ekosystemet denna månad domineras av Claude Skills och verktyg för AI-agenter. Denna översikt analyserar de mest populära Python-repositorierna på GitHub.

Januari 2026 populära Rust-repo

Rust-ekosystemet exploderar med innovativa projekt, särskilt inom AI-kodverktyg och terminalapplikationer. Den här översikten analyserar de topp 23 mest populära Rust-repo på GitHub denna månad.

Januari 2026 populära Go-repo

Go-ekosystemet fortsätter att blomstra med innovativa projekt inom AI-verktyg, självvärddade program och utvecklareinfrastruktur. Den här översikten analyserar de topp 100 populära Go-repositorier på GitHub denna månad.

Egenvärd ChatGPT-alternativ för lokala LLMs

Öppna WebUI är ett kraftfullt, utökligt och funktionstomt självvärddat webbgränssnitt för att interagera med stora språkmodeller.

Snabb LLM-inference med OpenAI API

vLLM är en högflödes- och minneseffektiv inferens- och serveringmotor för stora språkmotorer (LLM) som utvecklats av UC Berkeleys Sky Computing Lab.

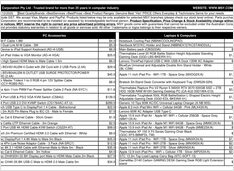

Verkliga AUD-priser från australiska återförsäljare nu

NVIDIA DGX Spark (https://www.glukhov.org/sv/hardware/ai/nvidia-dgx-spark/ “NVIDIA DGX Spark - liten AI-superdator”) (GB10 Grace Blackwell) är nu tillgänglig i Australien (https://www.glukhov.org/sv/hardware/ai/dgx-spark-pricing-in-australia/ “DGX Spark i Australien”) hos större datorhandlare med lokalt lager. Om du har följt globala priser och tillgänglighet för DGX Spark, är du kanske intresserad av att veta att priserna i Australien ligger mellan 6 249 och 7 999 AUD beroende på lagringskonfiguration och återförsäljare.

Teknisk guide för upptäckt av AI-genererat innehåll

AI-genererad innehålls explosion har skapat ett nytt utmaning: att skilja mellan riktigt mänskligt skrivande och “AI slop” - lågkvalitativt, massproducerat syntetiskt text.

Testa Cognee med lokala LLMs - verkliga resultat

Cognee är en Pythonramverk för att bygga kunskapsgrafer från dokument med hjälp av LLMs. Men fungerar det med självvärdbaserade modeller?