Jämförelse: Qwen3:30b vs GPT-OSS:20b

Jämföra hastighet, parametrar och prestanda hos dessa två modeller

Här är en jämförelse mellan Qwen3:30b och GPT-OSS:20b fokuserande på instruktionssäljning och prestandaparametrar, specifikationer och hastighet.

Jämföra hastighet, parametrar och prestanda hos dessa två modeller

Här är en jämförelse mellan Qwen3:30b och GPT-OSS:20b fokuserande på instruktionssäljning och prestandaparametrar, specifikationer och hastighet.

Uppskattade värdningskostnadsberäkningar jämfört med prenumeration.

Här är en snabb information om Write.as / WriteFreely - hur det passar in i fediversumet, var man kan få hanterad värd, hur användningstrenden ser ut och hur man själv värdar (plus grova kostnadsberäkningar).

+ Specifika exempel med hjälp av tänkande LLMs

I detta inlägg kommer vi att utforska två sätt att ansluta din Python-applikation till Ollama: 1. Via HTTP REST API; 2. Via den officiella Ollama Python-biblioteket.

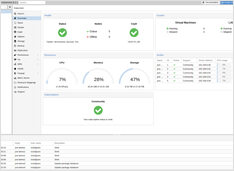

Vad är Proxmox?

Proxmox Virtual Environment (Proxmox VE) är en öppen källkod, typ-1 hypervisor och datacenter-orkestreringsplattform byggd på Debian.

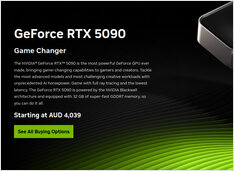

Priser på AI-lämpliga konsument-GPU:er – RTX 5080 och RTX 5090

Låt oss jämföra prissättning för toppkategorins konsument-GPU:n, som är särskilt lämpade för LLM och AI i allmänhet. Specifikt tittar jag på RTX-5080 och RTX-5090-priser. De har sjunkit lite.

Ingenstans särskilt fin.

Ollama’s GPT-OSS modeller har återkommande problem med att hantera strukturerad utdata, särskilt när de används med ramverk som LangChain, OpenAI SDK, vllm och andra.

Några sätt att få strukturerad utdata från Ollama

Stora språkmodeller (LLMs) är kraftfulla, men i produktion vill vi sällan ha fritt formulerade stycken. Istället vill vi ha förutsägbart data: attribut, fakta eller strukturerade objekt som du kan mata in i en app. Det är LLM Strukturerad Utdata.

Har testat både Kubuntu och KDE Neon, Kubuntu är mer stabilt.

För KDE Plasma-fans kommer två Linux-distributioner ofta upp i diskussionen: Kubuntu och KDE Neon. De kan verka liknande – båda levereras med KDE Plasma som standardbördsystem, båda baseras på Ubuntu och båda är vänliga mot nybörjare.

Min egen test av ollama-modellplanering

Här jämför jag hur mycket VRAM den nya versionen av Ollama allokerar för modellen hur mycket VRAM den nya versionen av Ollama allokerar för modellen med den tidigare versionen av Ollama. Den nya versionen är sämre.

Anteckningar om konfiguration av statisk IP i Linux

Denna guide kommer att guida dig genom processen att ändra den statiska IP-adressen på en Ubuntu Server.

Min syn på den nuvarande utvecklingen av Ollama

Ollama har snabbt blivit en av de mest populära verktygen för att köra LLM:er lokalt. Dess enkla CLI och streamlina modellhantering har gjort det till ett förfrågat alternativ för utvecklare som vill arbeta med AI-modeller utanför molnet.

Alternativ plattform för röstkommunikation över IP

Mumble är en fri och öppen källkodstalkapplikation för röst över IP (VoIP) som främst är utformad för realtidskommunikation. Den använder en klient-serverarkitektur där användare ansluter till en gemensam server för att prata med varandra.

Snabb översikt över de mest framträdande UI:erna för Ollama år 2025

Lokalt värd Ollama möjliggör att köra stora språkmodeller på din egen dator, men att använda den via kommandoraden är inte användarvänligt. Här är flera öppen källkodprojekt som tillhandahåller ChatGPT-stilgränssnitt som ansluter till en lokal Ollama.

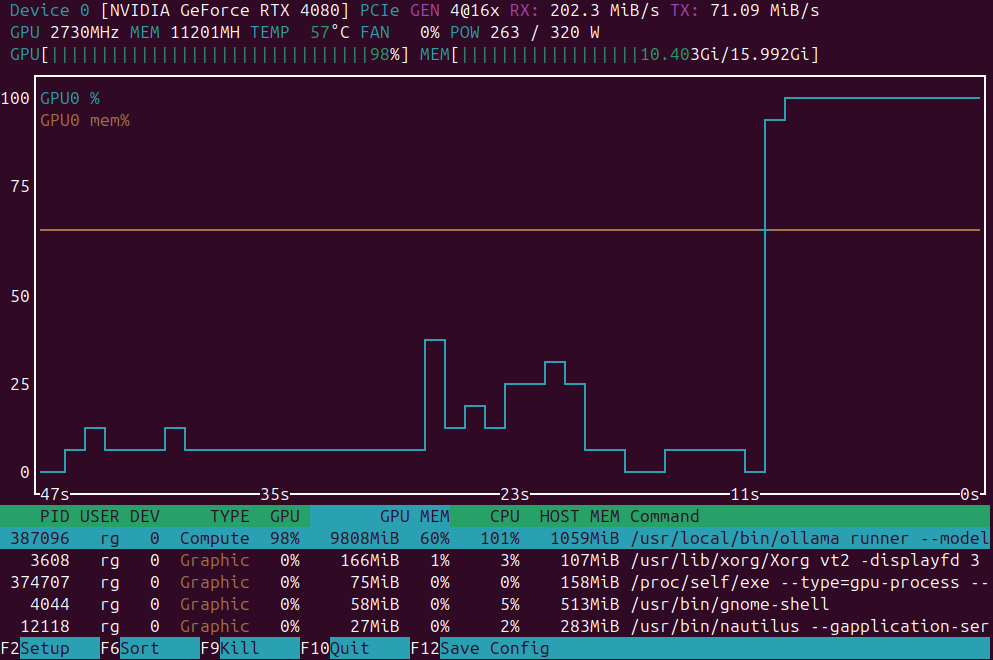

Liten lista över applikationer för GPU-lastövervakning

GPU-lastmätningsprogram: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

Installera liten k3s Kubernetes på hemma-labkluster

Här är en steg-för-steg-guide för installation av en 3-nod K3s-kluster på bare-metal servrar (1 master + 2 workers).

Kort översikt över Kubernetes-varianter

Jämförelse av self-hosting Kubernetes-distributioner för värd på bare-metal eller hemservrar, med fokus på enkel installation, prestanda, systemkrav och funktionsuppsättningar.