Zmniejsz koszty LLM: strategie optymalizacji tokenów

Zredukuj koszty LLM o 80% dzięki inteligentnej optymalizacji tokenów

Optymalizacja tokenów to kluczowe umiejętności, które oddzielają kosztowne aplikacje LLM od doświadczeń zużycia budżetu.

Zredukuj koszty LLM o 80% dzięki inteligentnej optymalizacji tokenów

Optymalizacja tokenów to kluczowe umiejętności, które oddzielają kosztowne aplikacje LLM od doświadczeń zużycia budżetu.

Tworzenie serwerów MCP dla asystentów AI z przykładami w Pythonie

Protokół Kontekstu Modelu (MCP) rewolucjonizuje sposób, w jaki asystenci AI interagują z zewnętrznymi źródłami danych i narzędziami. W tym przewodniku omówimy, jak zbudować serwery MCP w Pythonie, z przykładami skupionymi na możliwościach wyszukiwania w sieci i skrapowania.

Dostępność, rzeczywiste ceny detaliczne w sześciu krajach oraz porównanie z Mac Studio.

NVIDIA DGX Spark jest prawdziwy, dostępny od 15 października 2025 r., skierowany do deweloperów CUDA potrzebujących lokalnej pracy z modelami LLM z zintegrowanym stackiem AI NVIDIA. Cena MSRP w USA: 3 999 USD; ceny detaliczne w Wielkiej Brytanii/Niemczech/Japonii są wyższe ze względu na VAT i kanały dystrybucji. Publiczne ceny w AUD/KRW nie są jeszcze szeroko publikowane.

Integracja Ollama z Go: przewodnik po SDK, przykłady i najlepsze praktyki w środowisku produkcyjnym.

Ten przewodnik oferuje kompleksowy przegląd dostępnych Go SDKs dla Ollama i porównuje ich zestawy funkcji.

Porównanie prędkości, parametrów i wydajności tych dwóch modeli

Oto porównanie między Qwen3:30b a GPT-OSS:20b skupiające się na przestrzeganiu instrukcji i parametrach wydajności, specyfikacjach oraz prędkości.

+ Konkretne Przykłady Używania Myślących LLMów

W tym wpisie omówimy dwa sposoby połączenia swojej aplikacji Python z Ollama: 1. Poprzez HTTP REST API; 2. Poprzez oficjalną bibliotekę Pythona do Ollama.

Nie bardzo ładnie.

Modely GPT-OSS z Ollama mają powtarzające się problemy z obsługą strukturalnego wyjścia, szczególnie gdy są używane wraz z frameworkami takimi jak LangChain, OpenAI SDK, vllm i innymi.

Slightly different APIs require special approach. Slightly different APIs require special approach.

Oto porównanie wsparcia w formie obok siebie dla strukturalnego wyjścia (otrzymywanie niezawodnego JSON) wśród popularnych dostawców LLM, wraz z minimalnymi przykładami w Pythonie

Kilka sposobów na uzyskanie strukturalnego wyjścia z Ollama

Duże modele językowe (LLMs)

są potężne, ale w środowisku produkcyjnym rzadko chcemy wolnych paragrafów.

Zamiast tego chcemy przewidywalne dane: atrybuty, fakty lub strukturalne obiekty, które można przekazać do aplikacji.

To Strukturalne wyjście LLM.

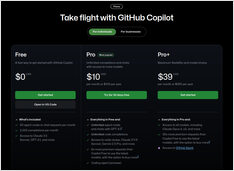

Opis, lista poleceń planów oraz skróty klawiszowe

Oto aktualny ściągawka dla GitHub Copilot, pokrywająca niezbędne skróty, polecenia, wskazówki dotyczące użytkowania oraz funkcje kontekstowe dla Visual Studio Code i Copilot Chat.

Długi artykuł o specyfikacjach i implementacji MCP w GO

Oto opis Protokołu Kontekstu Modelu (MCP), krótkie uwagi dotyczące sposobu implementacji serwera MCP w Go, w tym struktura wiadomości i specyfikacja protokołu.

Wdrażasz RAG? Oto kilka fragmentów kodu w Go – część 2...

Ponieważ standardowe Ollama nie posiada bezpośredniego interfejsu API do ponownego rankingu (reranking), musisz zaimplementować ponowny ranking przy użyciu Qwen3 Reranker w GO, generując wektory (embeddings) dla par zapytanie-dokument i przypisując im oceny.

Wdrażasz RAG? Oto kilka fragmentów kodu w języku Golang.

Ten niewielki przykład kodu Go do rerankingu wywołuje Ollamę do generowania wektorów dla zapytania oraz dla każdego dokumentu kandydackiego, następnie sortuje wyniki malejąco według podobieństwa kosinusowego.

LLM do wyodrębniania tekstu z HTML...

W bibliotece modeli Ollama są modele, które potrafią konwertować zawartość HTML na Markdown, co jest przydatne w zadaniach związanych z konwersją treści. Ten przewodnik jest częścią naszego Narzędzia dokumentacyjne w 2026: Markdown, LaTeX, PDF i przepływ pracy druku hub.

Cursor AI vs GitHub Copilot vs Cline AI vs...

Poniżej wymienię narzędzia wspomagające kodowanie z pomocą AI oraz Asystentów AI do Kodowania i ich zalety.

Programowanie wspierane przez AI, gdzie opisujesz zamiast wpisywać kod.

Vibe coding to napędzane przez sztuczną inteligencję podejście do programowania, w którym deweloperzy opisują pożądaną funkcjonalność w języku naturalnym, a narzędzia AI automatycznie generują kod – przy minimalnym bezpośrednim pisaniu.