Сравнение: Qwen3:30b против GPT-OSS:20b

Сравнение скорости, параметров и производительности этих двух моделей

Вот сравнение между Qwen3:30b и GPT-OSS:20b, с акцентом на выполнение инструкций и параметры производительности, спецификации и скорость.

Сравнение скорости, параметров и производительности этих двух моделей

Вот сравнение между Qwen3:30b и GPT-OSS:20b, с акцентом на выполнение инструкций и параметры производительности, спецификации и скорость.

Приблизительные оценки стоимости хостинга по сравнению с подпиской.

Вот краткая информация о Write.as / WriteFreely - как это вписывается в fediverse, где можно получить управляемый хостинг, как выглядит тенденция использования, и как развернуть самостоятельно (плюс примерные расчеты стоимости).

+ Конкретные примеры использования мыслящих ЛЛМ

В этой статье мы рассмотрим два способа подключения вашего Python-приложения к Ollama: 1. Через HTTP REST API; 2. Через официальную библиотеку Ollama для Python.

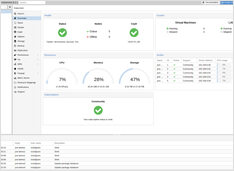

Что такое Proxmox?

Proxmox Virtual Environment (Proxmox VE) — это открытая платформа гипервизора типа 1 и оркестрации дата-центров, построенная на основе Debian.

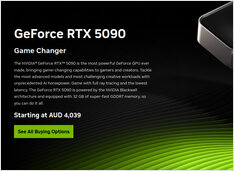

Цены на потребительские видеокарты, подходящие для ИИ — RTX 5080 и RTX 5090

Давайте сравним цены на топовые потребительские видеокарты, которые особенно подходят для работы с большими языковыми моделями (LLM) и искусственным интеллектом в целом. В частности, я рассматриваю цены на RTX-5080 и RTX-5090. Они немного снизились.

Не очень приятно.

Модели GPT-OSS от Ollama (https://www.glukhov.org/ru/llm-performance/ollama/ollama-gpt-oss-structured-output-issues/ “Ollama GPT-OSS”) постоянно сталкиваются с проблемами при работе со структурированным выводом, особенно при использовании с фреймворками вроде LangChain, OpenAI SDK, vllm и другими.

Несколько способов получения структурированного вывода из Ollama

Большие языковые модели (LLM) мощные, но в производстве мы редко хотим свободноформатных абзацев. Вместо этого нам нужны предсказуемые данные: атрибуты, факты или структурированные объекты, которые можно передать в приложение. Это Структурированный вывод LLM.

Попробовал и Kubuntu, и KDE Neon — Kubuntu стабильнее.

Для поклонников KDE Plasma в обсуждениях часто фигурируют две дистрибуции Linux: [Kubuntu и KDE Neon](https://www.glukhov.org/ru/developer-tools/comparisons/kubuntu-vs-kde-neon/ “Kubuntu vs KDE Neon”). На первый взгляд они могут показаться похожими — обе поставляются с KDE Plasma в качестве рабочего стола по умолчанию, обе основаны на Ubuntu и обе дружелюбны к новичкам.

Мое собственное тестирование планирования моделей Ollama

Здесь я сравниваю, сколько VRAM новая версия Ollama выделяет для модели по сравнению с предыдущей версией. Новая версия работает хуже.

Заметки по настройке статического IP-адреса в Linux

Это руководство проведет вас через процесс изменения статического IP-адреса на сервере Ubuntu.

Моё мнение о текущем состоянии разработки Ollama

Ollama быстро стал одним из самых популярных инструментов для запуска локальных моделей большого языка (LLM). Его простой интерфейс командной строки и упрощенное управление моделями сделали его предпочтительным вариантом для разработчиков, которые хотят работать с моделями ИИ вне облака.

Альтернативная платформа голосовой связи по IP

Mumble — это бесплатное и открытое программное обеспечение для голосовой передачи данных (VoIP), предназначенное в основном для передачи голоса в реальном времени. Оно использует клиент-серверную архитектуру, где пользователи подключаются к общему серверу для общения друг с другом.

Краткий обзор наиболее заметных интерфейсов для Ollama в 2025 году

Локально размещённый Ollama позволяет запускать большие языковые модели на вашем собственном устройстве, но использование его через командную строку не очень удобно. Вот несколько открытых проектов, которые предоставляют интерфейсы в стиле ChatGPT, подключающиеся к локальному Ollama.

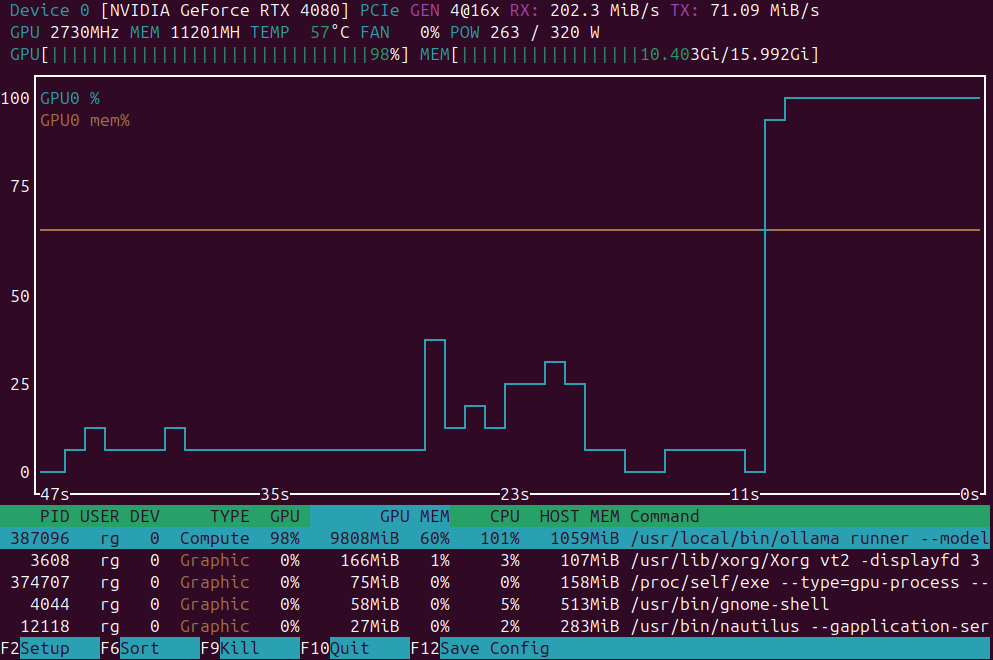

Краткий список приложений для мониторинга нагрузки на GPU

Приложения для мониторинга нагрузки GPU: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

Установка little k3s Kubernetes в кластере homelab

Вот пошаговое руководство по установке кластера K3s из 3 узлов на серверах с “голым” железом (1 мастер + 2 рабочих узла).

Краткий обзор вариантов Kubernetes

Сравнение дистрибутивов Kubernetes для саморазвертывания на bare-metal или домашних серверах, с акцентом на простоту установки, производительность, системные требования и функциональность.