Retrieval-Augmented Generation (RAG)-guide: Arkitektur, implementering och produktionsguide

Från grunden med RAG till produktion: chunkning, vektorsökning, omrankning och bedömning i en guide.

Detta Retrieval-Augmented Generation (RAG) tutorial är en steg-för-steg, produktionssnabb guide till byggning av verkliga RAG-system.

Om du söker efter:

- Hur man bygger ett RAG-system

- Förklaring av RAG-arkitektur

- RAG-tutorial med exempel

- Hur man implementerar RAG med vektor-databaser

- RAG med omrankning

- RAG med webbsökning

- Bästa praxis för produktion RAG

Du är på rätt plats.

Den här guiden sammanfattar praktisk kunskap om RAG-implementation, arkitekturella mönster och optimeringstekniker som används i produktion AI-system.

RAG-klusterkarta (Läs detta i ordning)

Om du vill ha den snabbaste vägen genom RAG-klustret, använd denna karta:

- Du är här: Översikt över RAG + slutpunkt-pipeline (den här sidan)

- Chunkning (grunden för hämtning av information): Chunkningsstrategier i RAG

- Vektorlager (val av lager + index): Jämförelse av vektorlager för RAG

- Hämtningens djup (när “sökning” inte räcker): Sökning vs DeepSearch vs Deep Research

- Omrankning (ofta den största kvalitetsförbättringen): Omrankning med inbäddningsmodeller

- Inbäddningar + omrankningsmodeller (praktiska implementationer):

- Avancerade arkitekturer: Avancerade RAG-variant: LongRAG, Self-RAG, GraphRAG

Vad är Retrieval-Augmented Generation (RAG)?

Retrieval-Augmented Generation (RAG) är ett systemdesignsmönster som kombinerar:

- Informationshämtning

- Kontextförstärkning

- Stor språkmodellgenerering

Enkelt uttryckt, en RAG-pipeline hämtar relevanta dokument och injicerar dem i prompten innan modellen genererar ett svar.

Olika finetuning, RAG:

- Fungerar med ofta uppdaterad data

- Stöder privata kunskapsbankar

- Minskar hallucination

- Undviker återträning av stora modeller

- Förbättrar svarsgrundläggande

Modern RAG-system innehåller mer än vektor-sökning. En komplett RAG implementation kan inkludera:

- Frågorewriting

- Hybrid-sökning (BM25 + vektor-sökning)

- Cross-encoder omrankning

- Flerskiktad hämtning

- Integration av webbsökning

- Utvärdering och övervakning

Minimal produktion RAG-blåprint (Referensimplementation)

Använd detta som en mental modell (och en startskiss) för produktion RAG.

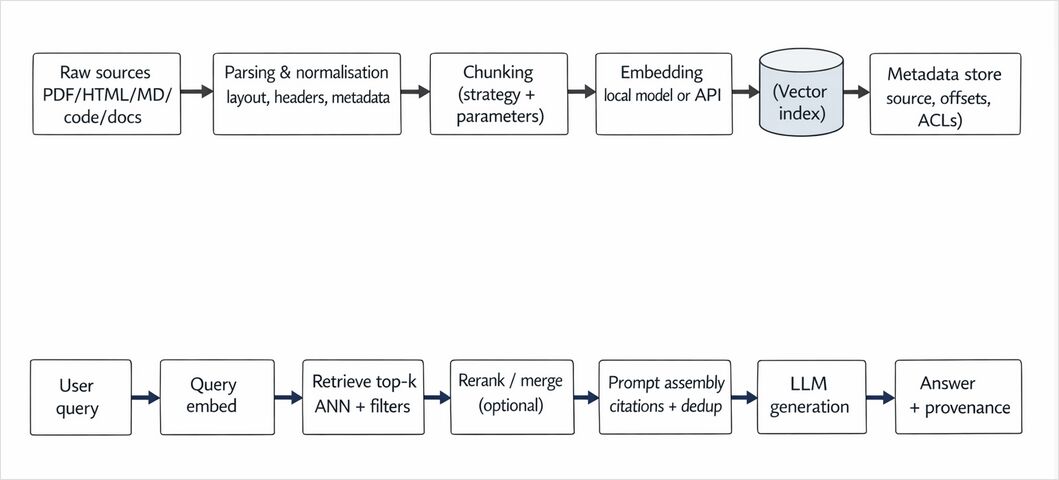

Ingestionspipeline (offline eller kontinuerlig)

- Samla källor (dokument, supportfall, webbsidor, PDF:er, kod)

- Normalisera (extrahera text, rensa skript, duplicera)

- Chunka (välj strategi + överlapp + metadata)

- Inbädda (versionerade inbäddningar)

- Upsert till index (vektorlager + metadatafält)

- Reindexstrategi när inbäddningar eller chunkning ändras

Frågepipeline (online)

- Parse / rewrite fråga (valfritt)

- Hämta kandidater (vektor eller hybrid + metadatafiltrering)

- Omranka top-K med en cross-encoder / omrankningsmodell

- Sammanställ kontext (duplicera, ordna efter relevans, lägg till referenser)

- Generera med grundad prompt (regler + avvisningsbeteende)

- Logga (hämtningssätt, omrankad uppsättning, slutgiltig kontext, latens, kostnad)

- Utvärdera (online/offline hämtare)

Om du bara förbättrar ett saker i ett fungerande RAG-system: lägg till omrankning och en utvärderingshämtare.

Steg-för-steg RAG-tutorial: Hur man bygger ett RAG-system

Detta avsnitt beskriver en praktisk RAG-tutorial-flöde för utvecklare.

Steg 1: Förbered och chunka din data

Kvaliteten på hämtning beror starkt på chunkningsstrategi och indexdesign: bra RAG börjar med korrekt chunkning.

Chunkning bestämmer:

- Hämtningens återkallelse

- Latens

- Kontextbrus

- Tokenkostnad

- Hallucinationrisk

Vanliga RAG-chunkningsstrategier inkluderar:

- Faststorlek chunkning

- Glidande fönster chunkning

- Semantisk chunkning

- Rekursiv chunkning

- Hierarkisk chunkning

- Metadatainsikts chunkning

Dålig chunkning är en av de vanligaste orsakerna till underpresterande RAG-system.

För en rigorös, ingenjörsförsta djupdykning i chunkningsväxel, utvärderingsdimensioner, beslutsdimensioner och körbara Pythonimplementeringar, se:

Chunkningsstrategier i RAG: Alternativ, växel och exempel

Den här guiden täcker praktiska standardvärden för:

- QA-system

- Sammanfattningspipelines

- Kod sökning

- Multimodella dokument

- Streaming ingestion

Om du är allvarlig med RAG-prestanda, läs den innan du justerar inbäddningar eller omrankning.

Steg 2: Välj en vektorlager för RAG

En vektorlager lagrar inbäddningar för snabb likhetssökning.

Jämför vektorlager här:

Vecktorlager för RAG - Jämförelse

När du väljer en vektorlager för en RAG-tutorial eller produktion system, överväg:

- Index typ (HNSW, IVF, osv.)

- Filtreringssupport

- Distribution modell (moln vs självvärd)

- Frågelatens

- Horisontell skalbarhet

- Multi-tenancy och tillgångskontroll krav

Steg 3: Implementera hämtning (vektor-sökning eller hybrid-sökning)

Grundläggande RAG-hämtning använder inbäddningslikhet.

Avancerad RAG-hämtning använder:

- Hybrid-sökning (vektor + nyckelord)

- Metadatafiltrering

- Multisindexhämtning

- Frågorewriting

För konceptuell grund:

Search vs DeepSearch vs Deep Research

Förstå hämtningens djup är avgörande för högkvalitativa RAG pipelines.

Steg 4: Lägg till omrankning i din RAG-pipeline

Omrankning är ofta den största kvalitetsförbättringen i en RAG implementation.

Omrankning förbättrar:

- Precision

- Kontextrelevans

- Förtroende

- Signal-till-brusförhållande

Lär dig omrankningstekniker:

- Omrankning med inbäddningsmodeller

- Qwen3-inbäddning + Qwen3-omrankare på Ollama

- Omrankning med Ollama + Qwen3-inbäddning (Go)

- Omrankning med Ollama + Qwen3-omrankare i Go

I produktion RAG-system, är omrankning ofta viktigare än att byta till en större modell.

Steg 5: Integrera webbsökning (valfritt men kraftfullt)

Webbsökning förstärkt RAG möjliggör dynamisk kunskapshämtning.

Webbsökning är användbar för:

- Realtidsdata

- Nyhetsmedvetna AI-assistenter

- Konkurrensanalys

- Öppen domäns frågansvar

Se praktiska implementationer:

Steg 6: Bygg en RAG-utvärderingsram

En allvarlig RAG-tutorial måste inkludera utvärdering. Utan det blir optimering av ett RAG-system gissning.

Vad att mäta

| Skikt | Vad att mäta | Varför det är viktigt |

|---|---|---|

| Ingestion | chunk täckning, dupliceringsfrekvens, inbäddningsversion | förhindrar tyst drift |

| Hämtning | recall@k, precision@k, MRR/NDCG | visar om du hämtar rätt bevis |

| Omrankning | förändring i precision@k jämfört med baslinje | bekräftar omrankarens ROI |

| Generering | förtroende / grundläggande, referensnoggrannhet, avvisningskvalitet | minskar hallucination |

| System | latens p50/p95, kostnad per fråga, cache träfffrekvens | håller produktionen användbar |

Minsta utvärderingshämtare (praktiskt checklist)

- Bygg en testuppsättning av frågor (verkliga användarfrågor om möjligt)

- För varje fråga, lagra:

- förväntat svar eller förväntade källor

- tillåtna källor (guldkällor) när tillgängliga

- Kör en offline batch:

- hämta kandidater

- omranka

- generera

- poängsätt (hämtning + generering)

- Följ upp mått över tid och misslycka bygget vid regressioner (även små)

Börja enkelt: 50–200 frågor är tillräckligt för att upptäcka stora regressioner.

Avancerade RAG-arkitekturer

När du förstår grundläggande RAG, utforska avancerade mönster:

Avancerade RAG-variant: LongRAG, Self-RAG, GraphRAG

Avancerade Retrieval-Augmented Generation-arkitekturer möjliggör:

- Multihopp resonemang

- Grafbaserad hämtning

- Selvkorrigera loopar

- Strukturerad kunskapsintegrering

Dessa arkitekturer är avgörande för företagsnivå AI-system.

När RAG misslyckas (Och hur man fixar det)

För det mesta är RAG-fel diagnosable om du tittar på pipelinen lager-för-lager.

- Den returnerar irrelevanta kontexter → förbättra chunkning, lägg till metadatafilter, implementera hybridsearch, justera K.

- Den hämtar rätt dokument men svarar felaktigt → lägg till omrankning, minska kontextbrus, förbättra promptgrundläggande regler.

- Den hallucinerar trots goda dokument → tvinga referenser, lägg till avvisningsbeteende, lägg till förtroendepoäng, minska “kreativ” temperatur.

- Den är långsam/kostsam → cacha hämtning + inbäddningar, minska omranknings K, begränsa kontext, batch inbäddningar, justera ANN-indexparametrar.

- Den läcker data mellan klienter → implementera ACL-filter vid hämtningstid (inte bara i prompten), separera index eller per-klientpartitioner.

Vanliga RAG-implementationfel

Vanliga fel i nybörjare RAG-tutorials inkluderar:

- Använda för stora dokumentchunkar

- Undvika omrankning

- Överlasta kontextfönstret

- Inte filtrera metadata

- Inga utvärderingshämtare

Att åtgärda dessa förbättrar RAG-systemprestanda dramatiskt.

RAG vs Finetuning

I många tutorials förväxlas RAG och finetuning. Använd denna besluts-guide:

| Du bör föredra… | När… |

|---|---|

| RAG | kunskapen ändras ofta; du behöver referenser/övervakbarhet; du har privata dokument; du vill ha snabba uppdateringar utan återträning |

| Finetuning | du behöver konsekvent ton/beteende; du vill att modellen ska följa en domännorm; din kunskap är relativt statisk |

| Båda | du behöver domännbeteende och fräscha/privata kunskaper (vanligt i produktion) |

Använd RAG för:

- Extern kunskapshämtning

- Ofta uppdaterad data

- Lägre driftsrisiko

Använd finetuning för:

- Beteendekontroll

- Ton/stilkonsekvens

- Domännanpassning när data är statisk

De flesta avancerade AI-system kombinerar Retrieval-Augmented Generation med vald finetuning.

Bästa praxis för produktion RAG

Om du går utöver en RAG-tutorial till produktion:

Hämtning + kvalitet

- Använd hybridhämtning

- Lägg till omrankning

- Använd metadatafiltrering och deduplivering

- Följ hämtningssmått kontinuerligt (recall@k / precision@k)

Kostnad + latens (förbli inte kvar)

- Cacha:

- Inbäddningscacha (identisk text → identisk inbäddning)

- Hämtningcacha (populära frågor)

- Responscacha (för deterministiska arbetsflöden)

- Justera ANN-indexparametrar (HNSW/IVF) och batchoperationer

- Kontrollera tokenanvändning: mindre kontext, färre kandidater, strukturerade prompter

Säkerhet + integritet

- Utför tillgångskontroll vid hämtningstid (ACL-filtrering / per-klientpartitioner)

- Redigera eller undvik indexering av PII där möjligt

- Logga säkert (undvik att lagra råkänsliga prompter om det inte krävs)

Driftsdisiplin

- Versionera dina inbäddningar och chunkningsstrategi

- Automatisera ingestionspipelines

- Övervaka hallucination/förtroendemått

- Följ kostnad per fråga

Retrieval-Augmented Generation är inte bara en tutorialkoncept - det är en produktion arkitektur disiplin.

Slutsatser

Den här RAG-tutorialen täcker både nybörjareimplementation och avancerad systemdesign.

Retrieval-Augmented Generation är grundpilen i moderna AI applikationer.

Att behärska RAG-arkitektur, omrankning, vektorlager, hybridsearch, och utvärdering kommer att bestämma om din AI-system förblir en demo - eller blir produktionsklar.

Detta ämne kommer att fortsätta utvecklas medan RAG-system utvecklas.