Minska LLM-kostnader: Strategier för tokenoptimering

Minska LLM-kostnader med 80% genom smart tokenoptimering

Tokenoptimering är den kritiska färdigheten som skiljer kostnadseffektiva LLM-applikationer från budgetdrainande experiment.

Minska LLM-kostnader med 80% genom smart tokenoptimering

Tokenoptimering är den kritiska färdigheten som skiljer kostnadseffektiva LLM-applikationer från budgetdrainande experiment.

Bygg MCP-server för AI-assistenter med Python-exempel

Model Context Protocol (MCP) revolutionerar hur AI-assistenter interagerar med externa datorkällor och verktyg. I den här guiden kommer vi att utforska hur man bygger MCP servrar i Python, med exempel som fokuserar på webbsökning och skrapning.

Tillgänglighet, faktiska butikspriser i sex länder och jämförelse med Mac Studio.

NVIDIA DGX Spark är en realitet, till salu 15 oktober 2025, och riktar sig mot CUDA-utvecklare som behöver lokal LLM-arbete med en integrerad NVIDIA AI-stack. US MSRP $3 999; UK/DE/JP-pris är högre på grund av moms och kanal. AUD/KRW-priser är ännu inte allmänt postade.

Integrera Ollama med Go: SDK-guide, exempel och produktionsrekommendationer.

Den här guiden ger en omfattande översikt över tillgängliga Go SDK:er för Ollama och jämför deras funktionssätt.

Jämföra hastighet, parametrar och prestanda hos dessa två modeller

Här är en jämförelse mellan Qwen3:30b och GPT-OSS:20b fokuserande på instruktionssäljning och prestandaparametrar, specifikationer och hastighet.

+ Specifika exempel med hjälp av tänkande LLMs

I detta inlägg kommer vi att utforska två sätt att ansluta din Python-applikation till Ollama: 1. Via HTTP REST API; 2. Via den officiella Ollama Python-biblioteket.

Ingenstans särskilt fin.

Ollama’s GPT-OSS modeller har återkommande problem med att hantera strukturerad utdata, särskilt när de används med ramverk som LangChain, OpenAI SDK, vllm och andra.

Lätt olika API:er kräver en särskild tillvägagångssätt.

Här är en sida vid sida jämförelse av stöd för strukturerad utdata (att få tillförlitligt JSON tillbaka) över populära LLM-leverantörer (https://www.glukhov.org/sv/llm-performance/benchmarks/structured-output-comparison-popular-llm-providers/ “strukturerad utdata över populära LLM-leverantörer”), plus minimala Python exempel

Några sätt att få strukturerad utdata från Ollama

Stora språkmodeller (LLMs) är kraftfulla, men i produktion vill vi sällan ha fritt formulerade stycken. Istället vill vi ha förutsägbart data: attribut, fakta eller strukturerade objekt som du kan mata in i en app. Det är LLM Strukturerad Utdata.

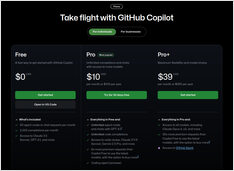

Beskrivning, planer, kommandolista och tangentbordsgenvägar

Här är en uppdaterad snabbreferens för GitHub Copilot, som täcker essentiella genvägar, kommandon, användningstips och kontextfunktioner för Visual Studio Code och Copilot Chat.

Långläsning om MCP-specifikationer och implementering i GO

Här har vi en beskrivning av The Model Context Protocol (MCP), korta anteckningar om hur man implementerar en MCP-server i Go, inklusive meddelandestruktur och protokollspecificeringar.

Implementerar du RAG? Här finns några kodexempel på Go – del 2...

Eftersom standard Ollama inte har en direkt rerank-API, behöver du implementera omrankning med Qwen3 Reranker i GO genom att generera inbäddningar (embeddings) för par av fråga-dokument och sedan betygsätta dem.

Implementerar du RAG? Här är några kodsnuttar i Golang..

Detta lilla Reranking-kodexempel i Go anropar Ollama för att generera inbäddningar för frågan och för varje kandidatdokument, och sorterar sedan i fallande ordning baserat på kosinussimilaritet.

LLM för att extrahera text från HTML...

I Ollama modellbiblioteket finns det modeller som kan konvertera HTML-innehåll till Markdown, vilket är användbart för innehållskonverteringsuppgifter. Den här guiden är en del av vår Dokumentationsverktyg 2026: Markdown, LaTeX, PDF & Skrivningsflöden hub.

Cursor AI jämfört med GitHub Copilot jämfört med Cline AI jämfört med...

Här listas några AI-assisterade kodverktyg och AI-kodassistenten samt deras fördelar.

AI-assisterad kodning där du beskriver istället för att skriva.

Vibe coding är ett AI-drivet programmeringssätt där utvecklare beskriver önskad funktionalitet på naturligt språk och låter AI-verktyg generera koden automatiskt – med minimal direkt kodning.