NVIDIA DGX Spark vs Mac Studio vs RTX-4080: Ollama-prestandajämförelse

GPT-OSS 120b-benchmärkningar på tre AI-plattformar

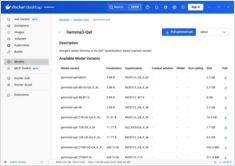

Jag hittade några intressanta prestandatest av GPT-OSS 120b som kör på Ollama över tre olika plattformar: NVIDIA DGX Spark, Mac Studio, och RTX 4080. GPT-OSS 120b-modellen från Ollama-biblioteket väger 65 GB, vilket innebär att den inte passar in i den 16 GB VRAM som finns på en RTX 4080 (eller den nyare RTX 5080).