OpenClaw Schnellstart: Installation mit Docker (Ollama GPU oder Claude + CPU)

Installieren Sie OpenClaw lokal mit Ollama

OpenClaw ist ein selbst gehosteter KI-Assistent, der mit lokalen LLM-Runtimes wie Ollama oder mit cloud-basierten Modellen wie Claude Sonnet ausgeführt werden kann.

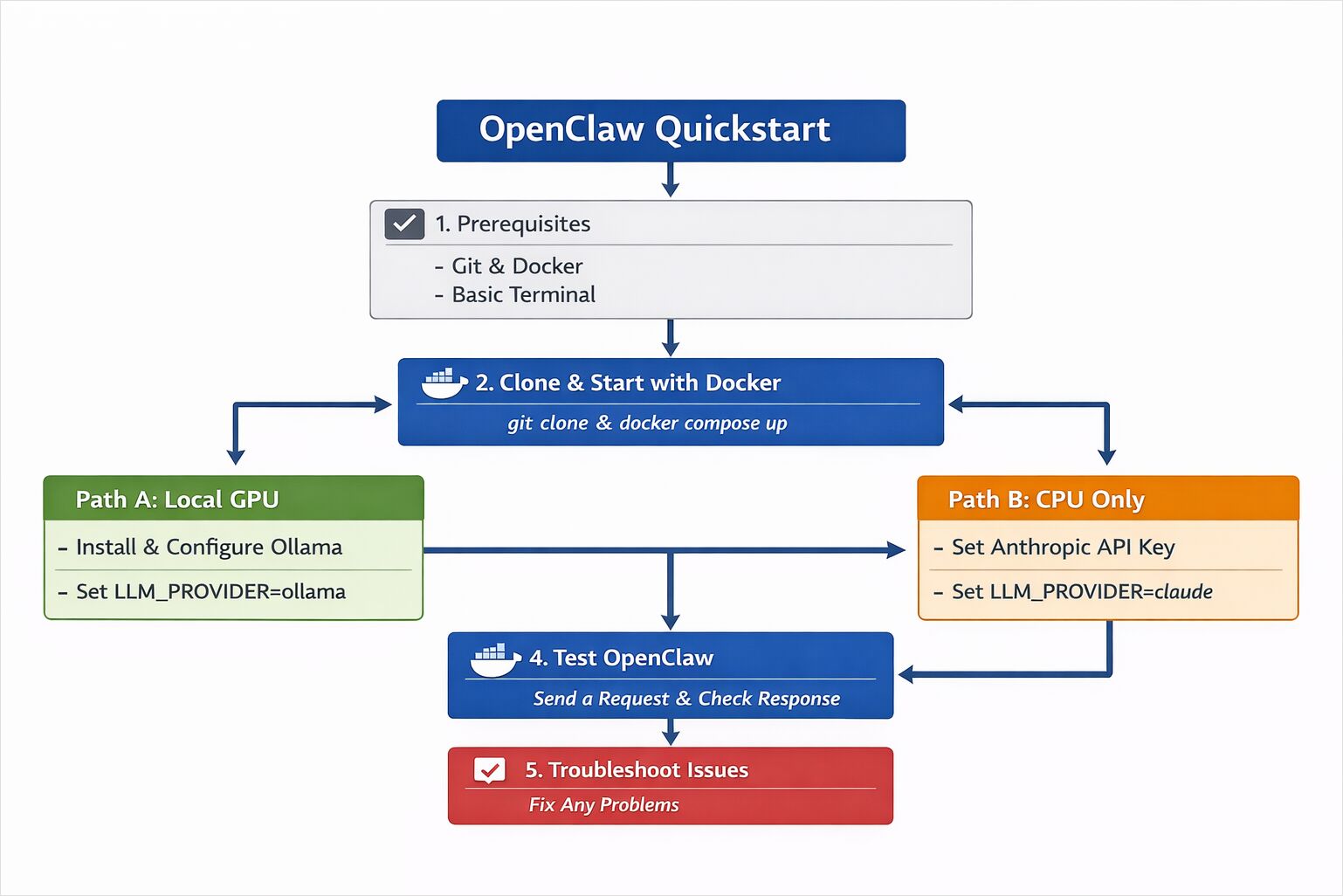

Dieser Schnellstart zeigt, wie OpenClaw mit Docker bereitgestellt wird, entweder ein GPU-gestütztes lokales Modell oder ein CPU-only-Cloud-Modell konfiguriert wird und wie sichergestellt wird, dass Ihr KI-Assistent von Anfang bis Ende funktioniert.

Dieser Leitfaden führt Sie durch eine minimale Einrichtung von OpenClaw, damit Sie sehen können, wie es auf Ihrem eigenen Gerät läuft und reagiert.

Das Ziel ist einfach:

- OpenClaw zum Laufen bringen.

- Eine Anfrage stellen.

- Bestätigen, dass es funktioniert.

Dies ist kein Leitfaden zur Produktionshärtung. Dies ist kein Leitfaden zur Leistungsoptimierung. Dies ist ein praktischer Startpunkt.

Sie haben zwei Optionen:

- Pfad A – Lokale GPU mit Ollama (empfohlen, wenn Sie eine GPU haben)

- Pfad B – CPU-only mit Claude Sonnet 4.6 über die Anthropic API

Beide Pfade teilen denselben Kern der Installationsprozess.

Wenn Sie neu bei OpenClaw sind und eine tiefere Übersicht darüber wünschen, wie das System strukturiert ist, lesen Sie die OpenClaw-Systemübersicht.

Systemanforderungen und Umgebungseinrichtung

OpenClaw ist ein Assistenten-System, das sich mit externen Diensten verbinden kann. Für diesen Schnellstart:

- Verwenden Sie nach Möglichkeit Testkonten.

- Vermeiden Sie die Verbindung sensibler Produktionssysteme.

- Führen Sie es in Docker aus (empfohlen).

Isolation ist eine gute Standardoption beim Experimentieren mit agentenbasierten Softwarelösungen.

OpenClaw-Voraussetzungen (GPU mit Ollama oder CPU mit Claude)

Für beide Pfade erforderlich

- Git

- Docker Desktop (oder Docker + Docker Compose)

- Eine Terminalkonsole

Für Pfad A (Lokale GPU)

- Ein Gerät mit einer kompatiblen GPU (NVIDIA oder AMD empfohlen)

- Ollama installiert

Für Pfad B (CPU + Cloud-Modell)

- Ein Anthropic-API-Schlüssel

- Zugriff auf Claude Sonnet 4.6

Schritt 1 – OpenClaw mit Docker installieren (Klonen & Starten)

OpenClaw kann mit Docker Compose gestartet werden. Dies hält die Einrichtung enthalten und reproduzierbar.

Repository klonen

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Umgebungs konfigurierung kopieren

cp .env.example .env

Öffnen Sie .env in Ihrem Editor. Wir werden es im nächsten Schritt konfigurieren, abhängig davon, welchen Modellpfad Sie wählen.

Container starten

docker compose up -d

Wenn alles korrekt startet, sollten Sie laufende Container sehen:

docker ps

Zu diesem Zeitpunkt ist OpenClaw zwar im Betrieb, aber noch nicht mit einem Modell verbunden.

Schritt 2 – LLM-Anbieter konfigurieren (Ollama GPU oder Claude CPU)

Entscheiden Sie nun, wie die Inferenz funktionieren soll.

Pfad A – Lokale GPU mit Ollama

Wenn eine GPU verfügbar ist, ist dies die einfachste und am meisten eigenständige Option.

Ollama installieren oder überprüfen

Wenn Sie einen detaillierteren Installationsleitfaden benötigen oder Speicherorte für Modelle konfigurieren möchten, sehen Sie:

- Ollama installieren und Speicherort für Modelle konfigurieren

- Ollama CLI-Referenz: ls, serve, run, ps + weitere Befehle (2026-Update)

Wenn Ollama nicht installiert ist:

curl -fsSL https://ollama.com/install.sh | sh

Überprüfen Sie, ob es funktioniert:

ollama pull llama3

ollama run llama3

Wenn das Modell reagiert, funktioniert die Inferenz.

OpenClaw für die Nutzung von Ollama konfigurieren

Konfigurieren Sie in Ihrer .env-Datei:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Starten Sie die Container neu:

docker compose restart

OpenClaw leitet Anfragen nun an Ihre lokale Ollama-Instanz weiter.

Wenn Sie entscheiden, welches Modell auf einer GPU mit 16 GB VRAM laufen soll, oder Benchmarks vergleichen möchten, sehen Sie:

Um Parallelität und CPU-Verhalten unter Last zu verstehen:

- Wie Ollama parallele Anfragen handhabt

- Test: Wie Ollama Intel-CPU-Leistung und effiziente Kerne nutzt

Pfad B – CPU-only mit Claude Sonnet 4.6

Wenn Sie keine GPU haben, können Sie ein gehostetes Modell verwenden.

API-Schlüssel hinzufügen

In Ihrer .env-Datei:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Neustart durchführen:

docker compose restart

OpenClaw verwendet nun Claude Sonnet 4.6 für die Inferenz, während die Orchestrierung lokal läuft.

Diese Einrichtung funktioniert gut auf CPU-only-Geräten, da die schwere Modellberechnung in der Cloud stattfindet.

Wenn Sie hier Anthropic-Modelle verwenden, erklärt diese Änderung der Claude-Abonnementrichtlinie warum OpenClaw eine API-basierte Abrechnung erfordert anstatt die Wiederverwendung von Claude-Abonnementplänen.

Schritt 3 – OpenClaw mit Ihrer ersten Eingabe testen

Sobald die Container laufen und das Modell konfiguriert ist, können Sie den Assistenten testen.

Je nach Einrichtung kann dies erfolgen über:

- Eine Weboberfläche

- Eine Messaging-Integration

- Eine lokale API-Endpunkt

Für einen grundlegenden API-Test:

curl http://localhost:3000/health

Sie sollten eine Antwort mit gesundem Status sehen.

Senden Sie nun eine einfache Eingabe:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Explain what OpenClaw does in simple terms."}'

Wenn Sie eine strukturierte Antwort erhalten, funktioniert das System.

Was Sie gerade ausgeführt haben

An diesem Punkt haben Sie:

- Eine laufende OpenClaw-Instanz

- Einen konfigurierten LLM-Anbieter (lokal oder Cloud)

- Einen funktionierenden Anfrage-Antwort-Zyklus

Wenn Sie den GPU-Pfad gewählt haben, findet die Inferenz lokal über Ollama statt.

Wenn Sie den CPU-Pfad gewählt haben, findet die Inferenz über Claude Sonnet 4.6 statt, während Orchestrierung, Routing und Speicherverwaltung in Ihren lokalen Docker-Containern laufen.

Die sichtbare Interaktion mag einfach aussehen. Darunter koordinieren mehrere Komponenten, um Ihre Anfrage zu verarbeiten.

Fehlerbehebung bei OpenClaw-Installation und Laufzeitproblemen

Modell reagiert nicht

- Überprüfen Sie Ihre

.env-Konfiguration. - Prüfen Sie die Container-Logs:

docker compose logs

Ollama nicht erreichbar

- Bestätigen Sie, dass Ollama läuft:

ollama list

- Stellen Sie sicher, dass die Basis-URL mit Ihrer Umgebung übereinstimmt.

Ungültiger API-Schlüssel

- Überprüfen Sie

ANTHROPIC_API_KEYerneut. - Starten Sie die Container nach der Aktualisierung von

.envneu.

GPU wird nicht genutzt

- Bestätigen Sie, dass GPU-Treiber installiert sind.

- Stellen Sie sicher, dass Docker GPU-Zugriff aktiviert hat.

Nächste Schritte nach der Installation von OpenClaw

Sie haben nun eine funktionierende OpenClaw-Instanz.

Von hier aus können Sie:

- Messaging-Plattformen verbinden

- Dokumentabruf aktivieren

- Routing-Strategien testen

- Observability und Metriken hinzufügen

- Leistung und Kostenverhalten optimieren

Die tiefergehenden architektonischen Diskussionen ergeben mehr Sinn, sobald das System läuft.

Das Inbetriebnahme ist der erste Schritt.

Sobald es läuft, sind die natürlichen nächsten Artikel:

- OpenClaw-Plugins-Leitfaden – welche Plugins für Speicher, Tools, Kanäle und Observability installiert werden sollen und wie der Lebenszyklus funktioniert

- OpenClaw-Fähigkeiten-Leitfaden – welche Fähigkeiten sich von ClawHub lohnen, und wie sie sicher pro Agentenrolle eingeschränkt werden können

- OpenClaw-Produktions-Einrichtungs-Muster – wie Plugins und Fähigkeiten für echte Nutzertypen wie Entwickler, Automatisierungsteams, Forscher und Support-Operatoren kombiniert werden

Für weitere Fallstudien zu KI-Systemen sehen Sie den Bereich KI-Systeme.