Ollama-Modelle an einen anderen Speicherort verschieben

Ollama-LLM-Modelldateien beanspruchen viel Speicherplatz.

Nach dem Installieren von Ollama ist es besser, Ollama sofort neu zu konfigurieren, um die Modelle direkt am neuen Speicherort abzulegen. So werden nach dem Herunterladen eines neuen Modells keine Dateien mehr am alten Ort gespeichert.

Über Ollama

Ollama ist eine textbasierte Frontend-Oberfläche für LLM-KI-Modelle und eine API, die diese ebenfalls hosten kann. Für einen breiteren Vergleich von Ollama mit vLLM, Docker Model Runner, LocalAI und Cloud-Anbietern – einschließlich Kosten- und Infrastruktur-Abwägungen – siehe LLM-Hosting: Lokale, selbst gehostete und Cloud-Infrastruktur im Vergleich.

Ollama installieren

Gehe zu https://ollama.com/download

Um Ollama unter Linux zu installieren:

curl -fsSL https://ollama.com/install.sh | sh

Ollama für Windows befindet sich auf der Seite: https://ollama.com/download/windows Ollama für Mac ist ebenfalls dort verfügbar: https://ollama.com/download/macOllamaSetup.exe

Ollama-Modelle herunterladen, auflisten und entfernen

Um einige Ollama-Modelle herunterzuladen: Gehe zur Ollama-Bibliothek (https://ollama.com/library) und suche das benötigte Modell; dort finden Sie auch Modell-Tags und Größen.

Führen Sie dann aus:

ollama pull gemma2:latest

# Oder holen Sie ein etwas klügeres Modell, das immer noch gut in 16 GB VRAM passt:

ollama pull gemma2:27b-instruct-q3_K_S

# Oder:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

Um zu prüfen, welche Modelle Ollama im lokalen Repository hat:

ollama list

Um ein nicht mehr benötigtes Modell zu entfernen:

ollama rm qwen2:7b-instruct-q8_0 # zum Beispiel

Speicherort der Ollama-Modelle

Standardmäßig werden die Modell-Dateien wie folgt gespeichert:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

Das gleiche Speicherproblem tritt auf, wenn Ollama in Containern ausgeführt wird: Sie möchten Modelle und Server-Status auf einem benannten Volume oder Bind-Mount speichern (und optional OLLAMA_MODELS, wenn das Layout vom Standardpfad /root/.ollama im offiziellen Image abweichen soll). Für eine vollständige Compose-Struktur mit GPU-Reservierung, OLLAMA_HOST, Upgrades und Rollback-Mustern siehe Ollama in Docker Compose mit GPU und persistentem Modellspeicher.

Konfigurierung des Ollama-Modellpfads unter Windows

Um eine Umgebungsvariable unter Windows zu erstellen, können Sie diesen Anweisungen folgen:

- Öffnen Sie die Windows-Einstellungen.

- Gehen Sie zu System.

- Wählen Sie Über.

- Wählen Sie Erweiterte Systemeinstellungen.

- Gehen Sie zum Register Erweitert.

- Wählen Sie Umgebungsvariablen…

- Klicken Sie auf Neu…

- Und erstellen Sie eine Variable namens OLLAMA_MODELS, die auf den gewünschten Speicherort für die Modelle zeigt.

Ollama-Modelle unter Linux verschieben

Bearbeiten Sie die systemd-Dienstparameter für Ollama:

sudo systemctl edit ollama.service

oder

sudo xed /etc/systemd/system/ollama.service

Dadurch wird ein Editor geöffnet.

Fügen Sie für jede Umgebungsvariable eine Zeile Environment unter der Sektion [Service] hinzu:

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

Speichern und schließen Sie ab.

Es gibt auch Parameter für Benutzer und Gruppe; diese müssen Zugriff auf diesen Ordner haben.

Laden Sie systemd neu und starten Sie Ollama neu:

sudo systemctl daemon-reload

sudo systemctl restart ollama

Falls etwas schiefging:

systemctl status ollama.service

sudo journalctl -u ollama.service

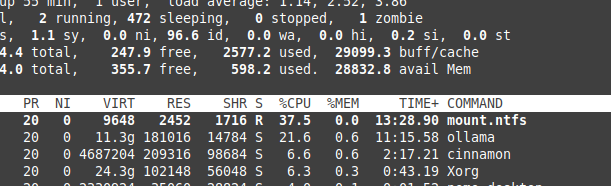

Speicherüberhead bei NTFS

Bitte beachten Sie, dass wenn Sie Linux laufen lassen und Ihre Modelle auf einer NTFS-formatierten Partition speichern, die Ladezeit Ihrer Modelle deutlich – mehr als 20 % – langsamer sein wird.

Ollama unter Windows in einen spezifischen Ordner installieren

Zusammen mit den Modellen:

.\OllamaSetup.exe /DIR=D:\OllamaDir

Ollama-API im internen Netzwerk freischalten

Intern bedeutet hier lokales Netzwerk.

Fügen Sie folgendes zur Dienstkonfiguration hinzu:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

Damit wird die reine HTTP-API in Ihrem Netzwerk freigeschaltet. Für automatisiertes HTTPS, korrekte Streaming- und WebSocket-Proxying über Caddy oder Nginx sowie Edge-Härtung (Timeouts, Pufferung, optionale Authentifizierung vor der API) verwenden Sie Ollama hinter einem Reverse-Proxy mit Caddy oder Nginx für HTTPS-Streaming.

Um Ollama von entfernten Geräten zu erreichen, ohne öffentliche Ports zu öffnen, verwenden Sie ein privates Overlay (Tailscale) oder WireGuard; siehe Fernzugriff auf Ollama über Tailscale oder WireGuard, keine öffentlichen Ports.

Um zu sehen, wie Ollama zu anderen lokalen und Cloud-LLM-Optionen passt, prüfen Sie unseren Leitfaden LLM-Hosting: Lokale, selbst gehostete und Cloud-Infrastruktur im Vergleich.

Nützliche Links

- Test: Wie Ollama Intel-CPU-Leistung und effiziente Kerne nutzt

- Wie Ollama parallele Anfragen behandelt

- LLM-Leistung und PCIe-Lanes: Wichtige Überlegungen

- Vergleich der LLM-Geschwindigkeitsleistung

- Vergleich der LLM-Zusammenfassungs-Fähigkeiten

- Effektive Prompts für LLMs schreiben

- Perplexica selbst hosten – mit Ollama

- Cloud-LLM-Anbieter