Workflowtoepassingen implementeren met Temporal in Go: een compleet gids

Maak workflows in Go met de Temporal SDK

Maak workflows in Go met de Temporal SDK

Eind-aan-eind observabiliteitsstrategie voor LLM-inferentie en LLM-toepassingen

LLM-systemen falen op manieren die traditionele API-bewaking niet kan oppassen — wachtrijen vullen zich stil, GPU-geheugen wordt lang voor CPU-busigheid volledig gebruikt, en latentie explodeert op het batchlaag-niveau in plaats van op het applicatie-laag-niveau. Deze gids behandelt een eind-afwerking observabiliteitsstrategie voor LLM-inferentie en LLM-toepassingen: wat je moet meten, hoe je het moet instrumenteren met Prometheus, OpenTelemetry en Grafana, en hoe je de telemetriepijplijn op schaal moet implementeren.

Van basis RAG tot productie: chunking, vectorzoeken, herschikken en evaluatie in één gids.

Metrieken, dashboards, logs en alerting voor productiesystemen — Prometheus, Grafana, Kubernetes en AI-workloads.

Observability vormt de basis van betrouwbare productie-systemen.

Zonder metrische gegevens, dashboards en alerting zullen Kubernetes-cluster’s afwijken, AI-workloads in stilte falen en zullen regressies in latentie onopgemerkt blijven totdat gebruikers klagen.

Beheer gegevens en modellen met zelfgehoste LLMs

Self-hosting van LLMs houdt gegevens, modellen en inferentie onder jouw controle - een praktische weg naar AI-sovereiniteit voor teams, bedrijven en naties.

LLM-snelheidstest op RTX 4080 met 16 GB VRAM

Het lokaal uitvoeren van grote taalmodellen biedt privacy, offline mogelijkheden en nul API-kosten. Deze benchmark laat precies zien wat men kan verwachten van 14 populaire LLMs op Ollama op een RTX 4080.

Python-repositories die januari 2026 trending zijn

Het Python-ecosysteem wordt deze maand gedomineerd door Claude Skills en tooling voor AI-agents. Deze analyse bespreekt de top trending Python-repositories op GitHub.

Populaire Rust-repos januari 2026

De Rust-ecosysteem explodeert met innovatieve projecten, vooral in AI-coderings-tools en terminaltoepassingen. Deze overzicht analyseert de top trending Rust-repositories op GitHub deze maand.

Populaire Go-repos januari 2026

De Go-ecosysteem blijft bloeien met innovatieve projecten die zich uitstrekken over AI-tools, zelfgehoste toepassingen en ontwikkelaarsinfrastructuur. Deze overzicht analyseert de top trending Go-repositories op GitHub deze maand.

Zelfgehoste alternatief voor ChatGPT voor lokale LLMs

Open WebUI is een krachtig, uitbreidbaar en functierijk zelfgehost webinterface voor het communiceren met grote taalmodellen.

Snel LLM-inferentie met de OpenAI API

vLLM is een inference- en serving-engine met hoge doorvoer en geheugenefficiëntie voor Large Language Models (LLM’s), ontwikkeld door het Sky Computing Lab van UC Berkeley.

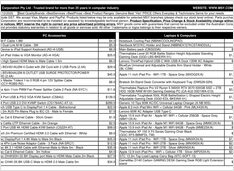

Real AUD-prijzen van Australische retailers, nu.

De NVIDIA DGX Spark (GB10 Grace Blackwell) is nu in Australië beschikbaar bij grote PC-handelaars met lokale voorraad. Als u de welvaartsprijzen en beschikbaarheid van de DGX Spark wereldwijd volgt, bent u misschien geïnteresseerd om te weten dat de prijzen in Australië variëren van $6.249 tot $7.999 AUD, afhankelijk van de opslagconfiguratie en de handelaar.

Technische gids voor het detecteren van AI-generatieerde inhoud

De verspreiding van AI-generatieerde inhoud heeft een nieuw probleem geschapen: het onderscheiden van echte menselijke schrijving van “AI slop” - laagwaardige, massaproduceerde synthetische tekst.

Cognee testen met lokale LLMs - reële resultaten

Cognee is een Python-framework voor het bouwen van kennisgrafieken uit documenten met behulp van LLMs. Werkt het echter met zelfgehoste modellen?