Стек данных для Linux: Jupyter, Pandas и инструменты

Настройка среды Linux для работы с данными в области науки

Linux стал де-факто операционной системой для профессионалов в области анализа данных.

Настройка среды Linux для работы с данными в области науки

Linux стал де-факто операционной системой для профессионалов в области анализа данных.

Ускорение FLUX.1-dev с квантованием GGUF

FLUX.1-dev — это мощная модель генерации изображений по тексту, которая производит потрясающие результаты, но её требование к памяти в 24 ГБ и более делает её сложной для запуска на многих системах. Квантование FLUX.1-dev в формате GGUF предлагает решение, уменьшая использование памяти примерно на 50% при сохранении отличного качества изображений.

Модель ИИ для дополнения изображений текстовыми инструкциями

Black Forest Labs выпустила FLUX.1-Kontext-dev, продвинутую модель искусственного интеллекта для преобразования изображений, которая дополняет существующие изображения с помощью текстовых инструкций.

Сократите затраты на LLM на 80% благодаря умной оптимизации токенов

Оптимизация токенов — это критический навык, отличающий экономически эффективные приложения на основе LLM от экспериментов, разоряющих бюджет.

Создавайте серверы MCP для ИИ-ассистентов с примерами на Python

Протокол Контекста Модели (MCP) революционизирует способ взаимодействия ИИ-ассистентов с внешними источниками данных и инструментами. В этом руководстве мы исследуем, как строить MCP-серверы на Python, с примерами, сосредоточенными на возможностях веб-поиска и парсинга.

Доступность, реальные розничные цены в шести странах и сравнение с Mac Studio.

NVIDIA DGX Spark — это реальное устройство, которое поступит в продажу 15 октября 2025 года, и оно предназначено для разработчиков CUDA, которым нужна локальная работа с LLM с интегрированным NVIDIA AI stack. Рекомендуемая розничная цена в США — $3,999; в Великобритании, Германии и Японии розничные цены выше из-за НДС и каналов сбыта. Австралийские и корейские вон пока не опубликованы широко.

Немного отличающиеся API требуют особого подхода.

Вот сравнение поддержки структурированного вывода (получение надежного JSON) среди популярных поставщиков LLM, а также минимальные примеры на Python

Несколько способов получения структурированного вывода из Ollama

Большие языковые модели (LLM) мощные, но в производстве мы редко хотим свободноформатных абзацев. Вместо этого нам нужны предсказуемые данные: атрибуты, факты или структурированные объекты, которые можно передать в приложение. Это Структурированный вывод LLM.

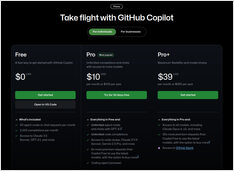

Описание, планы, список команд и сочетания клавиш

Вот актуальный шпаргалка GitHub Copilot, содержащая основные сочетания клавиш, команды, советы по использованию и функции контекста для Visual Studio Code и Copilot Chat

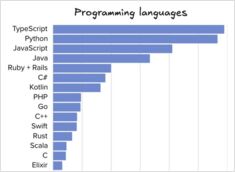

Сравнение инструментов и языков программирования

Недавно в письме Pragmatic Engineer были опубликованы статистические данные опроса о популярности языков программирования, IDE, инструментов ИИ и других данных на середину 2025 года.

В июле 2025 года скоро должно стать доступным

Nvidia готовится к выпуску NVIDIA DGX Spark - небольшого суперкомпьютера для ИИ на архитектуре Blackwell с 128+ ГБ объединённой оперативной памяти и производительностью 1 ПФЛОПС в области ИИ. Отличное устройство для запуска больших языковых моделей.

Статья о спецификациях и реализации MCP на языке GO

Здесь представлено описание Протокола Контекста Модели (MCP), краткие заметки о том, как реализовать MCP сервер на Go, включая структуру сообщений и спецификации протокола.

Реализуете RAG? Вот несколько фрагментов кода на Go - 2...

Поскольку стандартный Ollama не имеет прямого API для переупорядочивания, вам нужно реализовать переупорядочивание с использованием Qwen3 Reranker на GO, генерируя векторы представлений для пар запрос-документ и оценивая их.

Довольно давно я обучал ИИ для обнаружения объектов

Однажды холодным июльским зимним днем в Австралии… я почувствовал срочную необходимость обучить модель ИИ для обнаружения не заглушенных арматурных стержней из бетона…

Реализуете RAG? Вот несколько фрагментов кода на языке Golang.

Этот маленький

Пример кода на Go для reranking вызывает Ollama для генерации вложений

для запроса и для каждого кандидата документа,

затем сортирует по убыванию косинусной схожести.

Новые потрясающие LLM доступны в Ollama

Модели Qwen3 Embedding и Reranker являются последними выпусками в семействе Qwen, специально разработанными для продвинутых задач встраивания текста, извлечения и повторного ранжирования.