Добавление поддержки GPU NVIDIA в Docker Model Runner

Включите ускорение с помощью GPU для Docker Model Runner с поддержкой NVIDIA CUDA

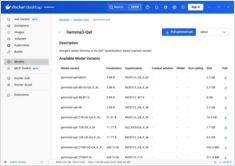

Docker Model Runner — это официальный инструмент Docker для запуска моделей ИИ локально, но включение ускорения NVIDIA GPU в Docker Model Runner требует специальной настройки.