Наблюдаемость систем LLM: метрики, трассировка, логи и тестирование в продакшене

Стратегия полной наблюдаемости для инференса LLM и приложений LLM

Стратегия полной наблюдаемости для инференса LLM и приложений LLM

Метрики, дашборды, логи и оповещения для продакшен-систем: Prometheus, Grafana, Kubernetes и AI-нагрузки.

Наблюдаемость — это основа надежных продакшн-систем.

Без метрик, дашбордов и алертинга кластеры Kubernetes постепенно деградируют, рабочие нагрузки ИИ отказывают без предупреждения, а проблемы с задержками остаются незамеченными до тех пор, пока пользователи не начнут жаловаться.

От базового RAG до продакшена: чанкинг, векторный поиск, реранкинг и оценка — всё в одном руководстве.

Управляйте данными и моделями с помощью саморазмещаемых ЛЛМ

Самостоятельное размещение LLM позволяет контролировать данные, модели и выводы — это практический путь к суверенитету ИИ для команд, предприятий и стран.

Тест скорости LLM на RTX 4080 с 16 ГБ видеопамяти

Запуск крупных языковых моделей локально обеспечивает вам конфиденциальность, возможность работы оффлайн и отсутствие затрат на API. Этот бенчмарк раскрывает, чего именно можно ожидать от 14 популярных LLMs на Ollama на RTX 4080.

Популярные Python-репозитории января 2026 года

Экосистема Python в этом месяце доминируется Claude Skills и инструментами для AI-агентов. В этом обзоре мы анализируем топовые трендовые репозитории Python на GitHub.

Трендовые репозитории Rust в январе 2026 года

Экосистема Rust бурно развивается, особенно в области инструментов для программирования на основе ИИ и терминальных приложений. Этот обзор анализирует самые популярные репозитории Rust на GitHub в этом месяце.

Трендовые Go-репозитории января 2026

Экосистема Go продолжает процветать с инновационными проектами, охватывающими инструменты ИИ, самоуправляемые приложения и инфраструктуру разработчиков. Этот обзор анализирует самые популярные репозитории Go на GitHub в этом месяце.

Самостоятельно развёртываемая альтернатива ChatGPT для локальных моделей большого языка

Открыть WebUI — это мощное, расширяемое и функциональное веб-приложение для взаимодействия с большими языковыми моделями.

Быстрый инференс LLM с использованием API OpenAI

vLLM — это высокопроизводительный, экономичный по памяти движок для вывода и развертывания больших языковых моделей (LLM), разработанный лабораторией Sky Computing Калифорнийского университета в Беркли.

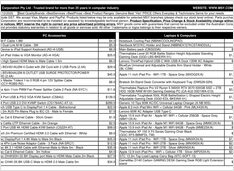

Актуальные цены в австралийских долларах от местных розничных продавцов уже доступны.

Компьютер NVIDIA DGX Spark (GB10 Grace Blackwell) поступил в продажу в Австралии у крупных розничных продавцов компьютеров с наличием на местных складах. Если вы следите за мировым ценообразованием и доступностью DGX Spark, то вам будет интересно узнать, что в Австралии цены варьируются от 6 249 до 7 999 австралийских долларов в зависимости от конфигурации накопителей и конкретного продавца.

Техническое руководство по обнаружению контента, созданного с помощью ИИ

Распространение контента, созданного с помощью ИИ, создало новую проблему: различение подлинного человеческого текста и “AI slop” - низкокачественного, массово произведенного синтетического текста.

Тестирование Cognee с локальными ЛЛМ - реальные результаты

Cognee — это фреймворк на Python для создания знаний из документов с использованием LLMs. Но работает ли он с самонастраиваемыми моделями?

Безопасные с точки зрения типов выходные данные LLM с BAML и Instructor

При работе с большими языковыми моделями в производственной среде получение структурированных, типизированных выходных данных имеет критическое значение. Два популярных фреймворка - BAML и Instructor - предлагают разные подходы к решению этой проблемы.