Docker 모델 러너에 NVIDIA GPU 지원 추가

NVIDIA CUDA 지원을 통해 Docker 모델 실행기에서 GPU 가속을 활성화하세요.

Docker Model Runner은 AI 모델을 로컬에서 실행하는 Docker의 공식 도구이지만,

Docker Model Runner에서 NVidia GPU 가속 기능 활성화

은 특정 설정이 필요합니다.

NVIDIA CUDA 지원을 통해 Docker 모델 실행기에서 GPU 가속을 활성화하세요.

Docker Model Runner은 AI 모델을 로컬에서 실행하는 Docker의 공식 도구이지만,

Docker Model Runner에서 NVidia GPU 가속 기능 활성화

은 특정 설정이 필요합니다.

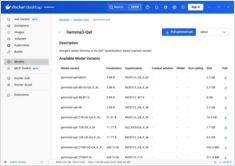

Docker Model Runner 명령어의 빠른 참조

Docker Model Runner (DMR)은 2025년 4월에 도입된 Docker의 공식 솔루션으로, 로컬에서 AI 모델을 실행하는 데 사용됩니다. 이 가이드는 모든 필수 명령, 구성 및 최선의 실천 방법을 위한 빠른 참조를 제공합니다.

로컬 LLM용 Docker Model Runner와 Ollama 비교

로컬에서 대규모 언어 모델(LLM) 실행 는 프라이버시, 비용 관리 및 오프라인 기능을 위해 점점 더 인기를 끌고 있습니다. 2025년 4월에 Docker가 Docker Model Runner (DMR), AI 모델 배포를 위한 공식 솔루션을 도입하면서 상황은 크게 변화했습니다.

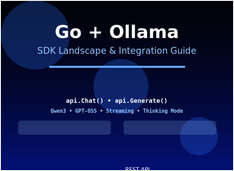

Ollama를 Go와 통합하기: SDK 가이드, 예제 및 프로덕션 최고 실천 방법

이 가이드는 사용 가능한 Ollama용 Go SDK에 대한 종합적인 개요를 제공하고, 그들의 기능 세트를 비교합니다.

+ 사고형 LLM을 사용한 구체적인 예시

이 포스트에서는 Python 애플리케이션을 Ollama에 연결하는 방법에 대해 두 가지 방법을 소개합니다: 1. HTTP REST API를 통해; 2. 공식 Ollama Python 라이브러리를 통해.

현재 Ollama 개발 상태에 대한 제 의견

Ollama은 LLM을 로컬에서 실행하는 데 사용되는 가장 인기 있는 도구 중 하나로 빠르게 자리 잡았습니다. 간단한 CLI와 스트리밍된 모델 관리 기능으로 인해 클라우드 외부에서 AI 모델을 다루고자 하는 개발자들에게 필수적인 선택지가 되었습니다.

2025년 Ollama의 가장 주목받는 UI에 대한 간략한 개요

로컬에서 호스팅된 Ollama는 자신의 기계에서 대규모 언어 모델을 실행할 수 있게 해주지만, 명령줄을 통해 사용하는 것은 사용자 친화적이지 않습니다.

다음은 로컬 Ollama에 연결되는 **ChatGPT 스타일 인터페이스**를 제공하는 여러 오픈소스 프로젝트입니다.

qwen3 8b, 14b 및 30b, devstral 24b, mistral small 24b

이 테스트에서는 Ollama에 호스팅된 다양한 LLM이 Hugo 페이지를 영어에서 독일어로 번역하는 방식을 비교하고 있습니다. 다른 LLM이 호스팅된 Ollama에서 Hugo 페이지를 영어에서 독일어로 번역하는 방식 비교.

LLM 제공업체 짧은 목록

LLM을 사용하는 것은 매우 비용이 많이 들지 않으며, 새로운 고성능 GPU를 구매할 필요가 있을 수도 있습니다.

클라우드에서 제공하는 LLM 제공업체 목록을 확인해보세요. 이 목록에는 제공업체가 호스팅하는 LLM이 나와 있습니다.

두 개의 deepseek-r1 모델을 두 개의 기본 모델과 비교합니다.

DeepSeek’s 첫 세대 추론 모델로, OpenAI-o1과 유사한 성능을 보입니다. 이 모델은 Llama와 Qwen을 기반으로 한 DeepSeek-R1에서 추출한 6개의 밀집 모델입니다.

업데이트된 Ollama 명령어 목록 - ls, ps, run, serve 등

이 Ollama CLI 치트시트 는 매일 사용하는 명령어 (ollama ls, ollama serve, ollama run, ollama ps, 모델 관리 및 일반적인 워크플로우) 에 초점을 맞추며, 복사/붙여넣기 할 수 있는 예제를 제공합니다.

두 개의 자체 호스팅 AI 검색 엔진 비교

아름다운 음식은 눈으로도 즐길 수 있는 즐거움입니다. 하지만 이번 포스팅에서는 두 가지 AI 기반 검색 시스템인 Farfalle 와 Perplexica 를 비교해 보겠습니다.

로컬에서 코파일럿 스타일 서비스를 실행하시나요? 간단합니다!

정말 흥미진진합니다!

코파일럿 (Copilot) 이나 perplexity.ai 에 접속하여 전 세계에 당신의 의도를 알릴 필요 없이, 이제 자신의 PC 나 노트북에서 유사한 서비스를 직접 호스팅할 수 있습니다!

Ollama LLM 모델 파일은 많은 공간을 차지합니다.

ollama 설치 후 모델을 즉시 새 위치로 저장하도록 ollama 를 재구성하는 것이 좋습니다. 이렇게 하면 새로운 모델을 풀링 (pull) 할 때 이전 위치로 다운로드되지 않습니다.