비교: Qwen3:30b vs GPT-OSS:20b

이 두 모델의 속도, 파라미터 및 성능 비교

다음은 Qwen3:30b와 GPT-OSS:20b 사이의 비교입니다. 지시사항 준수 및 성능 파라미터, 사양 및 속도에 초점을 맞추고 있습니다.

이 두 모델의 속도, 파라미터 및 성능 비교

다음은 Qwen3:30b와 GPT-OSS:20b 사이의 비교입니다. 지시사항 준수 및 성능 파라미터, 사양 및 속도에 초점을 맞추고 있습니다.

호스팅 비용 추정치와 구독 비용의 비교

다음은 Write.as / WriteFreely에 대한 간단한 정보입니다: fediverse에 어떻게 통합되는지, 관리형 호스팅을 어디서 구할 수 있는지, 사용 트렌드는 어떻게 되는지, 그리고 어떻게 자체 호스팅할 수 있는지(비용 예상 포함).

+ 사고형 LLM을 사용한 구체적인 예시

이 포스트에서는 Python 애플리케이션을 Ollama에 연결하는 방법에 대해 두 가지 방법을 소개합니다: 1. HTTP REST API를 통해; 2. 공식 Ollama Python 라이브러리를 통해.

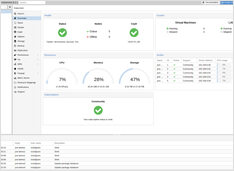

프록시모克斯란 무엇인가?

**Proxmox Virtual Environment (Proxmox VE)**는 Debian 기반으로 만들어진 오픈소스, 타입-1 하이퍼바이저 및 데이터센터 오케스트레이션 플랫폼입니다.

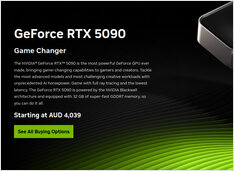

AI 에 적합한 소비자용 GPU 가격 - RTX 5080 과 RTX 5090

LLM 을 비롯한 AI 작업에 적합한 최상위 소비자용 GPU 의 가격을 비교해 보겠습니다. 특히 RTX-5080 과 RTX-5090 가격 에 주목합니다. 가격이 약간 하락했습니다.

매우 좋지 않다.

Ollama의 GPT-OSS 모델은 특히 LangChain, OpenAI SDK, vllm과 같은 프레임워크와 함께 사용될 때 구조화된 출력을 처리하는 데 반복적으로 문제가 발생합니다.

Ollama에서 구조화된 출력을 얻는 몇 가지 방법

대규모 언어 모델(LLMs) 은 강력하지만, 실제 운영 환경에서는 일반적인 문장이 아닌 예측 가능한 데이터를 원합니다. 즉, 앱에 입력할 수 있는 속성, 사실 또는 구조화된 객체를 원합니다. 이에 대해 LLM 구조화된 출력을 살펴보겠습니다.

Kubuntu 와 KDE Neon 을 모두 사용해 보았는데, Kubuntu 가 더 안정적입니다.

KDE Plasma 팬들에게 자주 논의되는 두 가지 Linux 배포판이 있습니다: Kubuntu와 KDE Neon. 이들은 유사해 보입니다 - 둘 다 기본 데스크톱으로 KDE Plasma 를 탑재하고, 둘 다 Ubuntu 를 기반으로 하며, 둘 다 초보자에게 친화적입니다.

내가 직접 수행한 ollama 모델 스케줄링 테스트

여기에서 저는 새로운 버전의 Ollama가 모델에 얼마나 많은 VRAM을 할당하는지와 이전 버전의 Ollama를 비교하고 있습니다. 새로운 버전은 오히려 더 나빠졌습니다.

리눅스에서 정적 IP 구성에 관한 참고 사항

이 가이드는 Ubuntu 서버에서 정적 IP 주소 변경 방법을 단계별로 안내합니다.

현재 Ollama 개발 상태에 대한 제 의견

Ollama은 LLM을 로컬에서 실행하는 데 사용되는 가장 인기 있는 도구 중 하나로 빠르게 자리 잡았습니다. 간단한 CLI와 스트리밍된 모델 관리 기능으로 인해 클라우드 외부에서 AI 모델을 다루고자 하는 개발자들에게 필수적인 선택지가 되었습니다.

대체 VoIP 통신 플랫폼

Mumble은 주로 실시간 음성 통신을 위해 설계된 무료이고 오픈소스의 음성 통화(VoIP) 애플리케이션입니다. 사용자들이 공유된 서버에 연결하여 서로와 대화할 수 있도록 클라이언트-서버 아키텍처를 사용합니다.

2025년 Ollama의 가장 주목받는 UI에 대한 간략한 개요

로컬에서 호스팅된 Ollama는 자신의 기계에서 대규모 언어 모델을 실행할 수 있게 해주지만, 명령줄을 통해 사용하는 것은 사용자 친화적이지 않습니다.

다음은 로컬 Ollama에 연결되는 **ChatGPT 스타일 인터페이스**를 제공하는 여러 오픈소스 프로젝트입니다.

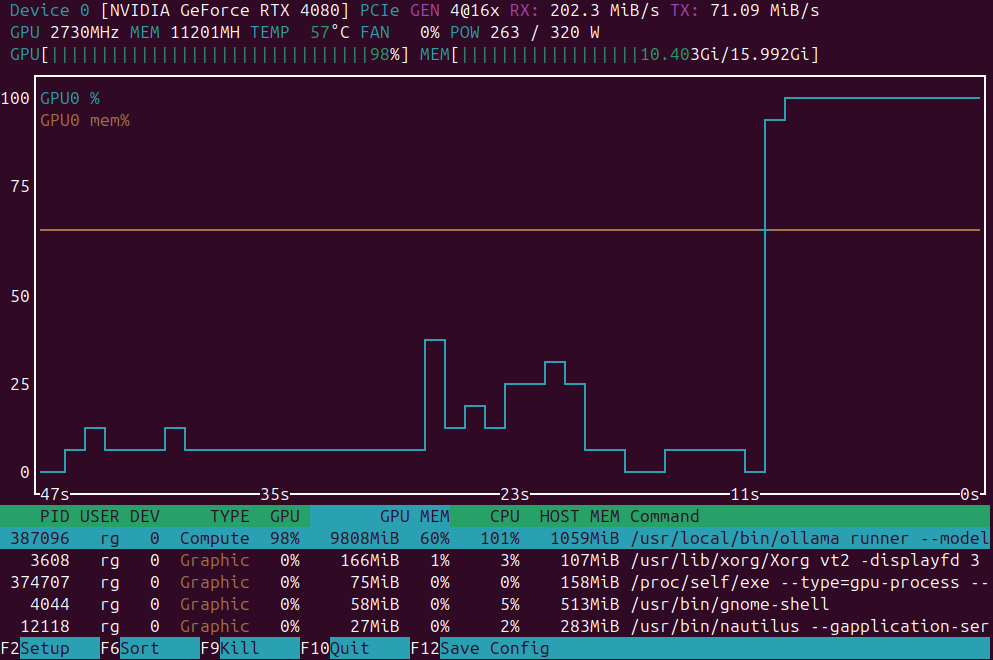

GPU 부하 모니터링을 위한 애플리케이션 목록

GPU 로드 모니터링 애플리케이션: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

홈랩 클러스터에 little k3s 쿠버네티스 설치

3노드 K3s 클러스터의 설치 단계별 가이드를 아래에 제공합니다.

이 가이드는 물리 서버(1 마스터 + 2 워커)에서 실행되는

**3노드 K3s 클러스터 설치**에 대한 것입니다.

쿠버네티스 변종에 대한 매우 짧은 개요

자체 호스팅 Kubernetes(self-hosting Kubernetes) 분포를 비교하여, 베어메탈 또는 홈 서버에 호스팅할 때 설치 용이성, 성능, 시스템 요구사항, 기능 세트에 초점을 맞추고 있습니다.