Сравнение AI-ассистентов программирования

Cursor AI против GitHub Copilot против Cline AI против...

Список здесь некоторых инструментов для кодирования с помощью ИИ и AI Coding Assistants и их приятных сторон.

Cursor AI против GitHub Copilot против Cline AI против...

Список здесь некоторых инструментов для кодирования с помощью ИИ и AI Coding Assistants и их приятных сторон.

Ollama на процессорах Intel: эффективность против производительных ядер

У меня есть теория, которую нужно проверить - использование всех ядер Intel CPU повысит скорость работы LLMs? (Тест: Как Ollama использует производительность и эффективные ядра Intel CPU)

Меня беспокоит, что новая модель gemma3 27 бит (gemma3:27b, 17ГБ в ollama) не помещается в 16ГБ видеопамяти моей GPU и частично работает на CPU.

Полезные команды MinIO

MinIO предоставляет два стандартных интерфейса: (1) MinIO Console - это веб-интерфейс, и (2) Команда MinIO - это командная строка util mc.

Обзор и установка MinIO

MinIO — это открытое программное обеспечение с высокой производительностью, распределённая система хранения объектов, разработанная для полной совместимости с API Amazon S3.

Искусственный интеллект требует большого количества энергии...

В разгар современных потрясений я сравниваю технические характеристики различных видеокарт, подходящих для задач ИИ (Deep Learning, Обнаружение объектов и LLMs). Однако все они невероятно дороги.

Наиболее популярные темы для Hugo

Давайте посмотрим на github список лучших тем для Hugo статического генератора сайтов,

и проверим их рейтинг звёзд.

Вы можете перейти к официальному списку тем Hugo: https://themes.gohugo.io/

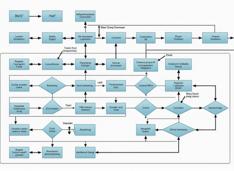

Настройка ollama для параллельного выполнения запросов.

Когда сервер Ollama получает два запроса одновременно, его поведение зависит от конфигурации и доступных системных ресурсов.

Немного системного администрирования

Probably shoud call this инженерия платформ now. Here are some notes on как установить, подключить и удалить Portainer - docker images and containers manager UI.

Когда нужно быстро выполнить асинхронные операции в облаке

Краткое сравнение RabbitMQ на AWS EKS и AWS SQS

Иногда вам нужно добавить отправку формы на ваш сайт, основанный на Hugo.

Не каждый второй пятницу, но всё равно… У нас есть два основных подхода

Запуск любого исполняемого файла в качестве службы Linux

Вот набор инструкций по

Как настроить запуск любого исполняемого файла как службы в Linux с использованием Systemd.

Сравнение двух моделей deepseek-r1 с двумя базовыми

DeepSeek’s первая генерация моделей рассуждений с производительностью, сопоставимой с OpenAI-o1, включает шесть плотных моделей, дистиллированных на основе Llama и Qwen.

Некоторые концепции POSSE и примеры

POSSE

, который означает “Publish (on your) Own Site, Syndicate Elsewhere,” является

стратегией публикации контента

, акцентирующей внимание на владении и контроле над вашим онлайн-контентом.

Некоторые детали о SearXNG

Объединение Python-программы в один файл

Используйте PyInstaller

для упаковки Python

программ в отдельные исполняемые файлы. Работает на Linux, Windows и Mac.

Не самый эффективный способ, но пригодный для использования.

Альтернативы Twitter/X/Facebook/Reddit

Есть целый мир основных социальных сетевых платформ. И есть небольшой мир альтернативных платформ - федиверса (Fediverse). Я покажу, насколько популярен федиверс.